一、为什么要考虑这个问题:

手眼标定求出机械基座坐标系和相机坐标系的转换关系(眼在手外),但是D435I显然拥有多个相机坐标系,所以要考虑点云建立时使用的是哪一个坐标系。

二、实验

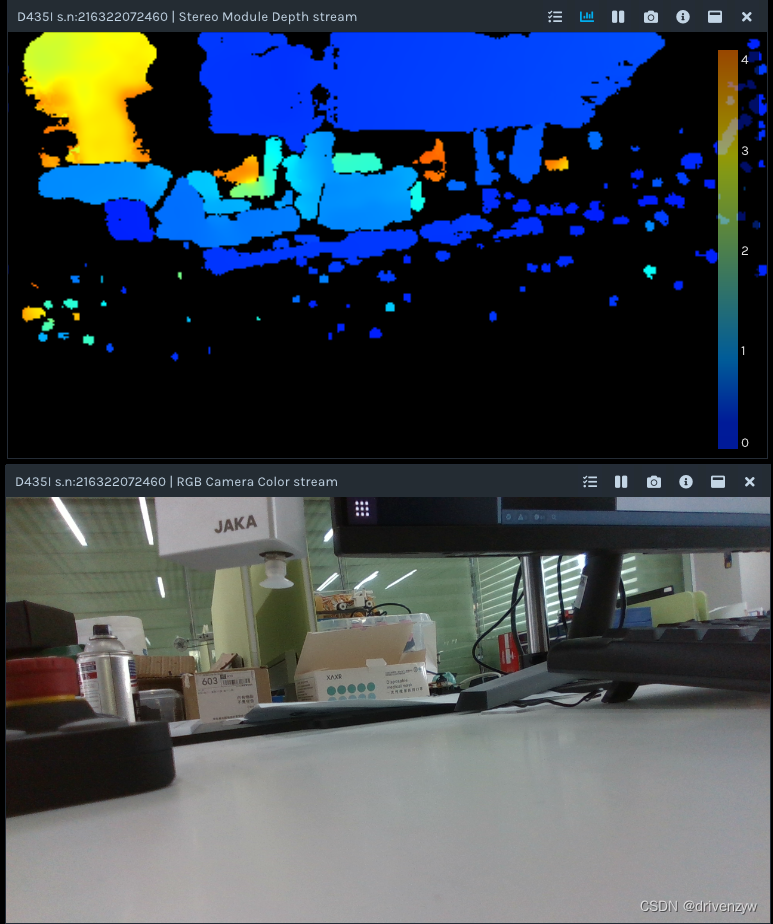

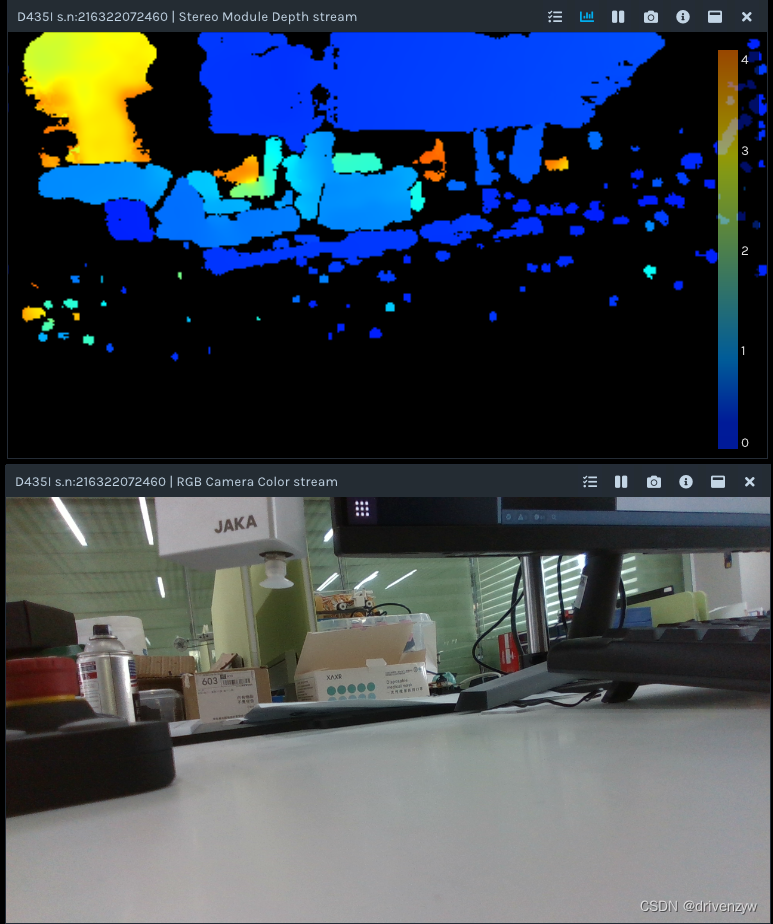

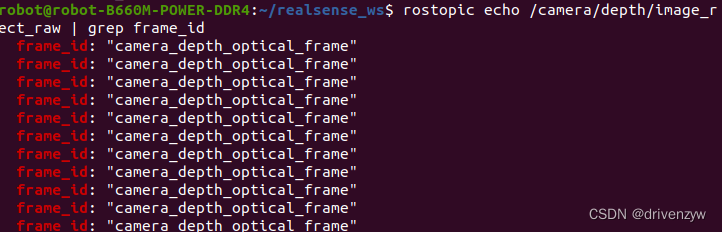

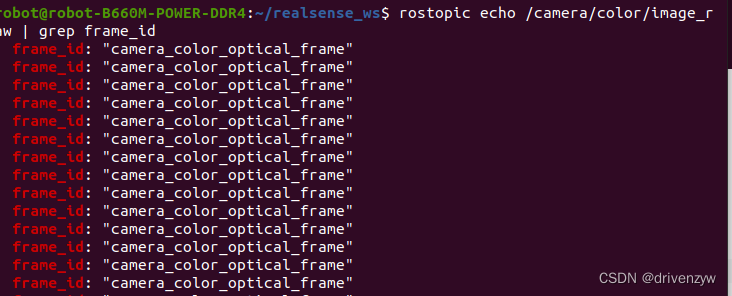

很明显,深度图和RGB图坐标不同

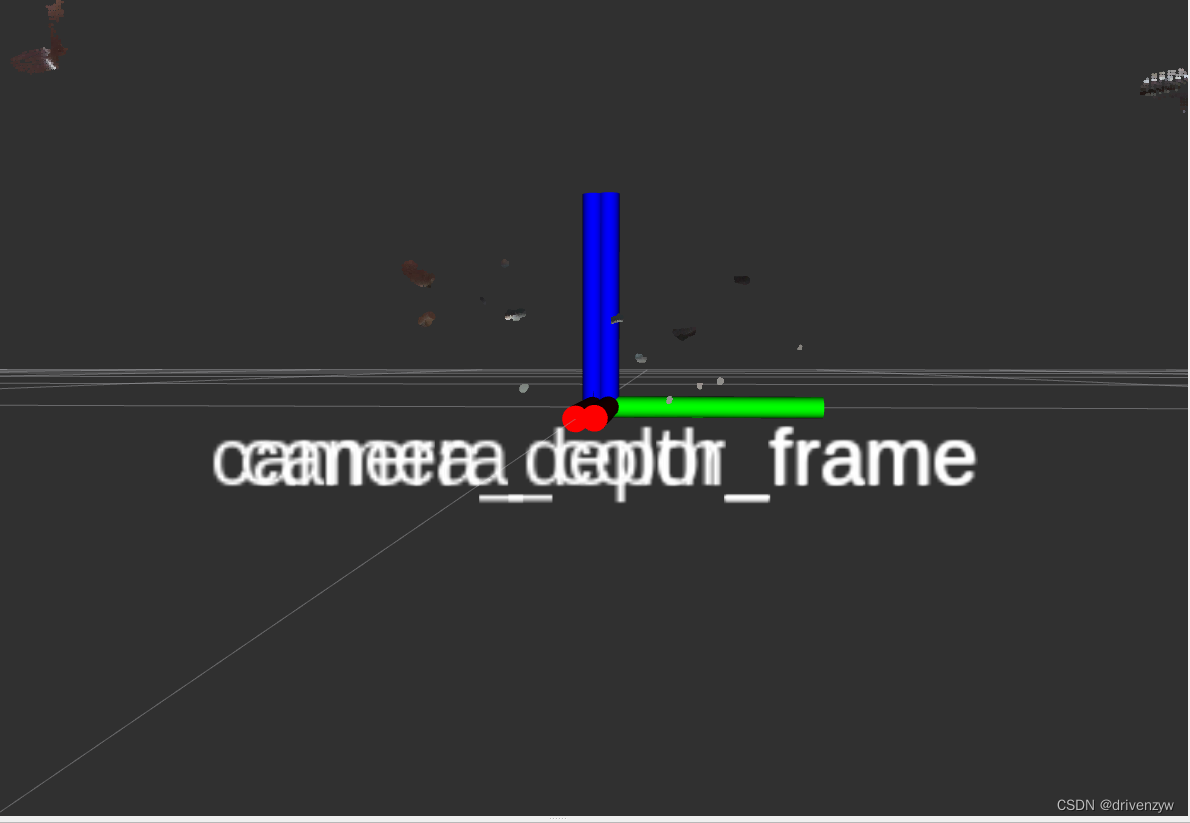

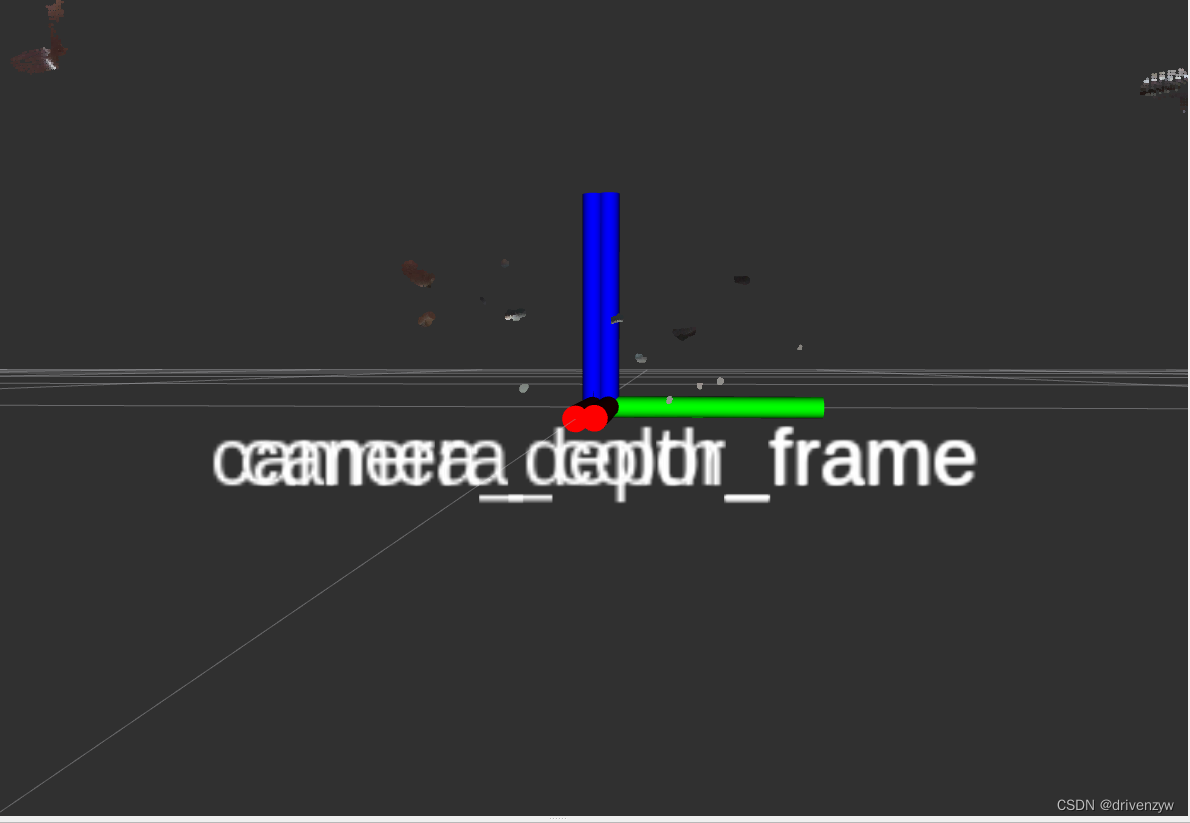

左边的是深度相机的坐标系

右边的是RGB相机的坐标系

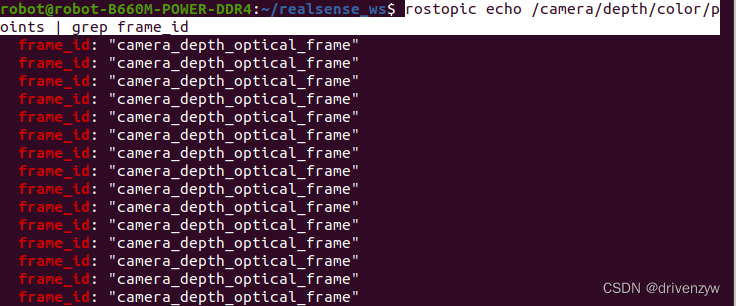

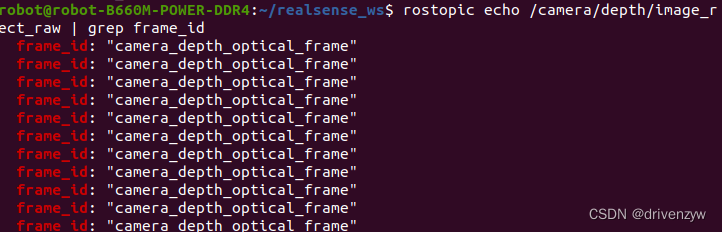

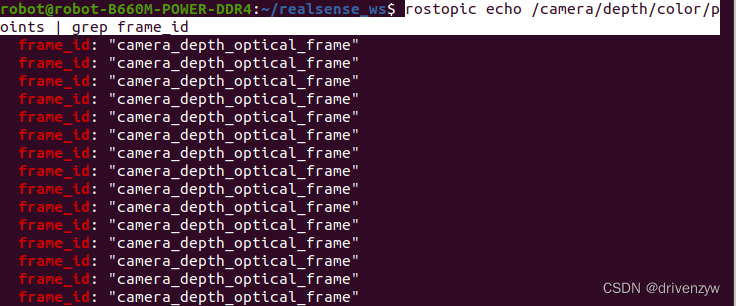

查看点云话题的坐标系

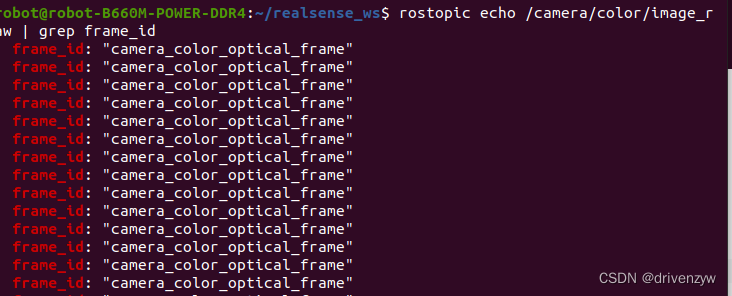

rostopic echo /camera/depth/color/points | grep frame_id

手眼标定求出机械基座坐标系和相机坐标系的转换关系(眼在手外),但是D435I显然拥有多个相机坐标系,所以要考虑点云建立时使用的是哪一个坐标系。

很明显,深度图和RGB图坐标不同

左边的是深度相机的坐标系

右边的是RGB相机的坐标系

查看点云话题的坐标系

rostopic echo /camera/depth/color/points | grep frame_id

1658

1658

1万+

1万+

6062

6062

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?