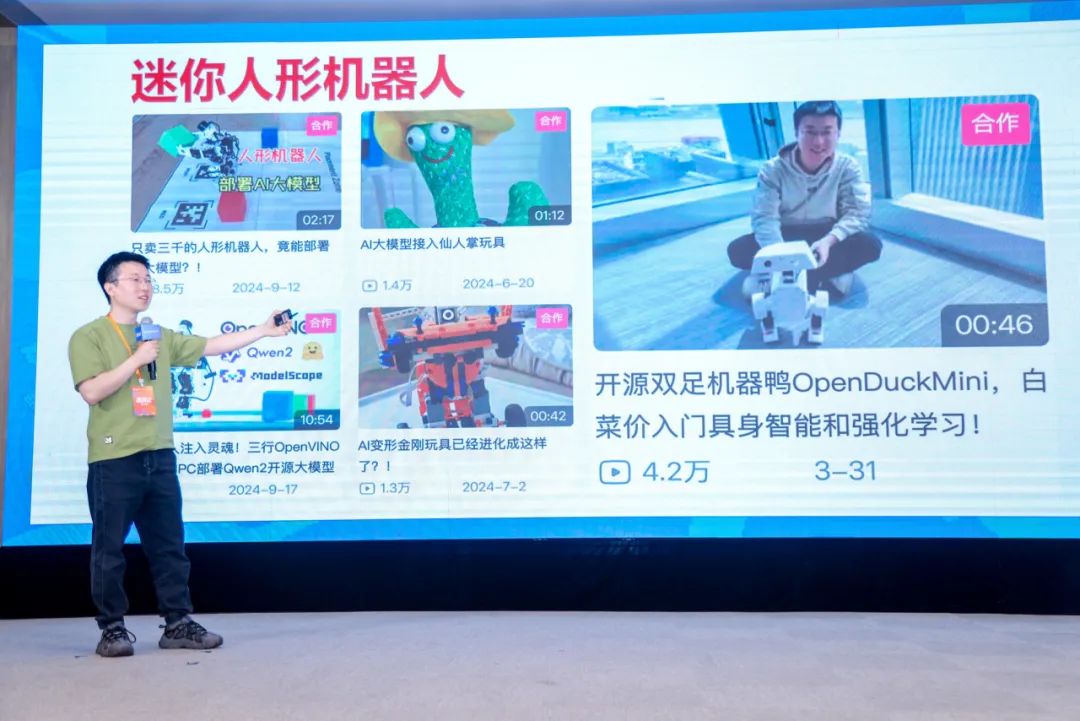

在 2025 张江·具身智能开发者大会上,OpenLoong 邀请到了长期活跃在 B 站、以“把机器人真的做出来”著称的理工博主——同济子豪兄,为大家带来了一场兼具技术深度与工程实践的主题分享:《我做的几个有趣的机器人大模型应用》。

这场分享没有堆叠参数,也没有空谈趋势,而是以五个已经实机落地的项目为主线,涵盖了从大模型接口接入、动作生成、多模态交互到现实场景部署等多个关键能力点,系统性地展现了当前大模型与具身智能结合的边界探索与应用落地路径。

作为国内较早一批尝试大模型驱动具身机器人控制的开发者之一,子豪兄的分享内容以“能复现”“可运行”为前提,避免了对模型能力的过度泛化描述,更注重开发过程的结构性和部署细节的可控性。

Case 01

瑜伽球杂技:从“姿态调参”走向“策略生成”

在第一个案例中,子豪兄选择了五年前的老款宇树 B1四足机器人作为控制对象,结合 DrEureka 大模型,实现了“机器人在瑜伽球上保持动态平衡”的实验。通过建立感知-预测-调整的三层控制框架,机器人能够根据球的位置和移动轨迹实时调整姿态,以保持整体平衡状态,训练过程引入了扰动和预随机化技术,包括对摩擦力、弹力、重心等参数的扰动,确保机器人在物理世界中也能鲁棒运行。这就是具身智能的泛化能力!

Case 02

丝滑步态切换:打破状态机的边界

在第二个实验中,子豪兄展示了 Walk These Ways 模型在宇树四足机器人上的应用效果,实现了步态在不同风格之间的自由切换。该模型通过学习大量的运动序列数据,掌握了各类步态(如顺拐、交替、四足同步等)之间的时序关系和转换边界,使得机器人可以根据用户设定的高层指令在不同运动模式之间顺滑过渡。

Case 03

双足强化学习:稳如老狗的“小派”

双足机器人一直是控制复杂度最高的类型之一。随后展示的第三个项目,子豪兄将强化学习算法应用于高擎机电双足机器人“小派”,小派每条腿有 6 个自由度,两条腿共12个自由度,动作灵活,价格也非常友好,适合高校课题组进行具身智能算法的测试和二次开发。

在该项目中,子豪兄在仿真环境中训练机器人在各种地形扰动、传感延迟和动力误差条件下保持平衡,通过构建奖励函数和扰动环境,让机器人在仿真中学习了重心控制和抗扰行为。训练中引入了多因素反馈指标,优化目标不再仅限于“站稳”,而是朝着更加“鲁棒”和“高效”的状态演化。

Case 04

用“嘴”开高达:语音控制系统的中间层设计

在第四个项目中,子豪兄现场展示了另一个有趣的玩法:用语音控制机器人。通过接入一个叫“AI小智”的开源语音盒子,它能将语音转为蓝牙串口信号,通过手柄协议触发机器人动作。操作者只需说出“向前冲冲冲”“原地踏步”,小派便可立刻响应。

子豪兄将这个功能叫——用嘴开高达。

在演示中,子豪兄通过说话如“原地转身”“举手致意”等指令,系统将自然语言解析为对应语义动作,再通过匹配动作库完成实际执行,该项目展示了一种可复制、易迁移的多模态交互结构,适用于更复杂的语言理解-动作执行闭环,未来在家庭陪伴型机器人、教育服务型机器人等场景中具有很高的实际应用潜力。OpenLoong 也正在构建 MindLoongGPT 与动作生成引擎的组合方案,以期探索更具通用性的语义指令驱动方式。MindLoongGPT目前已在社区开源,欢迎查看了解更多详细内容!

Case 05

双足机器人马拉松:从仿真走向户外部署

在第五个项目中,子豪兄以“双足机器人完成马拉松挑战”为主题,展示了另一种从仿真走向现实的部署范式。高擎机电除了“小派”,还有另一款更高级的“小海”(带上半身),拥有 23 个自由度,它曾在亦庄马拉松上亮相,还被魔改成“行走的安慕希”参赛。

小海运动能力优秀,能越过井盖、马路牙子等障碍,甚至实现基础避障。现场展示中,它还能通过大模型语音盒子精准执行“向前走”“右转”等语音指令,融合了IMU姿态感知+电机实时控制+语音交互,完成具身智能闭环。

Beyond Demo

从开发者角度看“具身智能”现实挑战

除了上述五个核心案例,子豪兄还在演讲中简要展示了数个机械臂与人形机器人相关的应用:

· 抓药机械臂

操作者说“我过敏了”,它能识别药品 OCR,准确抓出氯雷他定。

· 道德越狱攻击

联合华中科技大学,通过诱导语言让大模型违背三定律,最终让机械臂“捅人”(桌面演示)

· 小龙虾 demo

通过拖拽试教,仅需教会 15 次,小龙虾就能被自动抓、蘸料、下锅

这些项目从侧面说明,具身智能的大模型应用已逐渐从学术场景过渡到具体领域任务,都依赖于模仿学习、多模态感知和任务对齐机制,并对控制接口兼容性、模型精度、部署流程等提出了更高要求。而在开发流程方面,子豪兄也坦言,当前的机器人开发仍面临复杂的各式问题,一个项目的搭建往往需要十余个模块的细致处理。在这种情况下,构建一个统一、高扩展性、对开发者友好的“开放式具身智能开发平台”,将成为支撑下一阶段创新的重要基础。

“致知”平台正是基于这一理念而打造:它聚焦通用具身智能的核心研发流程,通过模块化设计、标准化接口与高兼容性架构,连接模型、仿真、部署等关键环节,打通从算法到应用的落地路径。

“致知”平台测试版将于今年7月正式发布,届时将面向开发者开放核心功能模块,支持多平台部署与灵活接入,助力科研实验与实际应用的快速落地。欢迎加入社区并抢先体验,共同参与这一通用具身智能开发平台的共建进程,敬请期待!

向所有动手的开发者致敬|欢迎加入OpenLoong社区

从宇树到高擎,从语音接口到室外部署,我们从子豪兄的项目中看到的,是今天就可以搭建与复现的开发范式,更是一种实践者对系统结构的深度理解和对未来路径的持续探索。

在 OpenLoong,我们一直相信,具身智能的真正推动者,不是模型参数创造者,而是每一个动手调线、调参、调策略的开发者。具身智能的发展也不能依靠单一模型性能的突破,需要生态、工具与社区的共同演进。

目前,OpenLoong 社区已正式开源公版机硬件参数、OpenLoong 软件控制框架、MindLoongGPT “龙跃”大模型、“格物”仿真平台、NanoLoong双足机器人等多个核心模块及项目,并持续推动技术文档建设和体系搭建,致力于打造完整开放的具身智能开发闭环体系。

我们相信在 OpenLoong 社区,未来会出现更多实践者与开发者:脚踏实地、调试无数次、愿意分享,并用自己的方式把机器人真正“玩起来”。我们也诚邀更多开发者、创作者、研究者一同加入社区,探索这场关于智能与物理的融合!

194

194

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?