1、PCA的原理

-

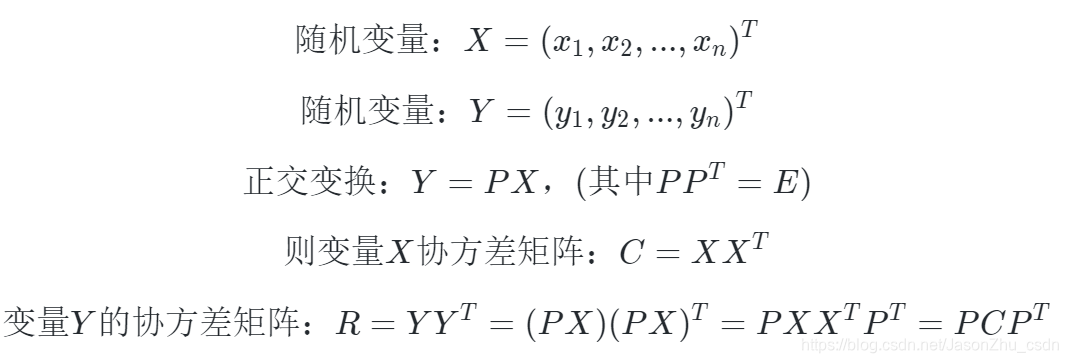

设n维随机变量X, 其对应的协方差矩阵是C

-

-

基于正交矩阵P,对随机变量X做正交变换,得到变量Y,对应协方差矩阵为R,如下所示。

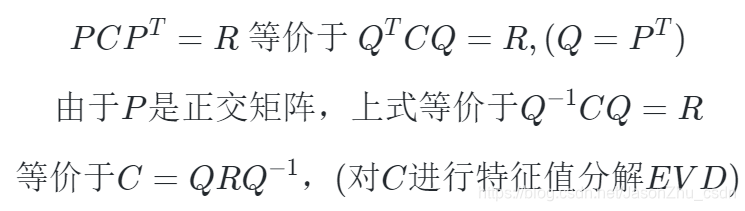

C是X的协方差矩阵,R是Y的协方差矩阵,二者都是一个对称矩阵 协方差矩阵的对角线以外的值都是n维变量各分量之间的相关性的度量值,当值为0时表示两个分量无关,即相互独立,此时我们得到的变量具有很好的统计特性,便于处理,即我们的目标是找到正交矩阵P使下式成立

即对C进行相似对角化处理,生成对角矩阵R

根据对称矩阵的性质可知,一定存在对角阵与C正交相似

此时,

- 对角矩阵R是矩阵C的对应特征值组成的对角阵,

- 变换矩阵Q是C的特征值对应的正交化的特征向量组。

特征值分解(EVD)步骤

- 求特征值

本文深入探讨PCA(主成分分析)的原理,通过特征值分解(EVD)降低数据维度,强调正交变换在寻找不相关变量中的作用。同时,文章拓展讨论EVD和奇异值分解(SVD)的区别,指出SVD在处理非方阵时的优势,并在PCA中常用SVD来实现。

本文深入探讨PCA(主成分分析)的原理,通过特征值分解(EVD)降低数据维度,强调正交变换在寻找不相关变量中的作用。同时,文章拓展讨论EVD和奇异值分解(SVD)的区别,指出SVD在处理非方阵时的优势,并在PCA中常用SVD来实现。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3491

3491

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?