deepseek今年很火热,既然开源了,那就来试试微调吧。

用一个医学数据集微调推理模型R1系列。

后面会涉及数据集的准备,模型加载,LoRA加载,微调训练和推理过程。

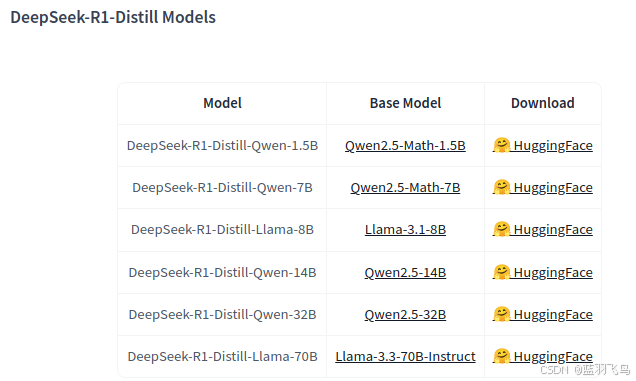

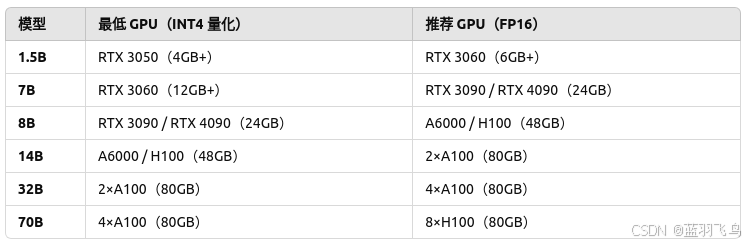

可以看到它有不同的尺寸,模型的硬件需求取决于它们的大小(参数量)以及加载方式(FP16、INT8、INT4等)。

GPU需求如下:

我们这里用3090微调一个7B的R1模型。

微调(Fine-Tuning)是对已经训练好的大模型进行特定任务的优化,以提高其在特定数据上的表现。

那么微调有哪些方法呢?

-

全参数微调(Full Fine-Tuning)

最标准的微调方式:对模型的 所有参数 进行训练

适用于:计算资源充足,任务与原始训练数据差异较大(如医学、法律)

缺点:

计算成本高(7B 需要 100GB+ GPU 内存)

训练数据量需要足够大(否则容易过拟合)

适用于少量任务,不能灵活切换任务 -

LoRA(Low-Rank Adaptation)

只在模型的 部分权重(如 QKV 矩阵) 上 添加可训练参数

通过 低秩矩阵(A×B) 来优化参数更新

优点:

极大降低显存消耗(7B 只需 10GB)

适用于多任务 LoRA 适配器切换

训练速度快 -

QLoRA(Quantized LoRA)

LoRA + INT4 量化,让 LoRA 微调时占用更少显存

允许 在 INT4 量化模型上训练 LoRA

比普通 LoRA 省 50% 显存

7B 只需 6GB 显存即可微调

另外还有Prefix Tuning(前缀微调),Adapter Tuning(适配器微调),BitFit(偏置微调),Adapter Fusion(适配器融合)。3090的话推荐LoRA或QLoRA。

Lora原理参考这里

数据集格式转换

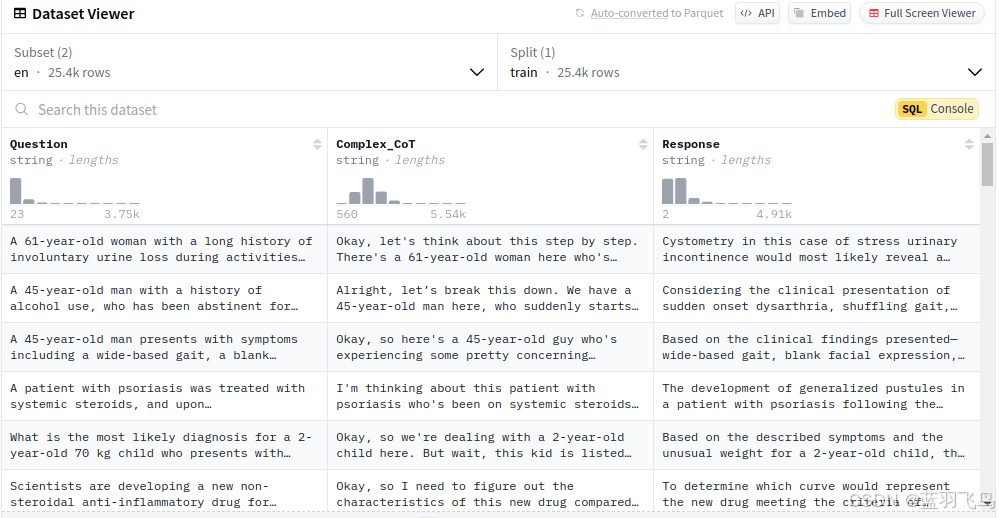

使用医学数据集:medical-o1-reasoning-SFT

它长这个样子,有英文和中文两个子集,我们这里用中文(zh)的。

这里可以看到数据集有3列,“Question”,“Complex_CoT”, “Response”,

其中Question是对话时的问题,CoT是思维链,是思考过程的描述,Response是最后的回答。

不过大模型需要的数据格式是这样的,需要把上面的数据转为下面这样的格式:

train_prompt_style = """

以下是一个任务说明,配有提供更多背景信息的输入。

请写出一个恰当的回答来完成该任务。

在回答之前,请仔细思考问题,并按步骤进行推理,确保回答逻辑清晰且准确。

### Instruction:

你是一位具有高级临床推理,诊断和治疗规划知识的医学专家。

请回答以下医学问题。

### Question:

{}

### Response:

<think>

{}

</think>

{}

"""

def formatting_prompts_func(examples):

inputs = examples["Question"]

cots = examples["Complex_CoT"]

outputs = examples["Response"]

texts = []

for input, cot, output in zip(inputs, cots, outputs):

text = train_prompt_style.format(input, cot, output) + EOS_TOKEN

texts.append(text)

return {

"text" : texts,

}

dataset = load_dataset("FreedomIntelligence/medical-o1-reasoning-SFT", "zh", split="train")

dataset = dataset.map(formatting_prompts_func, batched=True)

我们来说明一下这段代码做了什么,

如果把数据集的3列写成提示词的形式,是这样的

### Question:

什么是心房颤动?

### Complex CoT:

心房颤动是一种常见的心律失常,可导致血栓形成和中风风险增加。

### Response:

心房颤动(Atrial fibrillation,AF)是一种快速、无规律的心跳状态,通常需要抗凝治疗。

<eos>

那现在大模型不需要Complex CoT,而是用Response里的 < think > < /think >代替,所以把Complex CoT的内容移到think里面, think结束后直接接上Response的内容。把Question对应的内容放到#Question下面,这就是train_prompt_style.format(input, cot, output)做的事情。

这是训练过程,< think >里面和“ ### Response”后面是有数据的,推理时只给到开头的< think >, 后面的部分让模型预测输出。

注:不要以为模型回答就是往Response里面填答案,不是填答案的。模型的预训练是根据前文预测下一个token, 那么这里也是一样,根据前文(到Response为止)预测后面的token。

其他数据部分的细节问题:

在每行数据的结尾加上一个EOS,为什么一定要加EOS?

如果 不加 EOS_TOKEN,训练时可能会把多个样本拼接成一个 连续文本,导致模型在推理时无法区分不同对话:

模型可能无法区分 一个问题的结束和下一个问题的开始,导致 输出混乱。

### Question:

什么是心房颤动?

### Response:

心房颤动是一种快速无规律的心跳状态,通常需要

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1020

1020

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?