paper主要提出了在transformer中替代layer norm的方案,dynamic tanh函数,它是逐元素计算的,避免了layer norm在计算中需要计算channel整体的均值,方差,进行reduce和broad cast计算,天然并行,且硬件友好。

这篇论文专注于 Transformer 中的 LayerNorm 替代,不涉及 CNN 中使用的 BatchNorm 或其他归一化方法。DyT 的设计完全围绕“token 向量级别的标准化”,所以在 CNN 上并不适用。

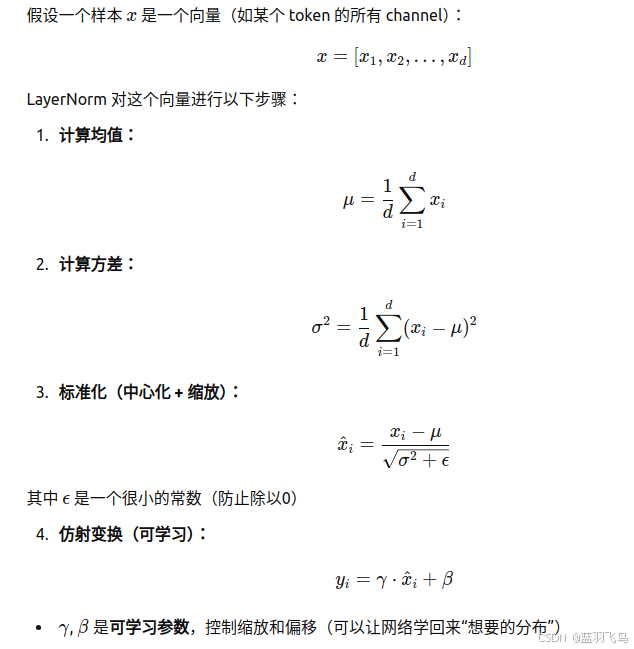

先复习一下什么是layer norm.

Transformer 中输入通常是:[B, T, C]

B: batch size (样本数)

T: token个数(LLM中是词数,图像中是patch数)

C: channel, 在token中指的是向量维度,也就是embedding dim.

layer norm是对每个 token 的向量 [C] 做归一化,即对最后一个维度做均值/方差计算。

输入形状: [B, T, C]

LayerNorm 就是对每个 [x_t1, x_t2, ..., x_tC] 做归一化

↑

每个 token 的 channel 向量

layer norm原理:

下面进入DyT的介绍,也就是paper部分,然后讨论为什么DyT比layer norm更快。

Abstract

归一化层在现代神经网络中无处不在,长期以来被认为是不可或缺的。

本研究表明,即使不使用归一化层,Transformer 也能通过一种非常简单的技术达到相同甚至更好的性能。

我们提出了一种逐元素操作,称为 Dynamic Tanh(DyT),其形式为:

DyT(x)=tanh(αx)

它可直接替代 Transformer 中的归一化层。

DyT 的灵感来自这样一个观察:在 Transformer 中,LayerNorm 的输入输出关系常常呈现类似 tanh 的 S 形曲线。通过使用 DyT,不含归一化层的 Transformer 模型在各种任务和设置下都能达到甚至超越原有性能,且几乎无需调参。

Introduction

在过去十年中,归一化层已经成为现代神经网络中最基础的组成部分之一。这一切始于 2015 年提出的 Batch Normalization(BN),它显著加快并稳定了视觉识别模型的收敛,并迅速被各类模型采纳。此后,针对不同架构和领域,研究者又提出了许多归一化层的变体,比如:

LayerNorm(LN)

InstanceNorm

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

581

581

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?