这是我们新一篇关于大模型的文章,我们此前还讲过如何运行 LLama3 大模型。而这次,我们将使用 Ollama 运行阿里千问Qwen2:7b。要知道 Qwen2 可是目前最热门的开源大语言模型了,甚至在一些性能测试中比 LLama3 表现还突出。谁不想试试看呢?

在本文中,我们将使用目前市场上最热门的 GPU 之一,NVIDIA A5000。让 Qwen2 在这个 GPU 上运行起来!

基于Ampere架构构建的 A5000 ,是一款强大的 GPU,其性能被公认为能胜任 增强图形渲染、大模型训练和推理等工作。A5000 有 8192 个 CUDA 核心和 24GB 的 GDDR6 内存,并具备很强的计算能力和较高的内存带宽。

A5000 支持实时光线追踪、AI 增强型工作流程以及 NVIDIA 的 CUDA 和 Tensor 核心等高级功能,可提高性能。凭借其强大的功能,A5000 非常适合处理复杂的模拟、大规模数据分析和渲染高分辨率图形。

简单介绍下阿里 Qwen2-7b

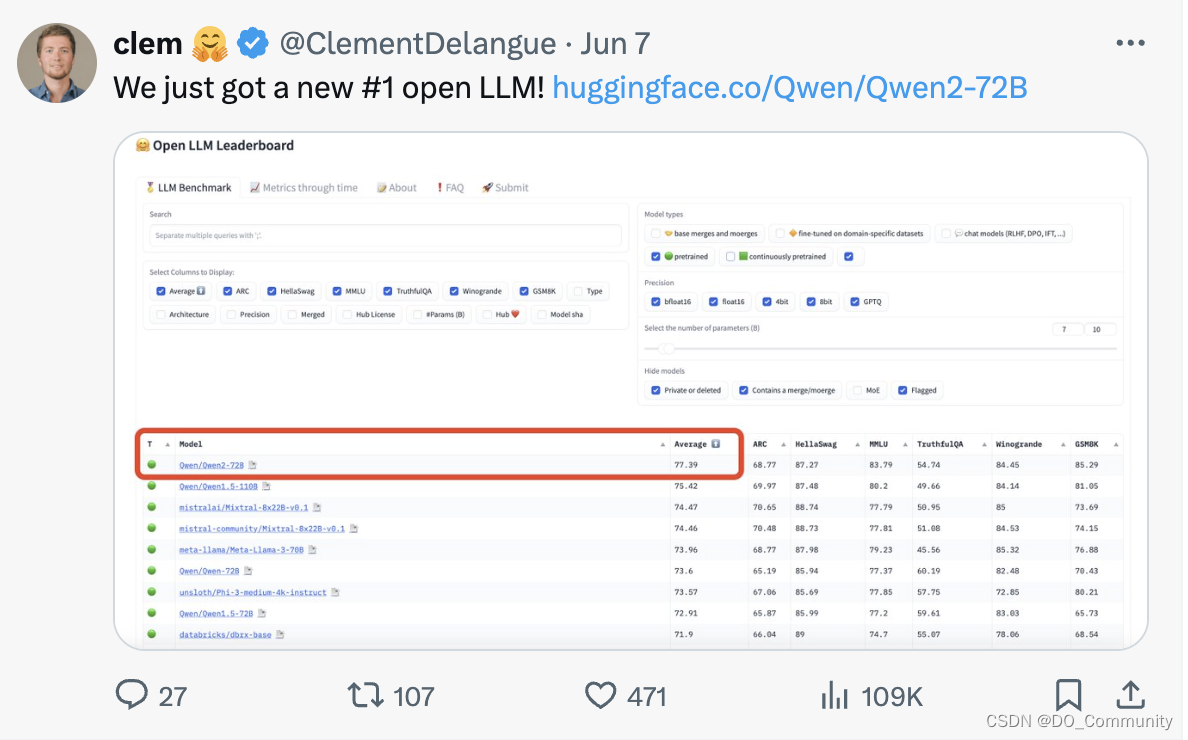

Qwen2 是阿里云最新推出的大语言模型系列,提供基础模型和指令调优版本,参数范围从 5 亿到 720 亿,其中包括一个 Mixture-of-Experts 模型。该模型已经在 Hugging Face 上开源了。而且开源后 Hugging Face 的联合创始人兼首席执行官就发文宣布,Qwen2-72B 冲上HuggingFace 开源大模型榜单 Open LLM Leaderboard 第一名,全球排名最高!

与其他开源模型如 Qwen1.5 相比,Qwen2在各

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

333

333

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?