导读

这是一篇探讨如何让自动驾驶系统更像人类驾驶员的研究论文。作者从一个核心观点出发:现有的基于优化的自动驾驶系统在处理长尾场景时存在根本性的局限。为了解决这个问题,作者提出自动驾驶系统应该像人类一样,通过持续驾驶来积累经验,并运用常识来解决问题。论文确定了实现这一目标所需的三个关键能力:推理、解释和记忆。作者通过在HighwayEnv环境中构建闭环系统,展示了大语言模型在驾驶场景中的应用可行性。实验结果表明,大语言模型展现出令人印象深刻的推理能力和解决长尾案例的潜力。

©️【深蓝AI】编译

论⽂题目:Drive Like a Human: Rethinking Autonomous Driving with Large Language Models

论文作者:Daocheng Fu, Xin Li, Licheng Wen, Min Dou, Pinlong Cai, Botian Shi

论文地址:https://ieeexplore.ieee.org/abstract/document/10495699

文章背景

假设你在停车线前等红灯,这时一辆装载着交通锥的皮卡车从前方路口驶过。作为人类驾驶员,你可以运用常识推理出这些交通锥只是皮卡车上的货物,道路并未在施工。然而,这种对人类驾驶员来说轻而易举的判断,对很多现有的自动驾驶(AD)系统来说却是棘手的长尾场景。虽然自动驾驶开发人员可以通过制定特定规则或收集更多关于车载交通锥(而非地面交通锥)的数据来避免突然制动,但当系统遇到相反情况 - 真正标记禁区的地面交通锥时,这种处理方式又会失效。这就像解决一个问题的同时又会带来新的问题,在现实世界中存在着无数甚至超出我们想象的罕见场景。正是基于这种认识,作者认为传统的基于优化和模块化的自动驾驶系统面临着根本性的性能瓶颈。

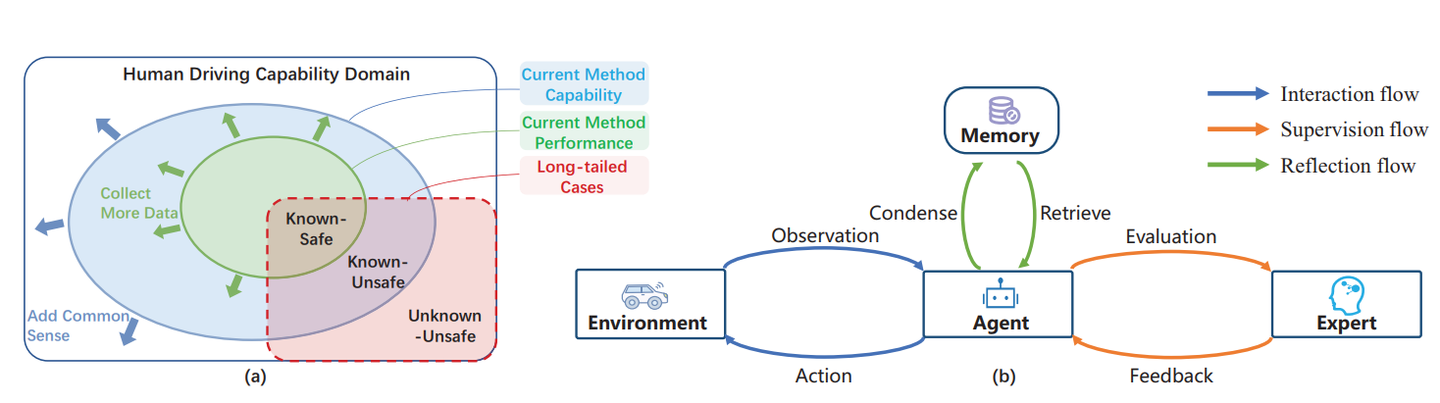

作者重新思考了自动驾驶的发展路径,并通过图1清晰地展示了为什么基于优化的传统自动驾驶系统在面对开放世界的挑战时会遇到困难。虽然基于优化理论构建的系统可以方便地将复杂的自动驾驶任务分解为一系列子任务,但在面对复杂场景时,优化损失函数的过程往往会陷入局部优化,这限制了系统的泛化能力。引入更多的数据(图中绿色箭头)只能减小当前模型(绿色椭圆)与基于优化方法的最大容量(蓝色椭圆)之间的性能差距。这主要是因为优化过程倾向于学习数据中的主导模式,而往往忽视了不频繁出现的长尾问题。如果没有融入常识(蓝色箭头),模型的能力(蓝色椭圆)就无法得到实质性的提升。此外,在持续的数据收集过程中总是会出现新的未知长尾场景。

▲图1| 人类驾驶和自动驾驶的关系©️【深蓝AI】编译

相比之下,人类总是能够通过经验和常识轻松解决这些长尾问题。这启发作者提出一个关键问题:我们是否可能构建这样一个系统,让它能像人类一样通过持续驾驶积累经验,而不是仅仅拟合有限的训练数据集?

根据近期研究,作者认为之前的模块化自动驾驶系统可以被视为互联网AI,它们仅在特定任务语料库上训练,缺乏推理、解释和自我反思等高级智能。作者指出,如果想要获得一个能够像有经验的人类驾驶员那样驾驶汽车的智能体,就有必要借鉴具身人工智能(Embodied AI)研究的思路。人类通过与真实环境的交互学习驾驶,并通过专家反馈来完善路感,这个过程涉及对各种场景和相应操作的解释、推理和记忆凝练。此外,由于具备逻辑推理能力,人类驾驶员可以运用常识总结规则并将其应用到更普遍的场景中(归纳推理)。同时,之前的经验可以在面对不可预测场景时被下意识地唤醒(演绎推理)。

相关工作

自动驾驶系统主要包含两种范式:模块化方法和端到端方法。模块化方法涉及一系列相互连接的组件,用于处理不同的子任务,如感知、规划和控制。这种架构提供了模块化和多功能性的优势。然而,调整流水线和管理错误传播可能会带来挑战。相比之下,端到端自主性直接将传感器输入映射到规划器或控制器命令。这些方法通常更容易开发,但缺乏可解释性,这使得诊断错误、确保安全性和整合交通规则变得困难。不过,最近在端到端可学习流水线自主性方面的进展通过结合两种范式的优势显示出了令人期待的成果。尽管这两种范式都取得了显著进展,但在处理现实环境中的长尾数据或分布外场景时,它们往往表现得比较脆弱,这对安全关键的自动驾驶提出了挑战。

大语言模型的成功令人振奋,因为它展示了机器学习人类知识的程度。近期在大语言模型方面的研究在零样本提示和复杂推理、具身代理研究以及解决关键交通问题方面都展现出了令人印象深刻的表现。具体来说:PaLM-E采用微调技术来适应预训练的大语言模型以支持多模态提示;Reflexion通过链式思维提示来生成推理轨迹和特定任务的行动,同时整合自我反思来进一步增强代理的推理能力;VOYAGER提出了基于大语言模型的终身学习,包含提示机制、技能库和自我验证三个模块,旨在增强代理的复杂行为发展;Generative Agents使用大语言模型来存储代理完整的经验记录。随着时间推移,这些记忆被综合为更高层次的反思,并被动态检索以规划行为;Instruct2Act引入了一个框架,利用大语言模型将多模态指令映射到机器人操作任务的顺序动作中。

作者提出了一个直观的想法:大语言模型是否也可以应用于自动驾驶的开发,这为提高自动驾驶车辆处理复杂条件的能力提供了潜力。在本文中,作者尝试将大语言模型整合到自动驾驶系统中,通过大语言模型的优势(如适应性、可解释性、零样本学习和常识推理),使自动驾驶车辆能够以类人的方式理解驾驶环境。作者指出,据他们所知,还没有人尝试使用大语言模型来构建像人类一样的驾驶代理,他们是首个展示大语言模型在驾驶场景中应用可行性的研究。

驾驶场景中的闭环交互能力

解释能力使大语言模型能够理解其驾驶环境,这构成了其与环境交互的基础,并支撑其推理和记忆能力。作者使用GPT-3.5在HighwayEnv环境中进行了闭环驾驶实验,以验证大语言模型的解释和环境交互能力。由于GPT-3.5是一个纯文本大语言模型,无法直接与HighwayEnv交互,因此作者提供了感知工具和代理提示来辅助其观察和决策。

如图2所示,代理提示为GPT-3.5提供了关于当前动作、驾驶规则和注意事项的信息。GPT-3.5采用ReAct策略,通过思考-行动-观察的循环来感知和分析周围环境。基于这些信息,GPT-3.5做出决策并控制车辆在HighwayEnv中行驶,形成了一个闭环驾驶系统。

▲图2| GPT3.5的闭环驾驶能力©️【深蓝AI】编译

像人类一样,GPT-3.5在驾驶时会评估其行动的潜在后果,并权衡结果以做出最明智的决定。与广泛使用的强化学习(RL)和基于搜索的方法相比,GPT-3.5不仅能解释场景和行动,还能利用常识来优化其决策过程。

与基于强化学习的方法相比,GPT-3.5在没有任何微调的情况下就在HighwayEnv中实现了超过60%的零样本通过率。相比之下,基于强化学习的方法需要大量迭代才能达到有竞争力的性能。如图3所示,由于碰撞会受到严重惩罚,基于强化学习的代理学会了一种策略:在开始时减速以与其他车辆拉开距离,为后续加速创造空间。这表明基于强化学习的方法经常产生这种意想不到的解决方案。

▲图3| 基于强化学习和基于搜索的自动驾驶方法对比©️【深蓝AI】编译

论文通过图4展示了第一个具体案例。场景中绿色的自我车辆(ego car)在最右车道(lane_3)行驶,前方是veh4,左侧车道(lane_2)上的veh1速度快于veh4。GPT-3.5首先确定可执行的动作,包括加速、减速、保持当前速度和向左变道。通过感知工具的反馈,系统发现加速可能与前车veh4发生碰撞,而保持速度是安全的。在检查向左变道动作时,系统首先确定了lane_2上受影响的车辆,并验证了向左变道对veh1是安全的。最终,GPT-3.5选择向左变道,并给出了合理的解释:虽然保持当前状态和变道都是安全的,但变道到lane_2能提供更大的机动灵活性,考虑到veh1的较快速度,这个决策更有利于整体表现。

▲图4| GPT3.5的变道行为©️【深蓝AI】编译

闭环驾驶不仅需要在每个时间步做出安全决策,还需要保持决策的一致性,避免频繁加减速和无意义的变道。图5展示了第二个案例,说明GPT-3.5如何保持决策一致性。在这个场景中,绿色的自我车辆在最右车道,与前车veh2保持相对较远的距离。在之前的决策中,GPT-3.5判断与前车距离过远,决定加速跟随。在新的决策周期中,系统仍然通过Get_available_action工具获取当前可用的四个动作。系统发现veh2仍在前方行驶,且保持当前速度和加速都是安全的。最终,GPT-3.5选择继续加速,其解释是"选择与之前决策一致的动作"。这使自我车辆缩短了与前车的距离,更有利于整体交通流。作者指出,由于参考了先前的决策结果,GPT-3.5调用的工具数量和推理成本显著降低。

▲图5| 加速过程中的决策一致性©️【深蓝AI】编译

驾驶场景中的常识推理能力

论文第四部分探讨了大语言模型在驾驶场景中的常识推理能力。作者指出,虽然人类驾驶员和传统的基于优化的自动驾驶系统都具备基本的驾驶技能,但他们之间的根本区别在于人类对世界具有常识性理解。常识是我们对周围事物的合理和实用判断,这些判断来源于日常生活的积累。所有与驾驶相关的常识都可以源自日常生活的各个方面。当面对新的驾驶情境时,人类驾驶员能够基于常识快速评估场景并做出合理决策。相比之下,传统的自动驾驶系统虽然在驾驶领域有经验,但它们缺乏常识,因此无法处理这类情况。

像GPT-3.5这样的大语言模型在大量自然语言数据上进行训练,对常识有深入的理解。这标志着与传统自动驾驶方法的重大突破,使大语言模型能够像人类驾驶员一样,运用常识推理来处理复杂的驾驶场景。在这一部分,作者评估了两个典型的自动驾驶系统长尾案例,其中涉及文章开头描述的载有交通锥的皮卡车场景。

作者通过图6展示了两个相似但不同的场景。第一张图片展示了一辆皮卡车,其货箱中装载着若干交通锥,正在前往目的地的路上。第二张图片也展示了一辆装有交通锥的皮卡车,但周围地面上也散落着交通锥。由于GPT-3.5不具备处理多模态输入的能力,作者使用LLaMA-Adapter v2作为图像处理前端。他们要求LLaMA-Adapter尽可能详细地描述照片,然后将这个描述作为观察输入,让GPT-3.5评估场景的潜在危险性,并为假设跟随在卡车后面的自我车辆做出决策。

▲图6| 两个相似的长尾场景©️【深蓝AI】编译

在第一个场景中,LLaMA-Adapter识别出皮卡车正在运输多个交通锥,并推断它们正在被运往目的地。基于这些观察,GPT-3.5成功分析了驾驶场景。它并未被交通锥的存在误导,而是基于"卡车运输货物去往目的地是常见现象"这一常识,判断这种情况并不危险。GPT-3.5建议自我车辆驾驶员无需减速,并提醒不必要的减速可能反而会危及交通流的安全。

在第二个场景中,除了卡车货箱内的交通锥外,地面上也散落着交通锥,这一细节被LLaMA-Adapter准确捕捉。尽管与第一个场景的差异很小,但GPT-3.5的响应却完全不同。它认为这种情况可能存在潜在危险,因为卡车周围散落的交通锥可能构成危险。因此,它建议自我车辆的驾驶员减速并与卡车保持安全距离,以避免与这些交通锥发生碰撞。

这些例子生动地展示了大语言模型在驾驶场景中强大的零样本理解和推理能力。常识知识的运用不仅使大语言模型能够更好地理解场景中的语义信息,还能够帮助它们做出更符合人类驾驶行为的理性决策。因此,拥有常识知识提高了自动驾驶系统的能力上限,使其能够处理未知的长尾案例,真正接近人类驾驶员的驾驶能力。

通过记忆能力来提升自动驾驶系统性能

论文第五部分探讨了通过记忆能力来提升自动驾驶系统性能的方法。作者首先指出,持续学习是人类驾驶的另一个关键方面。由于经验有限,新手驾驶员在遇到复杂交通状况时通常会谨慎驾驶。随着时间推移,驾驶员会遇到新的交通场景,掌握新的驾驶技能,并巩固先前的经验,最终成为经验丰富的驾驶员。

作者分析指出,基于优化的方法试图通过不断获取更多失败案例并用它们来重新训练神经网络来模仿持续学习的过程。然而,这种方法不仅繁琐且昂贵,而且从根本上无法实现真正的持续学习。常规驾驶和长尾corner cases之间的分布差异给平衡两者带来了重大挑战,最终导致灾难性遗忘。因此,需要一种更有效的方法来实现自动驾驶系统中的真正持续学习。

如图1(b)所示,作者提出的基于大语言模型的方法通过使用独立的记忆模块来紧密跟随人类学习过程。记忆模块只记录那些"偏离专家意见"的决策场景。这里的专家可以是开发人员对大语言模型决策的评估,也可以是现实世界中人类驾驶员决策的真实数据。一旦获得专家反馈,大语言模型就会进行自我反思,以确定其决策为什么偏离专家的决策。然后,它会将交通状况总结为一个决策场景,并将其与正确的决策一起作为新的记忆条目添加到记忆池中。当下次遇到类似情况时,大语言模型可以快速检索这个记忆条目作为参考,做出明智的决策。

作者在图7中给出了一个记忆过程的具体示例。场景涉及一辆蓝色自我车辆和一辆黄色车辆在一条略宽于两车宽度的狭窄车道上相向行驶。将场景转换为结构化文本输入GPT-3.5后,模型很好地理解了场景,包括车辆的状态、方向和目的地。然而,当要求它对场景做出决策时,GPT-3.5给出了一个安全但过于谨慎的建议:自我车辆应该停下来等待对向车辆通过。

▲图7| LLM的自我反思和记忆能力示例©️【深蓝AI】编译

为了改进大语言模型的表现,专家提供了关于人类驾驶员如何处理这种情况的实际建议:保持车辆行进并稍微向左偏移。通过这个过程,大语言模型认识到两车之间有足够的空间可以通过,而减速可能会扰乱交通流。它将这种情况总结为"两辆车在同一车道相向而行"的场景,并将记忆与正确的决策一起记录下来。

利用这些记忆,作者输入另一个关于两辆车在不同速度和位置的狭窄巷道相遇的场景,要求大语言模型做出决策。大语言模型成功认识到这只是"两辆车在同一车道相向而行"决策场景的另一个变体,建议自我车辆继续前进而不是减速等待。

记忆能力通过持续收集驾驶案例来积累经验,并通过检索现有记忆来辅助决策,赋予了大语言模型在自动驾驶中持续学习的能力。此外,这显著降低了大语言模型在类似场景中的决策成本,提高了其实际表现。这种方法不仅解决了传统方法中的灾难性遗忘问题,还提供了一种更自然、更高效的学习机制。

总结

在结论中,作者首先重申了论文的核心思想:构建一个能够像人类一样驾驶的系统。作者认识到,之前基于优化的自动驾驶系统在处理长尾corner cases时存在局限性,这主要是由于全局优化过程中的灾难性遗忘导致的。因此,作者总结了自动驾驶系统应该具备的三个必要能力:推理、解释和记忆。

作者进一步说明,他们设计了一个新的范式,这个范式模仿人类学习驾驶的过程。在人工通用智能的愿景指引下,研究团队尝试使用GPT-3.5作为测试平台,并展示了其在理解交通场景方面的出色能力。

作者强调,作为一项初步工作,他们仅仅触及了大语言模型在闭环驾驶中的潜力表面,主要目的是突出采用这项技术的优势和机遇,而不是将大语言模型直接用作驾驶代理。研究团队的愿望是这项研究能够成为催化剂,推动学术界和产业界共同创新,构建一个基于人工通用智能的自动驾驶系统,使其能够真正像人类一样驾驶。

233

233

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?