前言

Windows下的Dify安装完毕后,就可以进行和DeepSeek的挂接配置了。关于Windows下Dify 的安装,可以参考我另外的两篇博客:

Windows下docker的安装:https://quickrubber.blog.youkuaiyun.com/article/details/146170500

Windows下Dify的安装:https://blog.youkuaiyun.com/quickrubber/article/details/147277381

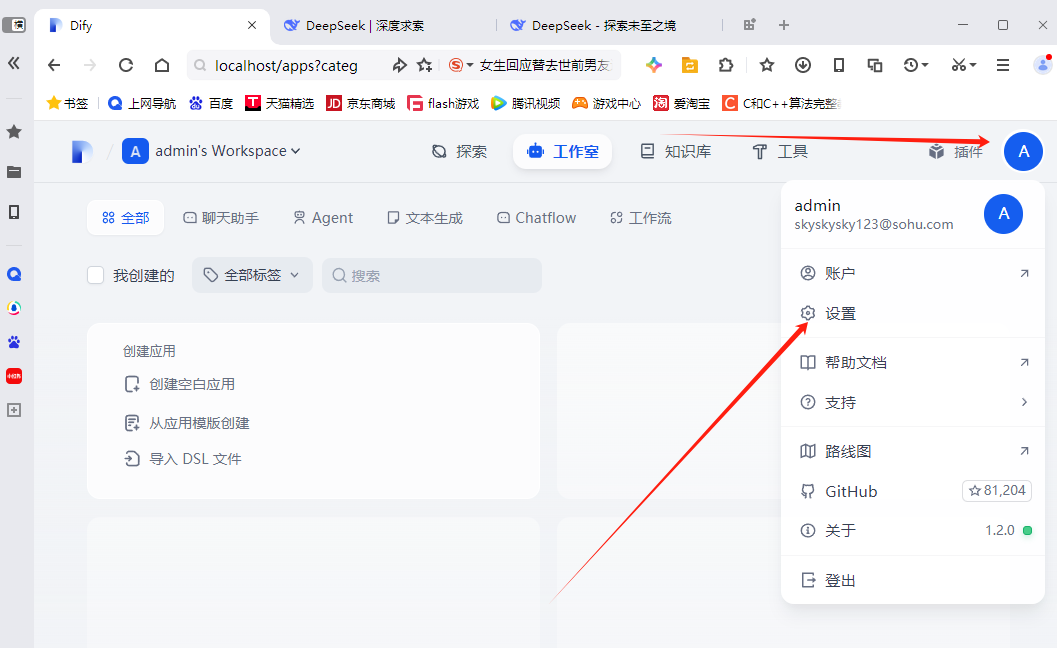

一、进入设置页面

进入设置页面后,点击“模型供应商”,如下图:

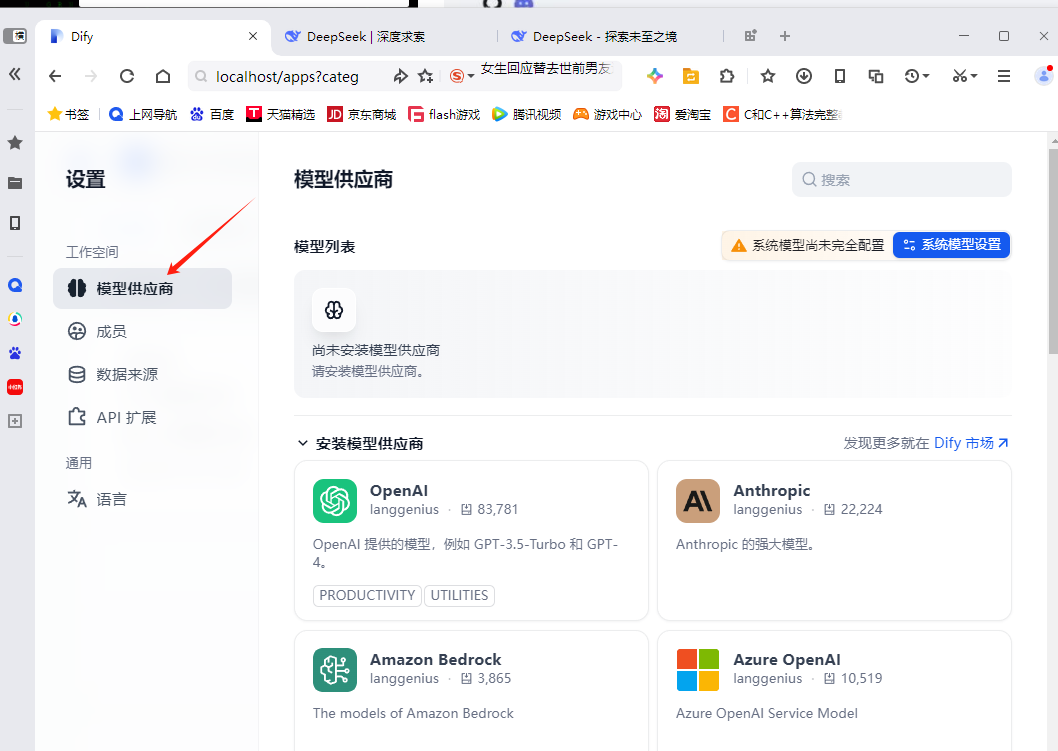

选择Ollama羊驼,进行安装测试,如下图:

然后,提示会安装如下的插件:

点击完成Ollama插件的安装。

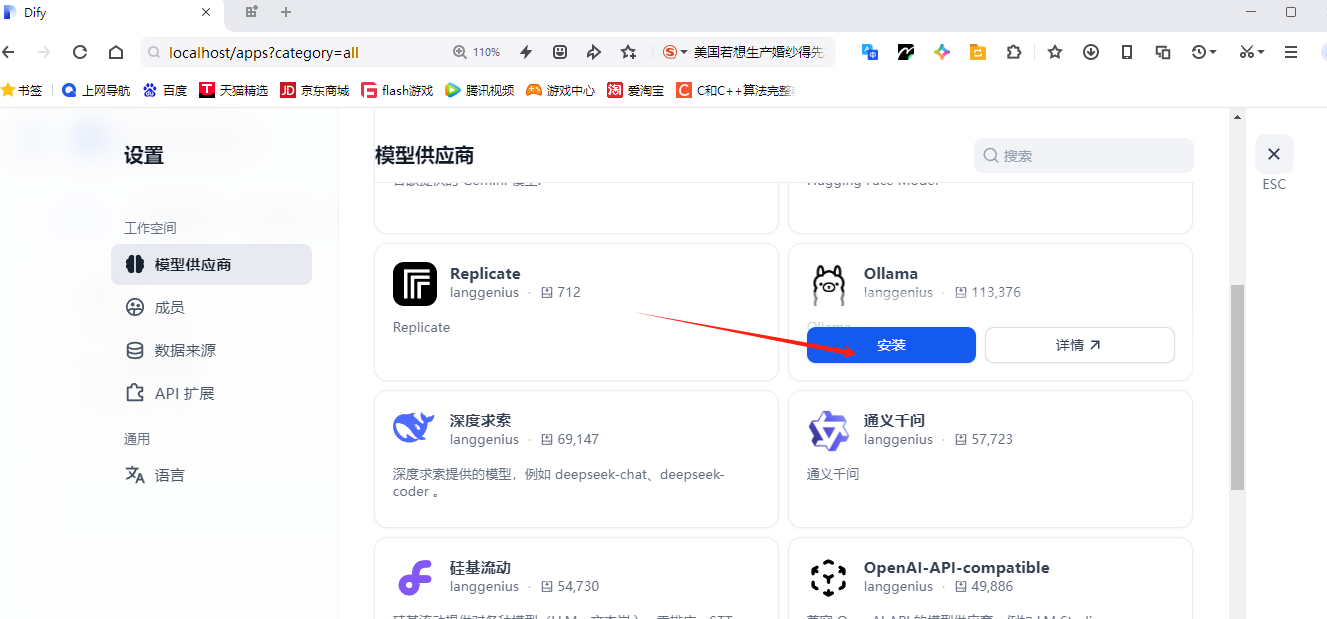

退出当前页面,新开浏览页,重新进入Dify,可以发现,这个插件已经可以用了,但是还需要进一步的配置,如下图:

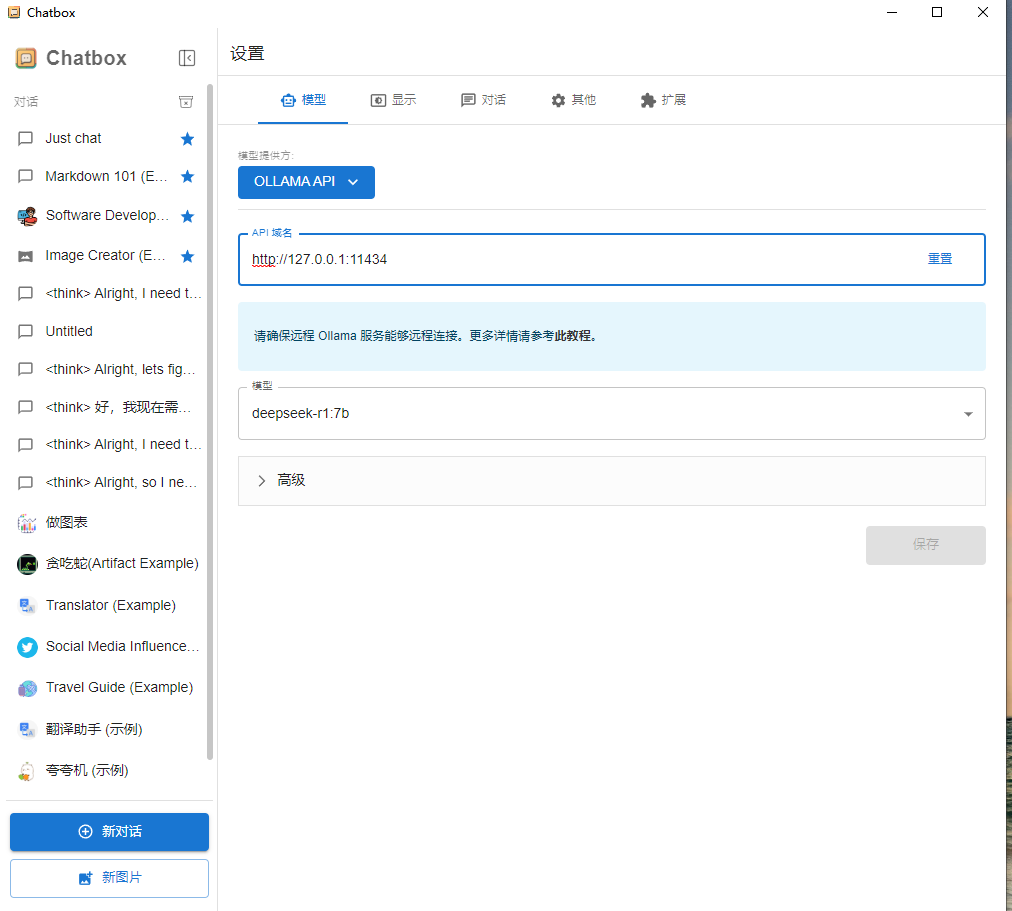

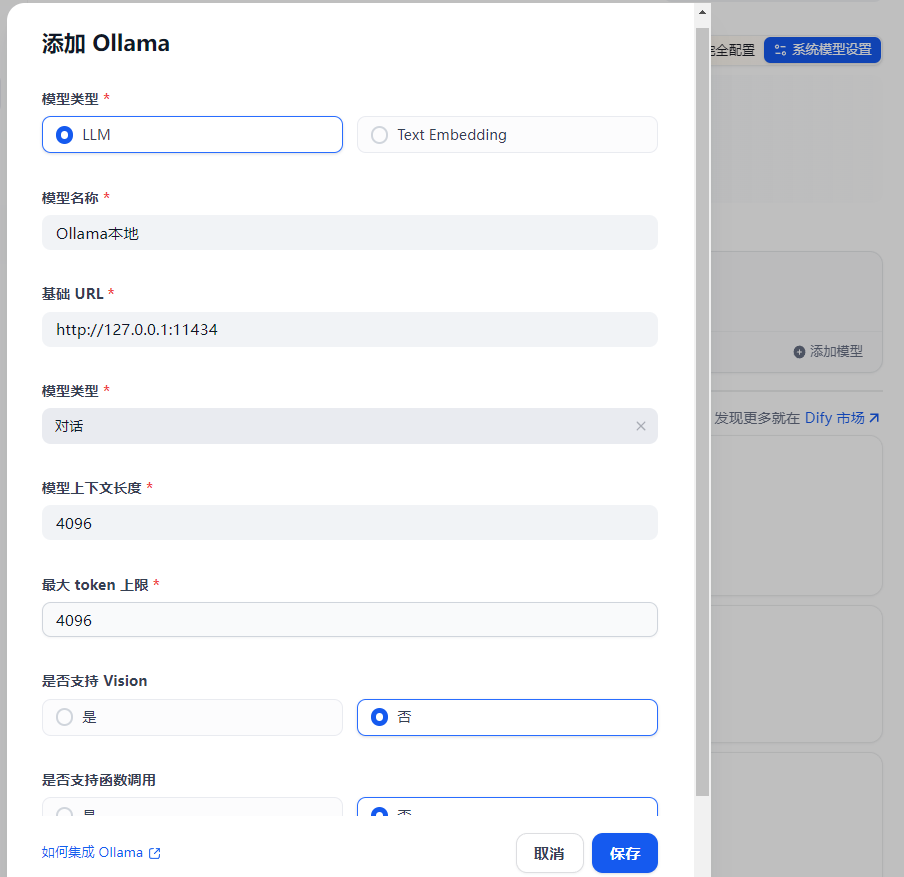

因为,我想使用本地配置的Ollama,所以我参考了我前面配置的ChatBox中的配置,如下图:

(关于ChatBox+Ollama+本地DeepSeek,可以参看我的另外一篇博客,DeepSeek的本地配置:https://quickrubber.blog.youkuaiyun.com/article/details/145868569)

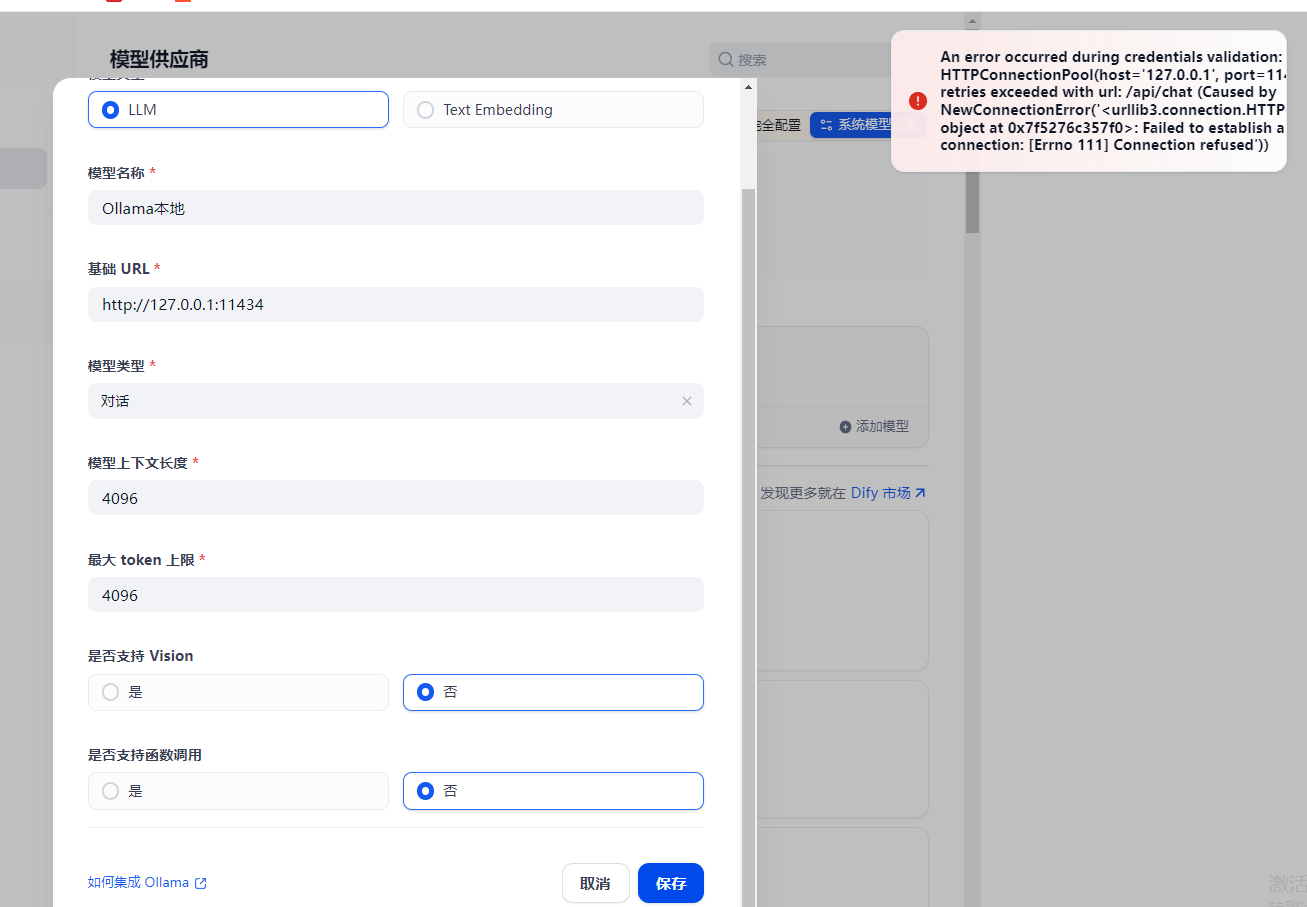

但是,这样保存后会出错,如下图:

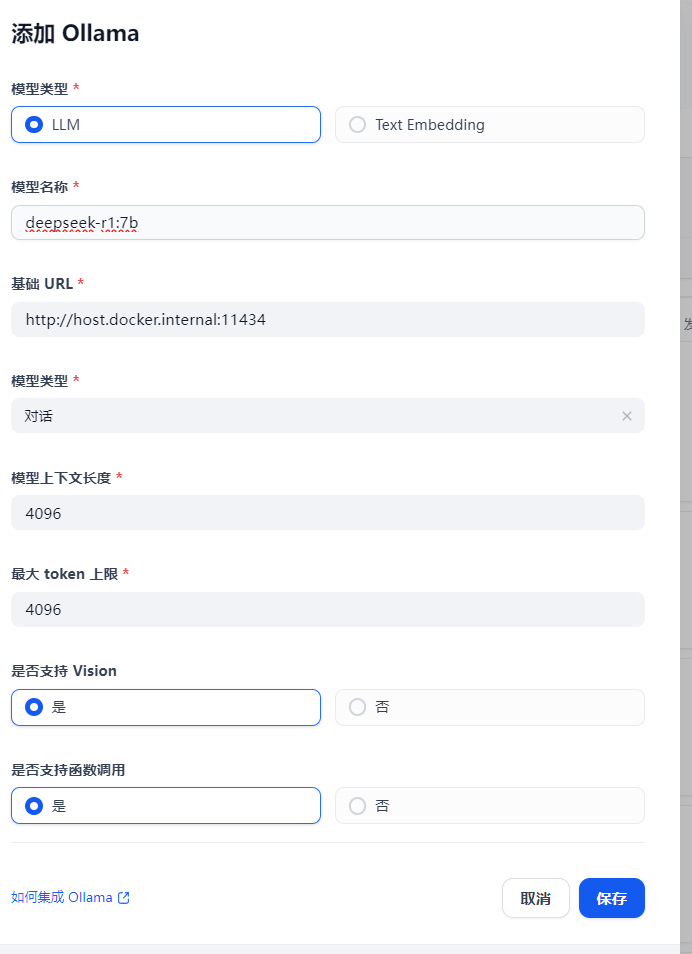

要这样配置就可以保存了(关键是要对基础URL进行修改),如下图:

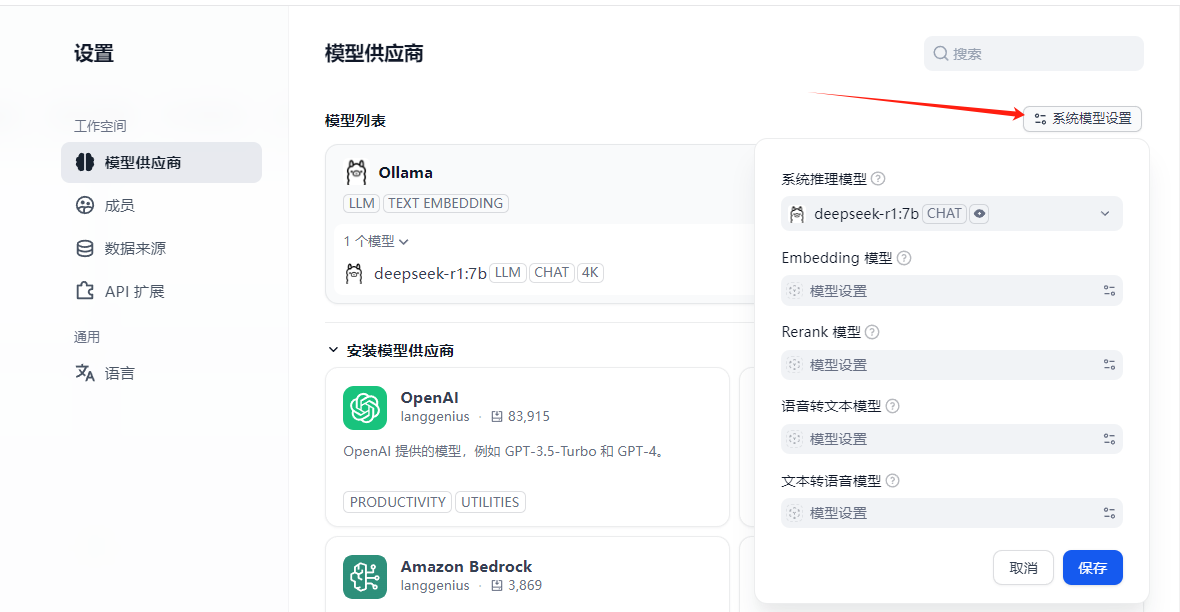

保存成功后,一个本地的deepseek模型就挂接成功了,如下图:

(值得注意的是,本地创建的deepseek模型,模型上下文长度和token的上限都是可以自己定义的,可以突破在线deepseek模型的默认上下文和token长度限制)

然后,对系统模型进行设置,如下图:

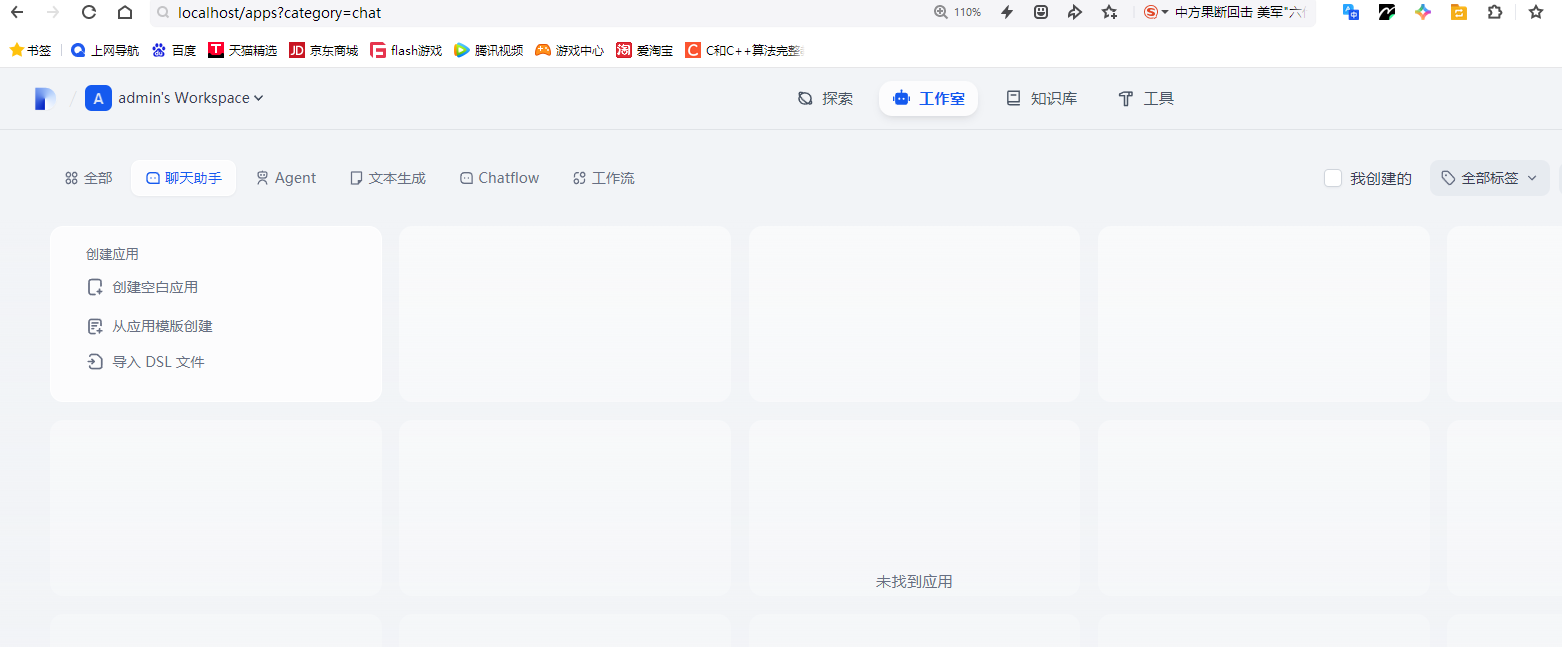

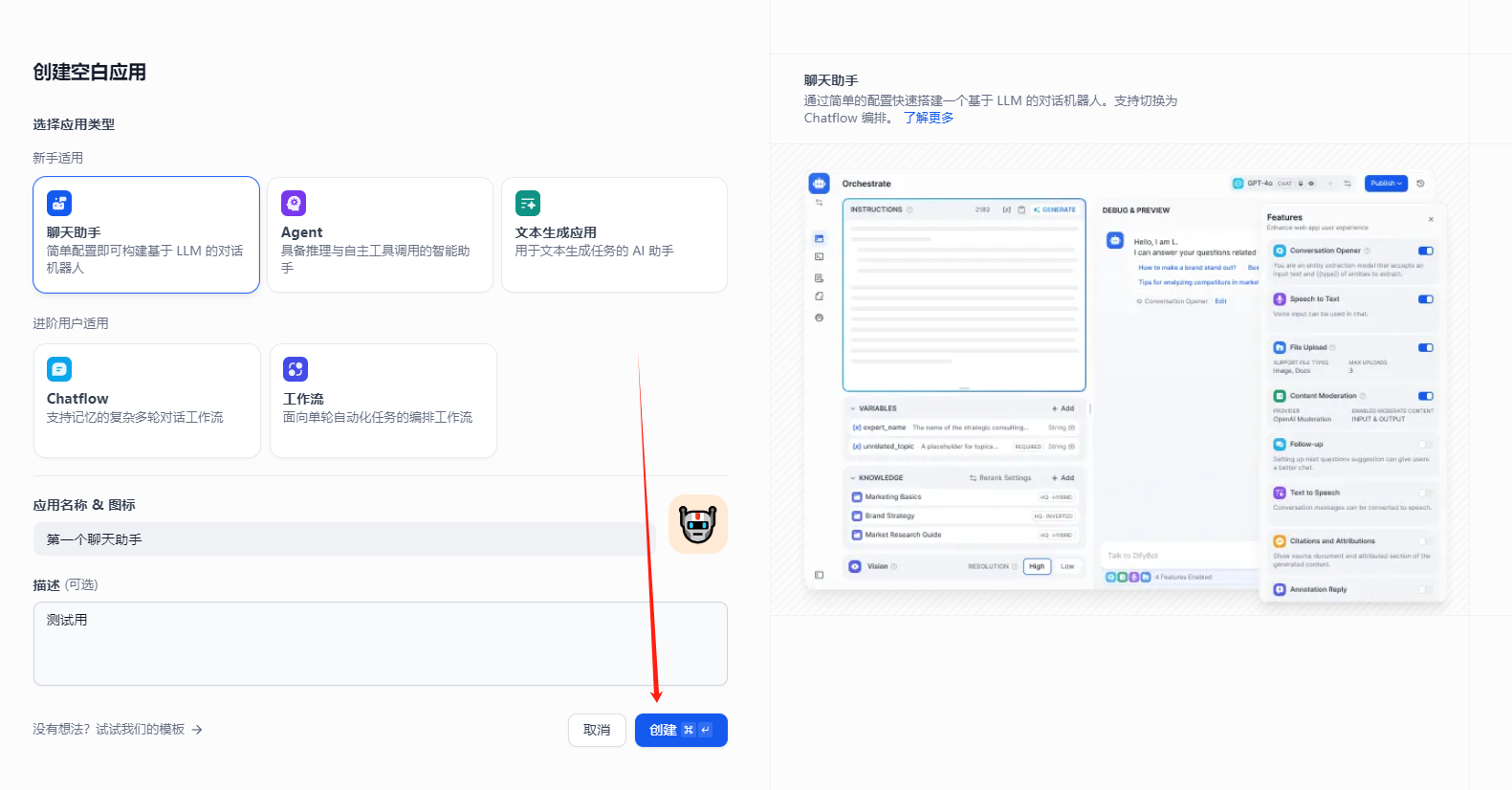

二、开始创建应用

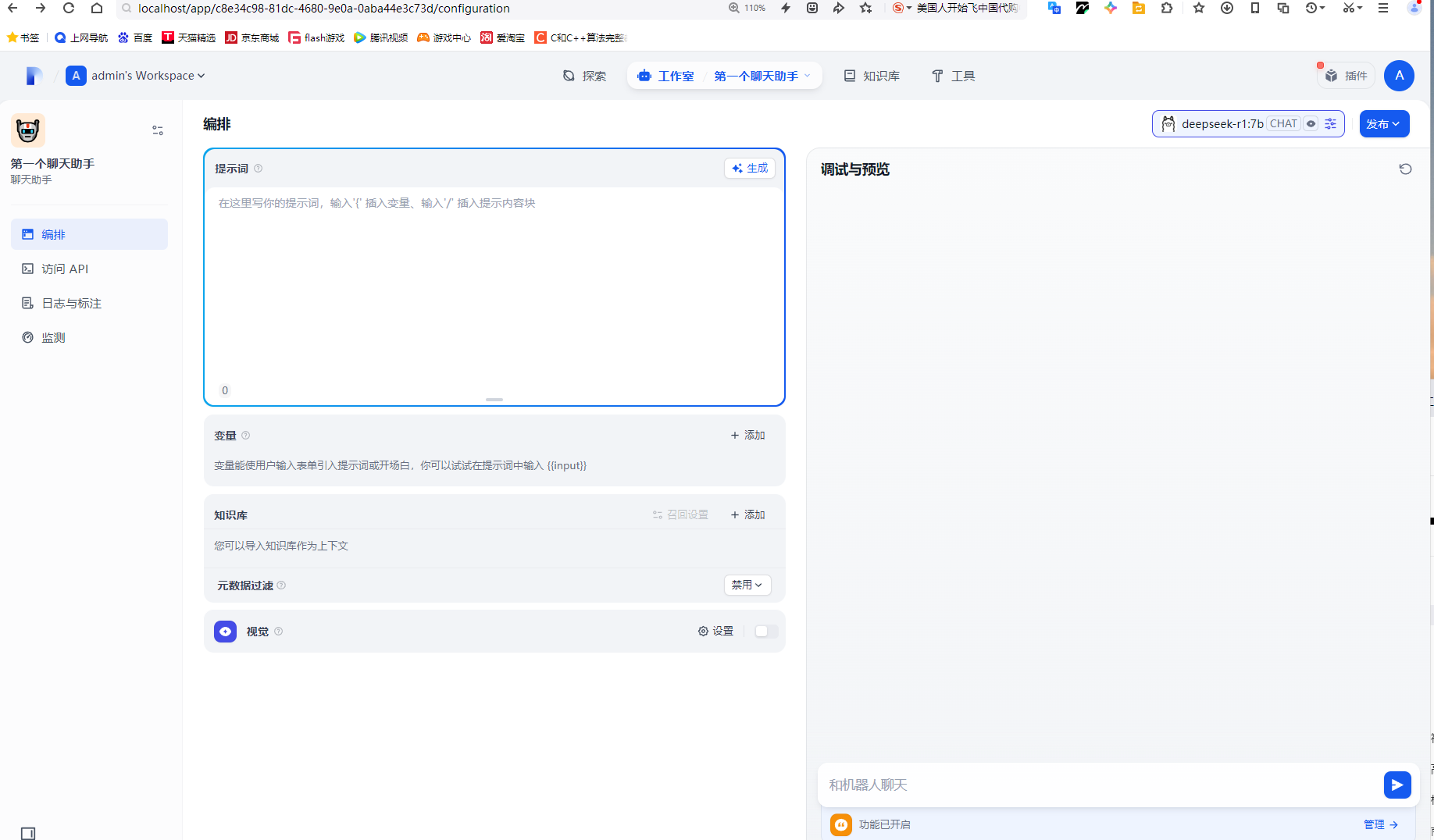

这样,一个基础的聊天助手,就创建好了,如下图:

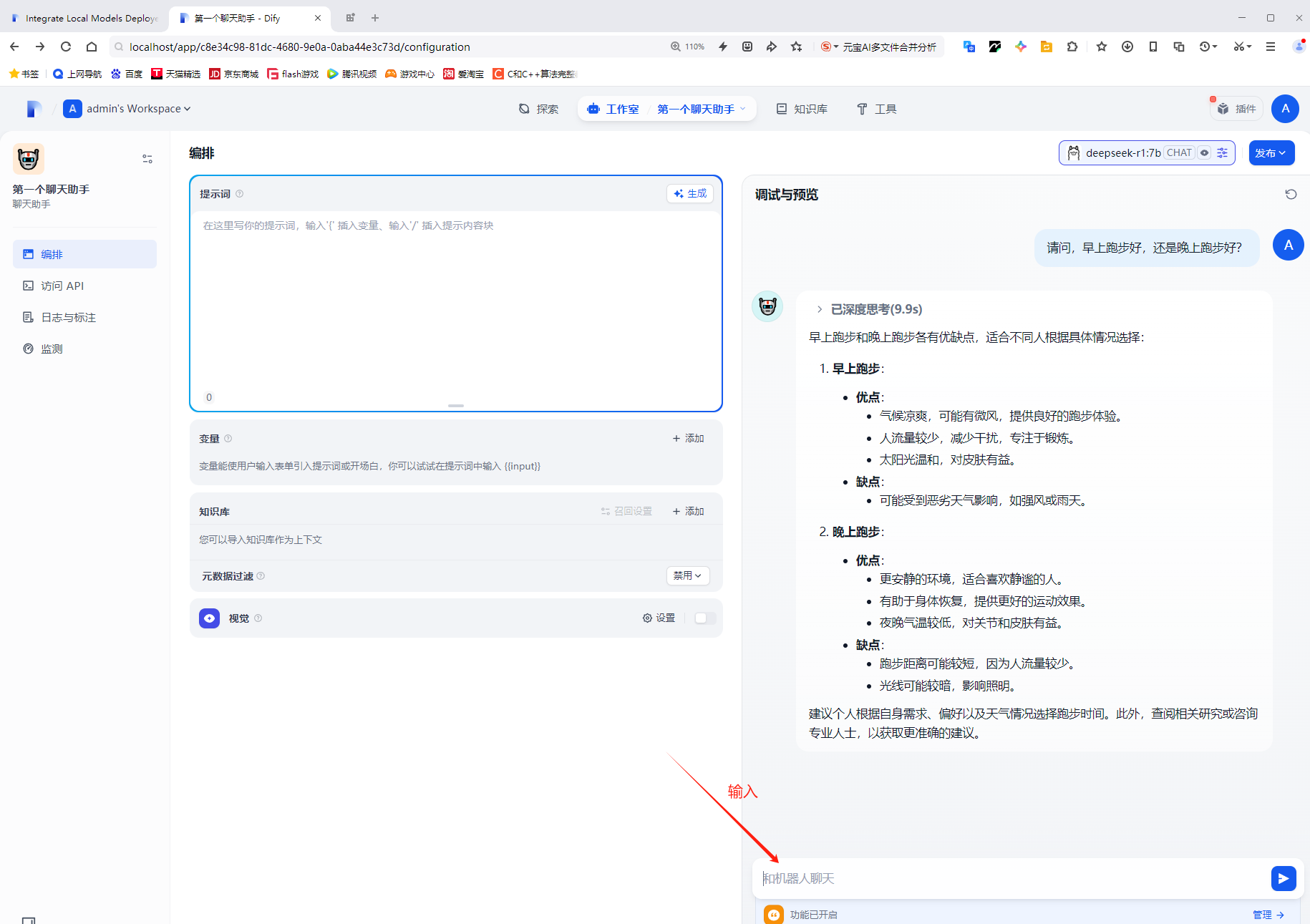

提问的效果,如下图:

可见可以用聊天助手进行提问和回答了。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?