卷积神经网络详解

在人工智能的浪潮中,卷积神经网络(Convolutional Neural Network, CNN)以其独特的结构和强大的图像处理能力,成为了计算机视觉领域的核心算法之一。本文将详细讲解卷积神经网络的基本概念、卷积操作以及其在图像处理中的应用。

首先推荐吴恩达课程:【吴恩达深度学习(2021版)- CNN卷积神经网络】 https://www.bilibili.com/video/BV1Rf4y1b7NP/?share_source=copy_web&vd_source=ff02203aa6bb704a88036ba6dbf11dd2

一、课程导入:为什么需要卷积神经网络?

在处理图像分类等任务时,我们可能会遇到海量的输入数据。例如,一张1000x1000像素的图像,如果有1000个类别,使用全连接神经网络(Fully Connected Neural Network, FCNN)进行分类,所需的参数数量将是一个天文数字——1000x1000x1000,即十亿个参数。这不仅会导致计算量巨大,还容易引发过拟合问题。

相比之下,卷积神经网络通过局部连接、权重共享和池化等操作,显著减少了参数数量,提高了模型的泛化能力。因此,在处理图像数据时,卷积神经网络成为了更为高效和可行的选择。

二、卷积操作的基础概念

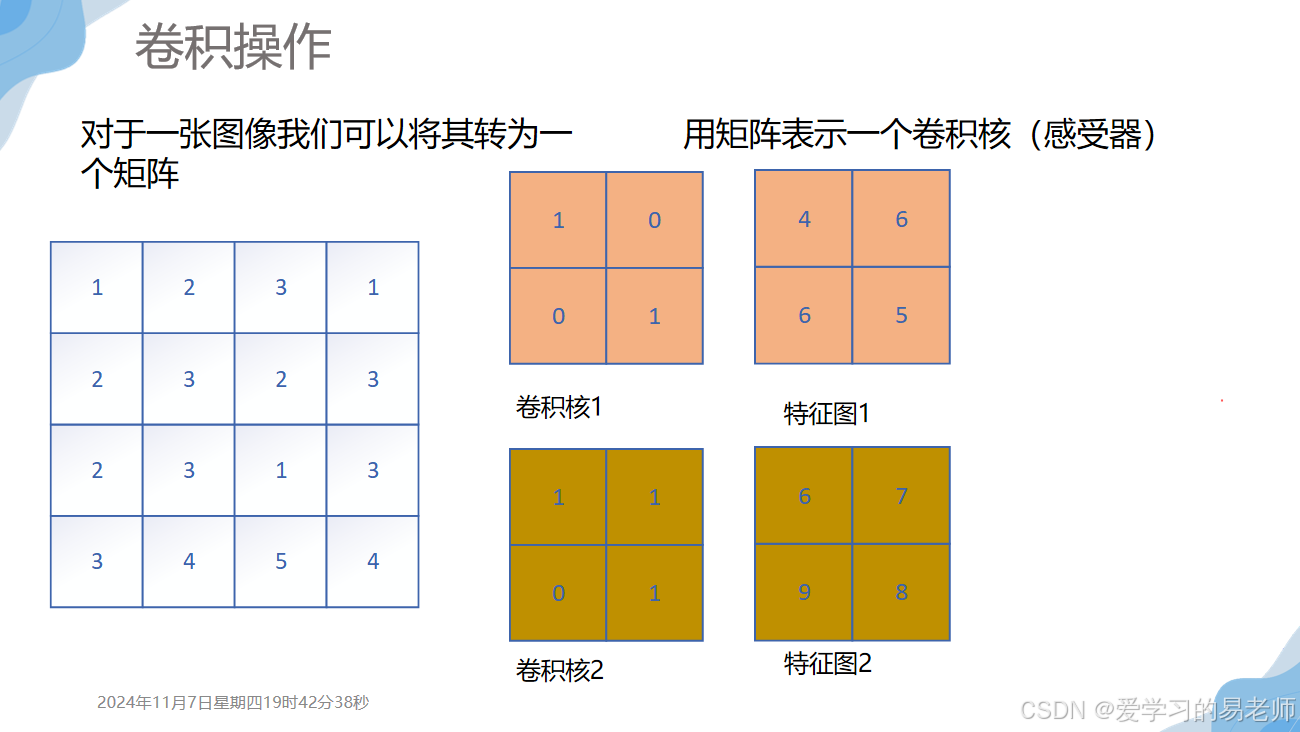

卷积操作是卷积神经网络的核心。它类似于人脑中的感受野,通过卷积核对原特征图像进行卷积运算,提取出图像中的局部特征。

1. 卷积核(感受器)

卷积核是一个小的矩阵,用于在输入图像上滑动并进行点积运算。不同的卷积核可以提取出不同的图像特征,如边缘、纹理等。

2. 卷积运算

对于一张图像,我们可以将其转为一个矩阵。然后,用卷积核在图像上滑动,每次滑动都计算卷积核与当前图像区域(感受野)的点积,得到一个新的像素值。这个过程就是卷积运算。

3. 特征图像

经过卷积运算后,我们得到的是一个新的图像,称为特征图像。特征图像的大小取决于输入图像的大小、卷积核的大小和步长(卷积核滑动的距离)。

三、卷积操作的详细步骤

1. 单步卷积

在单步卷积中,卷积核每次移动一个像素。假设输入图像的大小为HxW,卷积核的大小为KxK,则每次卷积运算时,卷积核会与输入图像的一个KxK区域进行点积。然后,卷积核向右移动一个像素,重复上述过程,直到遍历整个输入图像。

2. 多步卷积

在多步卷积中,卷积核可以每次移动多个像素(步长大于1)。这样可以进一步减少特征图像的大小,并加快计算速度。但是,步长过大可能会导致信息丢失。

3. 边缘处理

当卷积核滑动到输入图像的边缘时,可能会遇到边缘部分无法完整覆盖卷积核的情况。此时,我们可以采用填充(Padding)的方法,即在输入图像的边缘添加额外的像素值(通常为0),以确保卷积核能够完整地覆盖输入图像的每个区域。

4. 特征图像大小的计算

特征图像的大小可以通过以下公式计算:

[ ( H − K ) / S + 1 ] × [ ( W − K ) / S + 1 ] [(H-K)/S+1] \times [(W-K)/S+1] [(H−K)/S+1]×[(W−K)/S+1]

其中,H和W分别是输入图像的高度和宽度,K是卷积核的大小(假设卷积核是正方形的),S是步长。

四、彩色图像的卷积操作

对于彩色图像,由于其包含RGB三个通道,我们需要对每个通道分别进行卷积操作。然后,可以将每个通道的特征图像进行叠加或融合,得到最终的特征图像。

在实际应用中,我们通常会使用多个卷积核来提取不同的图像特征。这些特征图像将作为下一层的输入,继续进行卷积、池化等操作,直到构建出完整的卷积神经网络。

五、池化与Padding

在卷积神经网络中,池化(Pooling)和Padding是两个非常重要的概念,它们对于提高模型的性能和效率具有关键作用。

池化(Pooling)

池化是一种下采样操作,通常用于卷积层之后,以降低特征图像的维度(高度和宽度),同时保留重要特征。池化层的主要作用是减少参数数量和计算量,防止过拟合,以及提高模型的鲁棒性。

最常见的池化操作有两种:最大池化(Max Pooling)和平均池化(Average Pooling)。

-

最大池化:在池化窗口内选择最大值作为输出。这种操作可以保留图像中的显著特征,如边缘和纹理。

-

平均池化:在池化窗口内计算所有值的平均值作为输出。这种操作可以平滑图像,减少噪声。

池化窗口的大小和步长通常是预先设定的,常见的窗口大小有2x2、3x3等,步长通常与窗口大小相同,以实现下采样。

Padding

Padding是在输入图像的边界周围添加额外的像素值(通常为0),以确保卷积核能够完整地覆盖输入图像的每个区域。Padding的主要作用是控制特征图像的大小,以及防止信息在卷积过程中丢失。

Padding有两种常见的方式:有效填充(Valid Padding)和相同填充(Same Padding)。

-

有效填充:不进行填充,即Padding=0。此时,特征图像的大小会减小,具体取决于卷积核的大小和步长。

-

相同填充:进行填充,使得输出特征图像的大小与输入图像相同(或尽可能接近)。这通常要求Padding的大小根据卷积核的大小和步长进行计算。

在实际应用中,选择哪种Padding方式取决于具体任务和网络结构。有效填充可以减少计算量,但可能会导致信息丢失;相同填充可以保留更多信息,但可能会增加计算量。

通过合理地使用池化和Padding,我们可以构建出更加高效和鲁棒的卷积神经网络模型。这些技术不仅提高了模型的性能,还为后续的图像处理任务提供了有力的支持。

六、总结

卷积神经网络通过卷积操作提取图像中的局部特征,并通过多层网络结构构建出强大的图像处理能力。其局部连接、权重共享和池化等操作显著减少了参数数量,提高了模型的泛化能力。在处理图像分类、目标检测等任务时,卷积神经网络展现出了卓越的性能和广泛的应用前景。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?