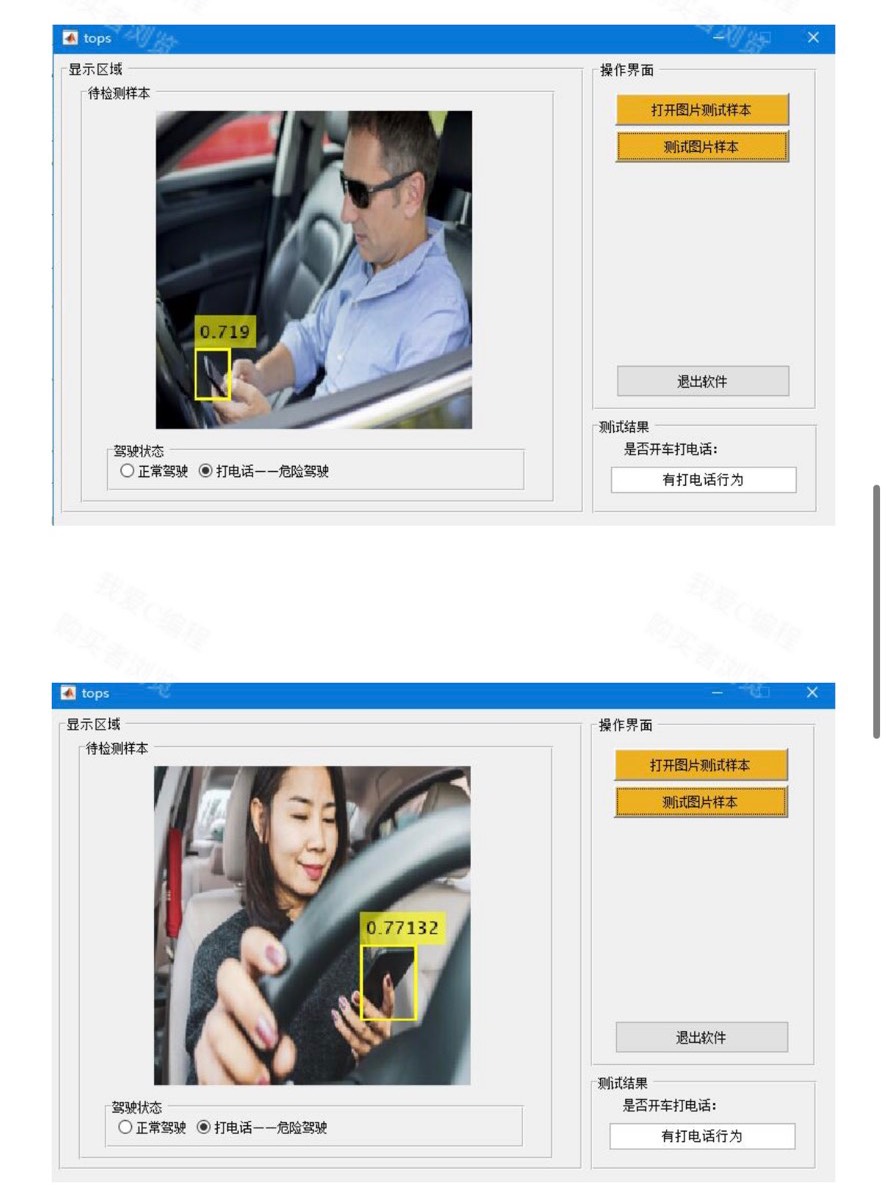

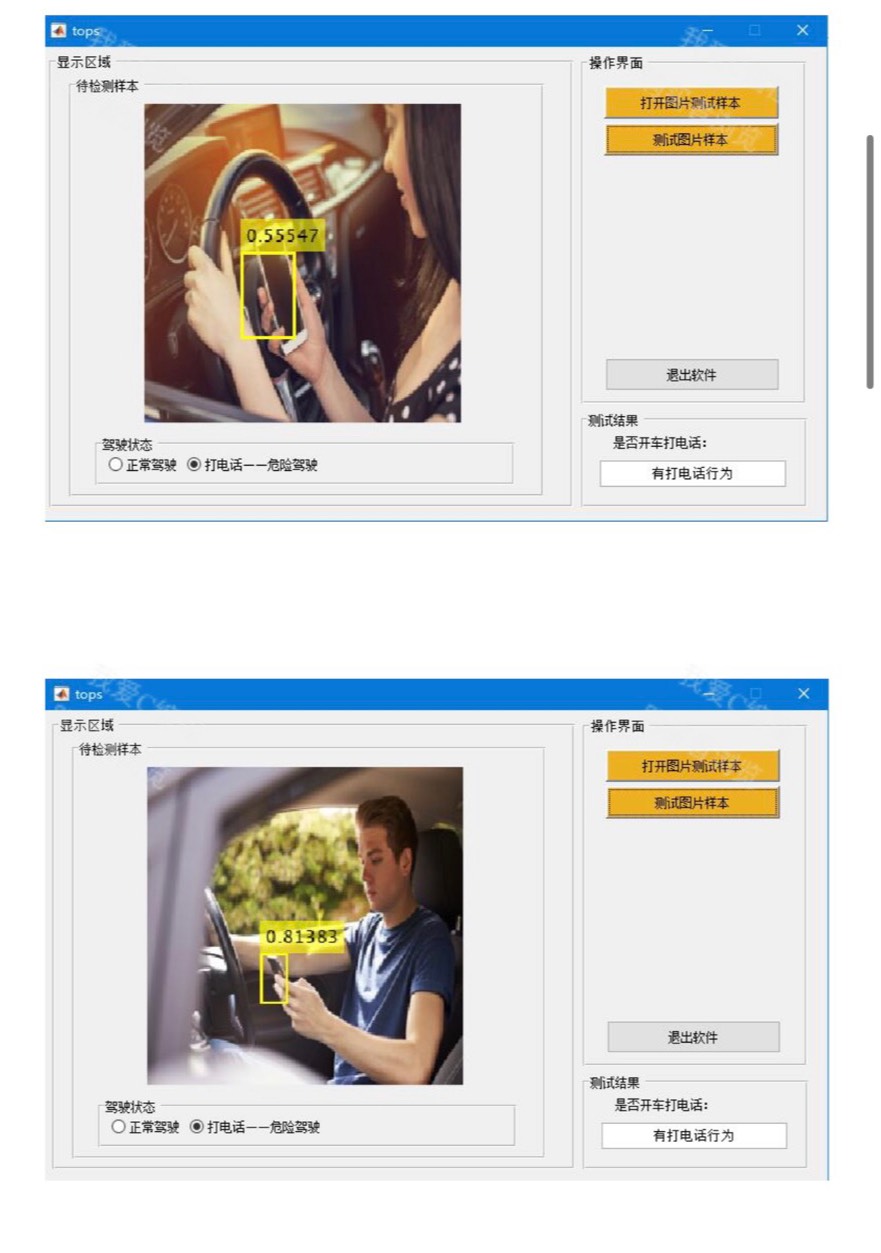

基于Yolov2深度学习网络的驾驶员打电话行为预警系统matlab仿真

开车打电话这事有多危险不用我多说了吧?今儿咱们就用Matlab整个能实时监测司机打电话的预警系统。YOLOv2这货速度快准头还行,正适合车载设备这种需要实时处理的情况。先上段数据预处理的代码镇楼:

imds = imageDatastore('driving_dataset/','IncludeSubfolders',true);

augmenter = imageDataAugmenter('RandXReflection',true,'RandYReflection',true);

trainingData = transform(imds,@(x) preprocessData(x,[416 416 3]));这段把图片统一缩放到416x416尺寸,顺带做了随机镜像增强。注意这里用了YOLO经典的输入尺寸,别瞎改参数,改小了容易漏检,改大了显存分分钟爆炸。

数据搞定之后,咱们得搭个像样的网络结构。YOLOv2的骨干网络Darknet-19直接搬过来用就成,Matlab里自带的预训练模型省事儿:

lgraph = yolov2Layers([416 416 3],2,anchorBoxes,'darknet19');这里anchorBoxes得自己算,建议用k-means聚类训练集的标注框。实测下来打电话这个场景,三个anchor足够用,尺寸大概在[30,60; 60,30; 80,80]这种比例,毕竟手机在画面里不会太大。

训练配置这块有讲究,初始学习率别超过1e-3:

options = trainingOptions('sgdm',...

'InitialLearnRate',0.001,...

'MiniBatchSize',8,...

'MaxEpochs',50,...

'Shuffle','every-epoch');注意BatchSize跟显存容量挂钩,GPU不够猛的就调小点。训练时记得盯着损失曲线,要是分类损失降得比定位损失快太多,八成是数据标注有问题。

实际检测时整个流程得串起来:

detector = yolov2ObjectDetector(lgraph);

while hasFrame(videoReader)

frame = readFrame(videoReader);

[bboxes,scores] = detect(detector,frame);

if ~isempty(bboxes)

triggerAlarm(); % 触发蜂鸣器警告

end

end这里有个坑——误报率控制。建议加个持续检测机制,比如连续5帧都检测到才报警,避免手机屏幕反光之类的误判。

最后说说部署,Matlab转成C++代码这事儿吧,能用但不够优雅。真要上车载设备还是得转TensorRT,不过那是后话了。这套系统在模拟环境下帧率能到25fps,1080p视频吃得消,但实际落地还得考虑摄像头安装角度和夜间补光的问题。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?