目录

随着人工智能技术的不断发展,本地化部署大语言模型的需求日益增加。DeepSeek 作为一个强大的本地模型,可以通过 Ollama 提供 API 支持,并结合 Chatbox 提供友好的 UI 界面,实现本地化的智能交互。本文将详细介绍如何下载、安装并配置 DeepSeek 本地模型,以及如何通过 Chatbox 使用它进行对话。

1. 下载并安装 Ollama

Ollama 是一个轻量级的本地模型管理工具,支持多种大语言模型,包括 DeepSeek。以下是安装 Ollama 的步骤:

-

访问 Ollama 官方网站:前往 Ollama 官方下载页面,选择适合你操作系统的版本进行下载。

-

Windows 用户可以直接下载

OllamaSetup.exe。 -

macOS 用户下载

.zip文件并解压。 -

Linux 用户可以参考 Ollama 官方文档进行安装。

-

-

安装 Ollama:

-

Windows:双击

OllamaSetup.exe,按照安装向导提示完成安装。 -

macOS:解压下载的

.zip文件后,将应用程序拖到“应用程序”文件夹。

-

-

验证安装:

-

打开终端或命令提示符,输入以下命令验证 Ollama 是否安装成功:

ollama -v如果安装成功,你会看到 Ollama 的版本信息。

-

-

-

2. 下载并运行 DeepSeek 模型

DeepSeek 是一个高性能的语言模型,支持多种参数规模。以下是下载和运行 DeepSeek 的步骤:

-

选择模型版本:

-

DeepSeek 提供多种参数规模的模型,如 1.5B、7B、14B 等。根据你的硬件配置选择合适的版本。例如,1.5B 版本适合低配置设备。

-

-

下载并运行模型:

-

在终端或命令提示符中输入以下命令下载并运行 DeepSeek 模型:

ollama run deepseek-r1:1.5b如果模型尚未下载,Ollama 会自动下载并启动。

-

-

测试模型:

-

模型启动后,你可以直接在终端中输入问题与模型进行对话。

-

3. 下载并配置 Chatbox

Chatbox 是一个支持多种 AI 模型的桌面客户端,可以方便地与本地部署的 DeepSeek 模型进行交互。

-

下载 Chatbox:

-

访问 Chatbox 官方网站,根据你的操作系统下载最新版本。

-

-

-

安装 Chatbox:

-

下载完成后,直接运行安装程序并完成安装。

-

-

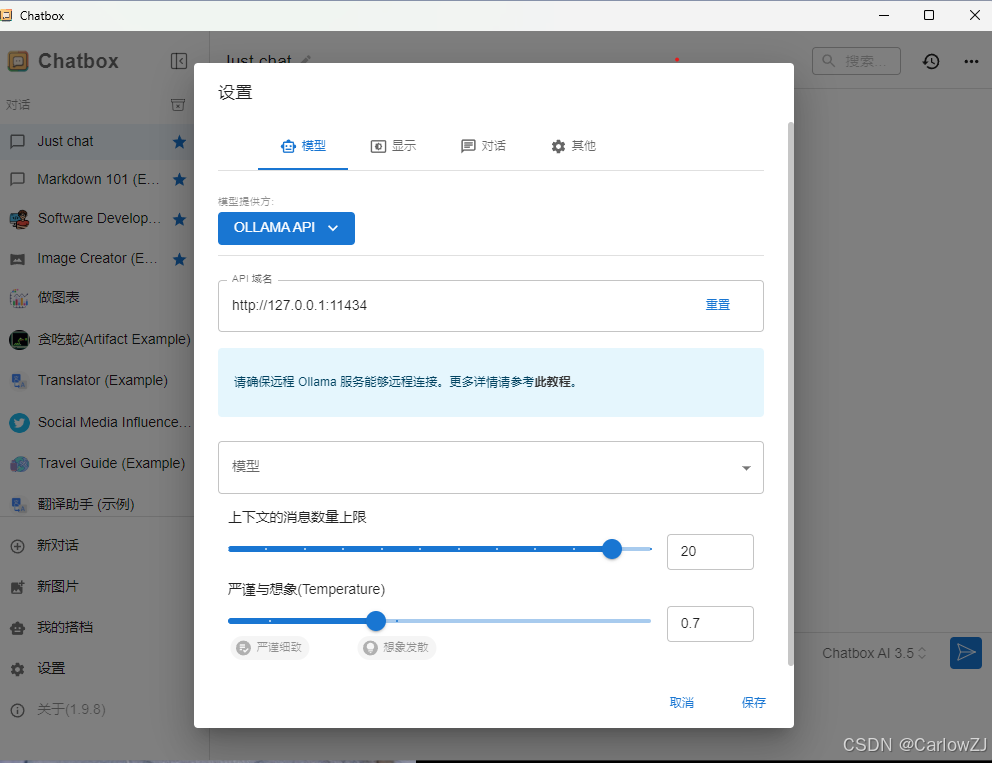

配置 Chatbox:

-

打开 Chatbox,点击“设置”。

-

-

-

在“模型提供方”中选择“OLLAMA API”。

-

填写以下配置信息:

-

API 地址:

http://localhost:11434。 -

模型名称:选择你下载的 DeepSeek 模型版本,例如

deepseek-r1:1.5b。

-

-

-

测试 Chatbox:

-

配置完成后,返回 Chatbox 主界面,输入问题并测试模型的响应。

-

4. 无需联网也能和 DeepSeek 畅快聊天

完成上述配置后,你就可以在断网情况下使用 DeepSeek 模型进行对话了。例如,你可以让模型帮助你生成文章标题、解答问题或提供创意建议。

5. 总结

通过本文的介绍,你已经成功部署了 DeepSeek 本地模型,并通过 Chatbox 实现了便捷的交互。你可以根据自己的需求进一步探索更多功能,例如调整模型参数或尝试其他大语言模型。

希望这篇文章能帮助你快速上手并享受本地 AI 模型带来的便利。如果你在操作过程中遇到任何问题,欢迎在评论区留言交流!

另外优秀的博客:

923

923

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?