在我们的数字时代,我们经常得处理那些装在PDF里头的庞大数据堆。

前排提示,文末有大模型AGI-优快云独家资料包哦!

想从这些文件里挖出有用信息?

可能会让人觉得既枯燥又费劲。但想象一下,如果有一个AI助手能直接从这些PDF中找答案,那会有爽!

本文将带你了解如何使用谷歌的Gemini LLM以及一种叫做检索增强生成(RAG)的策略,来打造这样一个AI驱动的应用。

跟着这个指南,你不仅能上传PDF文件,还能处理它们的内容,并且通过一个简洁的网页应用用自然语言来查询它们!

RAG究竟是啥?

RAG代表的是检索增强生成,这是一种混合AI方法,它把信息检索和语言生成结合起来,旨在提高回答的准确性和上下文感知力。

-

检索

:找到和查询相关的文档或数据。

-

增强生成

:利用检索到的数据作为上下文来产生精确的回答。

为什么要用RAG?

传统的大型语言模型(LLM)依赖它们训练时的知识,这可能已经过时或不完整。而RAG则可以改进这一点,方法包括:

-

实时接入外部数据源(比如PDF文件)。

-

生成更准确、更有上下文感的答案。

-

减少错误信息(幻觉答案)的出现。

RAG实战演示

设想一下,你上传了一家公司的财务报告(PDF格式),然后问:“2023年第二季度的净利润是多少?

”RAG系统不会依赖普通知识库,而是直接从报告中检索具体数据,并给出答案—这样可靠多了。

用Gemini LLM实现RAG的步骤

-

上传PDF

:用户可以上传一个或多个PDF文件。

-

从PDF提取文本

:利用Python的PyPDF2库来解析并抽取原始文本。

-

文本分块处理

:用递归字符分割器把文本分成好处理的小块,确保处理得当。

-

文本向量化

:用谷歌的GenerativeAI Embeddings把文本块转换成向量嵌入(数值形式)。

-

在FAISS中存储向量

:利用FAISS(一种向量数据库)来存储和索引向量嵌入,从而实现高效的相似性搜索。

-

处理用户查询

:把用户的查询转换成向量,并在FAISS数据库中进行搜索,找到相关的文本块。

-

用Gemini生成答案

:将找到的文本块作为上下文输入Gemini LLM,生成既准确又具有上下文感知的答案。

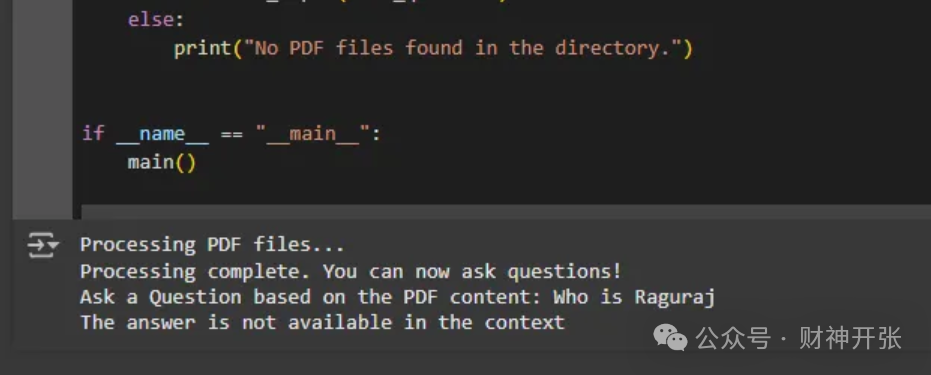

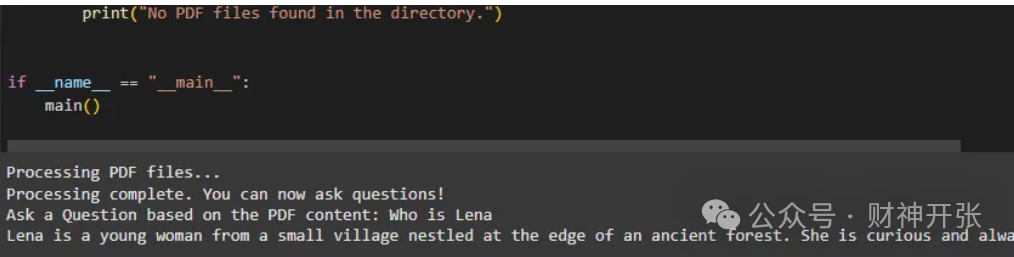

import os``os.system("pip install PyPDF2")``os.system("pip install langchain --upgrade")``os.system("pip install google-generativeai")``os.system("pip install faiss-cpu")``os.system("pip install langchain_google_genai")``os.system("pip install langchain.vectorstores")``os.system("pip install langchain_community")``from PyPDF2 import PdfReader``from langchain.text_splitter import RecursiveCharacterTextSplitter``from langchain_google_genai import GoogleGenerativeAIEmbeddings``import google.generativeai as genai``from langchain.vectorstores import FAISS``from langchain_google_genai import ChatGoogleGenerativeAI``from langchain.chains.question_answering import load_qa_chain``from langchain.prompts import PromptTemplate``GOOGLE_API_KEY = "PASTE YOUR GEMINI API KEY HERE"``genai.configure(api_key=GOOGLE_API_KEY)``def get_pdf_text(pdf_docs):` `# Reads PDF files and extracts raw text from each page.` `# Combines the text into a single string.` `text = ""` `for pdf in pdf_docs:` `pdf_reader = PdfReader(pdf)` `for page in pdf_reader.pages:` `text += page.extract_text()` `return text``def get_text_chunks(text):` `# Splits long text into smaller chunks` `# (10,000 characters with 1,000-character overlap) for efficient processing.` `text_splitter = RecursiveCharacterTextSplitter(chunk_size=10000, chunk_overlap=1000)` `chunks = text_splitter.split_text(text)` `return chunks``def get_vector_store(text_chunks):` `# Embedding: Converts text into numerical vectors using Gemini embeddings.` `# FAISS Database: Stores these vectors for fast similarity searches.` `embeddings = GoogleGenerativeAIEmbeddings(model="models/embedding-001")` `vector_store = FAISS.from_texts(text_chunks, embedding=embeddings)` `vector_store.save_local("faiss_index")``def get_conversational_chain():` `# Configures Gemini LLM with a custom prompt template.` `# Ensures the model only responds based on provided context to prevent hallucinations.` `prompt_template = """` `Answer the question as detailed as possible from the provided context, make sure to provide all the details, if the answer is not in` `provided context just say, "answer is not available in the context", don't provide the wrong answer\n\n` `Context:\n {context}?\n` `Question: \n{question}\n` `Answer:` `"""` `model = ChatGoogleGenerativeAI(model="gemini-pro", temperature=0.3)` `prompt = PromptTemplate(template=prompt_template, input_variables=["context", "question"])` `chain = load_qa_chain(model, chain_type="stuff", prompt=prompt)` `return chain``def user_input(user_question):` `# Converts the query into an embedding.` `# Finds the most similar text chunks using Euclidean Distance in FAISS.` `# Measures the straight-line distance between vectors (points).` `# Smaller distances indicate higher similarity.` `# FAISS uses this to find relevant document chunks for a given query efficiently.` `# Passes results to Gemini LLM for generating answers.` `embeddings = GoogleGenerativeAIEmbeddings(model="models/embedding-001")` `new_db = FAISS.load_local("faiss_index", embeddings, allow_dangerous_deserialization=True)` `docs = new_db.similarity_search(user_question)` `chain = get_conversational_chain()` `response = chain({"input_documents": docs, "question": user_question}, return_only_outputs=True)` `print(response["output_text"])``def main():` `# Specify the working directory containing PDF files` `pdf_dir = "./" # Replace with your target directory path if needed` `pdf_files = [os.path.join(pdf_dir, f) for f in os.listdir(pdf_dir) if f.endswith('.pdf')]` `# Process PDF files` `if pdf_files:` `print("Processing PDF files...")` `raw_text = get_pdf_text(pdf_files)` `text_chunks = get_text_chunks(raw_text)` `get_vector_store(text_chunks)` `print("Processing complete. You can now ask questions!")` `# Accept user query` `user_question = input("Ask a Question based on the PDF content: ")` `if user_question:` `user_input(user_question)` `else:` `print("No PDF files found in the directory.")``if __name__ == "__main__":` `main()

记得操作步骤:

把PDF文件加到Python文件的工作目录里。

别忘了在第19行加上你的Gemini API密钥哦,

可以在这里搞定:https://ai.google.dev/gemini-api/docs/api-key

然后运行:python llm.py

无论答案是否在上下文中,我们都成功构建了一个AI应用,它:

-

读取并处理PDF文件。

-

利用Gemini LLM进行自然语言理解。

-

通过RAG来获取并基于PDF生成准确的答案。

有了这套装备,你不仅可以处理更多的文件格式,还能整合外部数据库,甚至可以把它部署成一个云服务。

更多信息和链接:

-

网页:https://ragu.live/

-

LinkedIn:https://www.linkedin.com/in/raguraj-sivanantham/

-

GitHub:https://github.com/sragu2000

-

Medium:https://medium.com/@sragu2000

读者福利:如果大家对大模型感兴趣,这套大模型学习资料一定对你有用

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

包括:大模型学习线路汇总、学习阶段,大模型实战案例,大模型学习视频,人工智能、机器学习、大模型书籍PDF。带你从零基础系统性的学好大模型!

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?