通俗描述

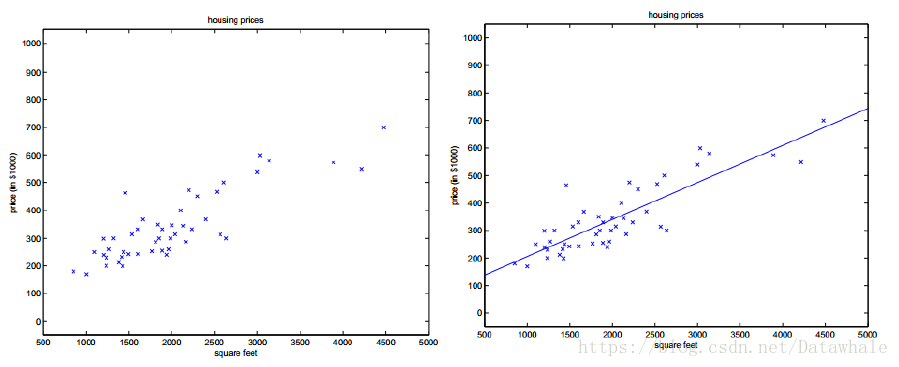

线性回归模型是利用线性函数对一个或多个自变量和因变量 ( y ) (y) (y)之间关系进行拟合的模型。

公式推导

数据输入

给定数据集 D = { ( x 1 , y 1 ) , ( x 2 , y 2 ) , … , ( x m , y m ) } , y i ∈ R D=\{(x_1,y_1),(x_2,y_2),…,(x_m,y_m)\},y_i\in R D={

(x1,y1),(x2,y2),…,(xm,ym)},yi∈R

1)一元线性回归:当 x i x_i xi只有一个特征值, x i = ( x i 1 ) x_i=(x_{i1}) xi=(xi1)

| 原始模型 | f ( x i ) = w x i + b f(x_i)=wx_i+b f(xi)=wxi+b |

|---|---|

| 性能度量 | 均方误差 ∑ i = 1 m ( f ( x i ) − y i ) 2 \sum\limits_{i=1}^{m}(f(x_i)-y_i)^2 i=1∑m(f(xi)−yi)2 |

| 目标函数 | 求使均方误差最小时的 w , b w,b w,b,即最小二乘法 ( w ∗ , b ∗ ) = a r g m i n ( w , b ) ∑ i = 1 m ( y i − w x i − b ) 2 \\ (w^*,b^*)={argmin \atop (w, b)}\sum\limits_{i=1}^m(y_i - wx_i - b)^2 (w∗,b∗)=(w,b)argmini=1∑m |

线性回归模型通过线性函数对自变量和因变量间的关系进行拟合。本文介绍了线性回归的基本概念,如一元和多元线性回归、最小二乘法、最大似然估计、梯度下降法、凸函数以及评价标准。此外,还讨论了线性回归的优缺点和应用场景,并提出了相关问题,如线性回归能否用于分类和非线性数据处理。

线性回归模型通过线性函数对自变量和因变量间的关系进行拟合。本文介绍了线性回归的基本概念,如一元和多元线性回归、最小二乘法、最大似然估计、梯度下降法、凸函数以及评价标准。此外,还讨论了线性回归的优缺点和应用场景,并提出了相关问题,如线性回归能否用于分类和非线性数据处理。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?