🌐 社群导航

🔗点击加入➡️【AIGC/LLM/MLLM/3D/自动驾驶】 技术交流群

最新论文解读系列

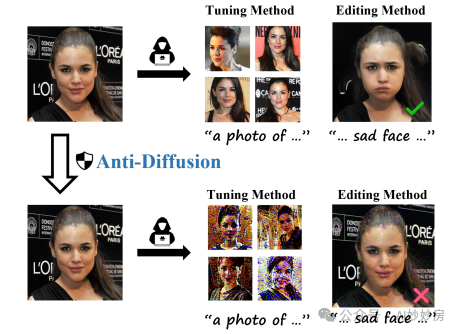

论文名:Anti-Diffusion: Preventing Abuse of Modifications of Diffusion-Based Models

论文链接:https://arxiv.org/pdf/2503.05595

开源代码:https://github.com/whulizheng/Anti-Diffusion

导读

尽管基于扩散的技术在图像生成和编辑任务中取得了显著成功,但它们的滥用可能会导致严重的负面社会影响。最近,一些研究工作已被提出,旨在防范基于扩散方法的滥用。然而,在特定场景下,它们的保护可能会受到手动定义提示词或稳定扩散(Stable Diffusion,SD)版本的限制。此外,这些方法仅专注于微调方法,而忽略了同样可能构成重大威胁的编辑方法。在这项工作中,我们提出了Anti - Diffusion,这是一个为通用的基于扩散的方法设计的隐私保护系统,适用于微调和编辑技术。为了减轻手动定义提示词对防御性能的限制,我们引入了提示词微调(Prompt Tuning,PT)策略,该策略能够精确表达原始图像。为了防范微调和编辑方法,我们提出了语义干扰损失(Semantic Disturbance Loss,SDL),以破坏受保护图像的语义信息。鉴于针对编辑方法防御的研究有限,我们开发了一个名为Defense - Edit的数据集,用于评估各种方法的防御性能。实验表明,我们的Anti - Diffusion在不同场景下的各种基于扩散的技术中都实现了卓越的防御性能。

简介

文本到图像合成领域(李等人,2023年;拉梅什等人,2021年;加夫尼等人,2022年;丁等人,2021年)取得了显著进展,这主要得益于扩散模型(霍、贾因和阿比尔,2020年;宋、孟和埃尔蒙,2020年)。许多扩散模型已证明其能够生成质量卓越的图像,如稳定扩散模型(SD,龙巴赫等人,2022年;杨等人,2023年)、像素艺术模型(陈等人,2023年、2024年)。基于这些扩散模型,还提出了一些可控生成方法(控制网络(Control-Net,张、饶和阿格拉瓦拉,2023年)、文本到图像适配器(T2I-Adapter,牟等人,2023年))和个性化方法(梦境展位(DreamBooth,鲁伊斯等人,2023年)、低秩自适应(LoRA,胡等人,2021年)、文本反转(Textual Inversion,加尔等人,2022年))。随着文本到图像技术的快速发展,许多行业专业人士甚至普通用户都可以根据自己的想法创作图像或训练个性化模型。

预备知识

稳定扩散模型(Stable Diffusion)

稳定扩散模型是一种在大规模数据上进行训练的潜在扩散模型(Latent Diffusion Model,LDM)。潜在扩散模型是一种能够从高斯噪声中合成高质量图像的生成模型。与传统的扩散模型不同,潜在扩散模型的扩散过程发生在潜在空

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?