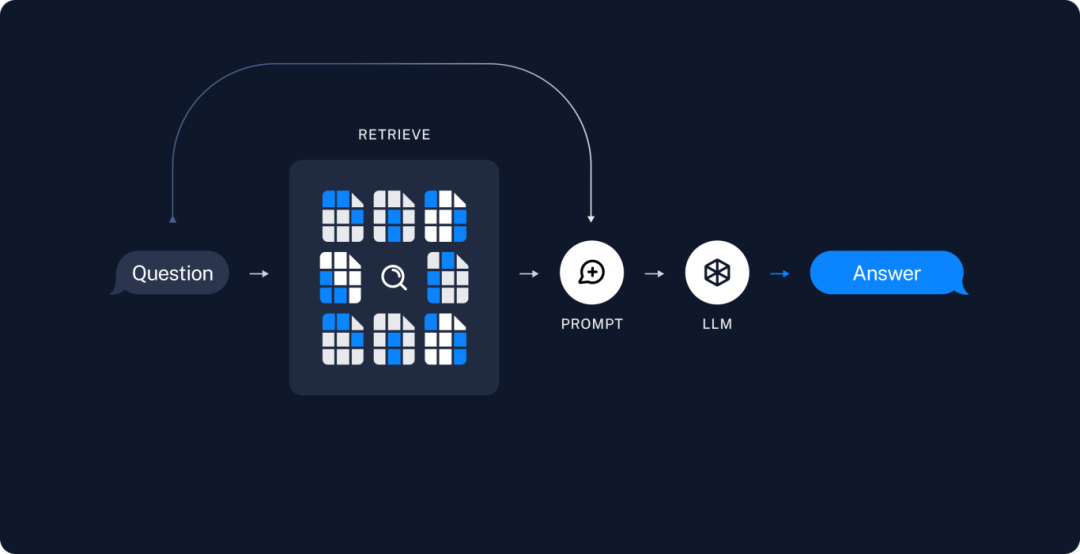

RAG全称是Retrieval-Augmented Generation,即检索增强生成。通俗来讲,就是在用户提的问题的基础上,引入相关资料信息,把“问题+相关资料” 一起给大模型,让大模型在参考资料的约束或提示下回答问题而不是随意发挥,从而期望大模型生成质量更高、更准确的答案,改善大模型”幻觉“、训练数据过时、 知识范围有限等带来的负面问题。

在涉及到专业领域知识或企业内部知识的应用场景中,这项技术发挥着重要作用。相比于大模型微调,RAG时间成本、经济成本和技术难度都更低。

本期内容涉及到以下知识点:

1.使用LangChain调用DeekSeek-v3模型服务

2.设计提示词模板,包括系统提示词和用户提示词

3.加载知识库,具体来说是本地或在线文档

4.将知识库中的文档分割成chunks,即多个片段

5.使用阿里云百炼的text-embedding-v2模型做文本嵌入,然后将这些向量保存到向量数据库中,供之后检索使用,即indexing

6.使用BAAI/bge-reranker-large模型自定义LangChain的ReRank类,用于提升知识库检索结果的质量

7.设计输出解析器,LangChain中的输入输出一般不是简单的字符串,比如大模型输出的是AIMessage对象,我们需要将结果格式化为目标形式

8.构建LCEL链,chain是LangChain框架的核心特点

9.给链传入回调函数,用于在链运行时获取状态信息或执行业务逻辑等

LangChain对各种功能进行了封装,所以上述的内容虽然很多,但实际代码量却比较少。

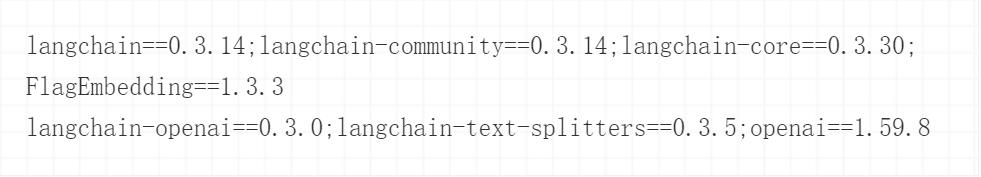

代码基于当前LangChain的最新版本v0.3

向观智能公众号发送文件码 7330 即可获取本文相关文件

Python库版本信息如下,使用pip默认安装最新版本即可:

本期内容采用递进的方式展开。

大模型调用

LangChain可以接入本地模型和云服务模型,模型来源有OpenAI、DeepSeek、Anthropic、Hugging Face等等,可调用的模型十分丰富。

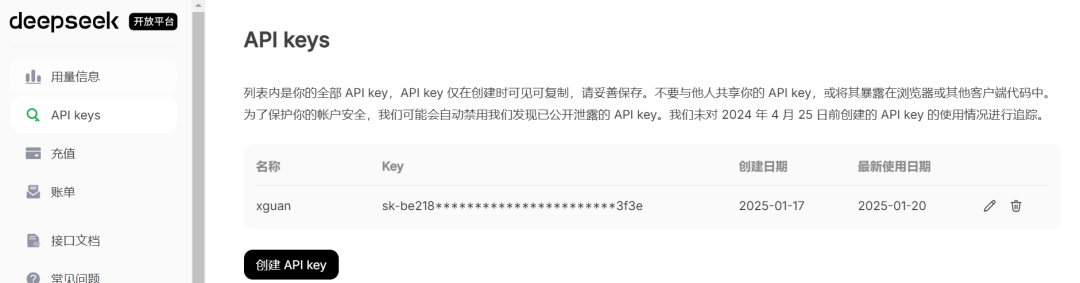

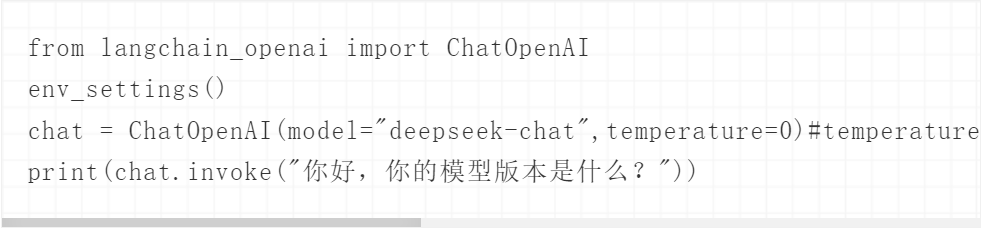

比如可以在DeepSeek开放平台上获取我们的API Key,用它来请求DeepSeek-v3的推理服务:(link=>https://platform.deepseek.com/)

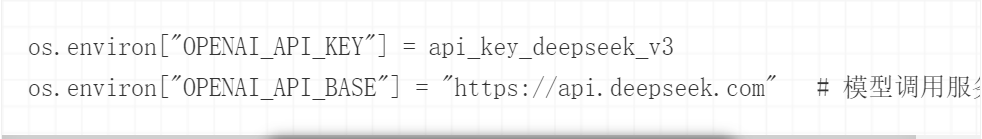

这里在自定义的函数env_settings()中设置了DeepSeek的API Key和服务地址两个环境变量,DeepSeek采用了和OpenAI相同的环境变量名称与调用方式:

提示词模板

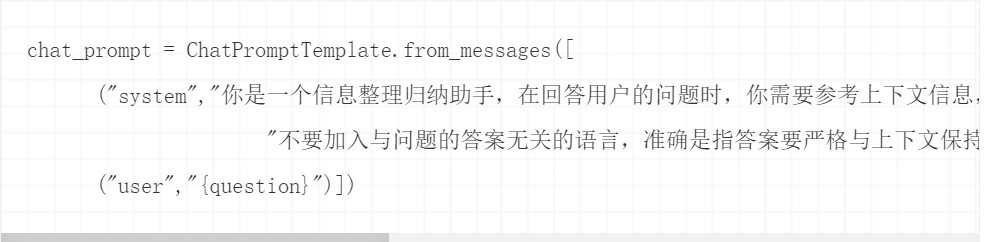

在LangChain中提示词模板推荐用ChatPromptTemplate。from_messages从消息对象模板构造整个提示词模板,每个元组的第一个元素代表消息对象模板类,第二个元素是该消息的提示词模板:

如上面的system和user分别代表对应的SystemMessageTemplate和用户消息模板HumanMessageTemplate,用字符串比传入实例对象的代码要简洁。

下面看提示词的写法:

(“system”,“你是一个信息整理归纳助手,在回答用户的问题时,你需要参考上下文信息,结合用户的问题以及上下文信息,你归纳出简练、准确的答案,简练是指不要加入与问题的答案无关的语言,准确是指答案要严格与上下文保持一致。请注意,如果上下文的内容为空,那么你就返回”在资料中没有相关信息“这句话,而不要自己生成答案。上下文的信息如下:{context}”)

(“user”,“{question}”)

system即系统提示词部分主要用来提供上下文信息,其中的context是占位符,后面用从知识库中检索到的与question相近的内容填充,作为对用户问题的补充说明。

用户的问题将用来填充question占位符。

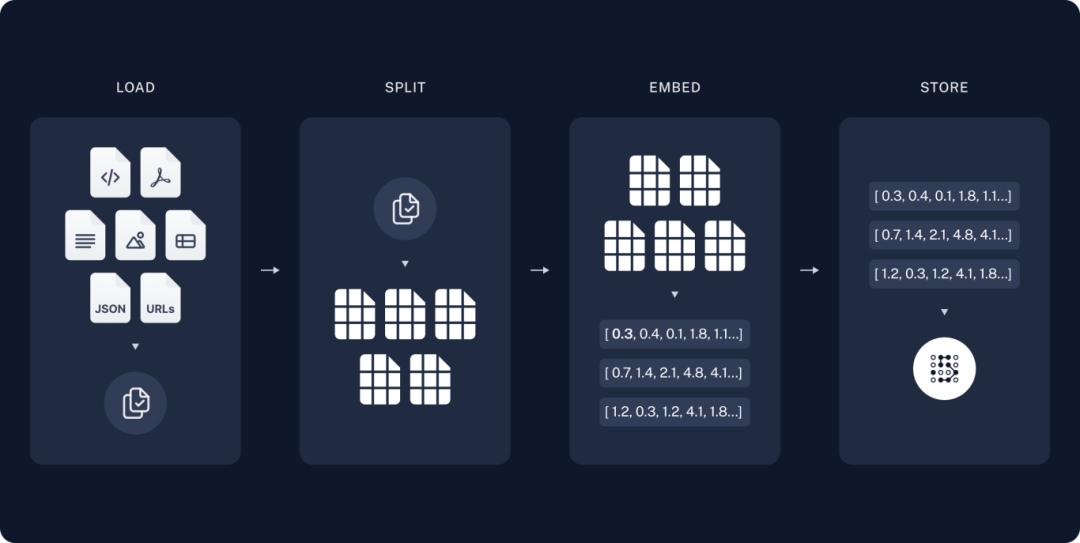

文档加载、分割与向量存储

这一部分是做信息的索引(indexing)

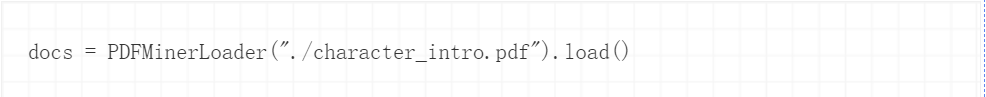

langchain_community.document_loaders中提供了各种文档加载器,如PDF、MarkDown、HTML、网络链接、txt等等。

任何类型的文档被加载后都成为Document对象,该对象的page_content字段保存文档内容,元信息字段保存文档的附加信息,比如位置。

加载得到的文档对象一般需要分割,原因有多种,比如文档太长模型无法处理、无法用向量表征语义等。

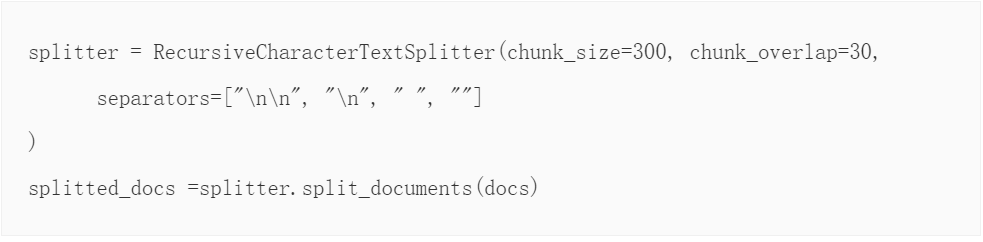

加载器推荐使用代码示例中的,chunk_size是指每块的最大字符长度;chunk_overlop是相邻块的重叠字符数,很简单,这样做是为了减少语义不完整的情况;separator是分割的依据:遇到双换行就分割,没有的话遇到换行就分割,以此类推。

分割后的文档变成了多个块,每个块依然是一个Document对象,其中page_content就是该块包含的内容,元信息则和它源自的那个文档保持一致,有的提高检索质量的算法会用到这个元信息。

接下来是做文本嵌入和词向量保存:

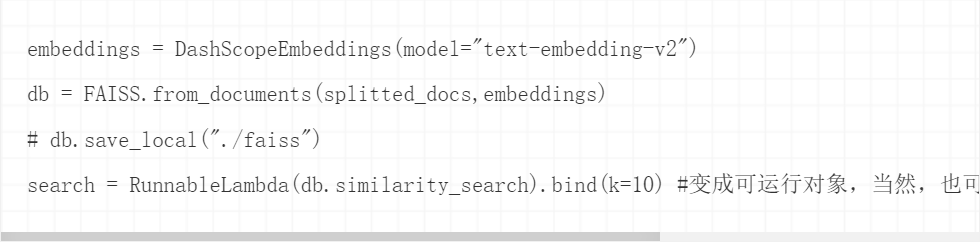

和大语言模型一样,LangChain也集成了OpenAI、Hugging Face等多种嵌入模型。这里用的是阿里云百炼的DashScopeEmbeddings接口,申请API Key即可调用(link=>https://bailian.console.aliyun.com/)

同样,LangChain集成了众多的向量数据库,如Chroma、Milvus、FAISS等。通过传入分割后的chunks列表以及嵌入模型对象,创建向量数据库。这里FAISS也支持将数据持久化到本地。

然后使用RunnableLambda类来包装向量数据库的相似度检索函数,将其变成Runnable对象,从而能够参与构建链。

ReRank重排

LangChain提供了丰富的解决方案来用于提高RAG中向量检索结果的质量,比如混合检索、多检索器检索、压缩上下文(ReRank也属于此种)等等。这里我们使用ReRank模型对向量检索的结果进行重排。

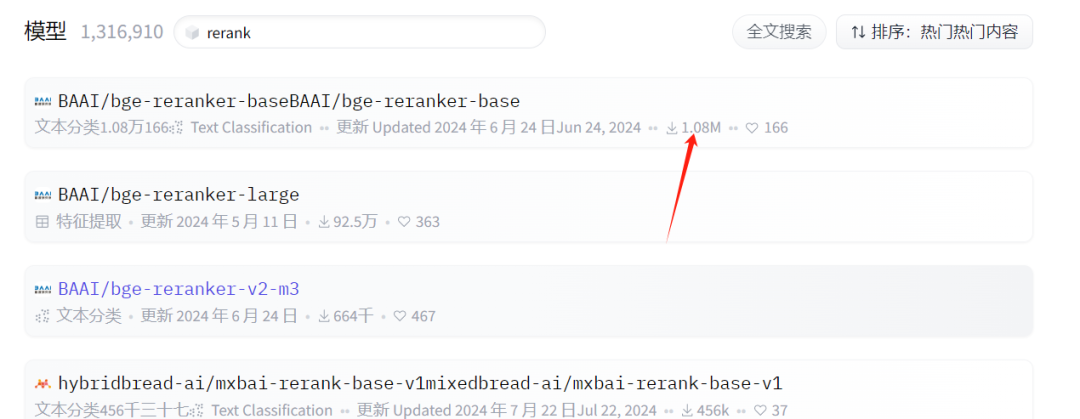

在Hugging Face上,北京智源人工智能研究院BAAI的bge-reranker-large是下载量最高的,中文语境效果很好。

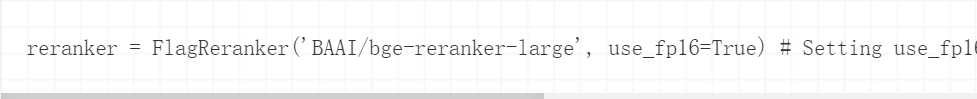

我们将使用这个模型做ReRank。需要安装FlagEmbedding库,创建rerank对象(第一次运行自动从网络下载到默认缓存位置):

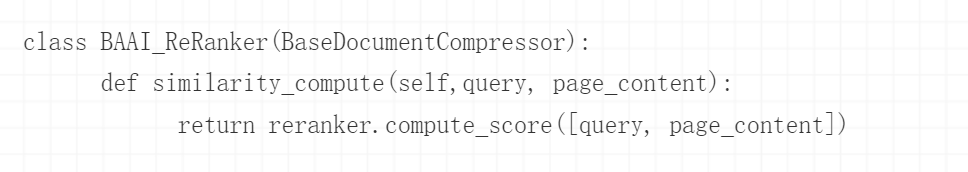

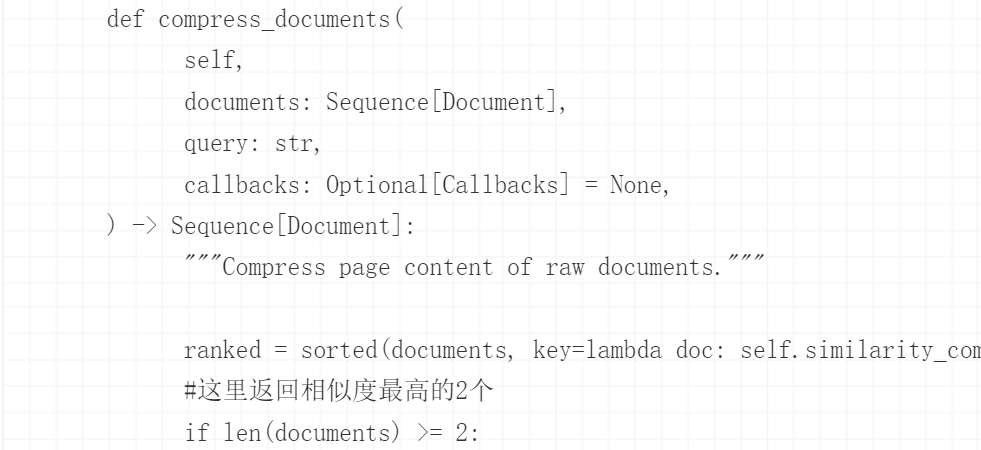

在LangChain中ReRank也属于文本压缩器compressor中的一员。我们需要自定义一个LangChain的Compressor类,继承BaseDocumentCompressor并实现compress_document方法:

上述代码非常简单,similarity_compute函数调用了上述创建的开源rerank模型对象,来计算用户问题和上阶段检索出来的文本的相似度,然后在compress_document中叫仅仅是使用Python内建的sorted函数对检索出来的文本根据相似度得分从大到小排序,最终返回最相似的前两个。

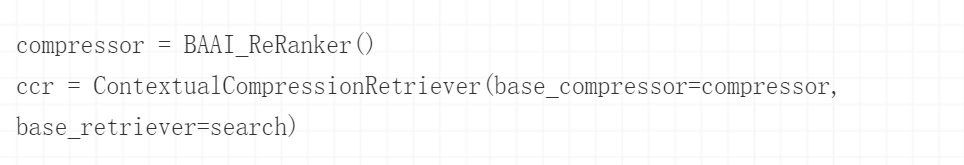

然后把检索加重排的逻辑利用ContextualCompressRetriever整合起来,即将rerank对象和上面得到的向量检索器作为参数传入,该类在只是在内部依次调用它们做了向量检索和重排而已:

构建链

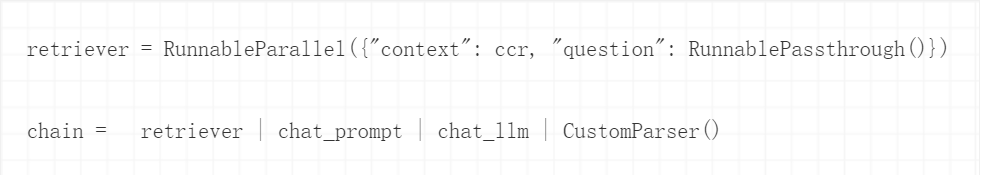

用户输入问题,然后检索得到相似上下文,此时问题和检索到上下文将被同时传入提示词模板来生成提示词,所以我们需要一个并行的组件RunnableParallel,以及一个将问题也变成Runnable对象的组件RunablePassthroug****h (Runnable对象才能用来构建链),前者是可以同时运行两个Runable对象, 后者是将信息包装成Runanble对象并原封不动的地输出 (ps:正如很多人吐槽的那样,LangChain大量的封装逻辑往往也会引起学习或使用者理解上的困难)

上面第二行代码则是将整个流程中的Runnable对象组成了一个链,链本身也是Runnable。

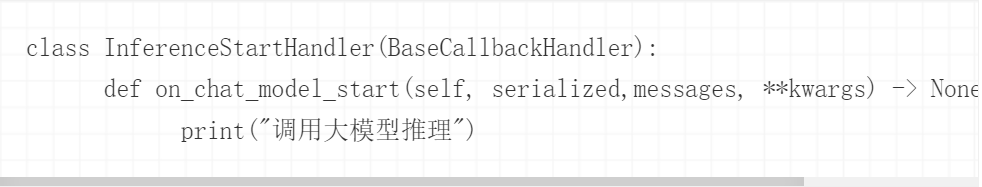

添加回调

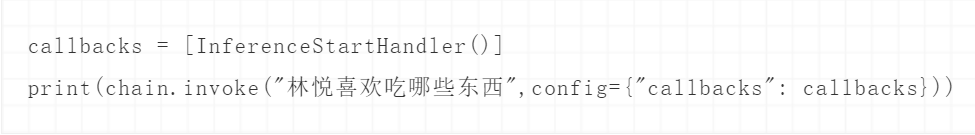

可以在运行时添加自定义回调,这需要继承BaseCallbackHandler,这里我简单地实现了on_chat_model_start函数,它用于在调用大模型推理时的回调:

最后就可以运行我们的问答应用了:

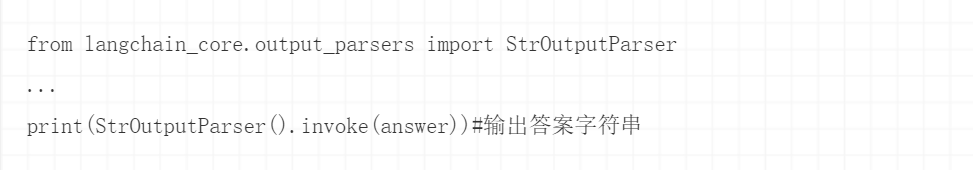

链的最后是一个输出解析器,用来将大模型的回答格式化。

输出解析器

LangChain中的消息都用消息对象封装,比如大模型输出的是AIMessage对象。所以我们需要把结果结构化成我们期望的格式,比如框架自带的StrOutputParser就是提取模型输出对象中content信息。

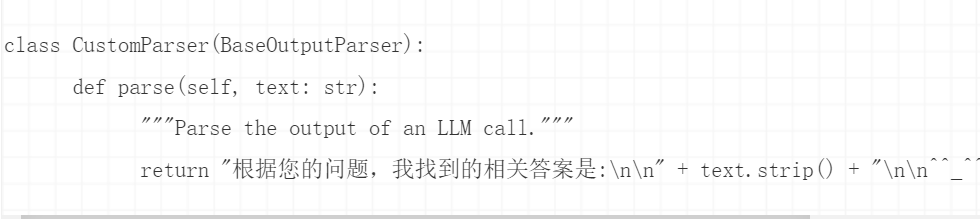

通过继承解析器基类BaseOutputParser,重写parse方法,自定义输出形式:

效果测试

测试文档中有一些人物的介绍信息,我希望通过大模型帮我快速总结关键信息,而不用自己阅读完整文档,在提示词中已经限制大模型要用简练的语言回答,并且文档中不存在的人物就按约定的内容回答不知道,下面看一下模型效果:

问:林悦喜欢吃什么

答:

根据您的问题,我找到的相关答案是:

林悦喜欢吃火锅,尤其是涮毛肚和鸭肠,蘸香油蒜泥调料。她还喜欢各种川味小吃,如钟水饺和龙抄手,以及一些清淡的川菜,如开水白菜。

^_感谢您的咨询_^

问:诸葛亮喜欢吃什么

答:

根据您的问题,我找到的相关答案是:

在资料中没有相关信息。

^_感谢您的咨询_^

如何零基础入门 / 学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

那么我作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,希望可以帮助到更多学习大模型的人!至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

👉 福利来袭优快云大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

全套AGI大模型学习大纲+路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉 福利来袭优快云大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

1090

1090

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?