-正文-

==========================

实现一个支持引用文本的RAG系统不仅能够动态整合外部知识库,还可以在生成答案的同时提供引用文本,从而显著增强答案的可信度和可解释性。

-

1. 业务需求描述

-

2. 系统的工作流程

-

3. 关键技术要点

-

3.1 文件更新与动态管理

-

3.1 提供引用文本的重要性

-

4. LangChain组件概述

-

5. 核心实现思路

-

5.1. 文档加载与预处理

-

5.2. 嵌入与存储

-

5.3. 问题检索与答案生成

-

5.4. 提供引用文本

-

6. 应用场景

– 领取学习资料大礼包,见文末

在人工智能迅速发展的今天,大语言模型(如GPT-4)展示出了强大的语言生成能力。

然而,这类模型也有其局限性,比如无法动态更新知识库、对特定领域信息掌握不足以及容易生成“看似合理但错误”的答案。

为了解决这些问题,**RAG(Retrieval-Augmented Generation)**应运而生。

RAG的最大特点在于,它不仅生成答案,还能提供答案的上下文引用文本。

这种能力显著提高了系统的可信度和可解释性,尤其在需要验证信息来源的应用场景(如法律、医学、学术研究等)中具有重要价值。

1. 业务需求描述

知识库中的文档可能会不断更新,例如新增文件、修改现有文件等。系统需要能够检测到这些变化,并自动完成以下任务:

-

识别新增或更新的文件(通过计算文件的哈希值)。

-

生成嵌入并存储到向量数据库中。

-

避免重复处理已存在的文档,提升效率。

系统不仅需要生成针对用户问题的自然语言答案,还需要明确标明答案的来源,提供可验证的引用文本。这一功能对提升系统的可信度和可解释性至关重要。

-

用户提问后,系统检索最相关的片段,将其作为上下文提供给生成模型。

-

在每个文本片段中,附加文件名、来源路径、片段内容等元信息。

2. 系统的工作流程

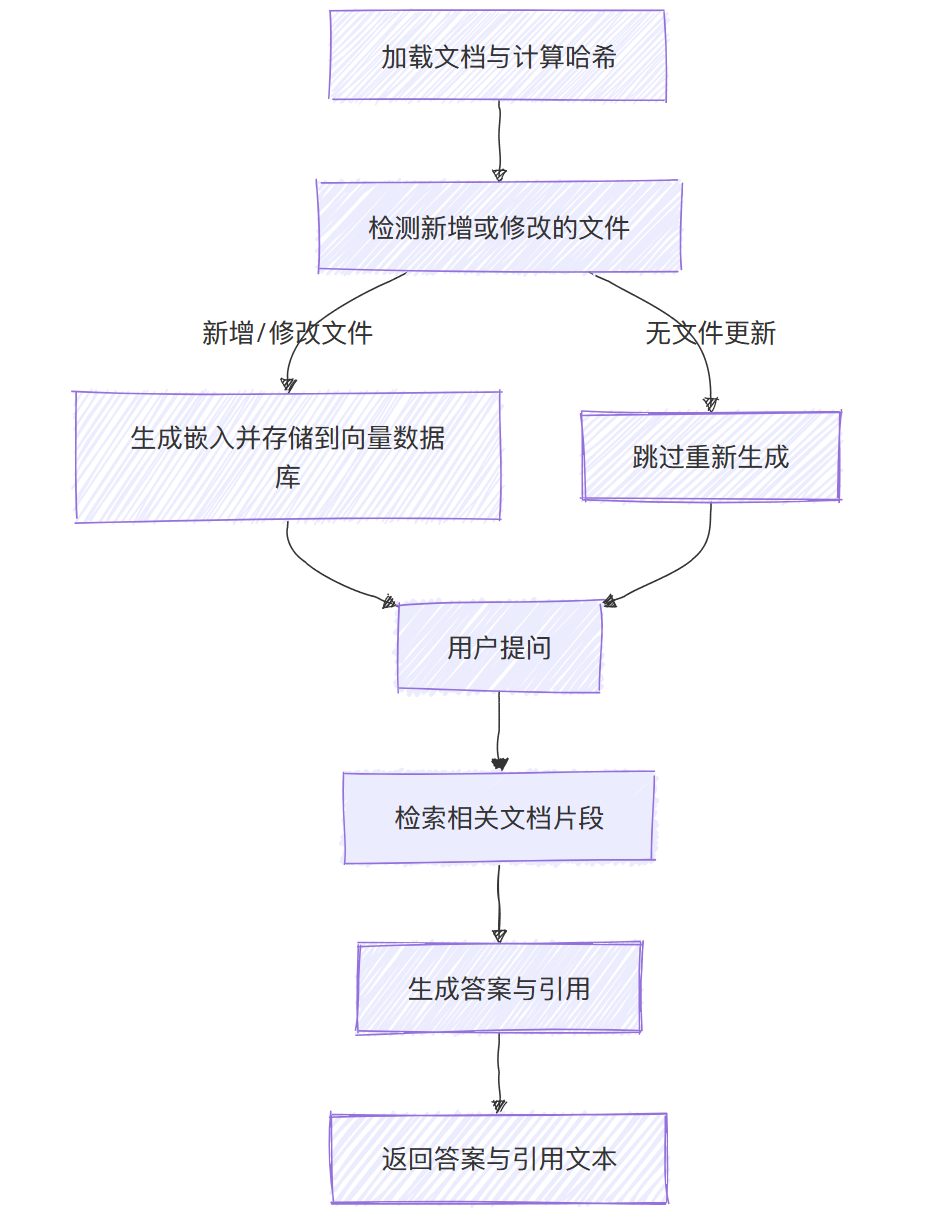

RAG系统的实现可以分为以下几个步骤,每一步都起着至关重要的作用。以下流程图展示了一个完整的RAG系统工作流程:

可以看出,在生成答案的同时,系统会提供引用文档内容作为支撑,这与仅提供答案的传统生成式模型形成了鲜明对比。

3. 关键技术要点

3.1 文件更新与动态管理

为了确保系统知识库的实时性,我们通过计算文件哈希值检测文档的更新或新增。一旦检测到新文件或文件变化,系统会自动生成新嵌入并更新向量数据库。

3.1 提供引用文本的重要性

在实际应用中,系统提供引用文本的能力可以解决以下问题:

-

增强可信度:用户不再只是依赖生成模型的“黑盒答案”,而是可以验证引用内容的准确性。

-

提升可解释性:对于复杂问题,引用上下文能让用户了解生成答案的依据和背景。

-

支持领域审查:在需要严格审查的领域(如法律、医学),引用文本是不可或缺的。

4. LangChain组件概述

LangChain是一个非常适合的工具框架。LangChain通过模块化设计,简化了从数据加载到问答生成的全流程操作。当前系统使用到的核心模块包括:

-

数据加载器(Loader):支持多种数据格式的加载(如文本、PDF等)。

-

文本分割器(Text Splitter):将长文本分割为适合检索的短片段。

-

嵌入与向量存储:将文本映射到高维向量空间并存储,用于快速检索。

-

Prompt管理:灵活设计生成模型的输入提示(Prompt)。

-

问答链(Chain):将检索和生成串联,完成从问题到答案的闭环。

接下来,我们将实现一个支持引用文本的RAG系统,介绍核心实现思路。

5. 核心实现思路

完整代码已放到学习资料包中:langchain_rag_1.py

5.1. 文档加载与预处理

RAG系统的第一步是将文档加载进来。LangChain提供了强大的文档加载工具,如DirectoryLoader,可以一次性加载整个文件夹中的文本文件。加载后的文档需要经过预处理,包括清理无关字符和分割文本。

loader = DirectoryLoader( dir_path, glob="**/*.txt", loader_cls=TextLoader, loader_kwargs={"encoding": "utf-8"} )

在文本分割阶段,系统会将文档切分成多个小片段,每个片段长度控制在500个字符左右,并设置一定的重叠区间(如50个字符)。这种分割方式确保了上下文的完整性,即使某些答案跨段落分布,也能在检索时保持语义连续性。

text_splitter = RecursiveCharacterTextSplitter(chunk_size=500, chunk_overlap=50) texts = text_splitter.split_documents(data)

5.2. 嵌入与存储

分割后的文本片段需要通过嵌入模型(如OpenAI Embeddings)转化为向量表示。嵌入模型会将文本映射到高维向量空间,其中相似的文本会具有更接近的向量表示。生成的向量存储在向量数据库(如Chroma)中。

在存储向量时,我们附加了文档的元信息(Metadata),包括:

-

文档来源(如文件名、路径)。

-

文档的哈希值(用于检测更新)。

元信息的存储是实现引用文本的关键,因为它允许我们在检索阶段返回片段的来源和内容。

embeddings = OpenAIEmbeddings(model="text-embedding-3-large", base_url="https://api.openai-hk.com/v1") vectorstore = Chroma.from_documents( documents=texts, embedding=embeddings, collection_name="book_demo", persist_directory="./chroma_db" )

5.3. 问题检索与答案生成

当用户输入问题时,系统首先会根据问题检索最相关的文本片段。这一阶段的目标是找到支持答案的上下文,而不是直接生成答案。LangChain中,检索模块通过向量相似度计算(如余弦相似度)完成这一任务。

检索到的上下文片段将与用户问题一起,作为输入提供给生成模型。一个精心设计的Prompt模板会引导生成模型利用上下文回答问题。例如:

上下文信息如下: --------------------- {context} --------------------- 请根据以上提供的上下文信息,不依赖其他外部知识,回答以下问题: 问题: {input} 答案:

在这个Prompt中,{context}是系统检索到的相关文档片段,而{input}是用户的问题。生成模型会在上下文的基础上,生成准确的答案。

def create_rag_chain(vectorstore, top_k=3): """创建RAG问答链 Args: vectorstore: 向量存储实例 top_k (int): 检索的文档数量 Returns: RetrievalChain: RAG链实例 """ llm = ChatOpenAI( model="gpt-4o-mini", temperature=0, base_url="https://api.openai-hk.com/v1" ) retriever = vectorstore.as_retriever(search_kwargs={"k": top_k}) PROMPT = PromptTemplate.from_template(""" 上下文信息如下 --------------------- {context} --------------------- 请根据以上提供的上下文信息,不依赖其他外部知识,回答以下问题 问题: {input} 答案: """) question_answer_chain = create_stuff_documents_chain(llm, PROMPT) return create_retrieval_chain(retriever, question_answer_chain)

5.4. 提供引用文本

除了最终答案,系统还会将检索到的上下文片段作为引用文本一并展示。例如,对于问题“菩提祖师身边有多少个人?”,系统可能会返回如下结果:

问题: 菩提祖师身边有多少个人?

答案: 菩提祖师身边有三十个小仙侍立台下。

引用文档:

-

Source 1:

text : 这猴王整衣端肃,随童子径入洞天深处观看:一层层深阁琼楼,一进进珠宫贝阙,说不尽那静室幽居,直至瑶台之下。见那菩提祖师端坐在台上,两边有三十个小仙侍立台下。果然是: 大觉金仙没垢姿,西方妙相祖菩提; 不生不灭三三行,全气全神万万慈。 空寂自然随变化,真如本性任为之…

file_hash : 2545120aa977ff5dddc91f4cdabc808e

source : …\data\xiyouji\西游记第一回.txt

-

Source 2:

text: “…”

这种引用形式不仅让用户知道答案的来源,还能验证答案是否准确。如果答案不够明确,用户可以直接查阅引用文档的全文。

`for i, doc in enumerate(response["context"]): print(f"\nSource {i+1}:") print(f" text: {clip_text(doc.page_content, threshold=350)}") for key in doc.metadata: if key != "pk": val = doc.metadata.get(key) clipped_val = clip_text(val) if isinstance(val, str) else val print(f" {key}: {clipped_val}")`

6. 应用场景

支持引用文本的RAG系统在以下领域有着广泛的应用前景:

-

企业知识管理:帮助企业员工快速查询内部文档,同时提供引用内容便于验证。

-

法律咨询:在生成法律建议的同时,附上相关法规或案例的引用文本。

-

学术研究:支持研究人员检索论文片段,回答问题并标明来源。

-

医疗问答:提供医学知识回答的同时,附加权威文献或指南内容。

实现一个支持引用文本的RAG系统不仅能够动态整合外部知识库,还可以在生成答案的同时提供引用文本,从而显著增强答案的可信度和可解释性。

这一能力使得RAG系统在知识密集型领域大有可为。未来,系统可以进一步扩展系统功能,例如支持多模态数据(如图像、表格)或实时抓取外部信息,为用户提供更全面的智能服务。

如何学习AI大模型 ?

“最先掌握AI的人,将会比较晚掌握AI的人有竞争优势”。

这句话,放在计算机、互联网、移动互联网的开局时期,都是一样的道理。

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。【保证100%免费】🆓

优快云粉丝独家福利

这份完整版的 AI 大模型学习资料已经上传优快云,朋友们如果需要可以扫描下方二维码&点击下方优快云官方认证链接免费领取 【保证100%免费】

读者福利: 👉👉优快云大礼包:《最新AI大模型学习资源包》免费分享 👈👈

对于0基础小白入门:

如果你是零基础小白,想快速入门大模型是可以考虑的。

一方面是学习时间相对较短,学习内容更全面更集中。

二方面是可以根据这些资料规划好学习计划和方向。

👉1.大模型入门学习思维导图👈

要学习一门新的技术,作为新手一定要先学习成长路线图,方向不对,努力白费。

对于从来没有接触过AI大模型的同学,我们帮你准备了详细的学习成长路线图&学习规划。可以说是最科学最系统的学习路线,大家跟着这个大的方向学习准没问题。(全套教程文末领取哈)

👉2.AGI大模型配套视频👈

很多朋友都不喜欢晦涩的文字,我也为大家准备了视频教程,每个章节都是当前板块的精华浓缩。

👉3.大模型实际应用报告合集👈

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。(全套教程文末领取哈)

👉4.大模型落地应用案例PPT👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。(全套教程文末领取哈)

👉5.大模型经典学习电子书👈

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。(全套教程文末领取哈)

👉6.大模型面试题&答案👈

截至目前大模型已经超过200个,在大模型纵横的时代,不仅大模型技术越来越卷,就连大模型相关的岗位和面试也开始越来越卷了。为了让大家更容易上车大模型算法赛道,我总结了大模型常考的面试题。(全套教程文末领取哈)

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习

优快云粉丝独家福利

这份完整版的 AI 大模型学习资料已经上传优快云,朋友们如果需要可以扫描下方二维码&点击下方优快云官方认证链接免费领取 【保证100%免费】

读者福利: 👉👉优快云大礼包:《最新AI大模型学习资源包》免费分享 👈👈

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?