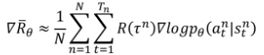

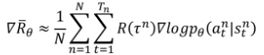

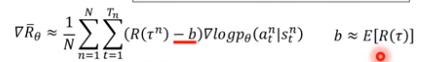

Policy gradient:

求解梯度trick:

∇fx=f(x)∇logf(x)![]()

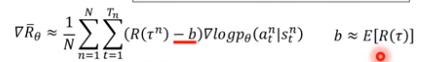

Tip1:将回报值的期望作为基线,使得每次计算的回报有正负区别

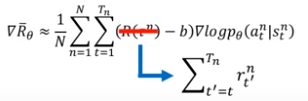

Tip2:不将整场游戏得到的reward作为权重,为每个动作分配应有的权重,权重即为从当前时间t开始所有reward的累加

改进:增加折扣

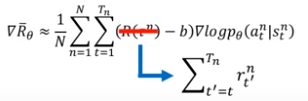

Policy gradient:

求解梯度trick:

∇fx=f(x)∇logf(x)![]()

Tip1:将回报值的期望作为基线,使得每次计算的回报有正负区别

Tip2:不将整场游戏得到的reward作为权重,为每个动作分配应有的权重,权重即为从当前时间t开始所有reward的累加

改进:增加折扣

1053

1053

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?