Introduction

当DeepMind提出一种在ATARI游戏中达到超人级别的算法时,Q-learning成为数据科学中的家喻户晓的名字。 它是强化学习(RL)的核心组成部分之一。 每当我读到RL时,我经常会遇到Q-learning。

但是,Q学习与我们的时差学习主题有什么关系呢? 让我举一个例子来说明时间差异学习是什么。

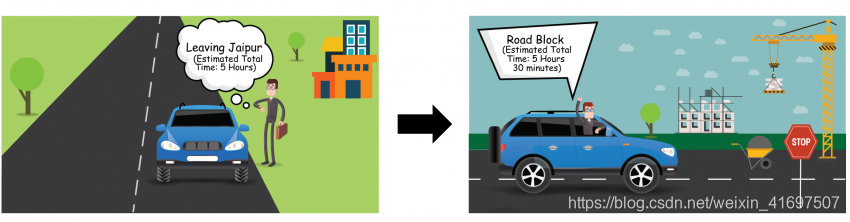

Rajesh计划在他的车里从德里前往斋浦尔。 快速查看Google地图会显示他估计需要5个小时。 不幸的是,由于路障造成了意外的延误(长途旅行的任何人都可能与此有关!)。 Rajesh的预计到达时间现在可以达到5小时30分钟。

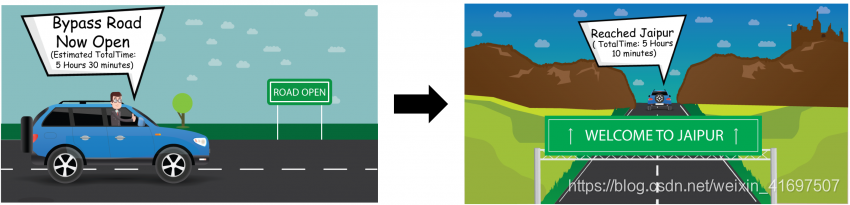

在旅途中途,他找到了一个减少他到达时间的旁路。 总的来说,他从德里到斋浦尔的旅程需要5小时10分钟。

您是否注意到Rajesh的到达时间如何根据不同剧集不断变化和更新? 简而言之,这说明了时间差异学习概念。 在本文中,我将向您详细介绍此算法及其组件,包括Q-learning如何适应图片。 我们还将选择一个案例研究并用Python解决它。

这是最有趣的强化学习概念之一,所以让我们学习这个很有趣!

本文深入浅出地介绍了强化学习中的时间差异(TD)学习,包括TD预测的直观解释和Q-learning、SARSA两种算法。通过Frozen Lake示例,展示了TD预测如何工作,接着探讨了非策略学习的Q-learning与策略学习的SARSA算法的差异。最后,通过Python案例研究展示了Q-learning在出租车调度问题中的应用。

本文深入浅出地介绍了强化学习中的时间差异(TD)学习,包括TD预测的直观解释和Q-learning、SARSA两种算法。通过Frozen Lake示例,展示了TD预测如何工作,接着探讨了非策略学习的Q-learning与策略学习的SARSA算法的差异。最后,通过Python案例研究展示了Q-learning在出租车调度问题中的应用。

订阅专栏 解锁全文

订阅专栏 解锁全文

2061

2061

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?