论文标题:iCROSSFORMER : TRANSFORMER UTILIZING CROSS DIMENSION DEPENDENCY FOR MULTIVARIATE TIME SERIES FORECASTING

开源代码:https://github.com/Thinklab-SJTU/Crossformer

前言

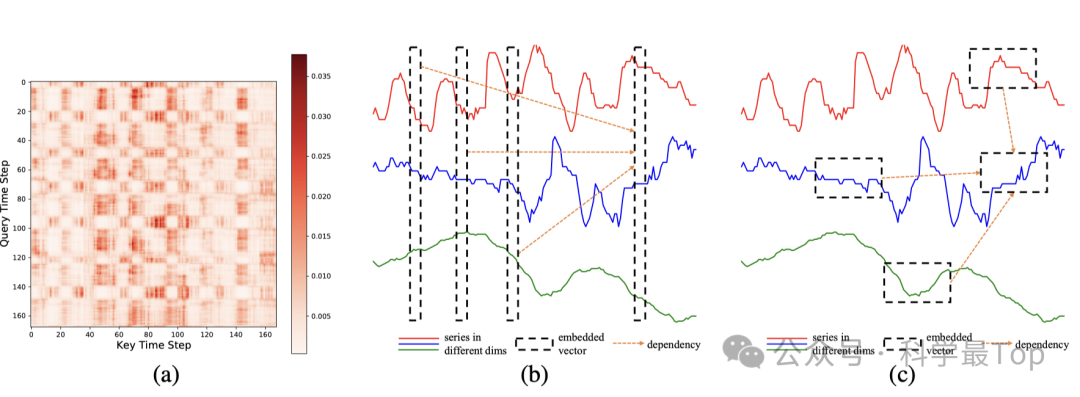

Crossformer是一篇非常典型的在transformer基础上魔改注意力机制的文章,这虽然现在时间序列中的多尺度、注意力基本已经做到头了,但是作为一篇学习论文,质量很高,值得阅读。另外,这篇文章也算是为patch找到了依据。Transformer的核心之一是注意力机制,而基础Transformer时序预测的注意力机制主要建模同一变量不同时刻的相关性(文中称跨时间依赖,如下图b),却忽视了不同变量之间的依赖性(文中称之为跨维度依赖,如下图c)。为了填补这一空缺,本文提出了 Crossformer,利用跨维度依赖性进行多变量时序预测。

图1

Crossformer 中,输入多维变量通过DSW(Dimension-Segment-Wise )过程嵌入为2D向量数组,保留时间和维度信

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1506

1506

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?