本期为大家介绍如何通过Ollama部署本地大模型,Dify如何接入Ollama部署的本地大模型,以及脱离Dify如何方便使用大模型。

本期具体内容包括1.Ollama下载安装、2.大模型部署(以deepseek为例)、3.Dify接入本地大模型、4.通过chatbox使用本地大模型(额外内容)。如果只想本地部署大模型可以只看1、2,如果想要通过Dify接入本地大模型可以看1、2、3,如果想脱离Dify直接方便的使用本地大模型可以看1、2、4。

1、Ollama下载安装

大模型的本地部署方式有很多,可以直接部署,也可以借助其他工具进行部署,为了方便使用和管理,通常是借助其他工具进行部署,例如Ollama或者LM Studio,相比于LM Studio,Ollama下载模型方便且兼容性好,但是安装会稍微麻烦一点而且没有界面,不过这些都好解决。

首先进入Ollama的官网https://ollama.com/,然后点击Download即可,这一步可能需要挂vpn,否则会访问不了,不过也不用担心,我已经把安装包放到了网盘,私信回复“1235”可以获取。

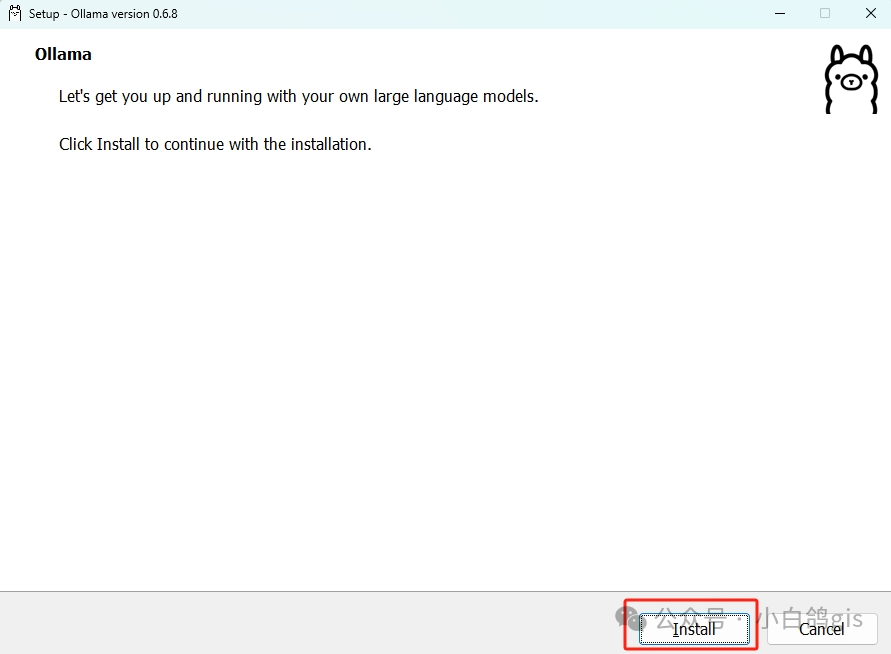

下载好后,打开安装包即可安装,对于Windows用户来说一路点击下一步就好了,Ollama默认是安装到C盘,如果想迁移到其他路径可以期待下一期文章。

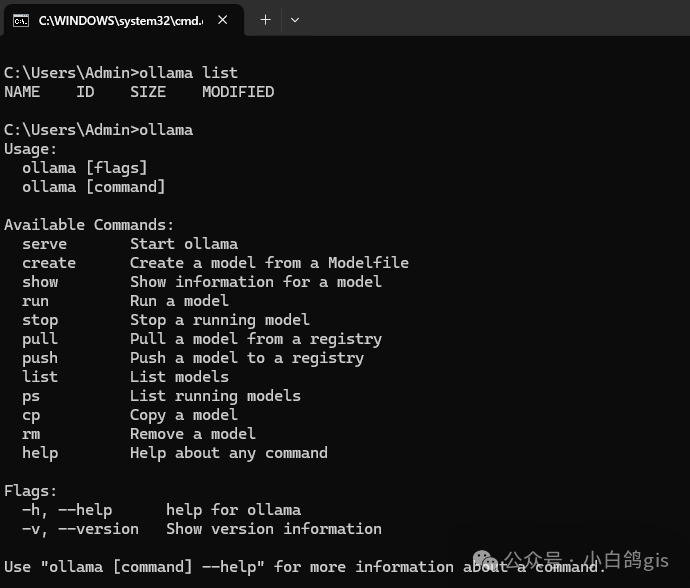

安装完成之后可以进行一下验证,打开cmd,输入ollama,如果像下面这样显示即表示安装成功了。

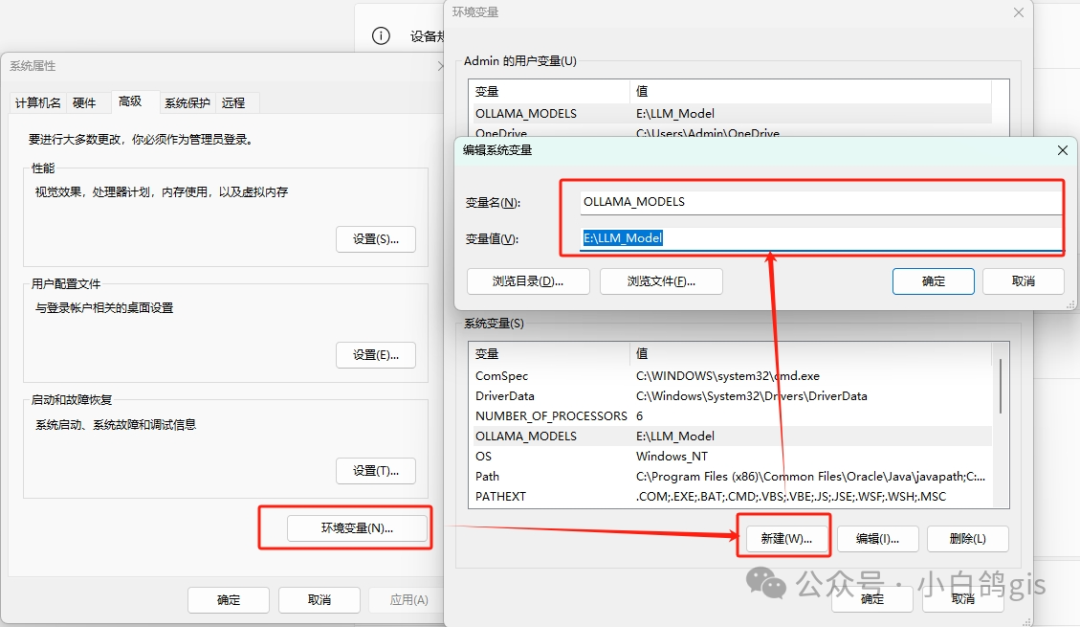

安装成功后可以在系统变量设置一下模型的下载路径,在桌面找到“此电脑”,右键“属性”,然后点击“高级系统设置”,找到“环境变量”,在系统变量下点击“新建”,在变量名输入“OLLAMA_MODELS”,在变量值输入自己想放置模型的路径。

重启一下Ollama,注意一定要重启,否则环境配置不生效,下载的模型还是默认在C盘。

2、大模型部署(以deepseek为例)

安装完Ollama后,即可依托Ollama进行大模型的部署,此处有两种办法,一种是在线安装,直接在Ollama的模型库里找,然后通过命令安装,Ollama会自动下载并部署模型;另一种是离线安装,离线安装是指从其他资源网站下载好模型(.gguf文件),例如从hugging face上下载模型,然后通过modlefile文件进行安装。此处以在线安装作为示例。

首先进入Ollama官网,点击Models,进入模型资源库。

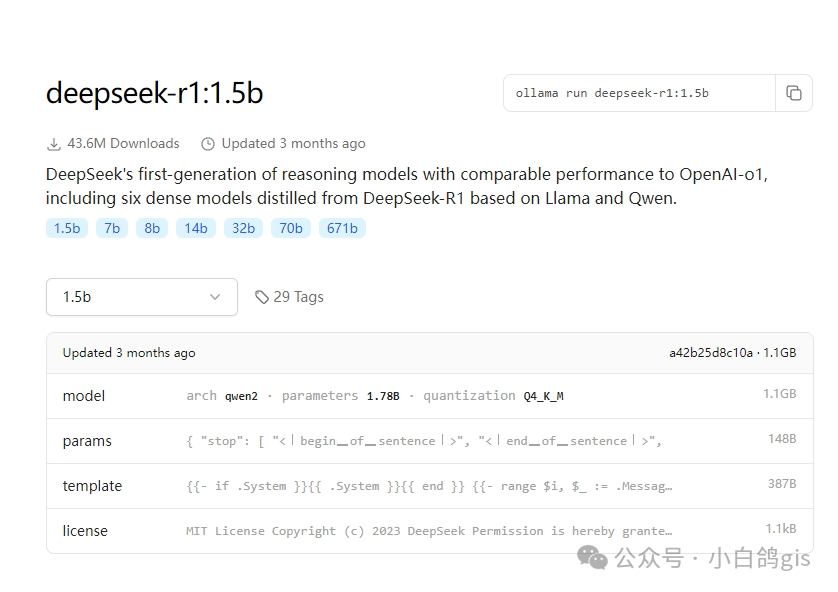

随便选择一个模型,此处以deepseek-r1:1.5b为例,注意名称一定要和官网名称一致。

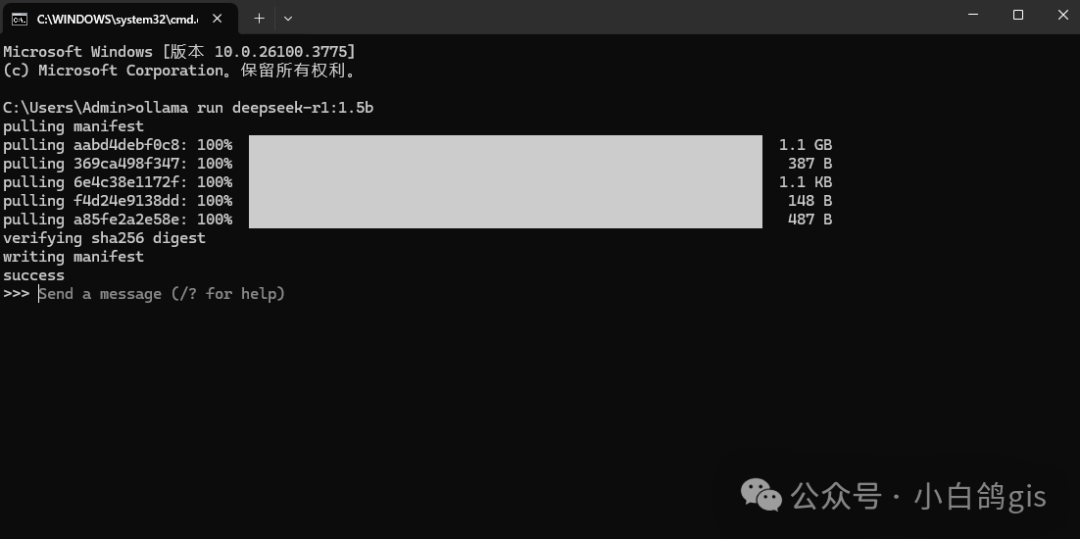

打开cmd,输入ollama run deepseek-r1:1.5b,即开始自动拉取模型,等待完成即可。

完成后即可开始对话,此时由于ollama没有界面,所以只能通过cmd进行对话。

后续可以通过打开cmd,输入ollama run 模型名称 使用,如果不清楚已经安装的模型具体名称,可以输入 ollama list 查看。

第3步将介绍怎么在Dify中接入和使用本地大模型,第4步将介绍通过chatbox在可视化的界面中使用大模型。

3、Dify接入本地大模型

完成大模型的本地部署后,暂时还不能在Dify中使用,还需要进行一些配置。

注:Dify的安装可以查看上一期文章

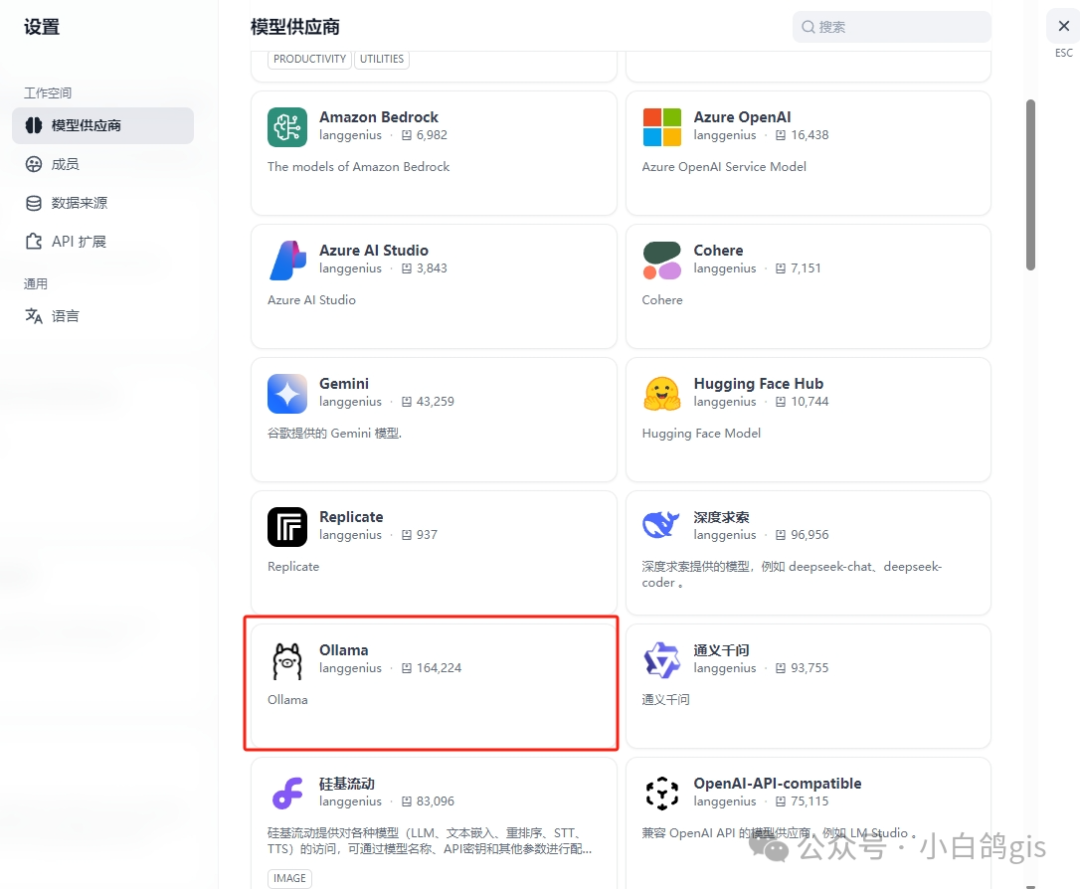

首先,打开浏览器,输入http://localhost/apps进入Dify,点击页面右上角头像的设置,在模型供应商中找到Ollama并点击安装。

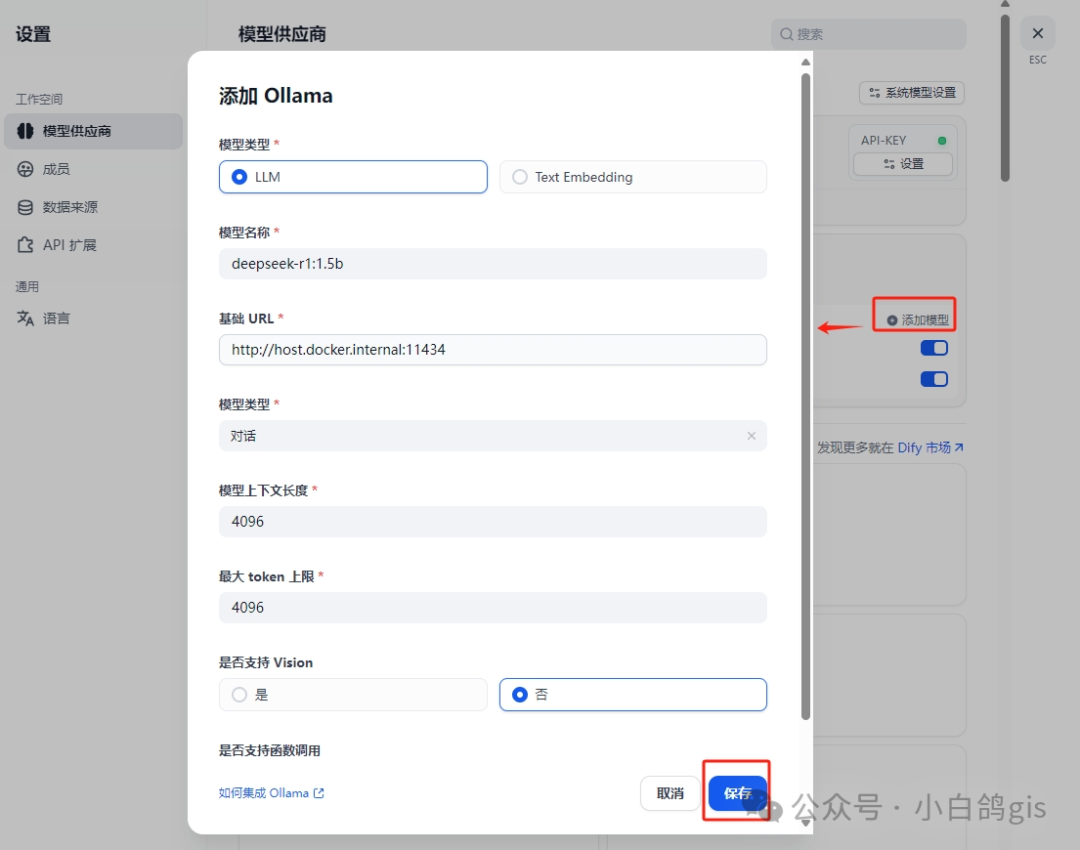

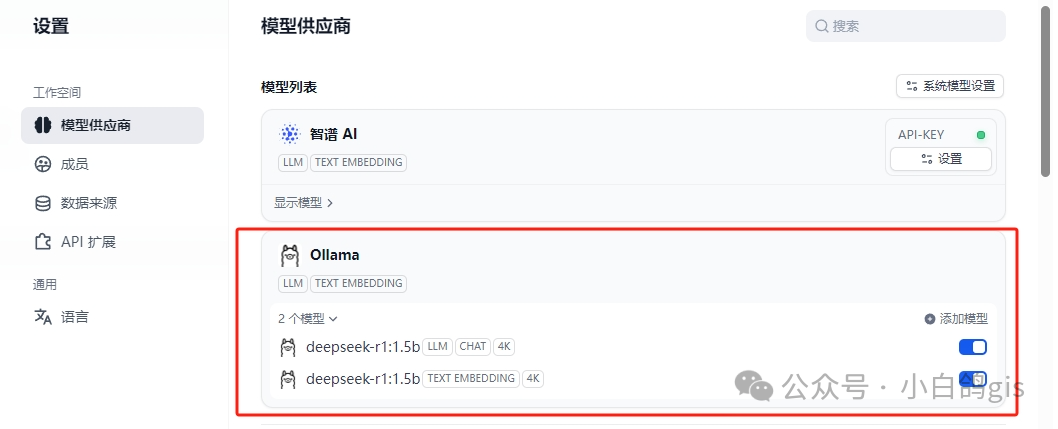

等待安装完成后进行模型配置,此处配置包括两部分,一个是LLM模型配置,所谓LLM即是大语言模型,此处可以是deepseek的模型也可以是chatgpt的模型或者是其他模型,其主要作用就是对话;另一个是Text Embedding模型,也叫文本嵌入模型,它是应用于知识库的模型,其主要功能是把知识库中的文本转换成向量,因为计算机无法直接理解自然语言,但是当把自然语言转换成向量之后,就可以通过数学的方式去进行理解和计算,例如你输入一个问题,从知识库中获得结果,本质就是把问题转换成向量并在知识库中检索和问题相似度最高的向量。此处可以用deepseek-r1模型进行配置,也可以使用其他专门的模型进行配置。

在模型名称中填写上一步下载的模型,如果不知道模型名称可以打开cmd,输入ollama list查看已经安装的模型。基础URL代表的是Ollama 服务地址,Ollama是默认暴露11434端口进行API调用,如果Dify是通过Docker部署的话,在基础URL中填入http://host.docker.internal:11434即可,如果是其他方式部署的Dify,可以参考帮助文档:https://docs.dify.ai/zh-hans/development/models-integration/ollama。剩余参数保持默认即可。最后点击保存

如果保存按钮变成灰色并且迟迟没有保存成功,可以参考一下步骤重新启动Dify的Docker服务以及重新启动大模型。

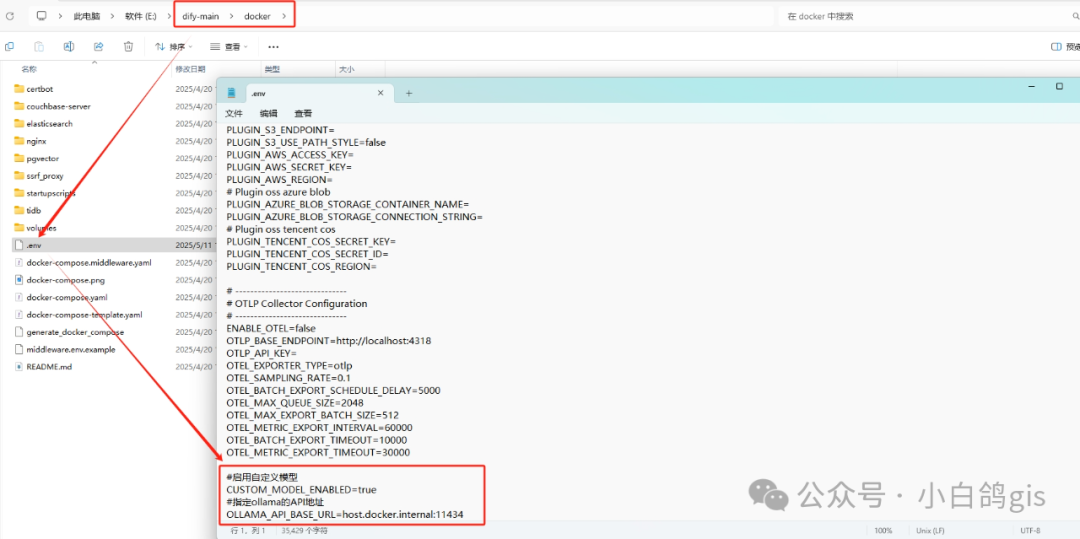

进入到Dify的工程文件,找到docker文件夹里的.env文件,用记事本打开,并在最后添加以下内容:

#启用自定义模型

CUSTOM_MODEL_ENABLED=true

#指定ollama的API地址

OLLAMA_API_BASE_URL=host.docker.internal:11434

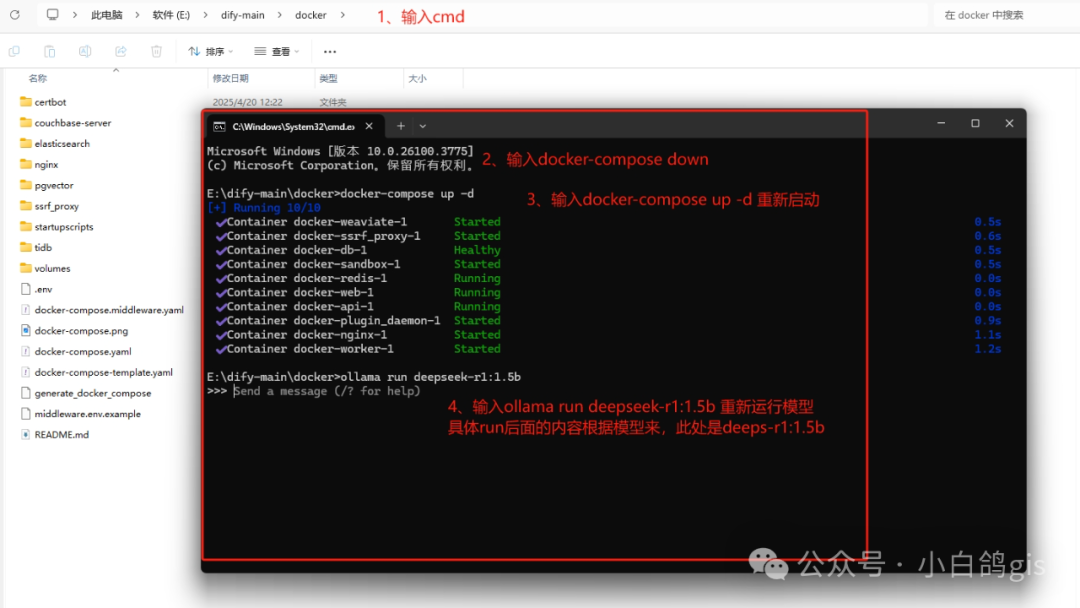

按照下图步骤重启docker服务,并且运行模型

完成配置后可以看到两个模型都处于开启状态,此时即可在Dify中使用本地大模型。

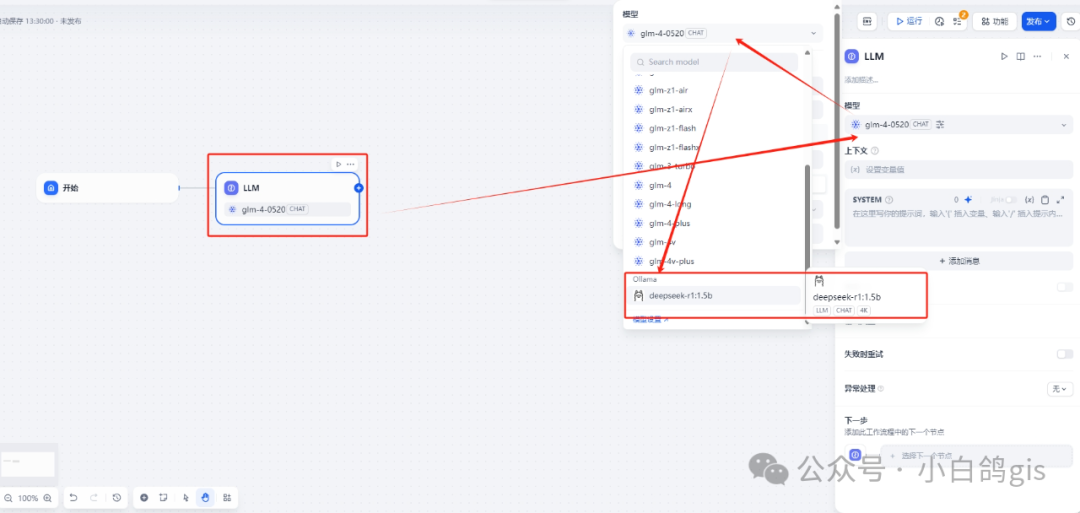

回到Dify的工作空间,在“工作室”中创建空白应用,此处以工作流为例,点击工作流,输入名称和描述创建。

在工作流中添加LLM节点,点击节点可以在右侧进行配置,点击模型可以切换为刚才安装的deepseek-r1:1.5b模型

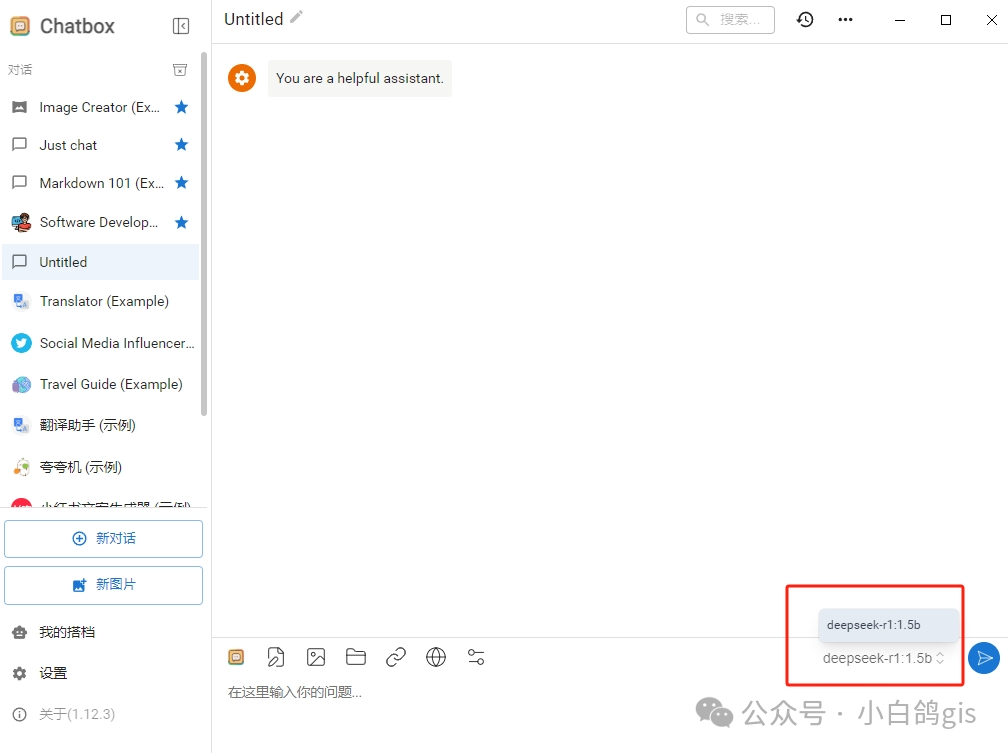

4、通过chatbox使用本地大模型

仅通过Ollama部署的本地大模型如果不借助其他工具只能在cmd中进行对话使用,如果想在可视化的界面中使用本地大模型,可以考虑使用chatbox这类的AI客户端,chatbox的优点在于轻量化和高性能。

首先进入官网https://chatboxai.app/zh?ref=tian 下载chatbox,下载完成后一路点击下一步即可安装。

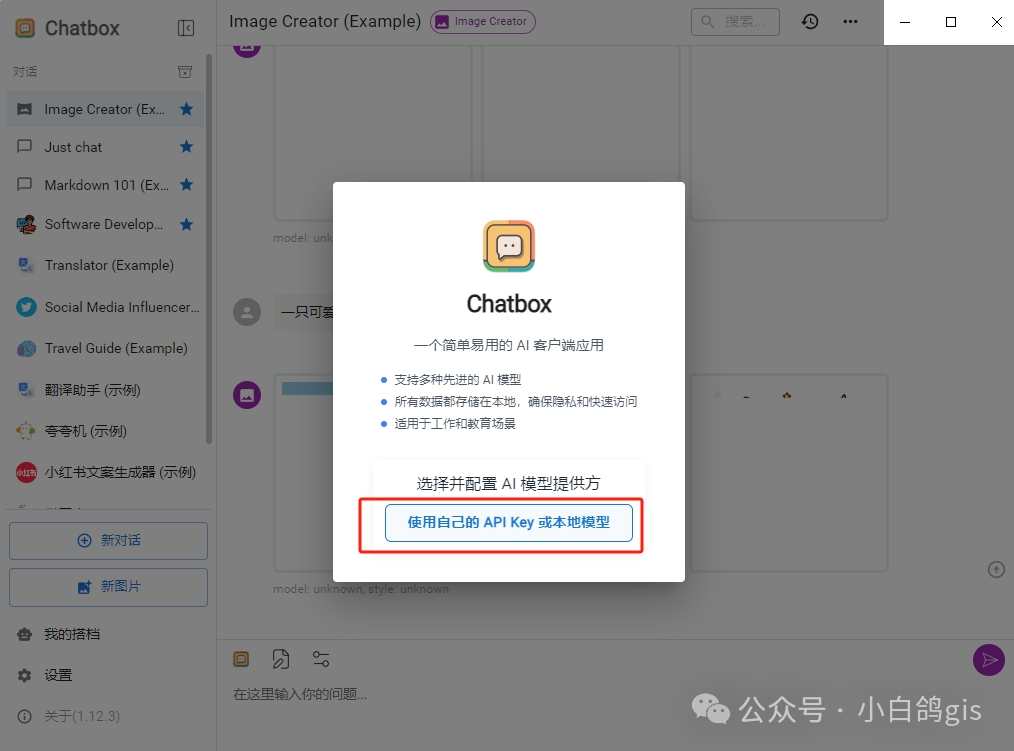

安装完成后打开软件,会弹出提示框,选择使用自己的API Key或本地模型,或者可以点击设置进入配置界面。

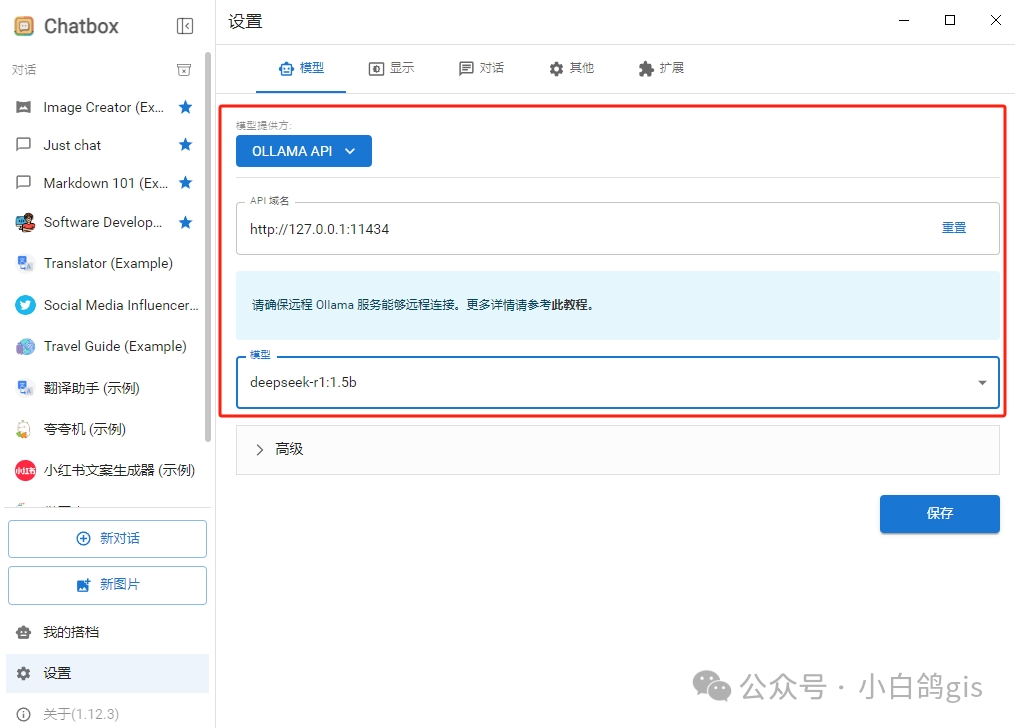

在模型栏填入API域名和模型名称,点击保存。

注意:配置前需要先启动Ollama并运行模型。

新建一个对话,此时可以看到配置的模型已经成功应用了。

后话

先运行模型: 无论是在Dify还是在chatbox中使用本地大模型,都需要先运行模型,运行方法是 ollama run 模型名称。

本期挖坑: 本期提到了ollama默认路径迁移和离线安装模型,由于篇幅原因没有展开,后续内容中会补齐。

如何零基础入门 / 学习AI大模型?

大模型时代,火爆出圈的LLM大模型让程序员们开始重新评估自己的本领。 “AI会取代那些行业?”“谁的饭碗又将不保了?”等问题热议不断。

不如成为「掌握AI工具的技术人」,毕竟AI时代,谁先尝试,谁就能占得先机!

想正式转到一些新兴的 AI 行业,不仅需要系统的学习AI大模型。同时也要跟已有的技能结合,辅助编程提效,或上手实操应用,增加自己的职场竞争力。

但是LLM相关的内容很多,现在网上的老课程老教材关于LLM又太少。所以现在小白入门就只能靠自学,学习成本和门槛很高

那么我作为一名热心肠的互联网老兵,我意识到有很多经验和知识值得分享给大家,希望可以帮助到更多学习大模型的人!至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

👉 福利来袭优快云大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

全套AGI大模型学习大纲+路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉 福利来袭优快云大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

3932

3932

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?