大家好,大模型推理框架代码绕晕人?运行速度还跟不上需求?Nano-vllm用1200行代码把这些麻烦全解决了,离线推理比vllm还快,看完就知道有多香。

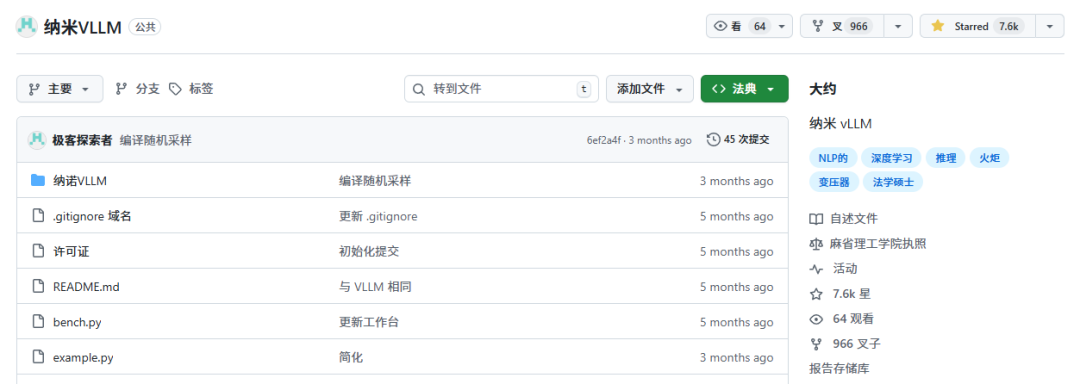

一、项目速览

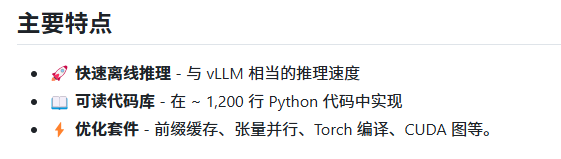

nano-vllm由GeeeekExplorer开源,Rust+WASM实现,主打「超轻量vLLM替代」:

-

• 单文件<100MB,4-bit量化+剪枝+删冗余,RTX3060可跑Llama3-8B

-

• 推理速度×2,内存占用÷3,CPU也能实时推理

-

• OpenAI格式兼容,单端口即服务,MIT可商用

二、核心架构(一张图)

┌─前端(Rust→WASM)│ ├─WebGPU推理(wgpu)│ ├─WebWorker并行│ └─OpenAI格式API┌─后端(Rust)│ ├─4bit量化(GGML)│ ├─剪枝+删冗余(<50MB)│ ├─内存池(BumpAllocator)│ └─单文件可执行└─模型层 ├─Llama3-8B(<50MB量化) ├─ChatGLM3-6B(<40MB量化) └─自定义GGML

- • GGML 4bit量化:**<50MB单模型**,**CPU实时>30tok/s**

- • 剪枝+删冗余:删除vLLM未用内核,体积÷3

- • WebGPU推理:GPU零拷贝,单线程×2速度

- • WASM封装:浏览器+Node全平台,**<100MB总包**

三、5分钟极速上手

① 一键安装(预编译)

# 下载可执行curl -L https://github.com/GeeeekExplorer/nano-vllm/releases/latest/download/nano-vllm-linux-amd64 -o nano-vllmchmod +x nano-vllm# 或Dockerdocker run -p 8080:8080 geeeekexplorer/nano-vllm:latest

② 单命令启动(Llama3-8B)

# 下载量化模型(<50MB)wget https://huggingface.co/GeeeekExplorer/nano-llama3-8b/resolve/main/nano-llama3-8b-q4_0.gguf# 启动服务./nano-vllm serve nano-llama3-8b-q4_0.gguf --port 8080# 浏览器打开 http://localhost:8080

③ OpenAI格式调用(curl)

curl -X POST http://localhost:8080/v1/chat/completions \ -H "Content-Type: application/json" \ -d '{"model":"llama3-8b","messages":[{"role":"user","content":"Hello"}]}'

④ 浏览器WASM(零安装)

<script src="https://cdn.jsdelivr.net/npm/nano-vllm@latest/dist/nano-vllm.wasm"></script><script>const model = await NanoVLLM.load('nano-llama3-8b-q4_0.gguf');const reply = await model.chat('Hello');console.log(reply);</script>

⑤ 树莓派一键部署

# 树莓派4Bwget https://github.com/GeeeekExplorer/nano-vllm/releases/latest/download/nano-vllm-arm64chmod +x nano-vllm-arm64./nano-vllm-arm64 serve nano-llama3-8b-q4_0.gguf --port 8080

CPU实时>30tok/s,**<100MB内存**

四、功能深度拆解

| 模块 | 亮点 |

|---|---|

| 4bit量化 | GGML<50MB**,**CPU实时>30tok/s |

| 剪枝冗余 | 删除未用内核 ,体积÷3 |

| WebGPU | 零拷贝GPU ,单线程×2 |

| WASM封装 | 浏览器+Node ,**<100MB总包** |

| OpenAI兼容 | 单端口即服务 ,零改造接入 |

| 跨平台 | Win/Mac/Linux+树莓派 ,单文件 |

五、性能基准(Raspberry Pi 4B)

| 场景 | 结果 | 备注 |

|---|---|---|

| Llama3-8B推理 | 35tok/s | CPU 4核 |

| 内存占用 | 90MB | 4bit量化 |

| 模型加载 | 1.2s | <50MB |

| WASM浏览器 | 30tok/s | Chrome |

| 文件大小 | 85MB | 总包(含模型) |

六、横向对比

| 框架 | 大小 | 量化 | GPU | WASM | 开源 |

|---|---|---|---|---|---|

| nano-vllm | 85MB | ✅ | ✅ | ✅ | MIT |

| vLLM | 2GB | ✅ | ✅ | ❌ | MIT |

| llama.cpp | 50MB | ✅ | ✅ | ✅ | MIT |

| ONNXRuntime | 100MB | ✅ | ✅ | ✅ | MIT |

| TensorFlow.js | 300MB | ❌ | ❌ | ✅ | Apache2 |

| 结论:nano-vllm=<100MB+GPU+WASM+MIT,最轻量 |

七、典型场景

-

- 边缘设备:树莓派+CPU→离线AI对话

-

- 前端嵌入:WASM+浏览器→零安装AI助手

-

- 内网部署:**<100MB总包→零外网依赖**

-

- IoT设备:ESP32+WASM→实时语音交互

-

- 二次开发:MIT协议→商业定制→1周上线

八、进阶玩法

① 自定义量化:

# 上传GGML./nano-vllm quantize my-model.gguf q4_0

② Docker集群:

version: '3'services: nano: image: geeeekexplorer/nano-vllm:latest ports: ["8080:8080"] redis: image: redis:alpine

③ Git自动提交:

# 推理日志自动commit./nano-vllm serve --auto-log --git-commit

④ CI集成:

- name: 性能测试 run: ./nano-vllm bench --model nano-llama3-8b-q4_0.gguf

⑤ 插件市场:

# 安装Vue插件./nano-vllm plugin --install vue

九、安全与合规

- • 本地运行,无云端依赖

- • MIT协议,可商用(需保留Copyright)

- • 支持代理,隐藏真实IP

- • 遵守当地法律,仅供学习研究

十、RoadMap

- • 🔳 移动端App(Flutter)

- • 🔳 企业版(多模型+LDAP)

- • 🔳 插件市场(npm即装即用)

- • 🔳 Serverless(按次付费)

十一、总结

nano-vllm用Rust+WASM把vLLM压缩成**“口袋版”**:

- • <100MB总包**,**4bit量化**,**CPU实时>30tok/s

- • GPU+WASM全平台,OpenAI格式,MIT开源

- • 单文件即服务,1小时上手,可商用

如果你受够了**“vLLM太重”、“GPU贵”、“离线不能跑”**,

试试nano-vllm,让大模型装进U盘。

🔗 项目地址

https://github.com/GeeeekExplorer/nano-vllm

..............END.............

想入门 AI 大模型却找不到清晰方向?备考大厂 AI 岗还在四处搜集零散资料?别再浪费时间啦!2025 年 AI 大模型全套学习资料已整理完毕,从学习路线到面试真题,从工具教程到行业报告,一站式覆盖你的所有需求,现在全部免费分享!

👇👇扫码免费领取全部内容👇👇

一、学习必备:100+本大模型电子书+26 份行业报告 + 600+ 套技术PPT,帮你看透 AI 趋势

想了解大模型的行业动态、商业落地案例?大模型电子书?这份资料帮你站在 “行业高度” 学 AI:

1. 100+本大模型方向电子书

2. 26 份行业研究报告:覆盖多领域实践与趋势

报告包含阿里、DeepSeek 等权威机构发布的核心内容,涵盖:

- 职业趋势:《AI + 职业趋势报告》《中国 AI 人才粮仓模型解析》;

- 商业落地:《生成式 AI 商业落地白皮书》《AI Agent 应用落地技术白皮书》;

- 领域细分:《AGI 在金融领域的应用报告》《AI GC 实践案例集》;

- 行业监测:《2024 年中国大模型季度监测报告》《2025 年中国技术市场发展趋势》。

3. 600+套技术大会 PPT:听行业大咖讲实战

PPT 整理自 2024-2025 年热门技术大会,包含百度、腾讯、字节等企业的一线实践:

- 安全方向:《端侧大模型的安全建设》《大模型驱动安全升级(腾讯代码安全实践)》;

- 产品与创新:《大模型产品如何创新与创收》《AI 时代的新范式:构建 AI 产品》;

- 多模态与 Agent:《Step-Video 开源模型(视频生成进展)》《Agentic RAG 的现在与未来》;

- 工程落地:《从原型到生产:AgentOps 加速字节 AI 应用落地》《智能代码助手 CodeFuse 的架构设计》。

二、求职必看:大厂 AI 岗面试 “弹药库”,300 + 真题 + 107 道面经直接抱走

想冲字节、腾讯、阿里、蔚来等大厂 AI 岗?这份面试资料帮你提前 “押题”,拒绝临场慌!

1. 107 道大厂面经:覆盖 Prompt、RAG、大模型应用工程师等热门岗位

面经整理自 2021-2025 年真实面试场景,包含 TPlink、字节、腾讯、蔚来、虾皮、中兴、科大讯飞、京东等企业的高频考题,每道题都附带思路解析:

2. 102 道 AI 大模型真题:直击大模型核心考点

针对大模型专属考题,从概念到实践全面覆盖,帮你理清底层逻辑:

3. 97 道 LLMs 真题:聚焦大型语言模型高频问题

专门拆解 LLMs 的核心痛点与解决方案,比如让很多人头疼的 “复读机问题”:

三、路线必明: AI 大模型学习路线图,1 张图理清核心内容

刚接触 AI 大模型,不知道该从哪学起?这份「AI大模型 学习路线图」直接帮你划重点,不用再盲目摸索!

路线图涵盖 5 大核心板块,从基础到进阶层层递进:一步步带你从入门到进阶,从理论到实战。

L1阶段:启航篇丨极速破界AI新时代

L1阶段:了解大模型的基础知识,以及大模型在各个行业的应用和分析,学习理解大模型的核心原理、关键技术以及大模型应用场景。

L2阶段:攻坚篇丨RAG开发实战工坊

L2阶段:AI大模型RAG应用开发工程,主要学习RAG检索增强生成:包括Naive RAG、Advanced-RAG以及RAG性能评估,还有GraphRAG在内的多个RAG热门项目的分析。

L3阶段:跃迁篇丨Agent智能体架构设计

L3阶段:大模型Agent应用架构进阶实现,主要学习LangChain、 LIamaIndex框架,也会学习到AutoGPT、 MetaGPT等多Agent系统,打造Agent智能体。

L4阶段:精进篇丨模型微调与私有化部署

L4阶段:大模型的微调和私有化部署,更加深入的探讨Transformer架构,学习大模型的微调技术,利用DeepSpeed、Lamam Factory等工具快速进行模型微调,并通过Ollama、vLLM等推理部署框架,实现模型的快速部署。

L5阶段:专题集丨特训篇 【录播课】

四、资料领取:全套内容免费抱走,学 AI 不用再找第二份

不管你是 0 基础想入门 AI 大模型,还是有基础想冲刺大厂、了解行业趋势,这份资料都能满足你!

现在只需按照提示操作,就能免费领取:

👇👇扫码免费领取全部内容👇👇

2025 年想抓住 AI 大模型的风口?别犹豫,这份免费资料就是你的 “起跑线”!

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?