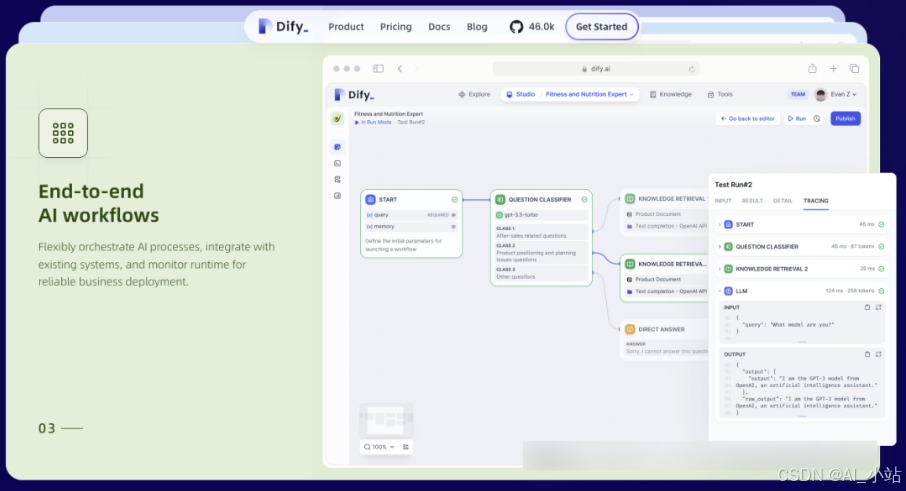

今天带来的是AIAgent 的另外一个流派,可以支持本地化部署的开源 AIAgent 平台Dify。

Dify 是一个开源的 LLMOps(大语言模型运营)平台,它允许开发者能够在本地快速创建和部署 AI 应用。

Dify 和 Coze 类似,也是通过可视化的方式进行 AI 应用构建,而且支持多种大语言模型,包含 GPT-3.5 、 GPT-4 等,同时,Dify 的另外一大优势是能接入本地化部署的大语言模型。

在应用提供上,Dify 还提供了API 接口,可以让用户非常方便的将 AI 应用集成到其他系统。在 Dify 内,还内置了数据集管理和大模型微调功能,在本地知识库管理和配置上,比 Coze 还多了保密和私有化应用的优势。

对于AI 应用的初学者,Dify 平台的使用可以让大家更加深入了解 AI 平台的工作原理,同时,提供了将想法快速转变成 MVP 应用实践的渠道。

那么,如何进行 Dify 的本地化部署,我这里边整理边同步给大家。

简单说一下我的电脑配置:MacBookAir M1 芯片,8G+512G;

当然,如果您不想自己部署,只想体验一下,官方提供了一定的免费额度,不过额度有限,文档上传限制了 50 个,而且 RAG 的向量空间也只有 5MB 。

在线体验地址:https://dify.ai/

1-安装 Docker

先安装Docker ,Docker 是一个开源的应用容器引擎,它允许开发者打包应用以及应用的依赖环境到一个可移植的容器中。

大白话理解就是, Docker 就像一辆房车,你生活所需要的所有物品(和它需要的东西)都装进这台房车中。这样,无论你开车到哪里(不管在哪个电脑上),你都能正常的生活(软件就能正常工作)。

打开 Docker 官网(https://www.docker.com/),根据你的操作系统下载对应的安装包,然后傻瓜式无脑安装即可。

2-Dify 私有化部署

接下来,看一下如何本地化部署。

先提供必要信息:

开源地址:https://github.com/langgenius/dify

官方文档:https://docs.dify.ai/v/zh-hans

将 dify 的源码克隆到本地。

1 、打开应用台,输入 Terminal

2 、输入这段指令:git clone https://github.com/langgenius/dify.git

3-打开 Dify

完成后,进入 Docker 目录。在刚才打开的 Terminal 内输入以下指令。

然后,在你的 Docker 里,你就能看到这样的目录。

在你的浏览里里输入http://localhost,就能看到这样的界面:

第一次登录,设置一下管理员账号。完成设置后,浏览器会自动跳转到登录页面,输入用户名和密码就能进入Dify 工作台。

4-创建第一个 Dify Agent

Dify 的创建应用类型包含聊天助手、 Agent 和工作流。创作应用的方式,可以直接创建一个空白应用,也可以从应用模板力创建,或者获取到其他大佬已经创建好的 Dify 文件,直接导入。

我个人总结出来的学习方法,可以直接从别人的模板开始入手,能够了解 Dify 工作流的主要构成,先有了宏观架构,再进行探索。

这里,我选择了从应用模板创建工作流,选择了一个“问题分类-知识-聊天机器人”模板。

如果是已经玩过 Coze 的同学,看到这个界面,会非常的熟悉。

接下来,配置 LLM 大模型。

点击右上角的个人账户下的“设置”。

然后点击左侧工作空间的“模型供应商”。

可以看到,Dify 支持非常丰富的大模型(这点比 Coze.cn 好)。

除了支持海外的大模型,Dify 几乎都能接入国内的大模型。包含讯飞星火、通义千问、文心一言,还有我特别喜欢的 Kimi 。

接下来,看一下如何配置大模型,以 kimi为例。

到 kimi 的 api key 页面找到你的 key ,地址:https://platform.moonshot.cn/console/info。

拷贝完成后,贴到这里来。

回到工作流模板中,将 ChatGPT3.5 替换成刚才配置好的 kimi 。

测试一下工作流能否正常执行。

好的,到这里,Dify 的本地化部署完成了。可以开始您的 Dify 之旅了。

Enjoy it, have fun!

如何学习大模型

现在社会上大模型越来越普及了,已经有很多人都想往这里面扎,但是却找不到适合的方法去学习。

作为一名资深码农,初入大模型时也吃了很多亏,踩了无数坑。现在我想把我的经验和知识分享给你们,帮助你们学习AI大模型,能够解决你们学习中的困难。

下面这些都是我当初辛苦整理和花钱购买的资料,现在我已将重要的AI大模型资料包括市面上AI大模型各大白皮书、AGI大模型系统学习路线、AI大模型视频教程、实战学习,等录播视频免费分享出来,需要的小伙伴可以扫取。

一、AGI大模型系统学习路线

很多人学习大模型的时候没有方向,东学一点西学一点,像只无头苍蝇乱撞,我下面分享的这个学习路线希望能够帮助到你们学习AI大模型。

二、AI大模型视频教程

三、AI大模型各大学习书籍!

四、AI大模型各大场景实战案例

五、AI大模型面试题库

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉 福利来袭优快云大礼包:《2025最全AI大模型学习资源包》免费分享,安全可点 👈

五、结束语

学习AI大模型是当前科技发展的趋势,它不仅能够为我们提供更多的机会和挑战,还能够让我们更好地理解和应用人工智能技术。通过学习AI大模型,我们可以深入了解深度学习、神经网络等核心概念,并将其应用于自然语言处理、计算机视觉、语音识别等领域。同时,掌握AI大模型还能够为我们的职业发展增添竞争力,成为未来技术领域的领导者。

再者,学习AI大模型也能为我们自己创造更多的价值,提供更多的岗位以及副业创收,让自己的生活更上一层楼。

因此,学习AI大模型是一项有前景且值得投入的时间和精力的重要选择。

8625

8625

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?