参考: https://www.processon.com/view/link/63637c0d7d9c084cafb49cfe

前言

上节中,我们已经实现了基础的信息增熵算法, 接下来我们学习下关于CART(Classification and Regression Tree)

Cart

cart 就是根据gini 系数, 数据的混乱程度来进行划分, gini系数越小,代表同类的可能性越大,越有利于划分为同类。

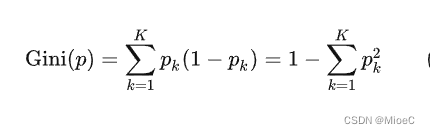

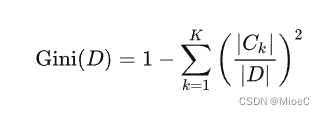

计算公式:

其中, Ck为样本类的个数, D为样本总数

可以发现, 样本类数越多, gini 系数越大, 相反,gini系数越小, 所以,我们需要选择gini 最小的

条件gini

根据特定条件可以帮数据分为两个部分

CART决策树算法详解

CART决策树算法详解

本文介绍了CART(Classification and Regression Tree)决策树算法,详细讲述了条件Gini系数的计算,以及CART决策树的构建步骤和剪枝过程。通过实例展示了如何计算Gini和条件Gini,并解释了为何选择Gini最小的特征进行划分。

本文介绍了CART(Classification and Regression Tree)决策树算法,详细讲述了条件Gini系数的计算,以及CART决策树的构建步骤和剪枝过程。通过实例展示了如何计算Gini和条件Gini,并解释了为何选择Gini最小的特征进行划分。

订阅专栏 解锁全文

订阅专栏 解锁全文

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?