yolov8就不介绍了,见主页

这里说下用pycharm运行。

代码参考segment页

from ultralytics import YOLO

# Load a model

model = YOLO('yolov8n-seg.pt') # load an official model

# Predict with the model

results = model('test_img.jpg') # predict on an image

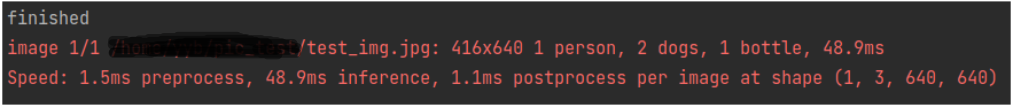

不通过command line,结果就只会显示predict时间和几个坐标。

并没有显示图片,也没有保存输出图片。

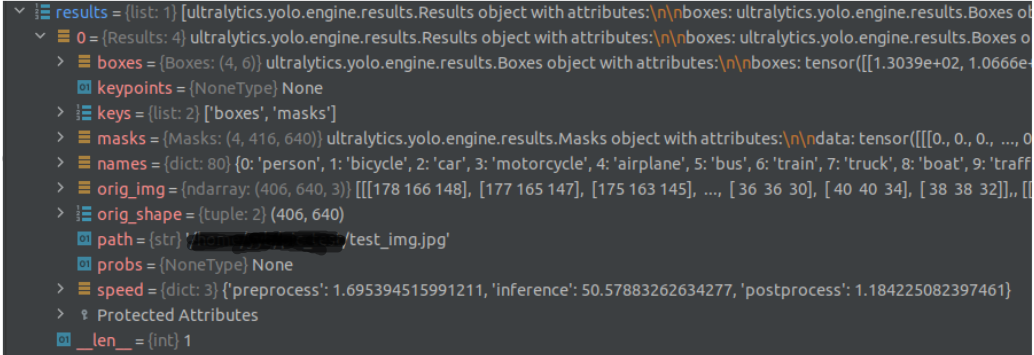

results里面的数据如下:

难道需要自己把box画出来?

不需要自己去写后处理,model里面自带的,现在来把它找出来。

在ultralytics/yolo/engine/predictor.py的BasePredictor中,看到了predict的流程,

可以看到,如果args.save或者args.show为True, 就会保存结果,

args.show和self.plotted_img同时为True, 就会显示结果.

如果用Command line执行,show和save是直接设置的,那么pycharm在哪里设置?

(在Run->Edit Configurations的parameters里面设置show=True save=True并没什么用)。

class BasePredictor:

def stream_inference(self, source=None, model=None):

...

for batch in self.dataset:

...

# Preprocess

with profilers[0]:

im = self PyCharm中运行YOLOv8模型:保存和显示预测结果

PyCharm中运行YOLOv8模型:保存和显示预测结果

文章讨论了如何在PyCharm中使用YOLOv8进行图像识别,指出默认情况下模型不会显示或保存预测结果。作者分析了代码,发现`BasePredictor`类中的逻辑,特别是`show`和`save`参数的设置。在`default.yaml`配置文件中设置`save`为True并不生效,因为如果不在命令行环境中,YOLO的`predict`方法会覆盖这个设置。解决办法是修改源代码,确保在非命令行执行时也能保存图片。

文章讨论了如何在PyCharm中使用YOLOv8进行图像识别,指出默认情况下模型不会显示或保存预测结果。作者分析了代码,发现`BasePredictor`类中的逻辑,特别是`show`和`save`参数的设置。在`default.yaml`配置文件中设置`save`为True并不生效,因为如果不在命令行环境中,YOLO的`predict`方法会覆盖这个设置。解决办法是修改源代码,确保在非命令行执行时也能保存图片。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

6972

6972

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?