Open WebUI 是一个开源的大语言模型(LLM)交互界面,支持本地部署与离线运行。通过它,用户能在类似 ChatGPT 的网页界面中,直接操作本地运行的 Ollama 等大语言模型工具。接下来为大家详细介绍其下载和使用方法。

一、安装前的准备工作

- Python 3.11:这是必须严格使用的版本,更高版本可能会出现不兼容问题。可访问Python 官网下载 Python 3.11.9 安装包,安装时务必勾选 “Add Python 3.11 to PATH”,安装完成后在命令行输入python --version验证,出现版本信息即安装成功。

- Ollama:若要使用 Ollama 模型,需提前安装并运行 Ollama。安装教程可参考相关文章 。

二、Open WebUI 的安装

打开 cmd 窗口,输入:pip install open-webui ,等待一段时间自动安装完成。安装过程中注意不要使用 python3.11 以上的版本,否则可能出现不兼容问题。当看到相关安装成功提示界面,即表示安装完成。

三、运行 Open WebUI 并连接 Ollama

- 启动 Open WebUI:在 cmd 窗口输入open-webui serve 。

- 设置中文界面:登录后,在右上角设置中选择 “简体中文”,提升使用体验。

- 选择模型:进入网站后,在右上角选择本地已安装的大模型,如 deepseek - r1.5 等,选择之后就可以进行对话了。

- 模型文件存储路径优化:通过环境变量OLLAMA_MODELS将模型文件迁移至非系统盘(如D:\ollama_models),避免 C 盘空间被大量占用。

- 端口冲突处理:若 8080 端口被占用,可通过--port参数指定其他端口,如open-webui serve --port 8090 。

除了上述通过 Python pip 安装的方式外,Open WebUI 还支持 Docker 安装等其他方式:

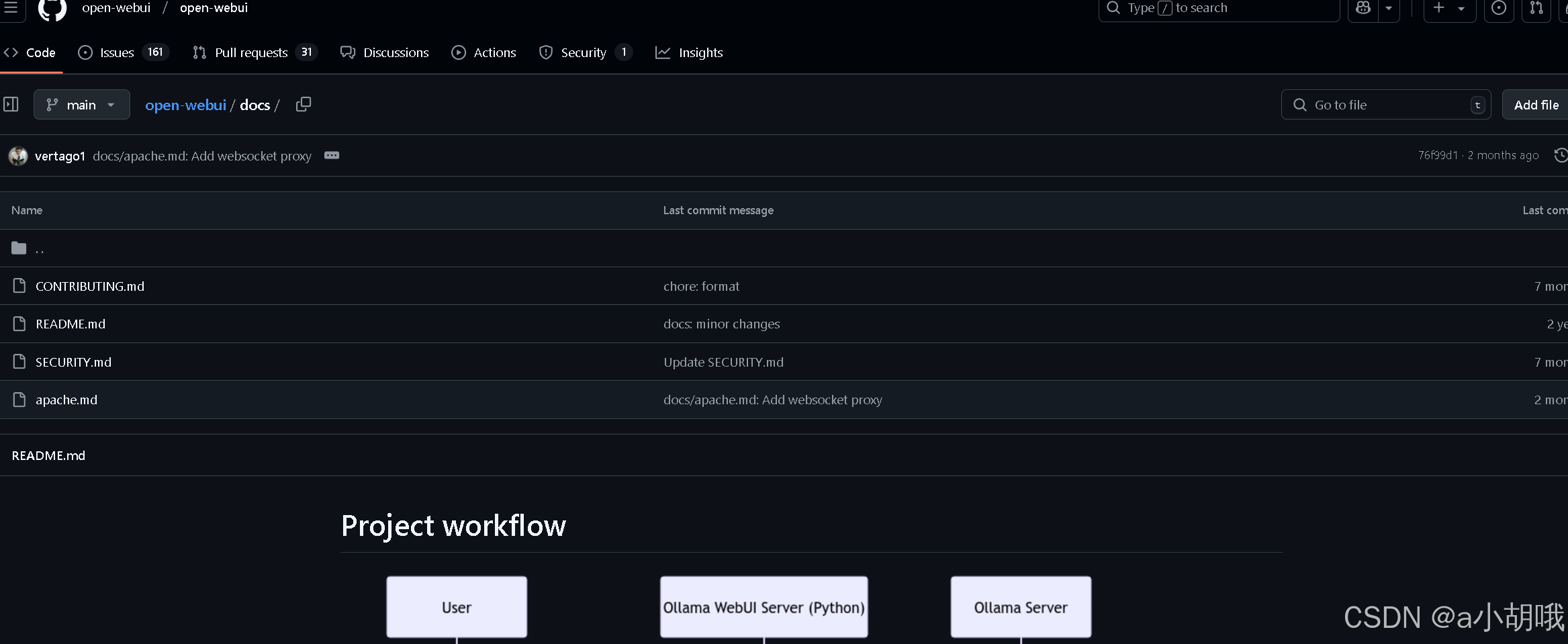

- Docker 安装:推荐使用带有:cuda或:ollama标签的官方镜像。需根据 Ollama 是否在本地以及是否需要 GPU 支持选择不同的命令,关键是要挂载数据卷-v open - webui:/app/backend/data以防止数据丢失,具体命令可参考GitHub 页面中的详细说明。如果 Ollama 在不同的服务器上,需要设置OLLAMA_BASE_URL环境变量。

- Docker Compose、Kustomize 和 Helm 安装:更多安装方法可参考Open WebUI 文档。

-

通过以上步骤,你就可以顺利下载并使用 Open WebUI,开启与本地大语言模型的便捷交互之旅了。赶紧动手试试吧!

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?