Chen Q, Zhang J, Meng R, et al. Modality-Specific Information Disentanglement from Multi-parametric MRI for Breast Tumor Segmentation and Computer-aided Diagnosis[J]. IEEE Transactions on Medical Imaging, 2024. 【开源】

【核心思想】

设计一个名为特定模态信息解耦(MoSID)的新框架。该框架旨在解决现有多参数磁共振成像(MRI)中用于肿瘤分割的深度学习方法的局限性。MoSID框架重点提取模态内部和跨模态注意力图,作为指导乳腺肿瘤分割的先验知识。通过解耦特定模态信息,MoSID为分割任务提供了补充洞察,增强了模态选择和跨模态评估的效果。文章还将分割结果用于构建分类器来预测患者对放射治疗的反应。通过在两个三维乳腺数据集和一个二维前列腺数据集上的实验,MoSID展示了其相比其他最先进方法的优越性能。

【Introduction部分重点总结】

-

现有的多模态肿瘤分割方法存在一些局限性

-

探索跨模态信息的局限:现有方法在探索和利用不同成像模态之间的信息时存在局限。这意味着它们可能无法充分利用多模态MRI提供的丰富和互补信息,从而影响肿瘤分割的准确性和效果。

-

关注特定模态的不足:这些方法在确定哪些模态是任务相关的(即对肿瘤分割最有信息价值的模态)方面可能不够有效。这可能导致在分割过程中未能充分利用最有价值的模态信息。

-

缺乏动态调整模态融合的能力:传统的多模态肿瘤分割方法可能缺乏根据每个病例的具体情况动态调整模态融合策略的能力。这意味着这些方法可能无法根据不同病人的特定情况优化处理策略,从而影响分割的准确性和鲁棒性。

-

解偶方法通常通过注意力模块在特征空间中进行,缺乏可解释性。

-

这些方法未能解决重要问题:1)每个患者的所有模式是否都为分割任务提供了信息? 2)提取的特定模态信息将有利于还是阻碍分割任务?

- 本文的主要贡献

-

开发了MoSID框架:提出了一种新的特定模态信息解耦(MoSID)框架,该框架能够有效地从多参数MRI中提取并利用跨模态和内模态的注意力图,这些图作为指导肿瘤分割的先验知识。

-

改进肿瘤分割方法:MoSID框架通过解耦特定模态信息,提供了更加全面的线索以指导肿瘤分割任务,这种方法在处理多模态医学影像数据时,相比现有方法展示了更高的准确性和效率。

-

实验验证:在多个数据集上进行的实验验证了MoSID框架的有效性。这些数据集包括两个三维乳腺数据集和一个二维前列腺数据集,结果表明MoSID框架在多模态肿瘤分割方面优于其他最先进的方法。

-

处理缺失模态情况:MoSID框架还能够有效处理在实际临床应用中可能遇到的缺失模态情况,表现出良好的鲁棒性和适应性。

-

计算机辅助诊断系统的应用:MoSID框架在乳腺癌新辅助治疗效果的预测中表现出潜力,特别是在预测放射治疗前的治疗反应(如病理完全缓解和非病理完全缓解)方面。

【额外的医学背景知识】

这里补充一些医学背景知识,不属于论文内容。

论文中,使用了DCE-MRI、ADC和T2w三种MRI模态,每种技术在医学成像中有其独特的应用和优势:

-

DCE-MRI(动态对比增强磁共振成像):DCE-MRI是一种使用对比剂来增强图像的MRI技术。它通过观察对比剂在组织中的分布和流动,帮助评估血管的密度和通透性。这种方法对于检测和评估肿瘤特别有用,因为肿瘤通常会引起血管生成和改变组织的血液动力学。在乳腺成像中,DCE-MRI被广泛用于检测和表征乳腺肿瘤。

-

ADC(表观扩散系数):ADC是扩散加权成像(DWI)的一个关键参数,用于量化组织中水分子的扩散程度。在扩散加权成像中,图像的对比度依赖于水分子在组织中的运动。ADC图像可以提供关于组织细胞密度和结构的信息。例如,在肿瘤成像中,较低的ADC值通常与高细胞密度相关联,这是许多类型肿瘤的特征。

-

T2w(T2加权成像):T2w是一种MRI技术,根据组织中水分子的T2弛豫时间来增强图像对比度。T2弛豫时间是水分子回到平衡状态所需的时间。T2加权成像特别擅长显示液体和水肿,因此对于揭示炎症、水肿和某些类型的肿瘤特别有效。在乳腺成像中,T2w有助于区分良性和恶性病变。

论文中根据临床诊断经验,选择DCE-MRI作为主要模态,T2w和ADC图像作为补充模态。

【本文提出的方法】

MoSID 框架:步骤 1 从替代模态角度导出与 DCE-MRI 等效的任务相关信息。步骤 2 通过对比合成图像和真实图像来辨别独特的模态信息,从而产生四个分割图: p 1 p_1 p1、 p 2 p_2 p2、 p 3 p_3 p3 和 p 4 p_4 p4。步骤 3 利用特定于模态的信息来增强分割性能。步骤 3 中模块包括模态特定注意力、模态可信门控和深度监督。

step1:图像合成

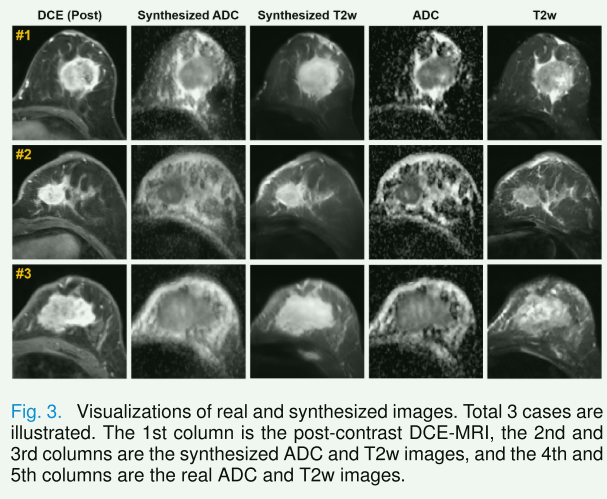

从DCE-MRI合成ADC和T2w图像。这是通过使用两个合成网络G1和G2来实现的,这些网络被训练用来将DCE-MRI映射到ADC和T2w空间。合成步骤中采用了残差U-Net(RU-Net)架构。这一步就是基于L1损失的监督学习。但最终目标不是生成几乎相同的图像,只希望合成图像能够保留原始结构信息,但具有其他模态样式,例如肿瘤区域的 ADC 模态中的低强度和 T2w 模态中的高强度。这一步采用这种方式感觉有点粗暴,感觉就是直接做风格迁移合并。效果见下图:

step2:模态相关信息的解耦

使用DCE-MRI作为主要模态,提取T2w和ADC作为补充模态的互补和特定信息。这一步就是做减法直接解耦,也比较直接。其中 p 1 p_1 p1、 p 2 p_2

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1689

1689

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?