一、迹运算

(1)迹(trace)是用来表示矩阵主对角元素和的概念:

Tr(A)=∑iAi,i

\operatorname{Tr}(\boldsymbol{A})=\sum_{i} \boldsymbol{A}_{i, i}

Tr(A)=i∑Ai,i

例如A=[a11a12a21a22]A=\begin{bmatrix}a_{11}&a_{12}\\a_{21}&a_{22}\end{bmatrix}A=[a11a21a12a22],则Tr(A)=a11+a22Tr(A)=a_{11}+a_{22}Tr(A)=a11+a22.

(2)若不使用求和符号∑\sum∑,有些矩阵运算很难描述,而通过矩阵乘法和迹运算符号可以清楚地表示。例如,Frobenius范数∥A∥F=∑i,jAi,j2\quad\|A\|_{F}=\sqrt{\sum_{i, j} A_{i, j}^{2}}\quad∥A∥F=∑i,jAi,j2的另一种表示方式可以是:

∥A∥F=Tr(AA⊤)\|A\|_{F}=\sqrt{\operatorname{Tr}\left(A A^{\top}\right)}∥A∥F=Tr(AA⊤)

这其实不难证明:

同样利用上面的矩阵AAA,AAT=[a11a12a21a22][a11a21a12a22]=[a112+a122⋯⋯a212+a222]AA^{T}=\begin{bmatrix}a_{11}&a_{12}\\a_{21}&a_{22}\end{bmatrix}\begin{bmatrix}a_{11}&a_{21}\\a_{12}&a_{22}\end{bmatrix}=\begin{bmatrix}a_{11}^2+a_{12}^2&\cdots\\\cdots&a_{21}^2+a_{22}^2\end{bmatrix}AAT=[a11a21a12a22][a11a12a21a22]=[a112+a122⋯⋯a212+a222]

显然,Tr(AA⊤)=a112+a122+a212+a222=∥A∥F\sqrt{\operatorname{Tr}\left(A A^{\top}\right)}=\sqrt{a_{11}^2+a_{12}^2+a_{21}^2+a_{22}^2}=\|A\|_{F}Tr(AA⊤)=a112+a122+a212+a222=∥A∥F,得证。

(3)迹运算的一些性质:

- Tr(A)=Tr(AT)\operatorname{Tr}(\boldsymbol{A})=\operatorname{Tr}\left(\boldsymbol{A}^{T}\right)Tr(A)=Tr(AT)

- Tr(ABC)=Tr(CAB)=Tr(BCA)\operatorname{Tr}(A B C)=\operatorname{Tr}(C A B)=\operatorname{Tr}(B C A)Tr(ABC)=Tr(CAB)=Tr(BCA)

- a=Tr(a)a=\operatorname{Tr}(a)a=Tr(a)

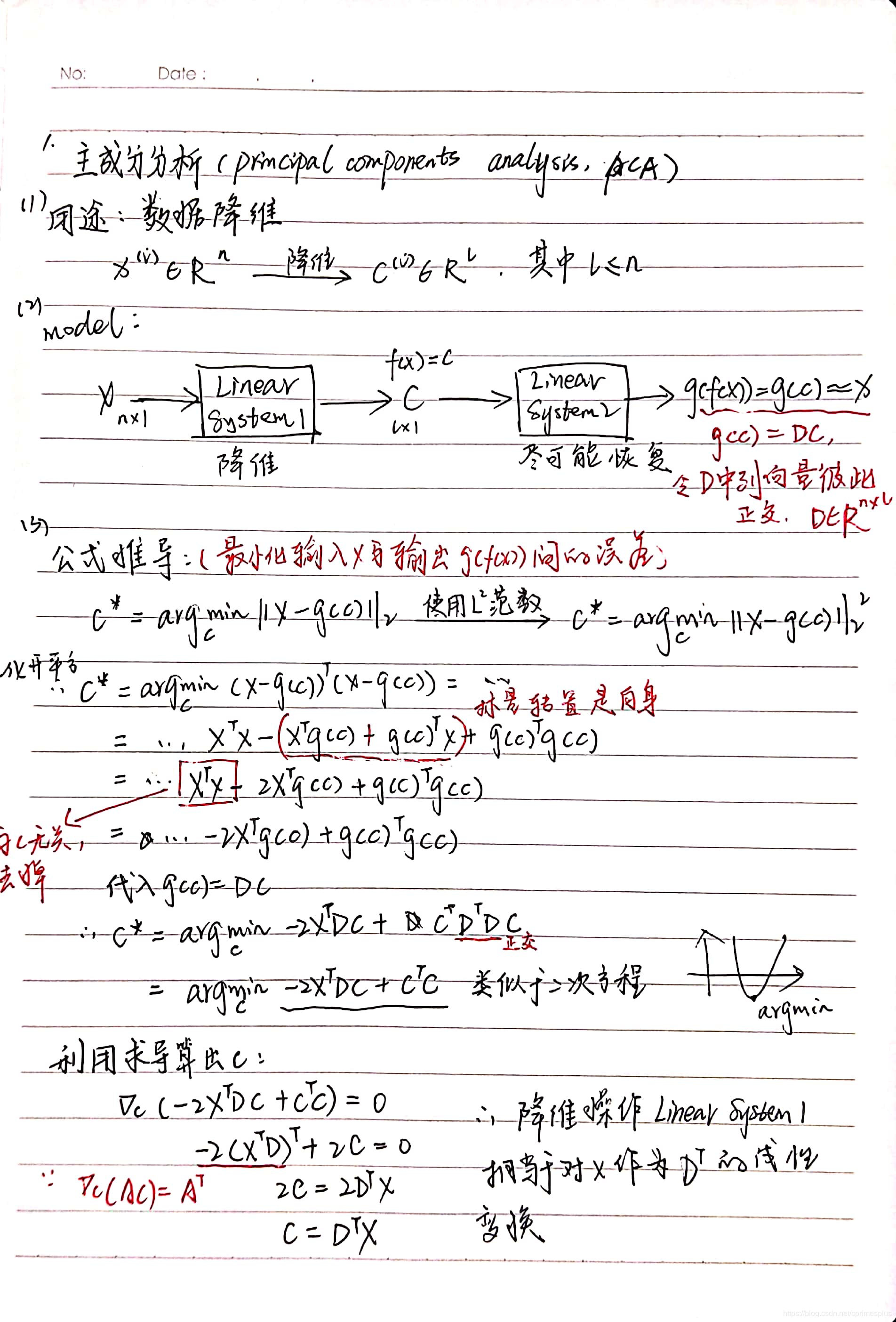

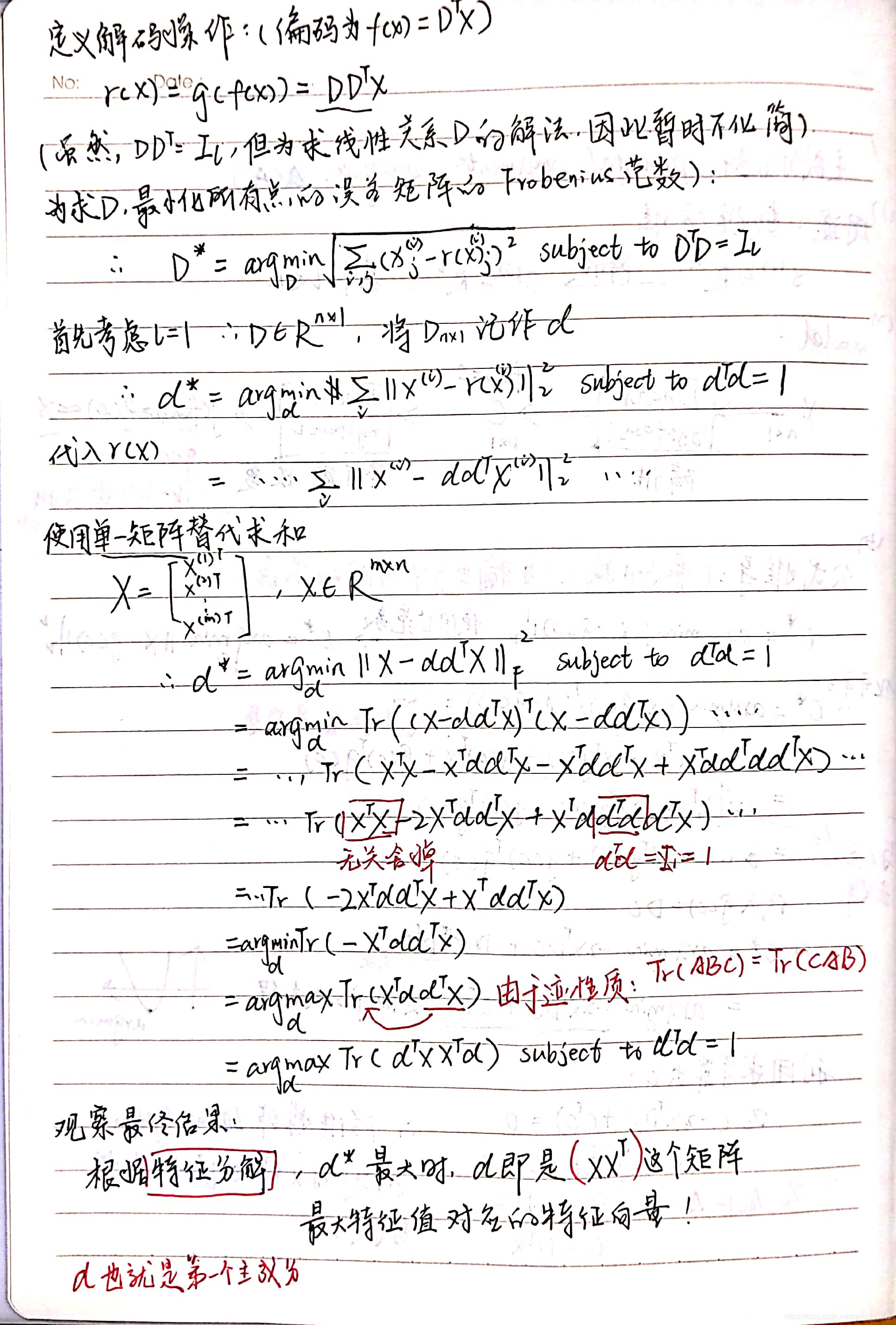

二、主成分分析

通过数学归纳法可证:

更一般的,当希望得到主成分的基时,矩阵DDD由其前 lll 个特征值对应的特征向量组成。

三、由PCA公式推导学到的

- 常见目标:最小化 / 最大化

- 为简化问题可适当增加约束条件,或者减少分析的维数(例如上面先令 l=1l=1l=1)

- 使用迹运算与化局部x(i)x^{(i)}x(i)为整体XXX,代替求和符号 ∑\sum∑

- 熟练运用:若向量相乘为标量,标量转置等于自身

- 熟练运用:∥A∥F=Tr(AA⊤)\|A\|_{F}=\sqrt{\operatorname{Tr}\left(A A^{\top}\right)}∥A∥F=Tr(AA⊤)

- 熟练运用:迹运算的各种性质

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?