最近出现了一系列令人激动的开源大语言模型,如meta的LLaMA、清华的ChatGLM等。伴随大模型一起爆火的,还有大模型的微调方法。然而随着模型规模和任务数量的增加,对整个Transformer模型进行微调也变得越来越昂贵。因此,很多参数高效微调方法(Parameter-Efficient Fine-Tuning,PEFT) 方法被提出来解决这类问题。

免费扫描参与课程(附老师ppt原稿&100+大模型论文)

领99个大模型微调模型/数据/工具

(文末有福利)

导师推荐100+大模型论文合集

我们邀请了清华大学博士,AI顶会审稿人青山老师为大家带来——惊艳的大模型高效参数微调法!来和大家聊一聊有关大模型微调的方法、未来趋势及创新点!

免费扫描参与课程(附老师ppt原稿&100+大模型论文)

领99个大模型微调模型/数据/工具

(文末有福利)

讲师介绍—青山老师

▪️研究领域:工业故障诊断、医学图像分割、医学多模态问答、不平衡学习、小样本学习、开集学习和可解释性深度学习等。

▪️共发表20余篇SCI国际期刊和EI会议论文,包括一区期刊IEEE Transactions on Industrial Informatics (影响因子11.648),Applied Soft Computing (影响因子8.263),Neurocomputing (影响因子5.779), ISA Transactions (影响因子5.911),Journal of Intelligent Manufacturing (影响因子7.136) 等。论文引用200+。

▪️长期担任人工智能顶级会议AAAI等审稿人, Neurocomputing,Expert Systems with Applications等国际顶级期刊审稿人。

【课程大纲】

第1节:大模型微调-任务特定的P-tuning

1. 端到端微调的挑战和限制

2. P-tuning 的基本思想与步骤

3. P-tuning 在自然语言处理任务上的实际应用

第2节:大模型微调-任务/模型无关的LORA

1. 各个领域预训练模型和微调概念的介绍

2. LoRA 微调的关键思想和方法

3. LoRA 在计算机视觉领域中的实际应用案例

第3节:大模型微调方法-Peft库使用实践(实战篇)

1. 使用P-tuning微调ChatGLM

2. 使用LoRA微调Blip

3. 参数高效的微调方法未来的发展趋势、热点预测

Prefix-tuning和P-tuning通过引导模型生成过程,使模型能够更准确地满足任务需求。

Adapter技术通过添加轻量级的适配器层,实现了快速的任务适应和灵活性。

Low-Rank Adaptation(LoRA)通过低秩近似减少模型参数量,提高模型的效率和部署可行性。

REcurrent ADaption(READ)在保持较高质量模型微调效果的同时,可以节省56%的训练显存消耗和84%的GPU使用量。

免费领99个微调数据/模型/工具

▪️58个开源的微调数据

▪️18个开源垂直微调模型

▪️23个开源的指令微调与强化工具

(文末有福利)

PEFT 方法可以分为三类,不同的方法对 PLM 的不同部分进行下游任务的适配:

Prefix/Prompt-Tuning :在模型的输入或隐层添加 k 个额外可训练的前缀 tokens(这些前缀是连续的伪 tokens,不对应真实的 tokens),只训练这些前缀参数;

Adapter-Tuning :将较小的神经网络层或模块插入预训练模型的每一层,这些新插入的神经模块称为 adapter(适配器),下游任务微调时也只训练这些适配器参数;

LoRA :通过学习小参数的低秩矩阵来近似模型权重矩阵 W 的参数更新,训练时只优化低秩矩阵参数。

作为一个科研小白,怎么发表一篇大模型微调相关的优质论文?

为了论文,大家都在努力地设计新网络、新策略、新training算法,只要能够在某一问题上做到一个很好的performance,论文就水到渠成。而想要快速达到,来自前辈的指点不可或缺。

一个好的指导老师的作用是,没有课题,能够结合所在课题组具体情况,结合最近热门研究方向,帮你规划课题,如果有了课题而缺少创新方向,老师能够快速帮你找到几种切入点,几种框架,甚至连需要读哪些文献都帮你想好了......

扫描二维码

获取学术大咖科研指导

(文末有福利)

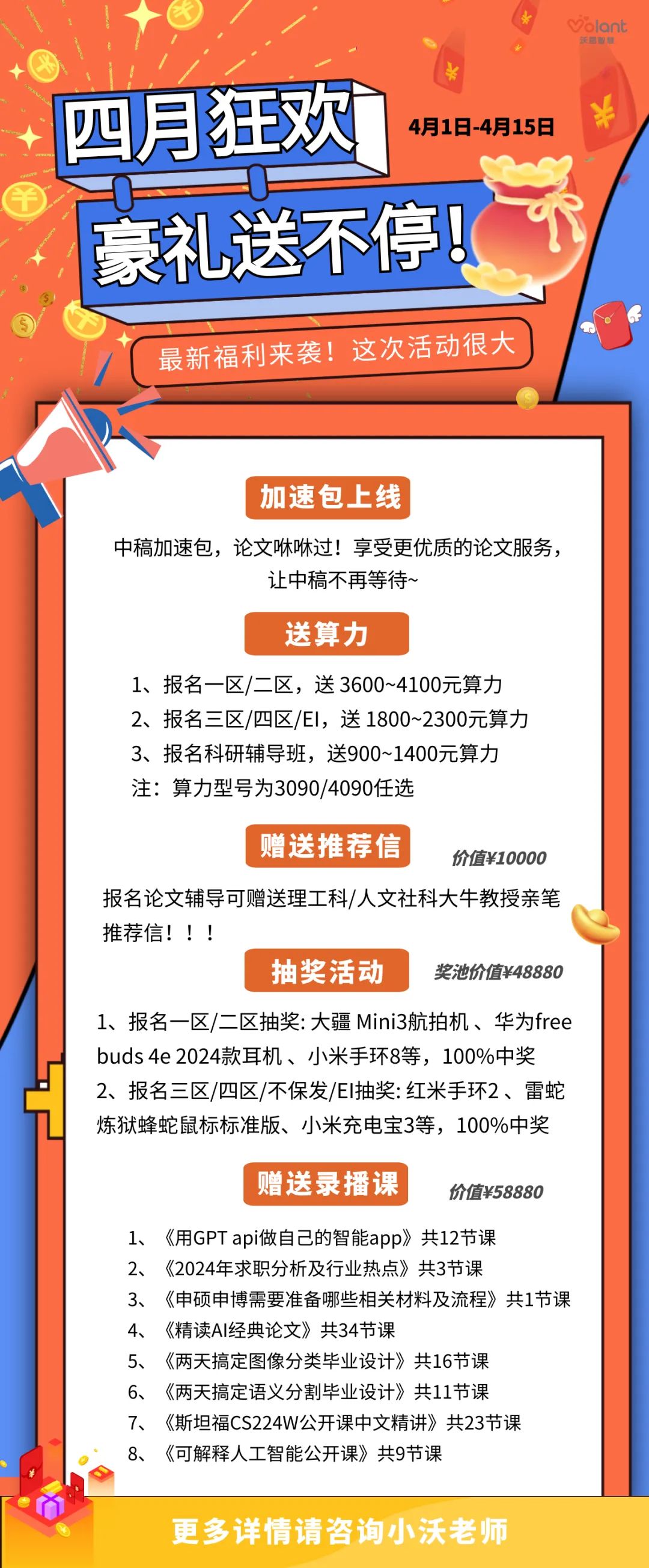

文末福利

给大家送一波大福利!我整理了100节计算机全方向必学课程,包含CV&NLP&论文写作经典课程,限时免费领!免费送GPU!

立即扫码

免费领100节计算机必学课程

本文介绍了近期流行的开源大语言模型及其微调方法,特别是PEFT技术,如P-tuning和Adapter,以及LoRA的低秩适应性。清华大学的青山老师分享了高效参数微调的课程,涵盖了任务特定的P-tuning、任务/模型无关的LORA和Peft库实践。同时,文章讨论了如何发表大模型微调相关论文,并提供了丰富的资源福利。

本文介绍了近期流行的开源大语言模型及其微调方法,特别是PEFT技术,如P-tuning和Adapter,以及LoRA的低秩适应性。清华大学的青山老师分享了高效参数微调的课程,涵盖了任务特定的P-tuning、任务/模型无关的LORA和Peft库实践。同时,文章讨论了如何发表大模型微调相关论文,并提供了丰富的资源福利。

881

881

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?