为什么单目摄像机不能测深度?

我们看到红色线条上三个不同远近的黑色的点在下方相机上投影在同一个位置,因此单目相机无法分辨成的像到底是远的那个还是近的那个。

双目立体视觉深度相机测距流程:

(1)需要对双目相机进行相机标定,得到两个相机的内外参数、单应矩阵。

(2) 根据标定结果对原始图像进行图像校正,校正后的两张图像位于同一平面且互相平行。

(3)双目匹配,对校正后的两张图像进行像素点匹配。

(4)根据匹配结果计算每个像素的深度,从而获得深度图

理想的双目相机模型:

可求得深度值Z为:

B:双目相机之间的距离,称为基线。

f:双目相机的焦距(该焦距要转换为以像素为单位的焦距)。

d:称为视差,即物体在左右相机中成像的点距成像平面边缘的距离(成像点的在图像平面上的像素坐标的行像素)。

假设目标点在左视图中的坐标为(x,y)--为像素坐标系下的坐标值,在左右视图上形成的视差为d,

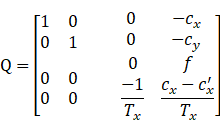

目标点在以左摄像头光心为原点的世界坐标系中的坐标为(X,Y,Z),则存在所示的变换矩阵Q,使

'

![]()

双目相机深度测距技术解析

双目相机深度测距技术解析

双目立体视觉深度相机通过相机标定、图像校正、双目匹配及视差计算来获取深度图。文章详细介绍了从标定到匹配的步骤,并探讨了影响因素,包括光照变化、纹理单调场景和计算复杂度。最后提到了视差求精方法,如左右一致性检测、滤波和亚像素插值,以提升深度图质量。

双目立体视觉深度相机通过相机标定、图像校正、双目匹配及视差计算来获取深度图。文章详细介绍了从标定到匹配的步骤,并探讨了影响因素,包括光照变化、纹理单调场景和计算复杂度。最后提到了视差求精方法,如左右一致性检测、滤波和亚像素插值,以提升深度图质量。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

2253

2253

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?