近期的研究表明,强化学习可以显著提高模型的推理能力。例如,DeepSeek-R1 通过整合冷启动数据和多阶段训练,实现了最先进的性能,使其能够进行深度思考和复杂推理。

这一次,我们探讨了大规模强化学习(RL)对大语言模型的智能的提升作用,同时推出我们最新的推理模型 QwQ-32B。这是一款拥有 320 亿参数的模型,其性能可与具备 6710 亿参数(其中 370 亿被激活)的 DeepSeek-R1 媲美。

这一成果突显了将强化学习应用于经过大规模预训练的强大基础模型的有效性。此外,我们还在推理模型中集成了与 Agent 相关的能力,使其能够在使用工具的同时进行批判性思考,并根据环境反馈调整推理过程。

我们希望我们的一点努力能够证明强大的基础模型叠加大规模强化学习也许是一条通往通用人工智能的可行之路。

QwQ-32B 模型效果

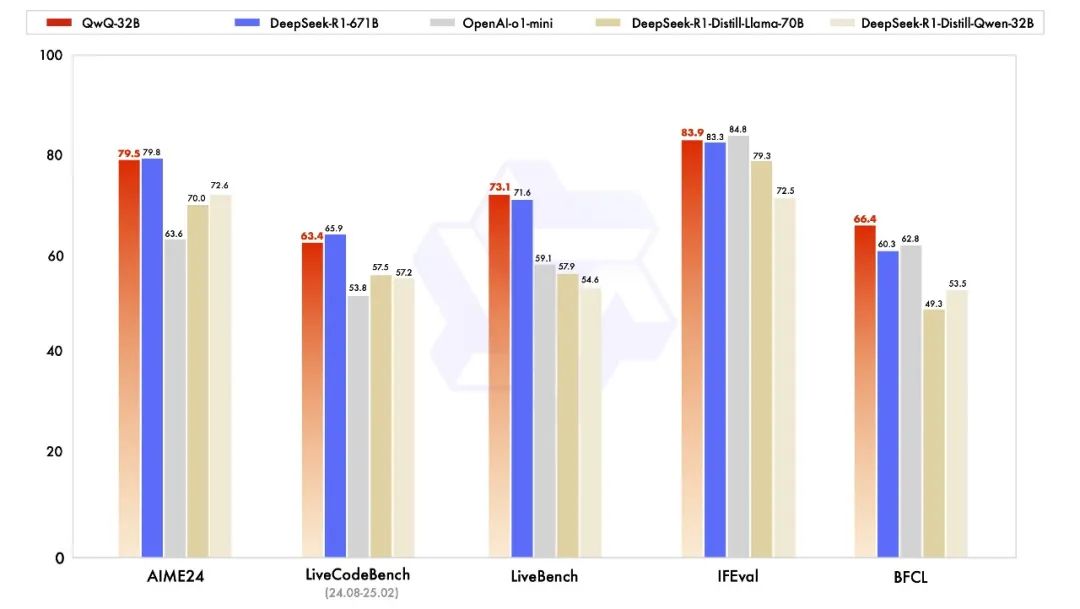

QwQ-32B 在一系列基准测试中进行了评估,测试了数学推理、编程能力和通用能力。以下结果展示了 QwQ-32B 与其他领先模型的性能对比,包括 DeepSeek-R1-Distilled-Qwen-32B、DeepSeek-R1-Distilled-Llama-70B、o1-mini 以及原始的 DeepSeek-R1。

在测试数学能力的 AIME24 评测集上,以及评估代码能力的 LiveCodeBench 中,千问 QwQ-32B 表现与DeepSeek-R1相当,远胜于 o1-mini 及相同尺寸的R1 蒸馏模型;在由Meta首席科学家杨立昆领衔的“最难LLMs评测榜” LiveBench、谷歌等提出的指令遵循能力IFEval评测集、由加州大学伯克利分校等提出的评估准确调用函数或工具方面的BFCL测试中,千问 QwQ-32B 的得分均超越了 DeepSeek- R1。

大规模强化学习

我们在冷启动的基础上开展了大规模强化学习。在初始阶段,特别针对数学和编程任务进行了 RL 训练。与依赖传统的奖励模型(reward model)不同,我们通过校验生成答案的正确性来为数学问题提供反馈,并通过代码执行服务器评估生成的代码是否成功通过测试用例来提供代码的反馈。

我们发现在 RL 扩展过程中,随着训练轮次的推进,这两个领域中的性能均表现出持续的提升。

在第一阶段的 RL 过后,我们增加了另一个针对通用能力的 RL。此阶段使用通用奖励模型和一些基于规则的验证器进行训练。我们发现,通过少量步骤的通用 RL,可以提升其他通用能力,同时在数学和编程任务上的性能没有显著下降。

通过API使用QwQ-32B

以下我们展示了一段简短的示例代码,说明如何通过 API 使用 QwQ-32B。

from openai import OpenAI``import os`` ``# Initialize OpenAI client``client = OpenAI(` `# If the environment variable is not configured, replace with your API Key: api_key="sk-xxx"` `# How to get an API Key:https://help.aliyun.com/zh/model-studio/developer-reference/get-api-key` `api_key=os.getenv("DASHSCOPE_API_KEY"),` `base_url="https://dashscope.aliyuncs.com/compatible-mode/v1"``)`` ``reasoning_content = ""``content = ""`` ``is_answering = False`` ``completion = client.chat.completions.create(` `model="qwq-32b",` `messages=[` `{"role": "user", "content": "Which is larger, 9.9 or 9.11?"}` `],` `stream=True,` `# Uncomment the following line to return token usage in the last chunk` `# stream_options={` `# "include_usage": True` `# }``)`` ``print("\n" + "=" * 20 + "reasoning content" + "=" * 20 + "\n")`` ``for chunk in completion:` `# If chunk.choices is empty, print usage` `if not chunk.choices:` `print("\nUsage:")` `print(chunk.usage)` `else:` `delta = chunk.choices[0].delta` `# Print reasoning content` `if hasattr(delta, 'reasoning_content') and delta.reasoning_content is not None:` `print(delta.reasoning_content, end='', flush=True)` `reasoning_content += delta.reasoning_content` `else:` `if delta.content != "" and is_answering is False:` `print("\n" + "=" * 20 + "content" + "=" * 20 + "\n")` `is_answering = True` `# Print content` `print(delta.content, end='', flush=True)` `content += delta.content

未来

这是Qwen在大规模强化学习(RL)以增强推理能力方面的第一步。通过这一旅程,我们不仅见证了扩展RL的巨大潜力,还认识到预训练语言模型中尚未开发的可能性。

在致力于开发下一代Qwen的过程中,我们相信将更强大的基础模型与依托规模化计算资源的RL相结合,将会使我们更接近实现人工通用智能(AGI)。此外,我们正在积极探索将智能体与RL集成,以实现长时推理,目标是通过推理时间扩展来释放更高的智能,敬请期待。

欢迎体验

目前,QwQ-32B 已在 Hugging Face (https://huggingface.co/Qwen/QwQ-32B) 和 ModelScope (https://modelscope.cn/models/Qwen/QwQ-32B) 开源,并采用了 Apache 2.0 开源协议。

也欢迎大家通过 Qwen Chat

(https://chat.qwen.ai/?models=Qwen2.5-Plus)直接进行体验!

## AI大模型学习福利

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版优快云大礼包:《AGI大模型学习资源包》免费分享

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版优快云大礼包:《AGI大模型学习资源包》免费分享

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版优快云大礼包:《AGI大模型学习资源包》免费分享

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版优快云大礼包:《AGI大模型学习资源包》免费分享

四、AI大模型商业化落地方案

因篇幅有限,仅展示部分资料,需要点击下方链接即可前往获取

2025最新版优快云大礼包:《AGI大模型学习资源包》免费分享

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量。

2695

2695

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?