[〇]关于本文

本文主要介绍安装DeepSeek

[一]安装Ollama

1-Ollama 是什么?

-

核心功能:

-

Ollama 是一个开源工具,专门用于在本地计算机上快速部署和运行大型语言模型(如 Llama、Mistral、DeepSeek 等)。

-

它简化了模型下载、依赖管理和运行流程,提供命令行界面直接调用模型。

-

-

核心优势:

-

一键运行:通过类似

ollama run deepseek的命令即可自动下载并启动模型。 -

跨平台支持:支持 macOS、Linux 和 Windows(预览版)。

-

模型管理:统一管理多个模型版本,无需手动配置环境。

-

2-为什么安装 DeepSeek 时需要 Ollama?

-

便捷部署:

-

DeepSeek 作为专注于代码和数学等领域的大模型,可能通过 Ollama 的模型库提供优化版本。使用 Ollama 可以直接拉取预配置的 DeepSeek 模型,省去手动安装依赖项的步骤。

-

-

依赖集成:

-

Ollama 内置了模型运行所需的框架(如 GPU 加速、内存优化),确保 DeepSeek 能在本地高效运行,尤其适合非技术用户。

-

-

标准化接口:

-

Ollama 提供统一的 REST API,便于后续将 DeepSeek 集成到其他应用(如聊天机器人、自动化工具)。

-

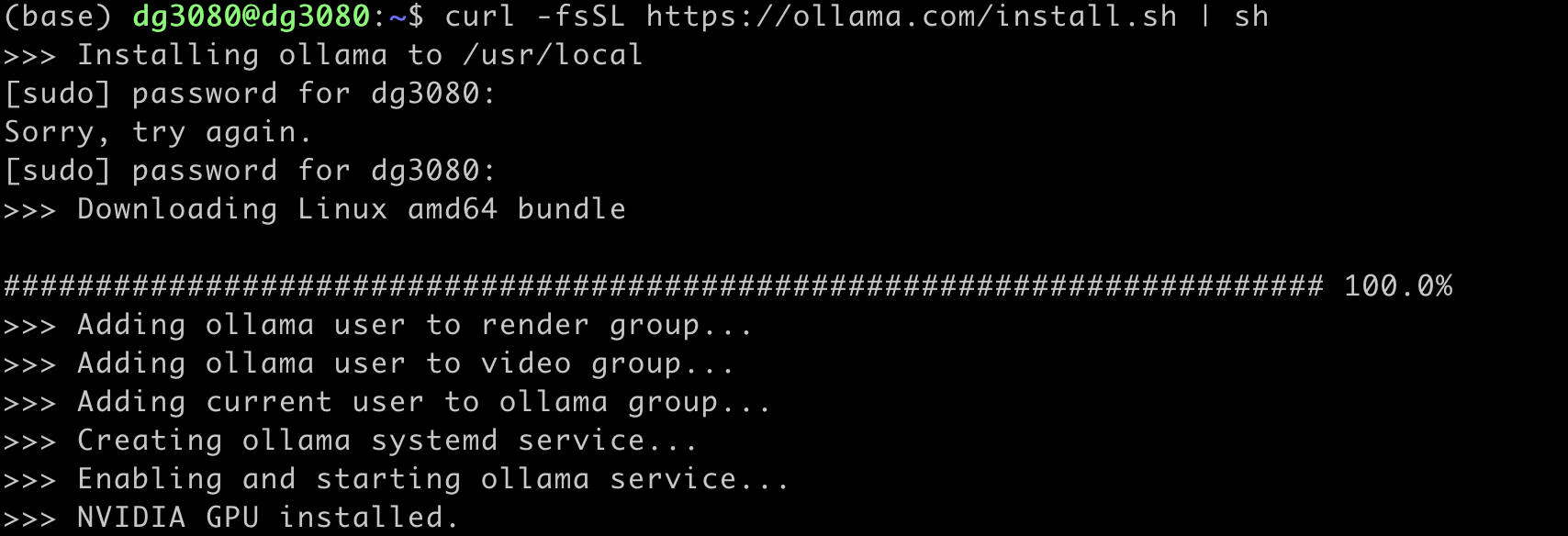

3-安装Ollama

curl -fsSL https://ollama.com/install.sh | sh

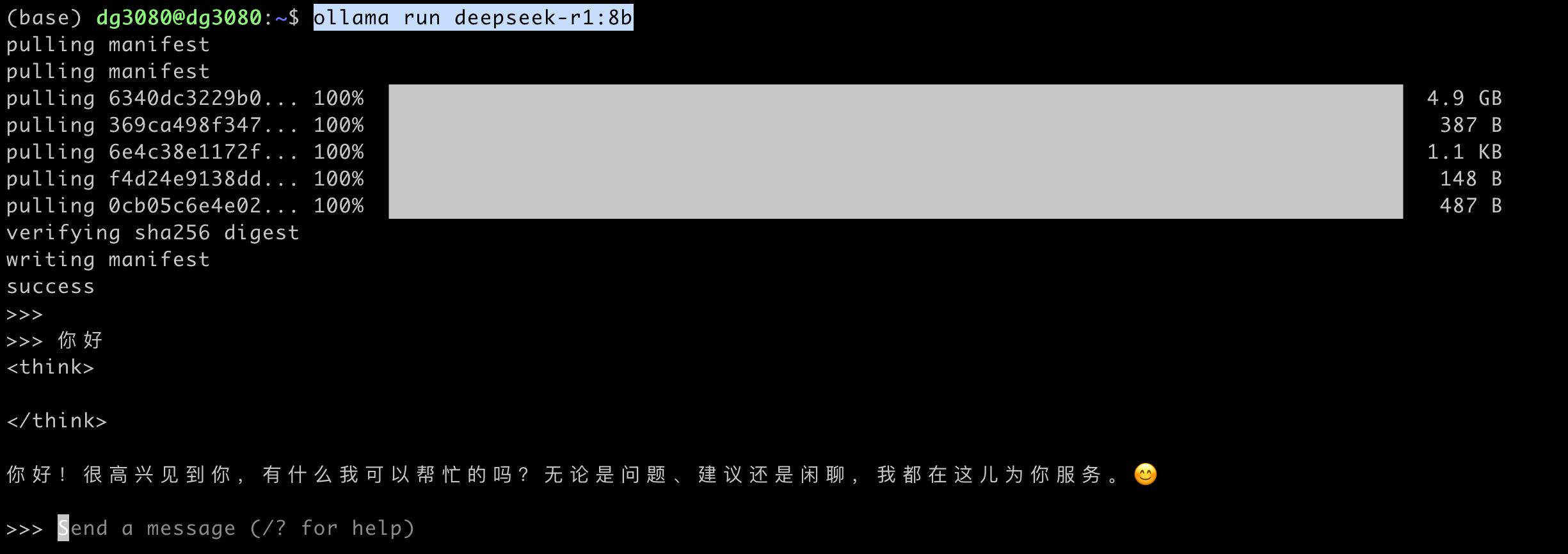

[二]安装Deepseek R1

ollama run deepseek-r1:8b

2071

2071

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?