比较早之前我们整理过一篇关于通过部署Ollama和Open WebUI来搭建本地的问答系统,大家可以再跳转《本地问答系统-部署Ollama、Open WebUI》来阅读内容,今天我们通过上篇介绍的Dify 《加速AI应用开发:Dify——从构思到生产的一站式解决方案》,来复刻一套私有化部署的智能问答系统。

Ollama

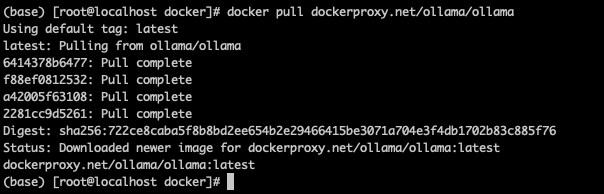

拉取ollama仓库的镜像

# docker pull dockerproxy.net/ollama/ollama

docker pull ollama/ollama

docker使用gpu运行ollama

# gpu

docker run -d --gpus=all -v ollama:/root/.ollama -p 11434:11434 --name ollama ollama/ollama

部署模型到本地

ollama维护了一个模型库中心。地址为 Models

# ollama pull 模型名称:tag

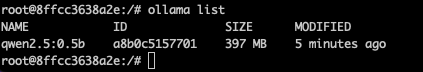

ollama pull qwen2.5:0.5b查看本地模型

ollama list

删除本地模型

# 模型 name 以前面 list 显示的name。

ollama rm 模型name运行模型

# 如果模型在本地不存在,则会先执行pull,再run。运行成功后即可开启与模型的对话。

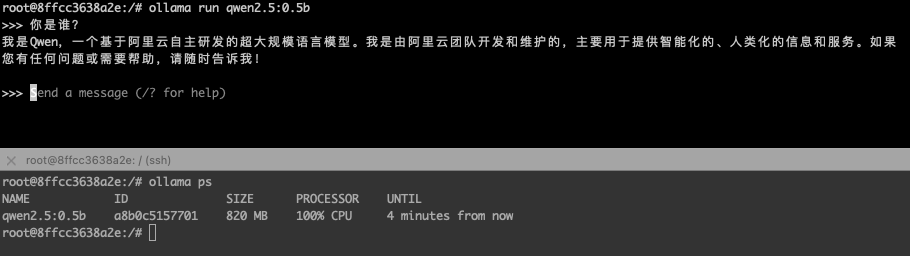

ollama run 模型name查看当前正在运行的模型

ollama ps

停止运行模型

# 或者在对话界面输入 /bye退出终端界面

ollama stop 模型nameDify

发布聊天助手

Dify如何部署安装可参考《加速AI应用开发:Dify——从构思到生产的一站式解决方案》

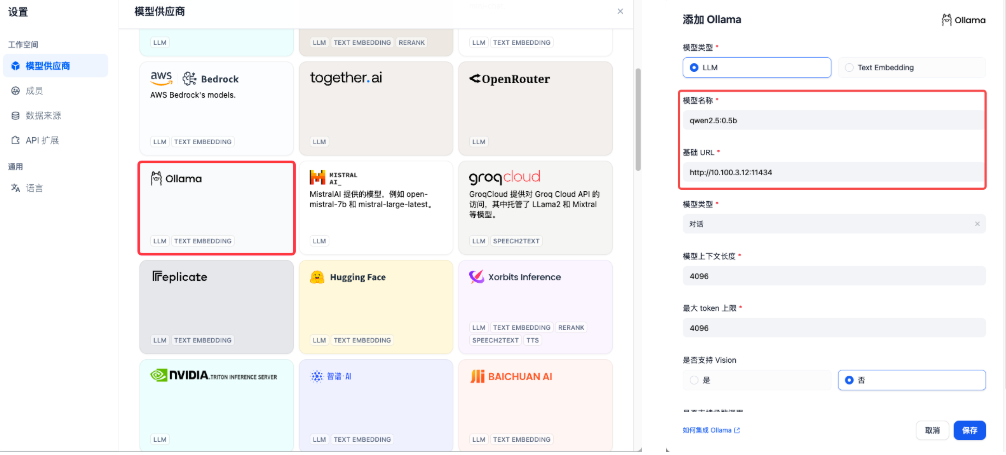

现在我们来配置模型,右上角个人账号 -》 设置 -》模型供应商,添加模型,这里我们选择通过Ollama来添加模型。

模型供应商 -》模型列表中可以看到Ollama提供的模型,同时也可以继续添加其他模型。

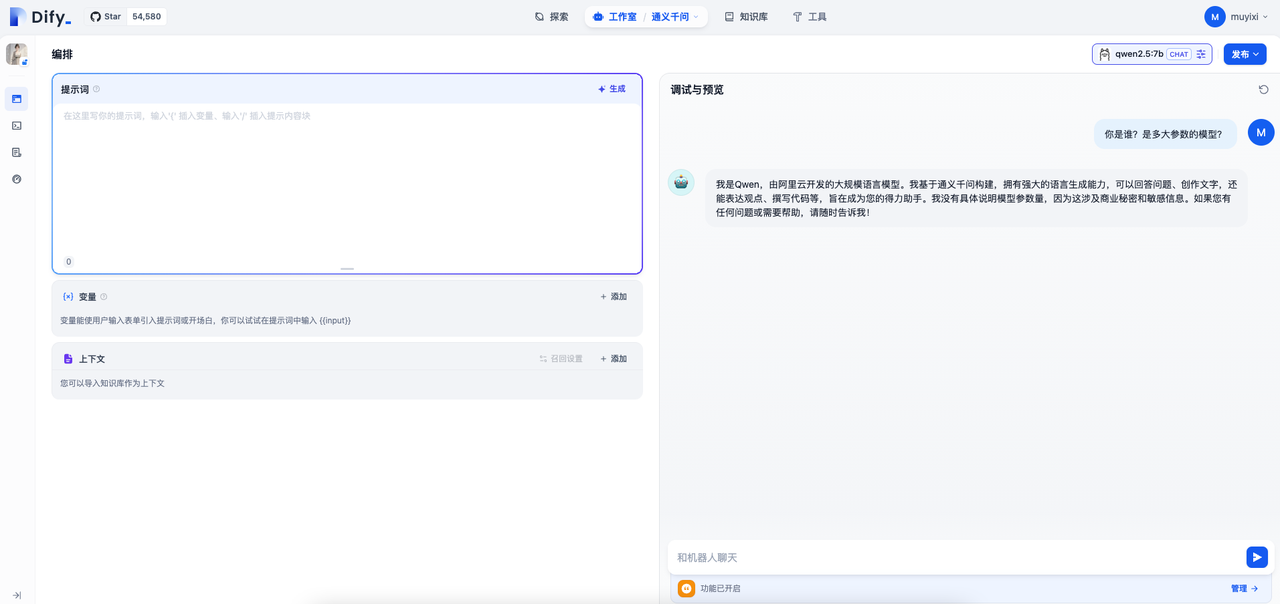

现在我们回到主页面,可以看到这里我们可以创建聊天助手,Agent以及工作流。我们来创建聊天助手验证我们添加的模型。

我们可以调试预览聊天的效果,并发布聊天助手,我们可以访问 http://0.0.0.0/chat/CAT4gZX5b5x8rLTS。

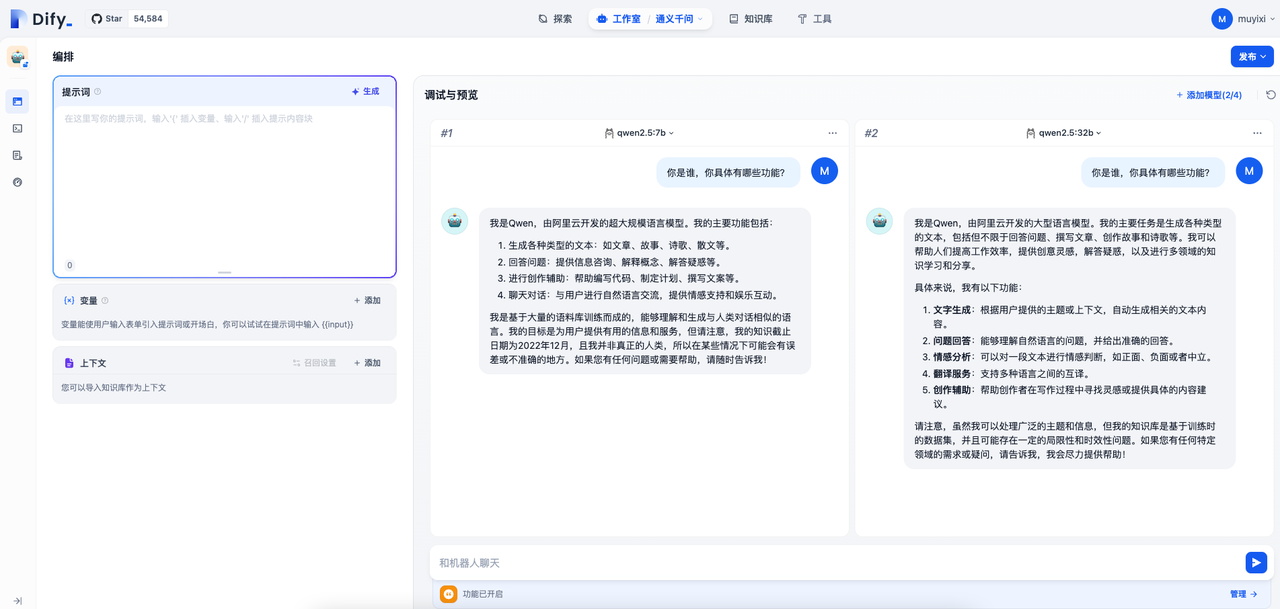

多个模型效果对比调试

添加知识库

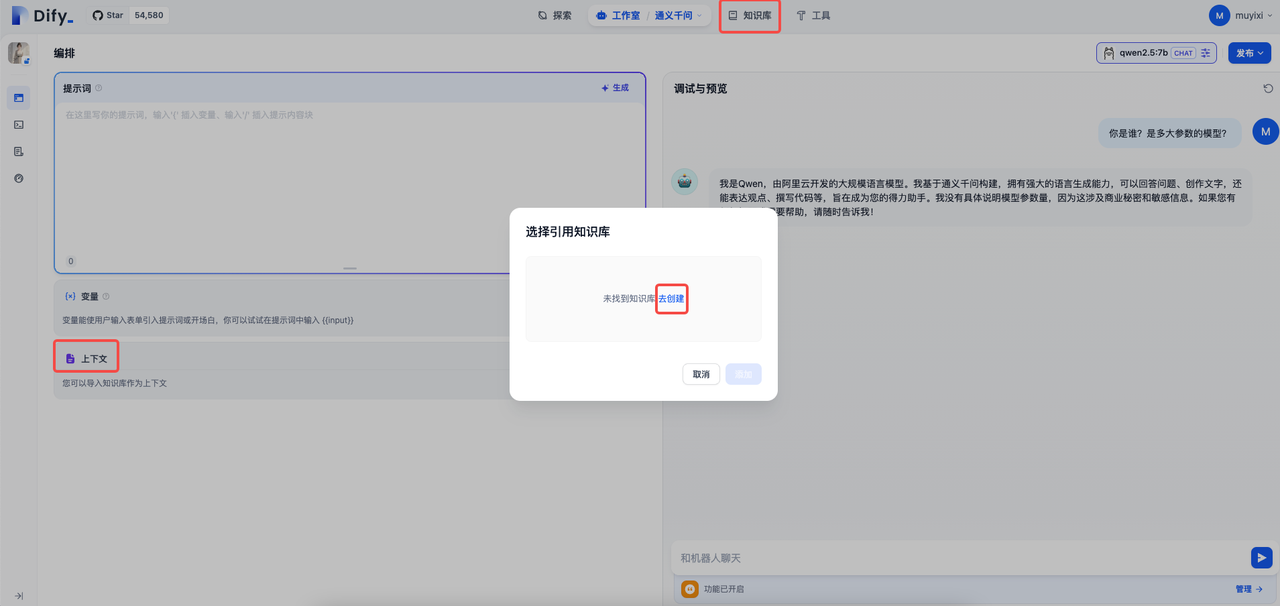

我们在聊天助手编排中,上下文处添加添加创建知识库,或者直接从导航栏的知识库进入创建知识库。

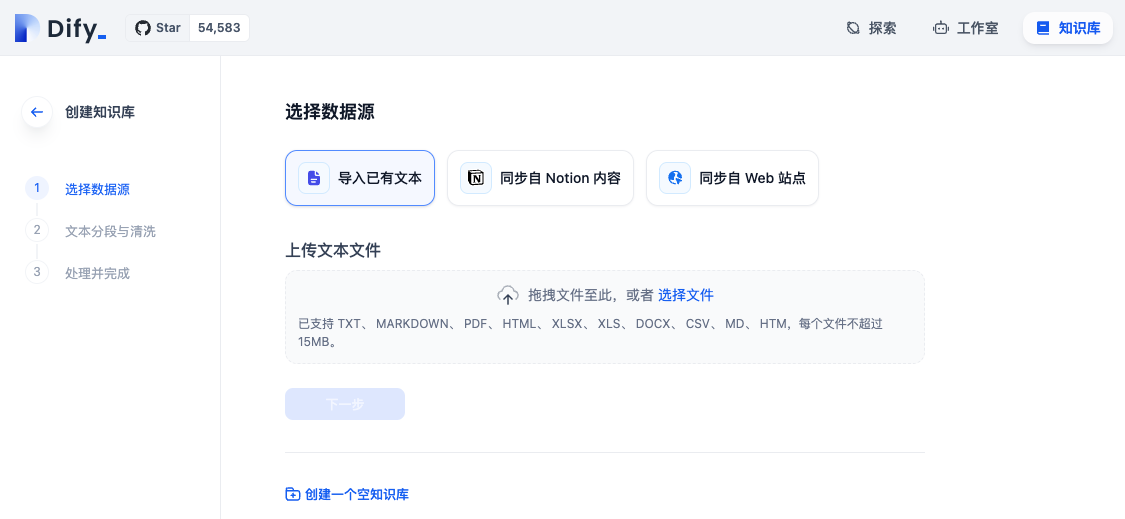

Dify的知识库创建支持导入已有文本,也支持同步自Notion内容或者同步自Web站点,这里我们选择导入已有文本。

知识库创建完成

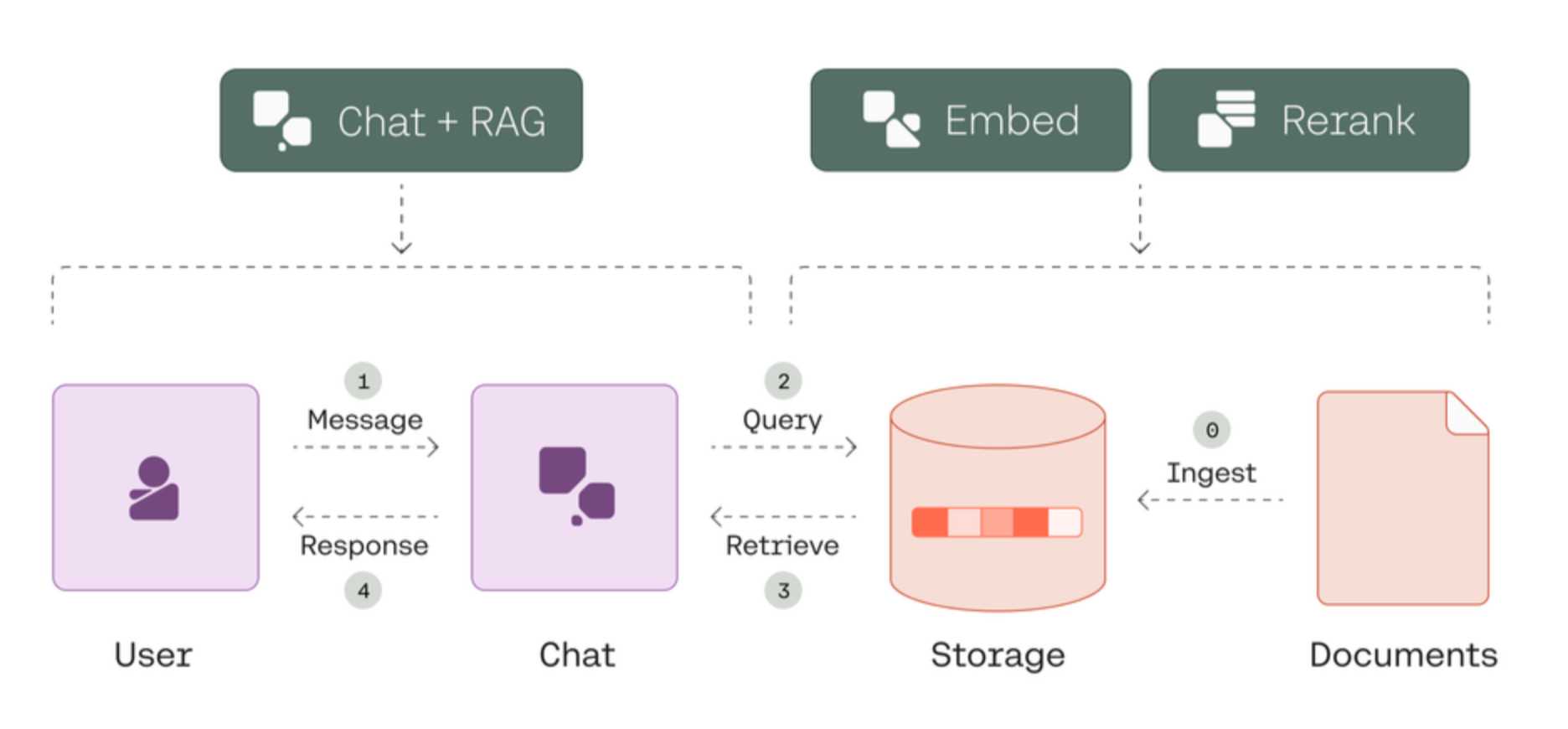

创建智能问答系统

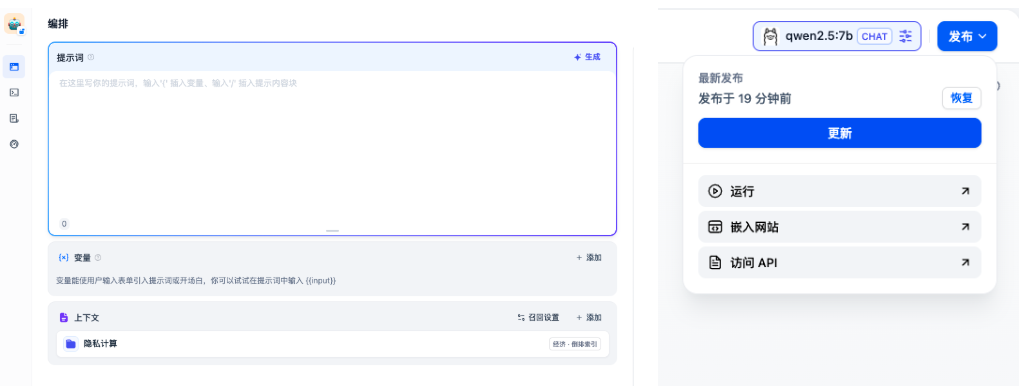

在我们的聊天助手编排中,上下文选择添加“隐私计算”知识库,点击发布更新。

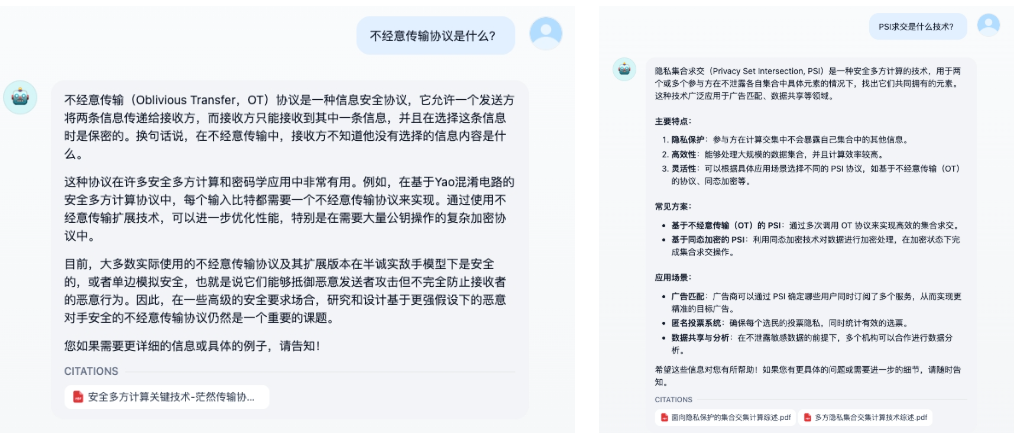

这样一个具有信息检索增强功能的聊天助手就创建完成了,我们来快速体验下。

下面是笔者到目前为止学习和整理的大模型相关的一些文章,欢迎感兴趣的小伙伴阅读+点赞+收藏。👍🏻👍🏻👍🏻

大模型学习之路

大模型知识篇

【大模型知识篇】论文解读:Transformer - Attention Is All You Need

【大模型知识篇】Transformer代码解读-从零开始实现

大模型体验篇

【大模型体验篇】文生图stable-diffusion-webui安装入门教程

【大模型体验篇】本地问答系统-部署Ollama、Open WebUI

【大模型体验篇】Vanna-ai基于检索增强(RAG)的sql生成框架

【大模型体验篇】AI半身数字人开箱体验 - 开源项目EchoMimicV2

大模型实战篇

【大模型实战篇】NVIDIA TensorRT-LLM 大模型推理框架实践

【大模型实战篇】LLaMA-Factory大模型微调实践 - 从零开始

3866

3866

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?