系列文章目录

玩转大语言模型——使用langchain和Ollama本地部署大语言模型

玩转大语言模型——三分钟教你用langchain+提示词工程获得猫娘女友

玩转大语言模型——ollama导入huggingface下载的模型

玩转大语言模型——langchain调用ollama视觉多模态语言模型

玩转大语言模型——使用transformers中的pipeline调用huggingface中模型

玩转大语言模型——transformers微调huggingface格式的中文Bert模型

玩转大语言模型——使用GraphRAG+Ollama构建知识图谱

玩转大语言模型——完美解决GraphRAG构建的知识图谱全为英文的问题

玩转大语言模型——配置图数据库Neo4j(含apoc插件)并导入GraphRAG生成的知识图谱

玩转大语言模型——本地部署带聊天界面deepseek R1的小白教程

玩转大语言模型——本地部署deepseek R1和本地数据库的小白教程(Ollama+AnythingLLM)

玩转大语言模型——使用LM Studio在本地部署deepseek R1的零基础)教程

玩转大语言模型——Ubuntu系统环境下使用llama.cpp进行CPU与GPU混合推理deepseek

玩转大语言模型——使用Kiln AI可视化环境进行大语言模型微调数据合成

文章目录

前言

最近deepseek模型可谓是非常火爆,尤其是deepseek R1的逻辑能力,并且deepseek R1还开放了多种参数大小的蒸馏模型,使得本地部署成为了可能。在本系列中上一篇介绍了在本地部署deepseek R1的用法,本篇将介绍如何部署本地大模型的数据库。

Ollama

下载ollama

下载安装ollama的过程如果之前有按照步骤配置过,可以跳过直接下载AnythingLLM.

Ollama官网:https://ollama.com/

点击下载,选择符合自己系统的版本,点击下载

下载后按照提示安装即可

下载模型

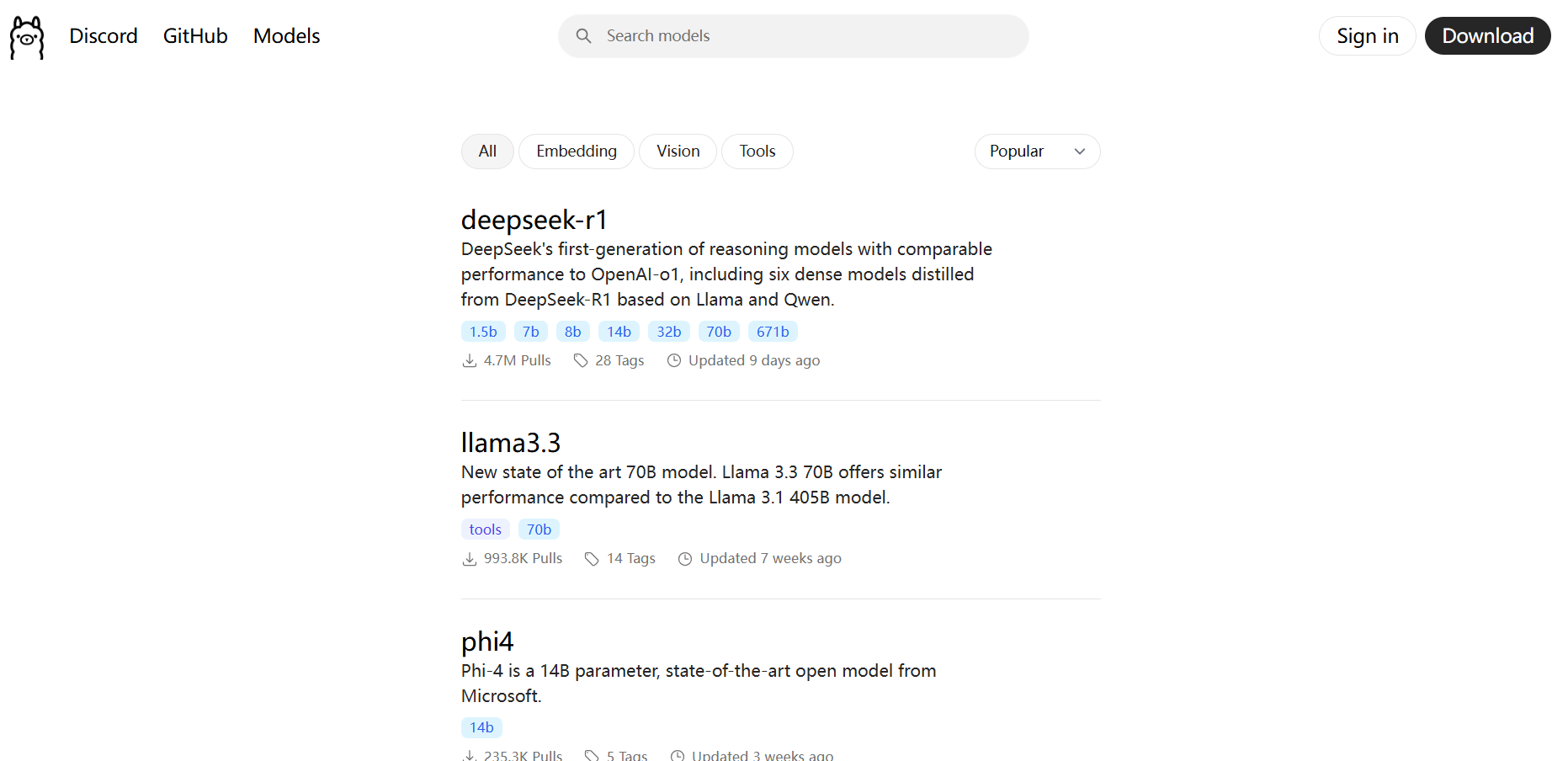

回到官网,点击左上角的Models

点击后可以看到会有众多支持的模型

可以看到现在deepseek-r1排第一,直接点进去就可以,如果没有可以在上方搜索查找deepseek-r1

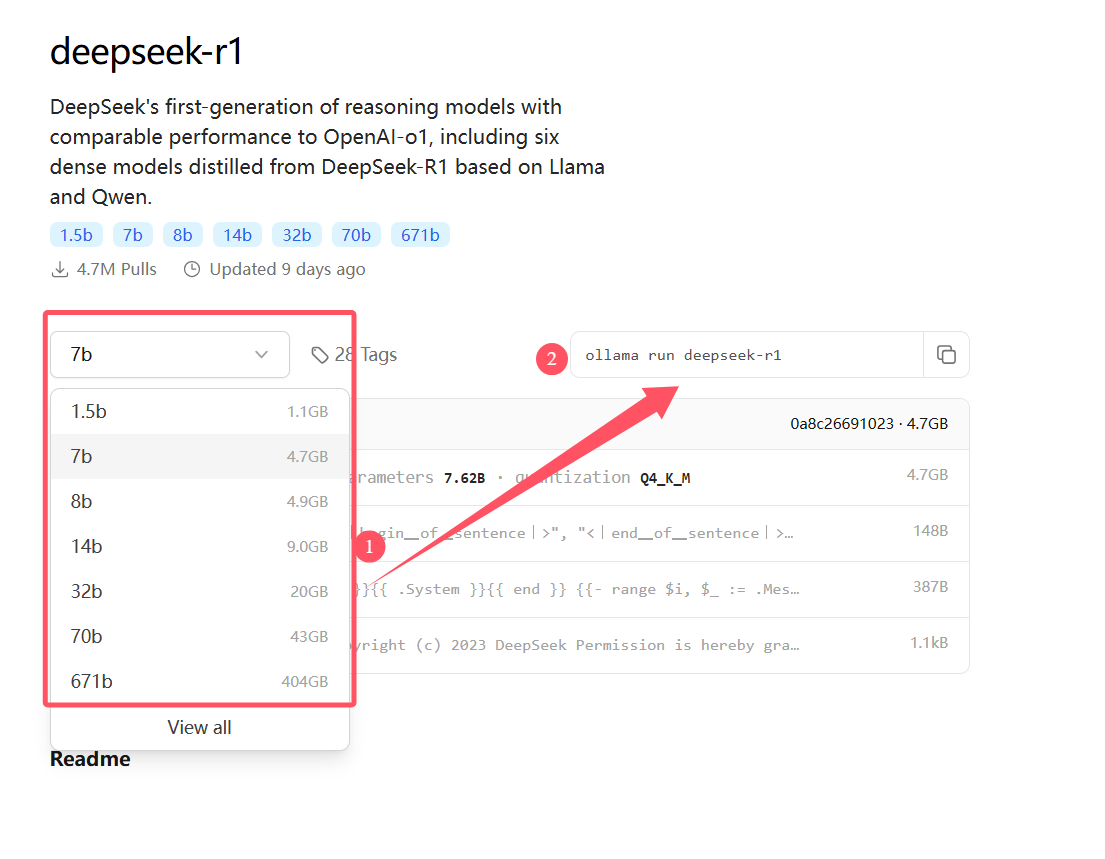

左侧选模型参数范围,一般越大能力越强,默认是7b的模型,选择好模型之后可以复制右侧的命令到命令行执行,会自动下载并运行模型,笔者的显卡是3060(6G显存),选择的是14b的模型,读者可以自行选择合适的大小。

只有第一次执行命令时会下载模型,下载过一次后执行命令会直接启动模型。如果只是下载模型而不需要在命令行启动模型,可以将run换成pull。

AnythingLLM

下载安装AnythingLLM

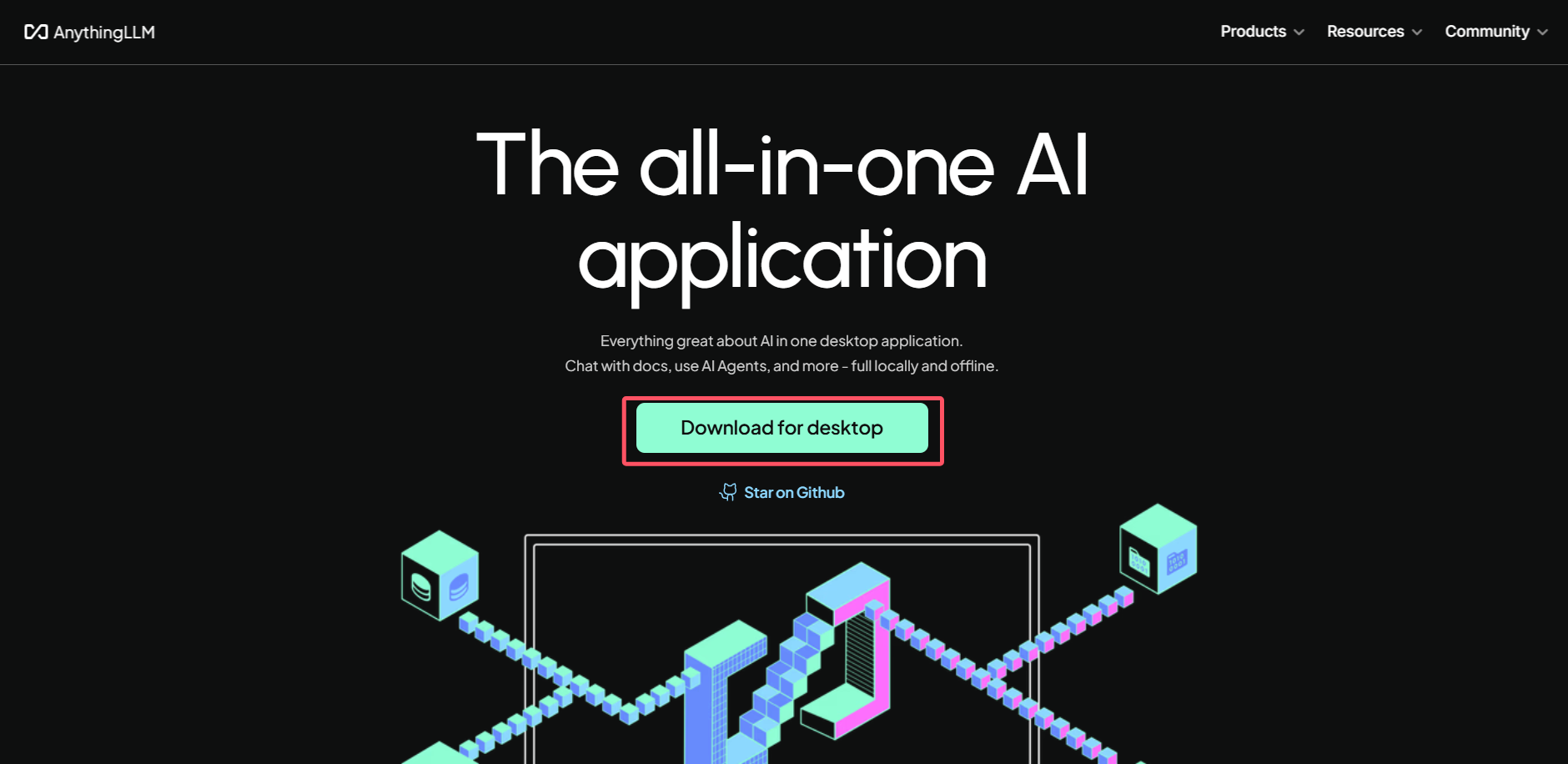

AnythingLLM官网:https://anythingllm.com/

进入官网后经过人机验证后进入以下界面点击下载

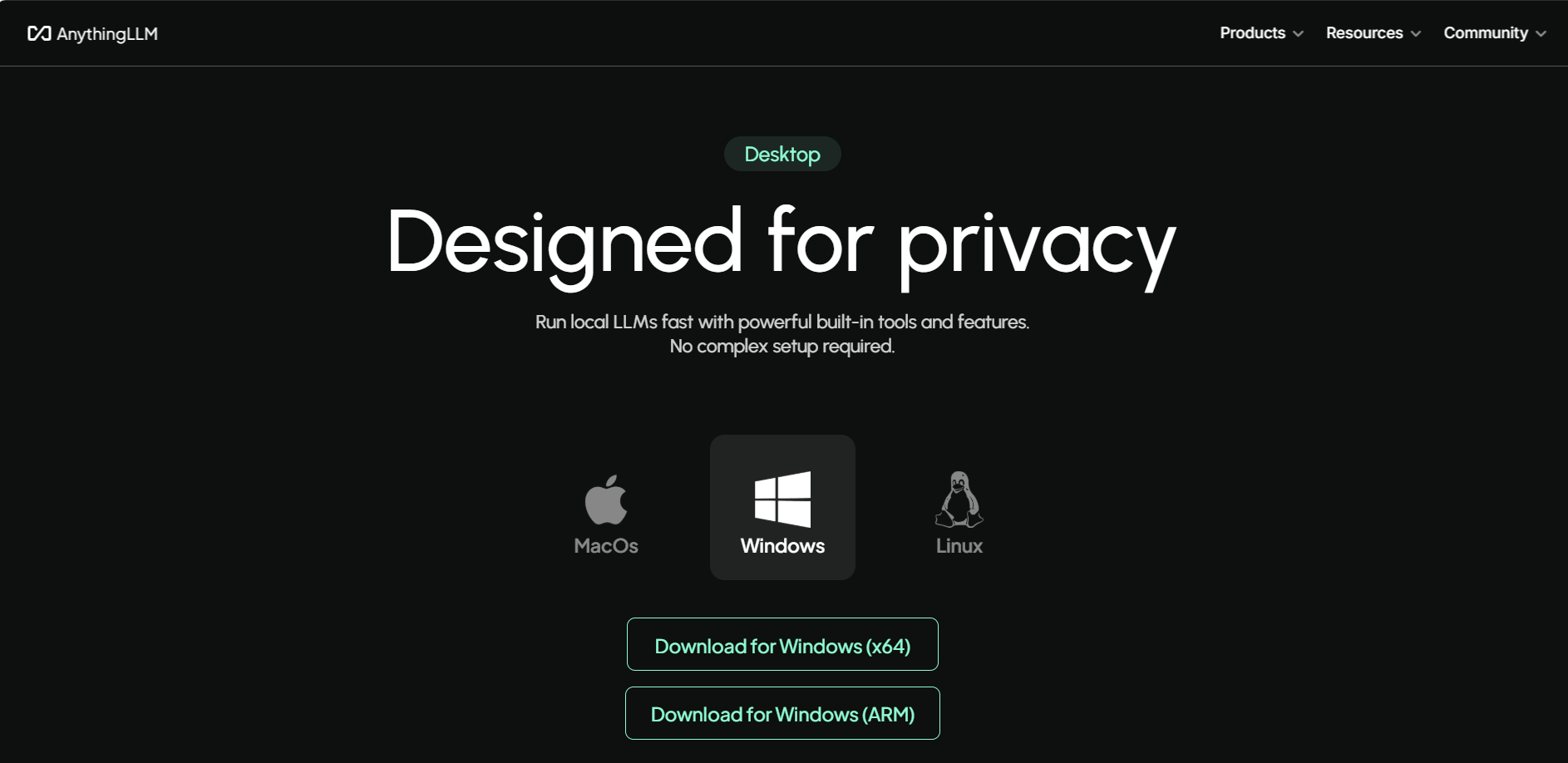

选择符合自己电脑配置的版本下载

如果点击下载后出现下图情况

可以在下载按钮右键单击鼠标,复制下载链接到迅雷下载。

下载后根据引导安装即可。

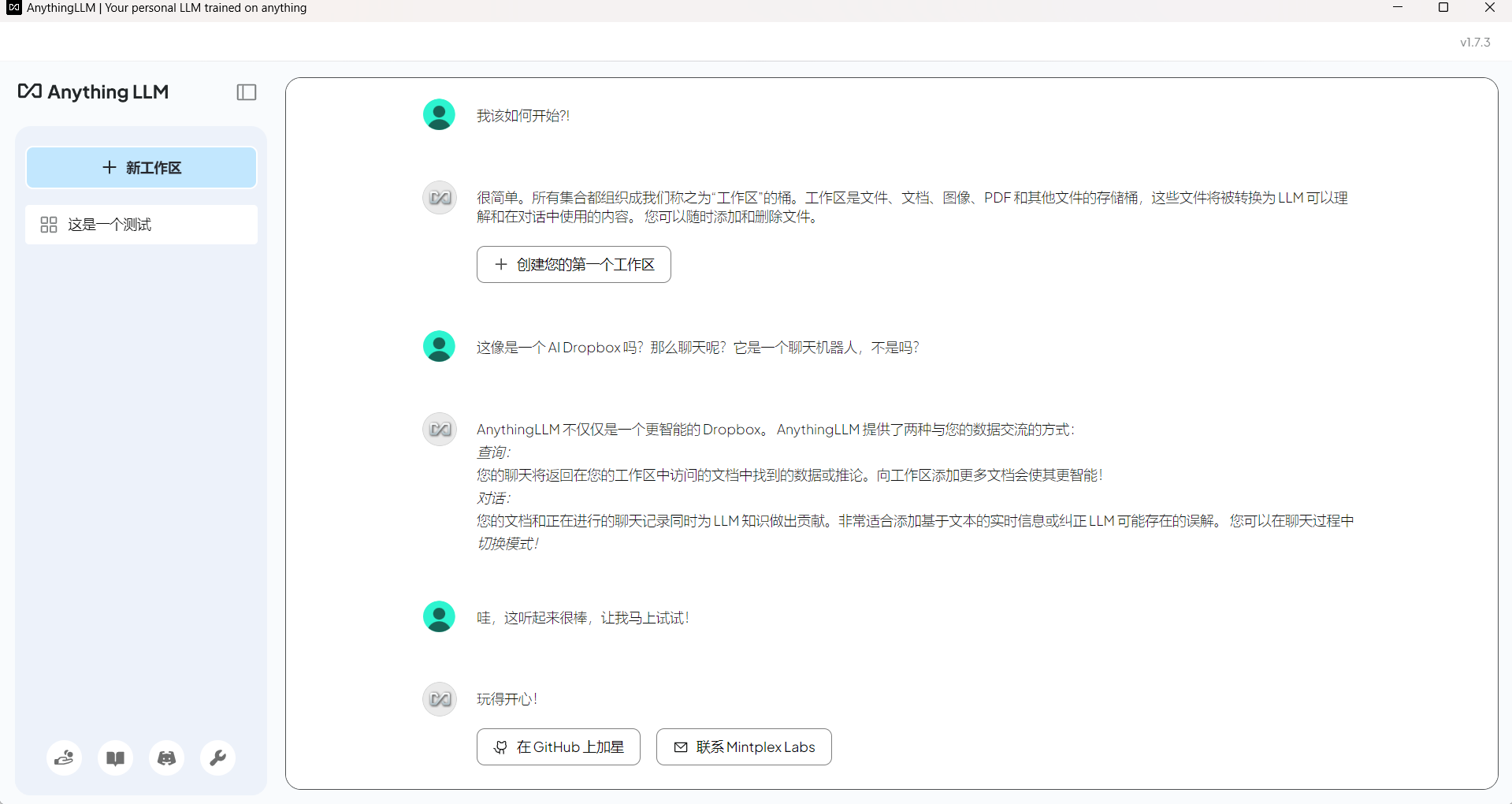

初试Anything LLM

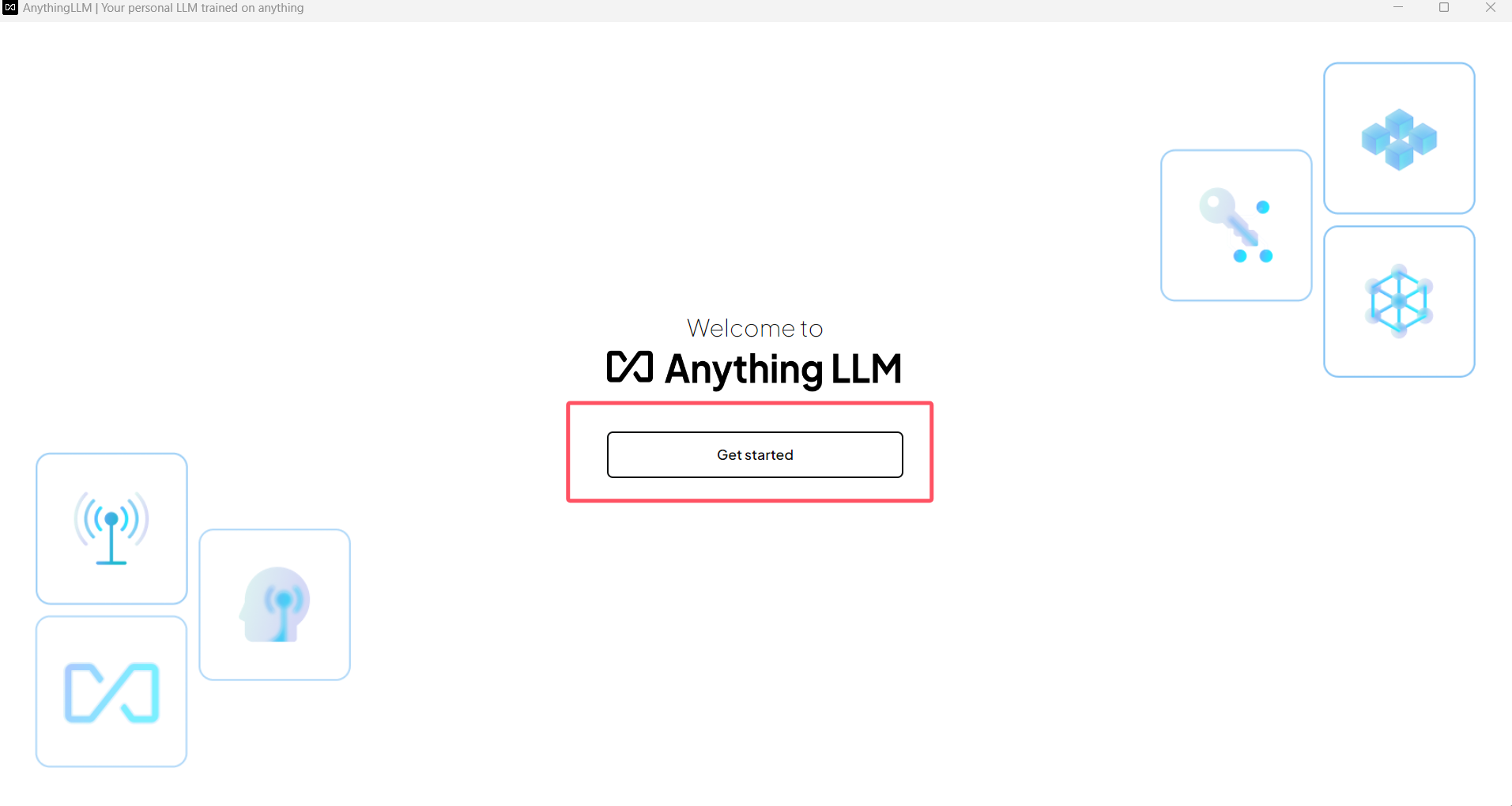

点击按钮Get started

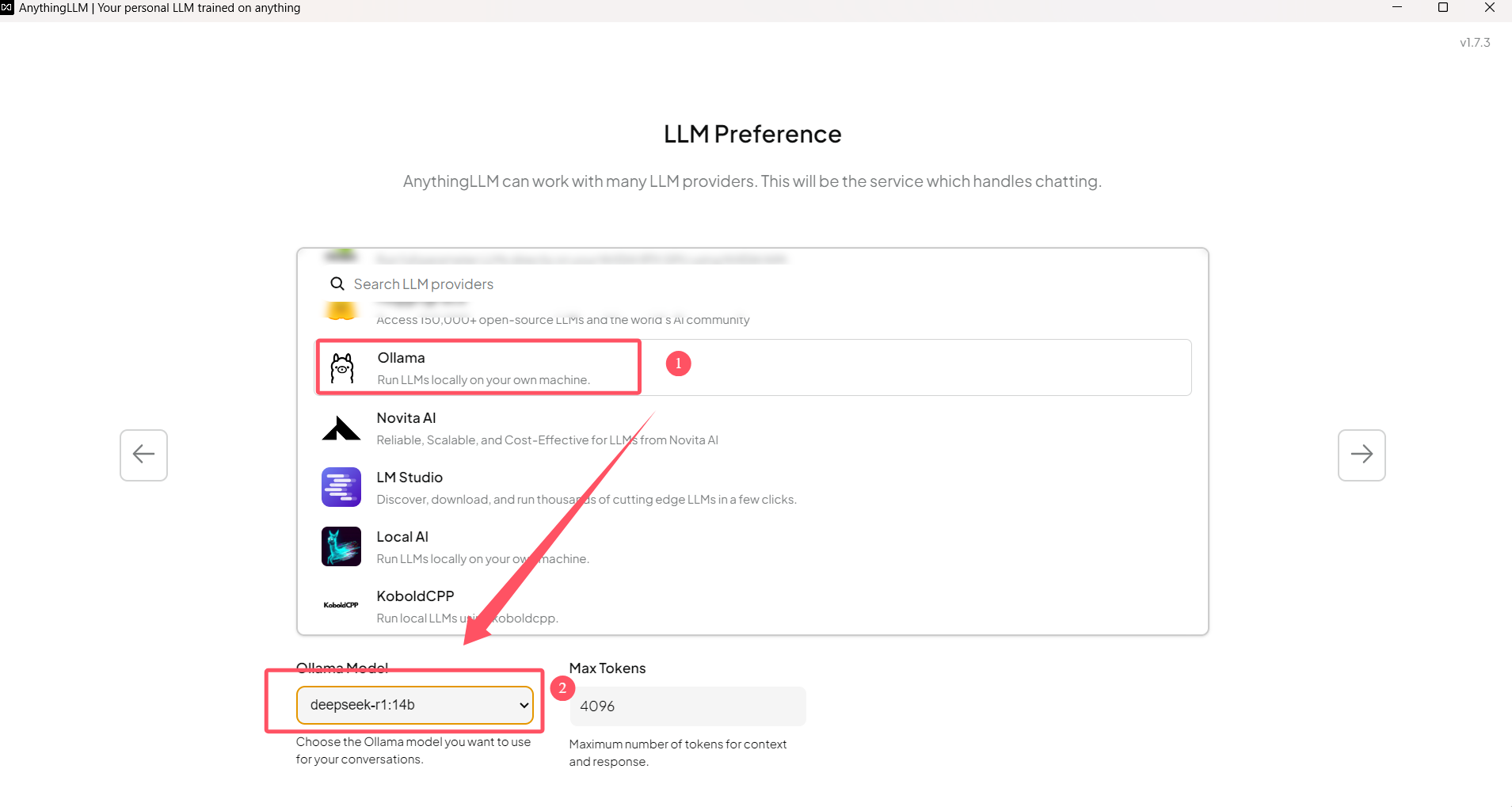

然后选择Ollama并选择模型

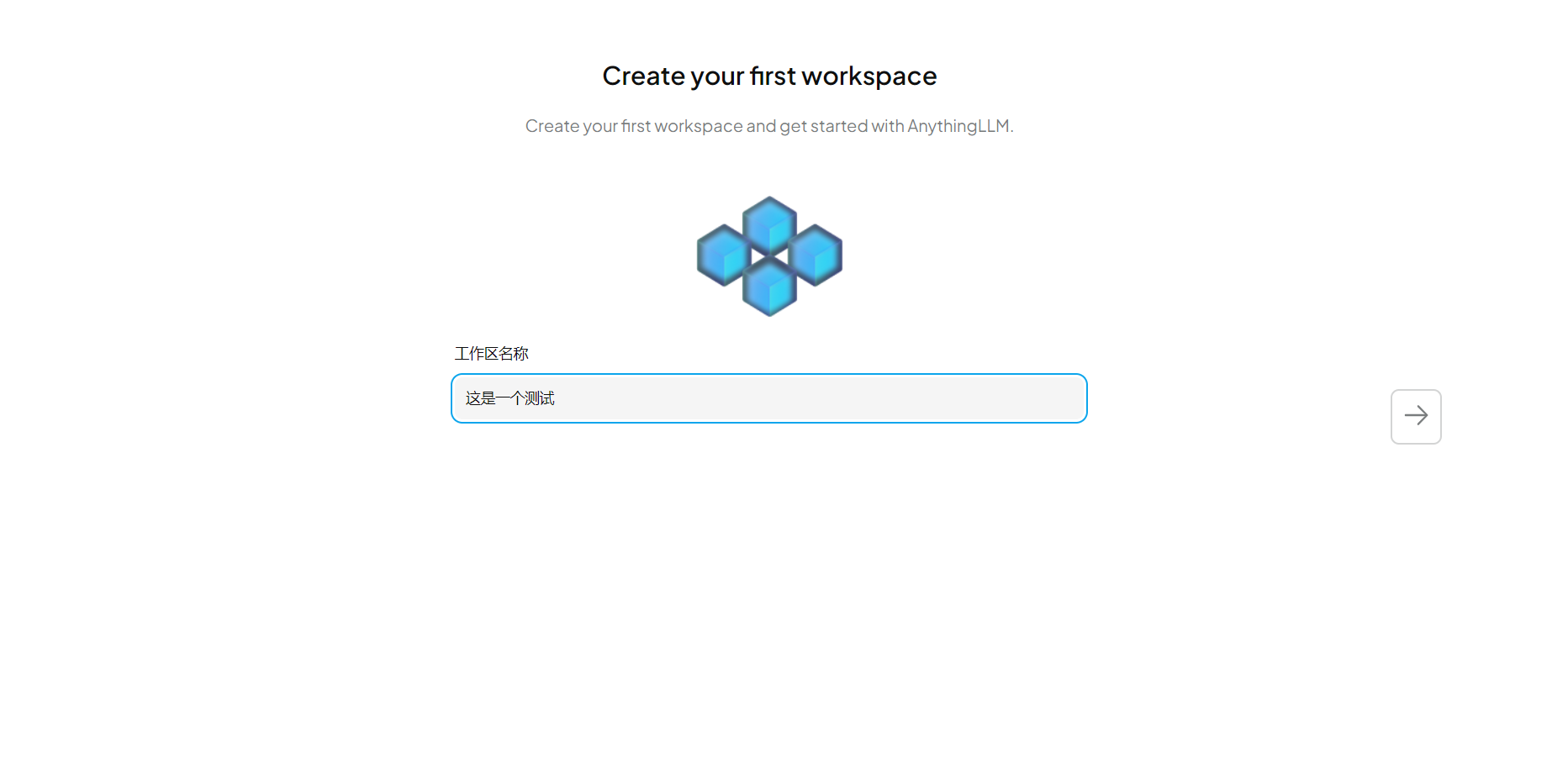

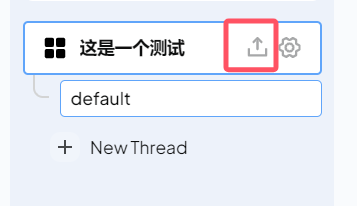

然后一直点右边的箭头,到以下界面需要输出一个工作区名称,笔者为了省事就写作这是一个测试

然后点击右箭头

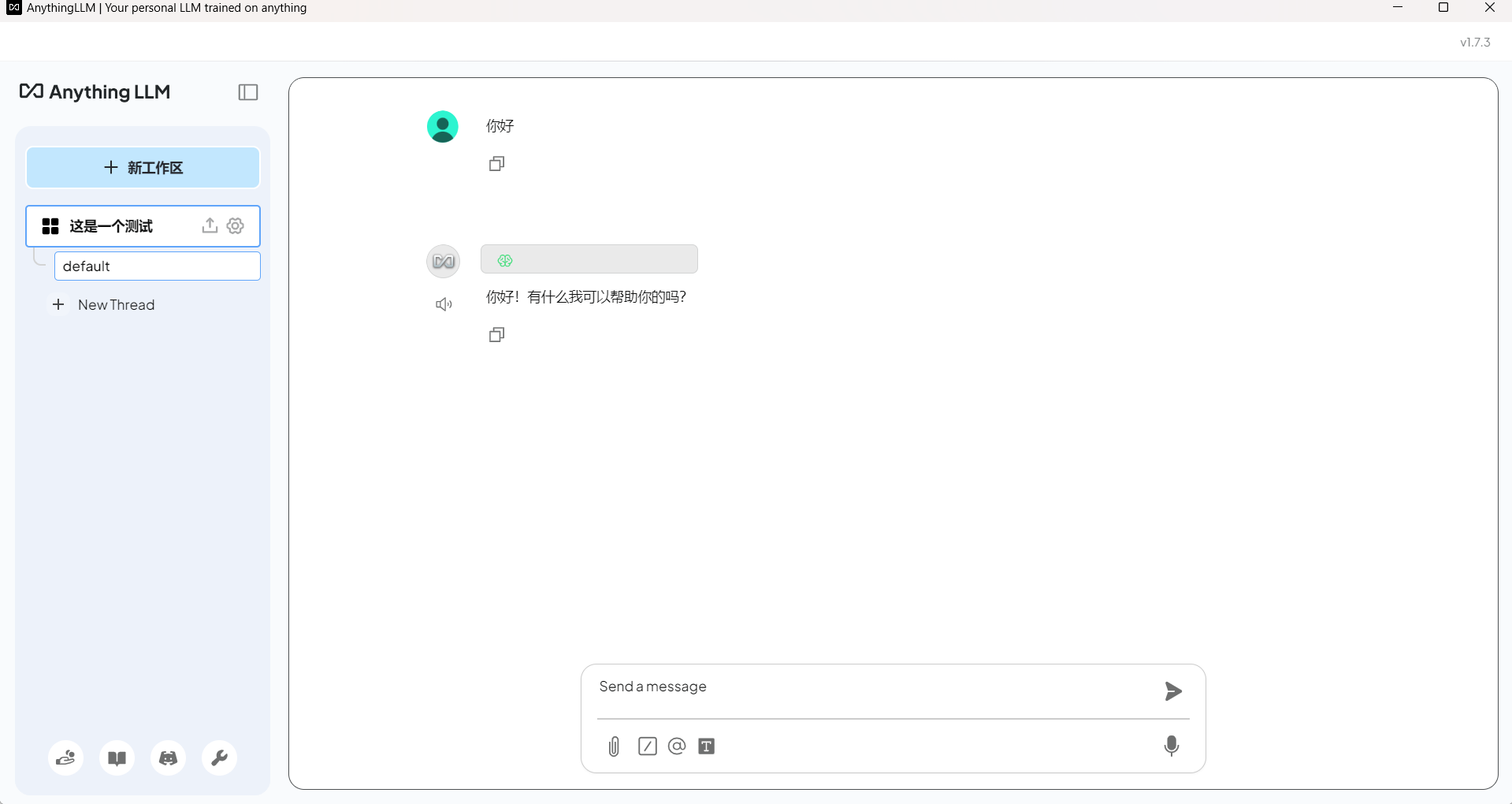

随后点击新建的工作区就可以对话了,笔者点击的是“这是一个测试”。

配置AnythingLLM设置

点击设置,选择ollama,然后选择deepseek模型

修改提示词后更新设置

构建本地数据库

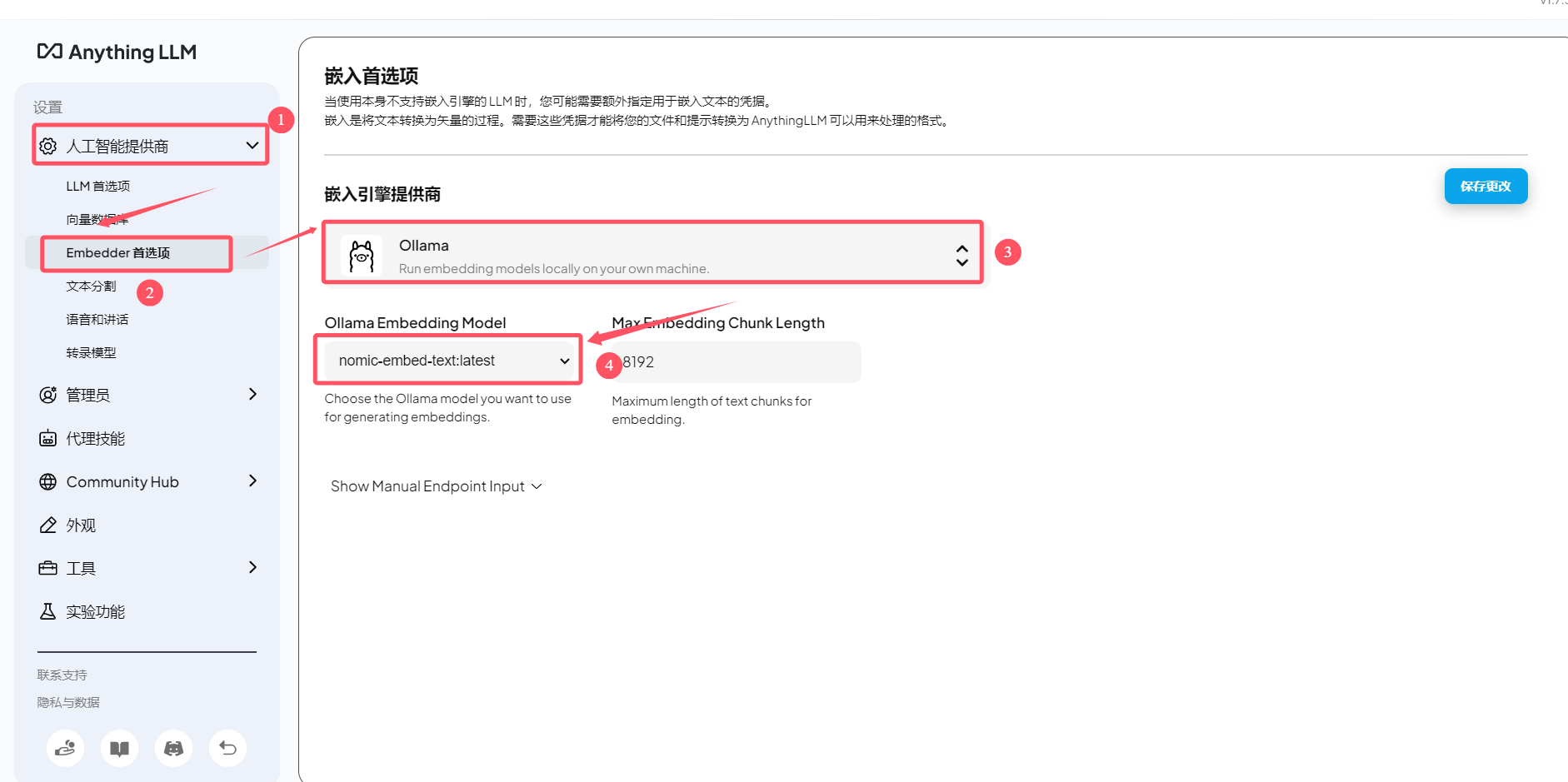

下载embedding模型

打开命令行,输入

ollama pull nomic-embed-text

下载完成后打开左下角的扳手按钮

切换到新下载的embedding模型后点保存更改

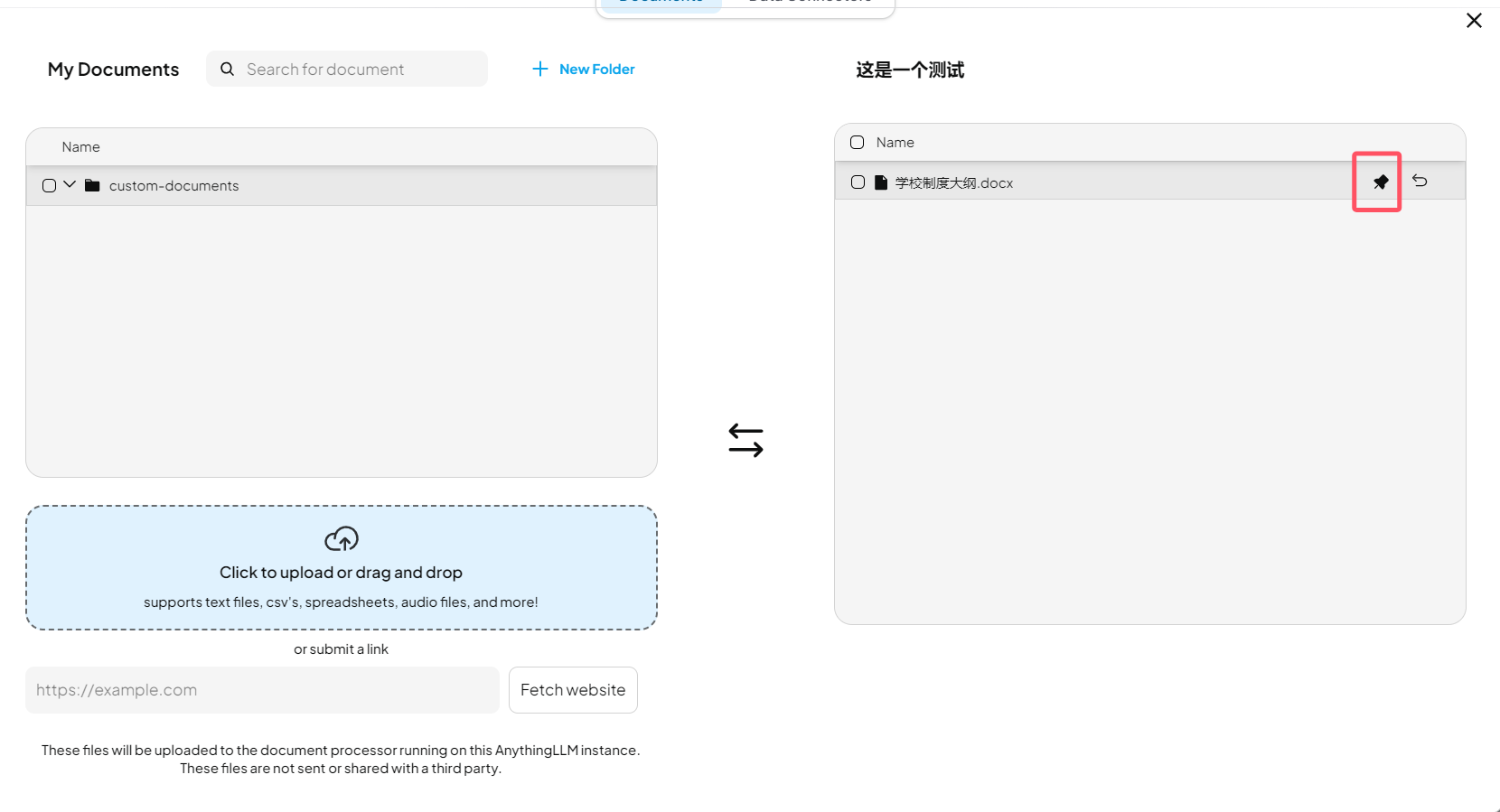

上传数据库

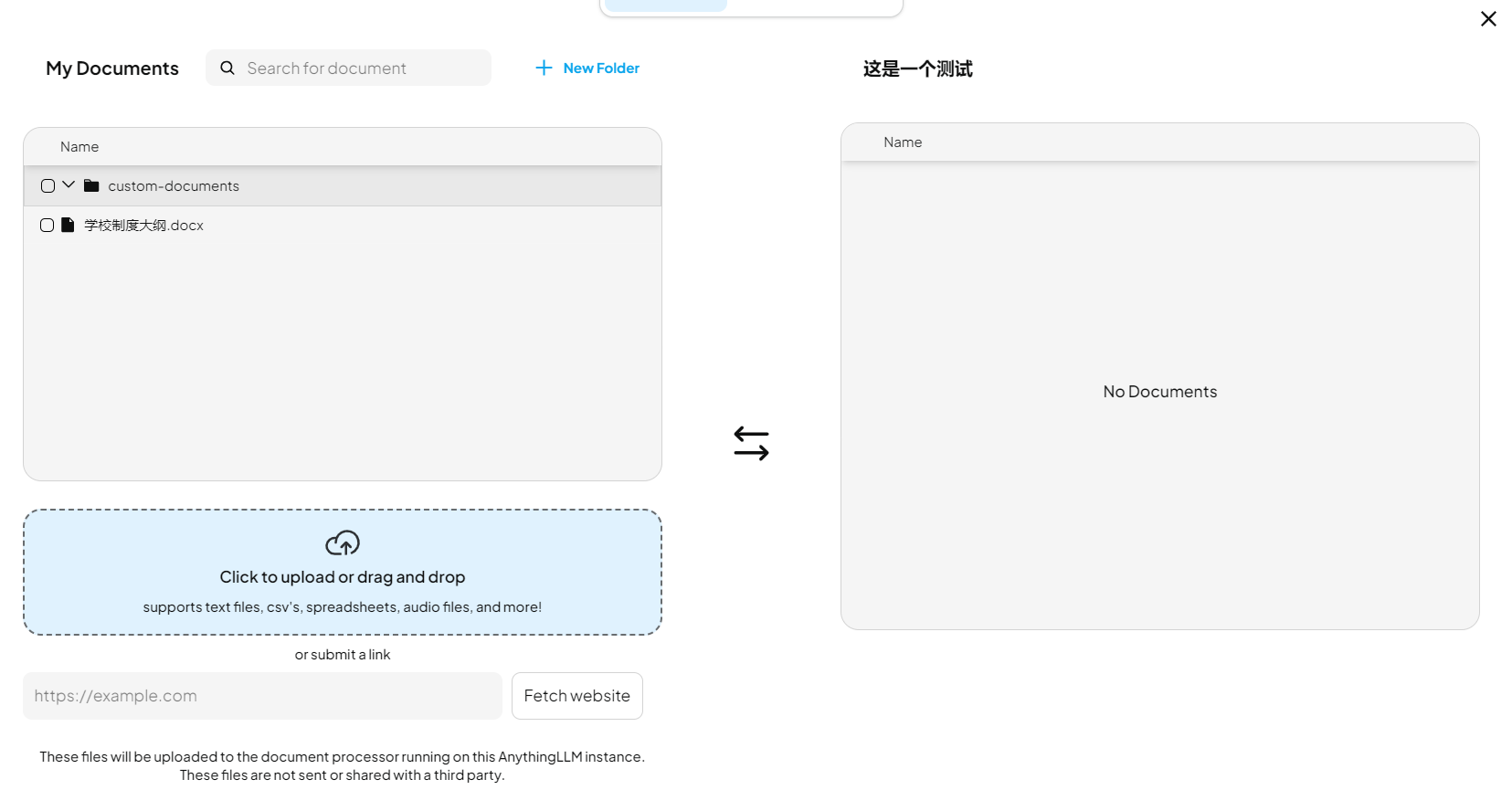

点击左侧这个按钮上传数据

点击这个区域上传文件

笔者这里上传的是AI生成的学校制度大纲

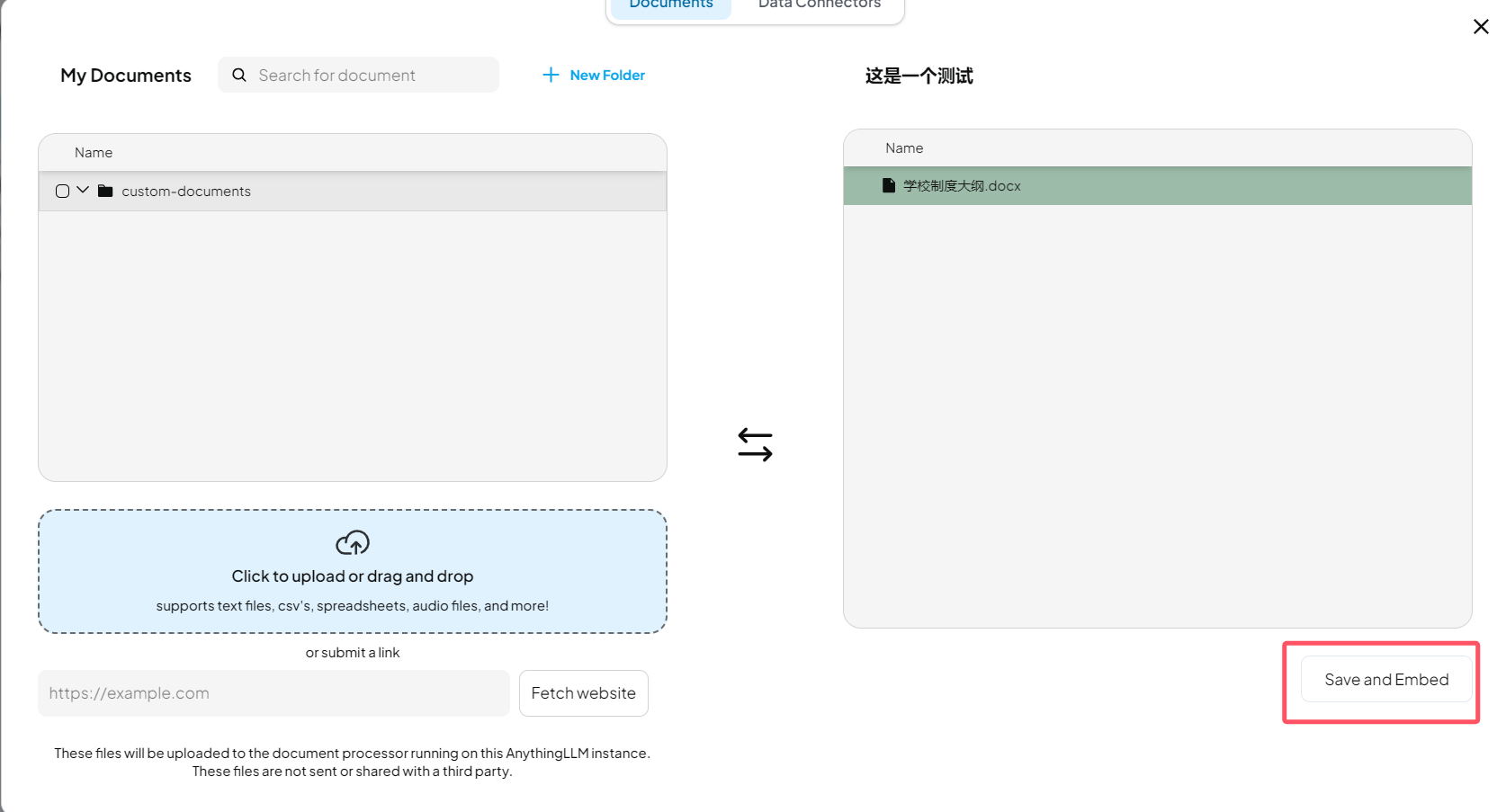

选中新上传的文件,将文件移动到工作区

然后点Save and Embed进行保存

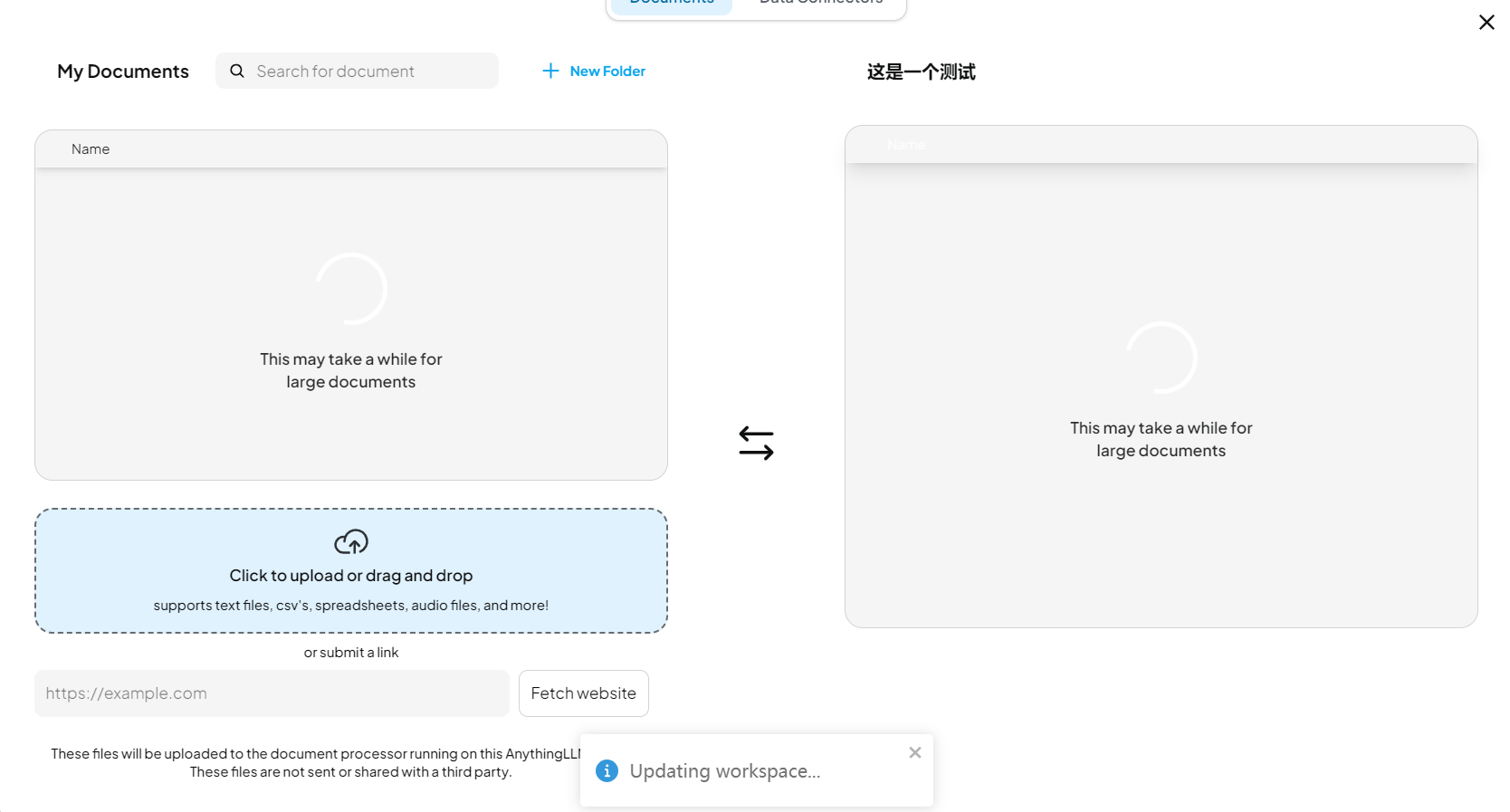

如果出现下面这种转圈的情况不要担心,等他转完就好

出现以下提示说明保存成功

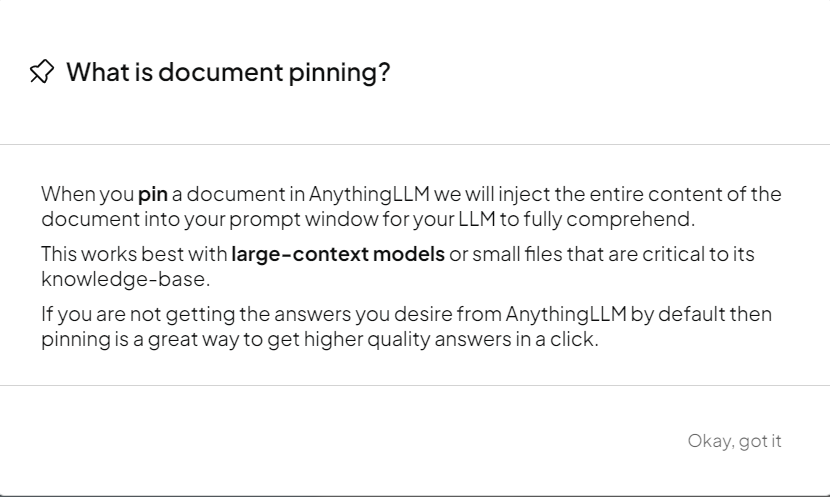

可以选择点击这个按钮将文档Pin在工作区(可不选)

如果出现以下提示,选Okay,got it

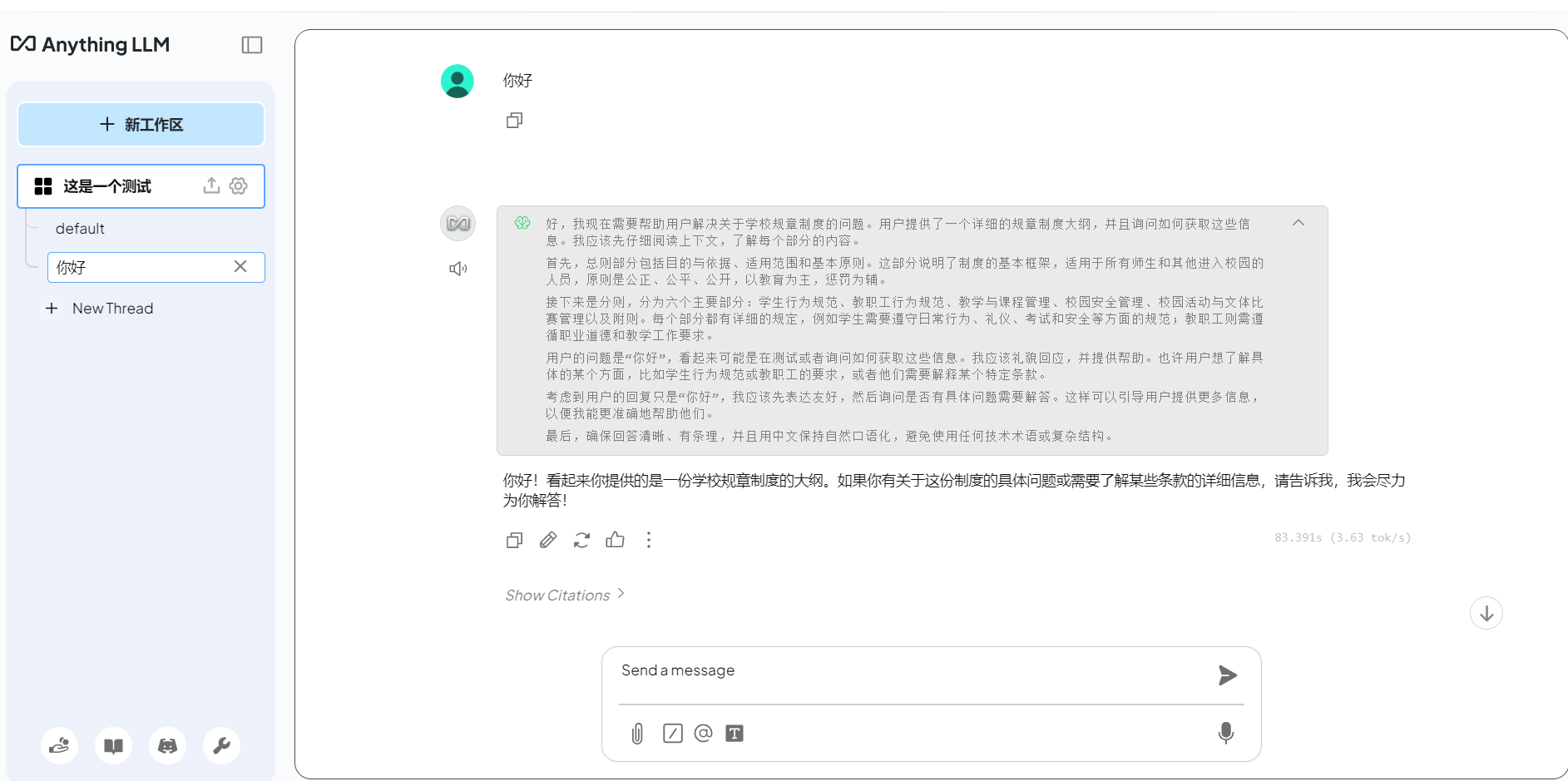

测试

新建一个对话测试

这里可以看到模型已经识别到了文档信息了

1759

1759