作者 | 路边野餐 编辑 | 汽车人

原文链接:https://www.zhihu.com/question/363919550/answer/1982689792

点击下方卡片,关注“自动驾驶之心”公众号

ADAS巨卷干货,即可获取

点击进入→自动驾驶之心【多传感器融合】技术交流群

后台回复【相机标定】获取超详细的单目双目相机模型介绍、内外参标定算法原理视频!

刚好最近在研究车上多传感器时间同步的问题,车上一般传感器包括:camera,Radar, Lidar, gnss,rtk,组合导航,轮速计等等。那么常见的传感器间时间同步主要涉及到camera, radar, lidar, imu等。对于如何实现传感器的时间同步,以及时间同步一般包括哪些内容,可能需要从以下几个方面考虑:

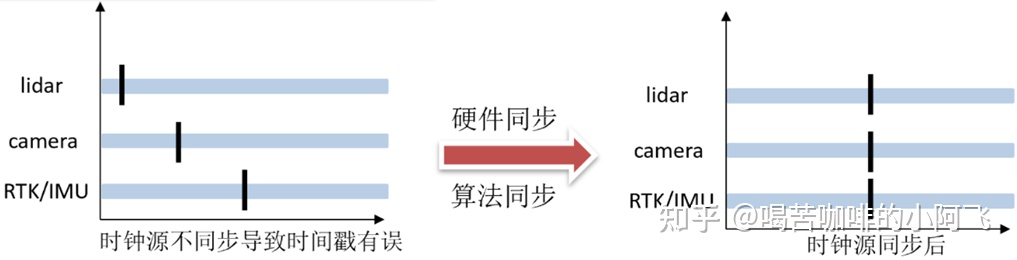

1)统一时钟源

由于每个传感器都有自己的时间戳,这里 统一时钟就是来同步不同传感器时间戳的。如果传感器支持硬件触发的情况下,可以采用GPS时间戳作为基准进行硬件触发,这时传感器给出的数据中包含的时间戳即为全局时间戳(GPS时间戳)而非传感器时间戳。

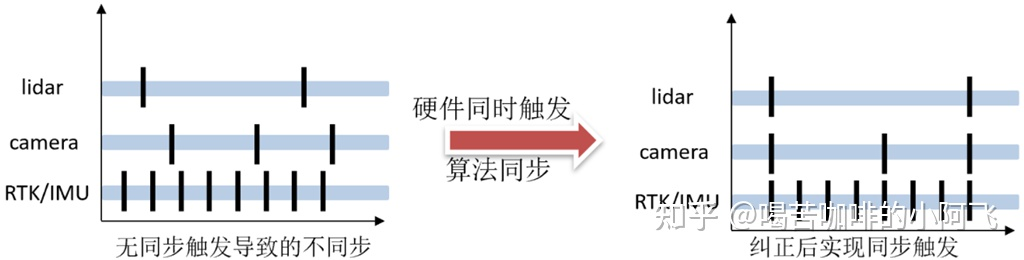

2)硬件同步触发传感器

另外,由于每种传感器的采样频率不一致,如lidar通常为10Hz,camera通常为25/30Hz,不同传感器之间的数据传输还存在一定的延迟,那么可以通过寻找相邻时间戳的方法找到最近邻帧,但如果两个时间戳相差较大,且传感器或障碍物又在运动,那么最终会得到较大的同步误差。这个情况可以采用硬同步触发的方法来缓解查找时间戳造成的误差现象,也可以调整传感器的固有频率,如将相机调整为20Hz,减少时间差问题。

3)各种传感器的时间戳

a) GPS/GNSS时间戳:

GPS时间指的是GPS原子时,是以UTC时间1980年1月6日0时0分0秒为时间基准,以后按照TAI秒长累计计时。

b) 相机时间戳

自动驾驶上使用rolling shutter相机是支持外部触发曝光的,但由于相机帧周期包括曝光时间和readout时间(整帧像素点读出),所以需要关注曝光时间,对于相同cmos芯片的相机,其readout时间是固定的,来反推图像真实时间戳(一般采用曝光中间时间)。

c) 激光雷达时间戳

d) 毫米波雷达时间戳

e) IMU时间戳

4)传感器间时间软同步

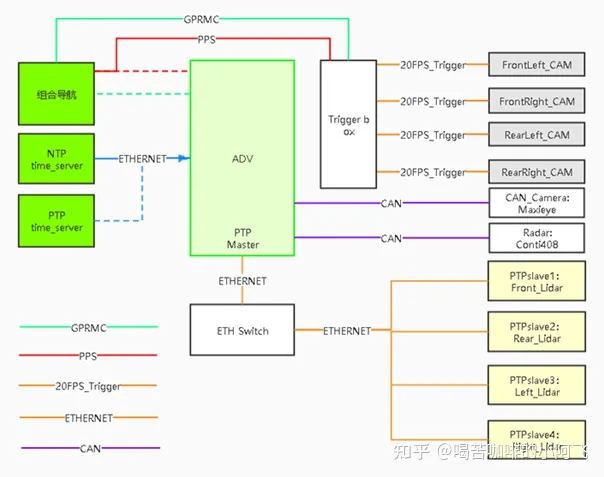

最后整体了解下车端传感器时间硬件同步的一个接线图,如下:

这个图中激光雷达和相机时硬件时间同步一个示例,因为激光雷达支持两种时间同步方法,而相机一般只是支持外部触发,一般采用基于GPS的时间同步机制。激光雷达采用的是基于IEEE 1588的以太网时间同步机制。

【自动驾驶之心】全栈技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦目标检测、语义分割、全景分割、实例分割、关键点检测、车道线、目标跟踪、3D目标检测、BEV感知、多传感器融合、SLAM、光流估计、深度估计、轨迹预测、高精地图、NeRF、规划控制、模型部署落地、自动驾驶仿真测试、硬件配置、AI求职交流等方向;

添加汽车人助理微信邀请入群

备注:学校/公司+方向+昵称

车载传感器时间同步技术在自动驾驶中的应用

车载传感器时间同步技术在自动驾驶中的应用

508

508

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?