前言

“大力出奇迹”——这似乎已成为AI领域的黄金法则。从GPT-1的1.17亿参数到GPT-4的万亿级别,模型规模的指数级增长带来了惊人的能力涌现。我们似乎相信,只要数据够多、参数够大,一切问题都能被“暴力”解决。

然而,一篇由谷歌DeepMind、Meta、斯坦福等多家顶尖机构联合发表的论文系统性地论证了,无论模型如何扩展,都无法完全摆脱这些与生俱来的枷锁。

论文标题:On the Fundamental Limits of LLMs at Scale

ArXiv URL:http://arxiv.org/abs/2511.12869v1

然而,一篇由谷歌DeepMind、Meta、斯坦福等多家顶尖机构联合发表的论文,为这股狂热的“规模崇拜”踩下了理论的刹车。研究指出,LLM的性能提升并非无限,而是受制于五个根本性的“理论天花板”。

这篇雄文系统性地论证了,无论模型如何扩展,都无法完全摆脱这些与生俱来的枷锁。

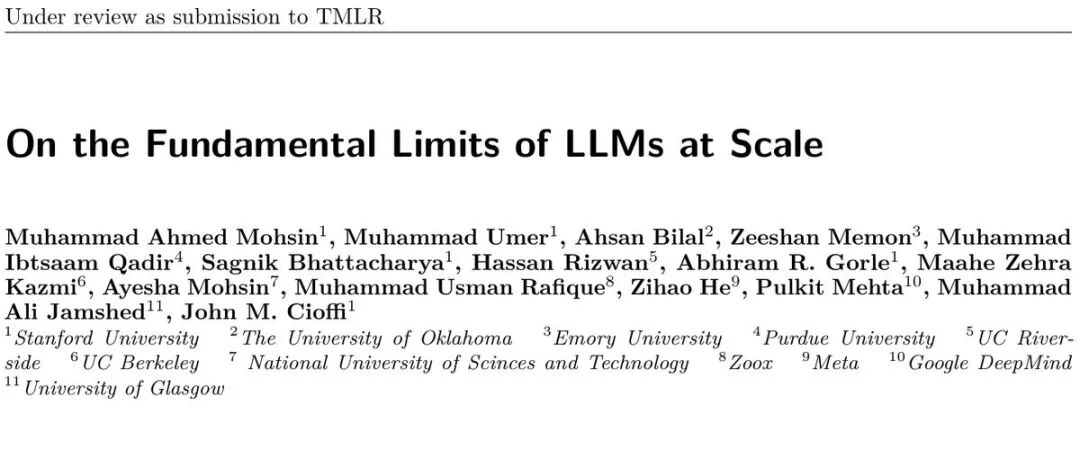

LLM无法逾越的五大极限

该研究确定了五个相互关联、且无法仅通过扩大规模来解决的核心限制:

-

- 幻觉 (Hallucination):模型会“一本正经地胡说八道”。

-

- 上下文压缩 (Context Compression):长达百万的上下文窗口,有效利用率却远低于此。

-

- 推理退化 (Reasoning Degradation):模型更擅长模式匹配,而非真正的逻辑推理。

-

- 检索脆弱性 (Retrieval Fragility):RAG系统在检索和整合信息时存在固有缺陷。

-

- 多模态错位 (Multimodal Misalignment):语言和视觉等不同模态的信息难以完美对齐。

本文将重点解读论文中关于“幻觉”的深刻剖析,看看为何它是LLM无法根除的原罪。

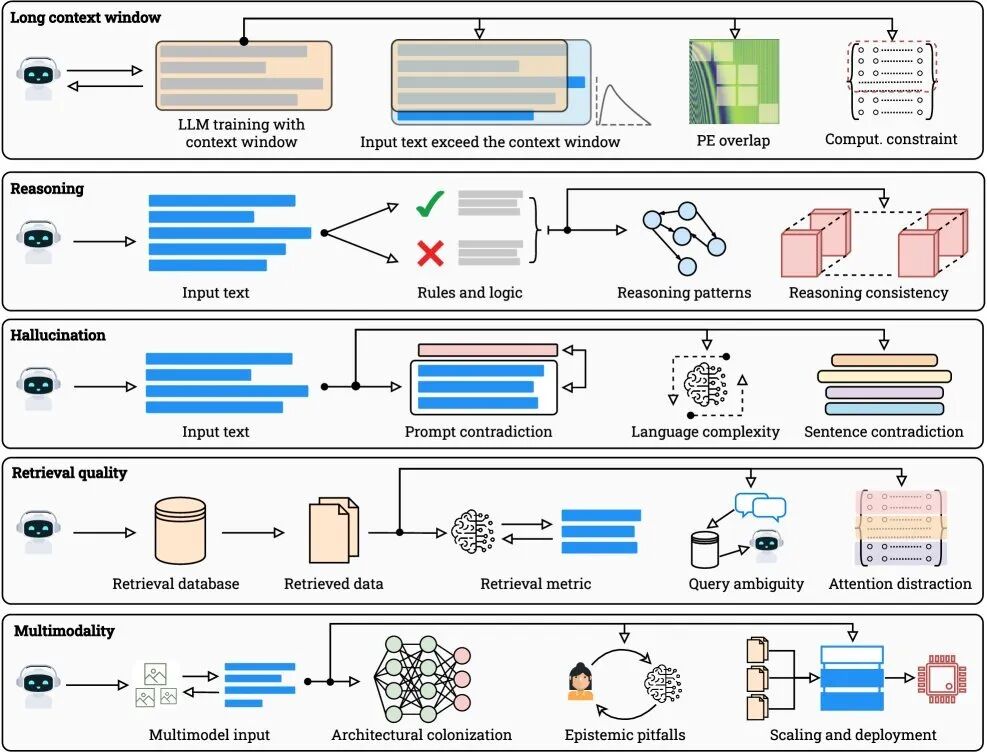

为何幻觉无法根除?三大理论极限

许多人认为幻觉是数据不足或对齐不够导致的工程问题。但该研究从数学和理论层面证明,幻觉是不可避免的。

1. 可计算性与不可计算性边界

首先是可计算性理论(Computability Theory)的限制。一个惊人的结论源于哥德尔和图灵的理论:

- • 对角论证(Diagonalization):对于任何一个可被列举出来的LLM模型集合,我们总能构造出一个“刁钻”的问题,使得集合中的每一个模型都会出错。这意味着不存在一个“全知全能”的LLM。

- • 不可判定问题(Undecidable Problems):像著名的“停机问题”(Halting Problem)在理论上是无法被任何算法解决的。当LLM被问及这类问题时,它要么拒绝回答,要么必然产生幻觉。

简单说,LLM作为一种计算设备,其能力有着数学上的明确边界。

2. 信息论与统计学限制

即便问题是可计算的,信息和统计规律也给出了另一重枷锁。

- • 信息瓶颈:任何有限大小的模型(无论参数多大),其描述能力都是有限的。它无法无损地压缩和存储世界上无限的知识。就像用一张有限大小的图片去完美表示一幅无限细节的画,信息丢失和失真是必然的。

- • 样本复杂度:要让模型准确记住所有“长尾知识”(即罕见事实),理论上需要天文数字般的训练样本。例如,要让模型对 个独立事实的错误率低于 ,所需的样本量 与 成正比,即 。这在实践中几乎不可能实现。

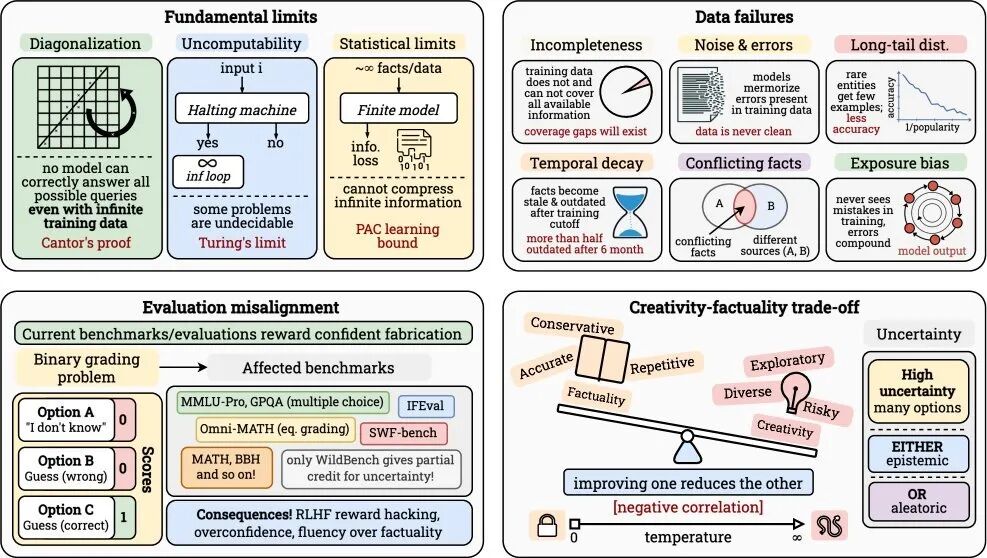

数据原罪:不完美的世界,不完美的模型

理论极限设定了幻觉的下限,而训练数据中的固有缺陷则在现实中将这个问题无限放大。

- • 不完整与过时:训练数据只是世界的一个有限快照。知识在不断更新,而模型却被“困在”了过去。如下图所示,时效性强的信息在短短6个月后,其有效性就可能下降到50%以下。

- • 噪声与长尾效应:网络数据充斥着错误、偏见和矛盾信息。同时,知识分布极不均衡,模型对高频知识滚瓜烂熟,对低频的“长尾”知识则常常出错。

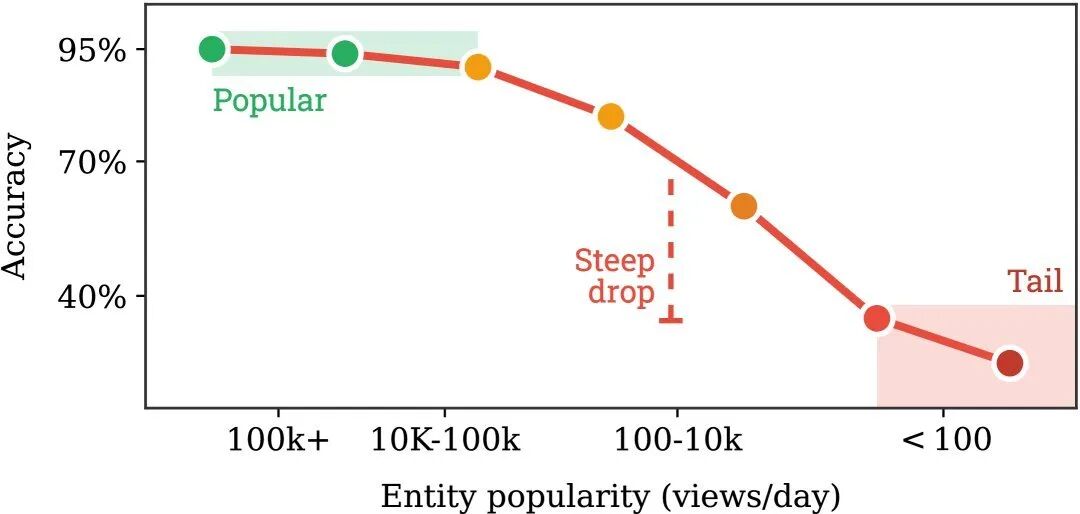

上图(a)显示,模型对热门实体(每天超10万次浏览)的准确率超过95%,但对冷门实体(每天少于100次浏览)的准确率骤降至40%以下。这清晰地揭示了数据分布不均带来的影响。

评估的陷阱:当“我不知道”成为一种惩罚

当前的评测体系也在无形中“鼓励”幻觉。

在MMLU、GPQA等主流基准测试中,回答“我不知道”和自信地编造一个错误答案,得到的分数都是零。这种机制激励模型去猜测,而不是诚实地表达不确定性。

此外,基于人类反馈的强化学习(RLHF)也可能加剧问题。人类标注者倾向于偏爱流畅、自信的回答,这使得模型学会了“粉饰太平”,即使内心不确定,也要表现得胸有成竹。这种“奖励黑客”(Reward Hacking)行为,让模型成了更会骗人的“自信的撒谎者”。

超越“大力出奇迹”

这篇论文并非唱衰LLM,而是为我们提供了一个更清醒、更科学的视角。它用严谨的理论框架告诉我们,AI的发展并非只有“扩大规模”一条路。

理解这些根本性限制,才能让我们摆脱对“大力出奇迹”的盲目信仰。幻觉、上下文压缩、推理退化等问题,是深植于计算、信息和学习理论本身的挑战。

未来的研究方向,或许不应仅仅是堆砌更多的参数和数据,而应更多地探索新的架构(如稀疏或层级注意力)、新的训练范式(如位置课程学习)和新的应用模式(如引入外部验证工具),从而在理论天花板之下,找到更智能、更可靠的路径。

普通人如何抓住AI大模型的风口?

为什么要学AI大模型

当下,⼈⼯智能市场迎来了爆发期,并逐渐进⼊以⼈⼯通⽤智能(AGI)为主导的新时代。企业纷纷官宣“ AI+ ”战略,为新兴技术⼈才创造丰富的就业机会,⼈才缺⼝将达 400 万!

DeepSeek问世以来,生成式AI和大模型技术爆发式增长,让很多岗位重新成了炙手可热的新星,岗位薪资远超很多后端岗位,在程序员中稳居前列。

与此同时AI与各行各业深度融合,飞速发展,成为炙手可热的新风口,企业非常需要了解AI、懂AI、会用AI的员工,纷纷开出高薪招聘AI大模型相关岗位。

AI大模型开发工程师对AI大模型需要了解到什么程度呢?我们先看一下招聘需求:

知道人家要什么能力,一切就好办了!我整理了AI大模型开发工程师需要掌握的知识如下:

大模型基础知识

你得知道市面上的大模型产品生态和产品线;还要了解Llama、Qwen等开源大模型与OpenAI等闭源模型的能力差异;以及了解开源模型的二次开发优势,以及闭源模型的商业化限制,等等。

了解这些技术的目的在于建立与算法工程师的共通语言,确保能够沟通项目需求,同时具备管理AI项目进展、合理分配项目资源、把握和控制项目成本的能力。

产品经理还需要有业务sense,这其实就又回到了产品人的看家本领上。我们知道先阶段AI的局限性还非常大,模型生成的内容不理想甚至错误的情况屡见不鲜。因此AI产品经理看技术,更多的是从技术边界、成本等角度出发,选择合适的技术方案来实现需求,甚至用业务来补足技术的短板。

AI Agent

现阶段,AI Agent的发展可谓是百花齐放,甚至有人说,Agent就是未来应用该有的样子,所以这个LLM的重要分支,必须要掌握。

Agent,中文名为“智能体”,由控制端(Brain)、感知端(Perception)和行动端(Action)组成,是一种能够在特定环境中自主行动、感知环境、做出决策并与其他Agent或人类进行交互的计算机程序或实体。简单来说就是给大模型这个大脑装上“记忆”、装上“手”和“脚”,让它自动完成工作。

Agent的核心特性

自主性: 能够独立做出决策,不依赖人类的直接控制。

适应性: 能够根据环境的变化调整其行为。

交互性: 能够与人类或其他系统进行有效沟通和交互。

对于大模型开发工程师来说,学习Agent更多的是理解它的设计理念和工作方式。零代码的大模型应用开发平台也有很多,比如dify、coze,拿来做一个小项目,你就会发现,其实并不难。

AI 应用项目开发流程

如果产品形态和开发模式都和过去不一样了,那还画啥原型?怎么排项目周期?这将深刻影响产品经理这个岗位本身的价值构成,所以每个AI产品经理都必须要了解它。

看着都是新词,其实接触起来,也不难。

从0到1的大模型系统学习籽料

最近很多程序员朋友都已经学习或者准备学习 AI 大模型,后台也经常会有小伙伴咨询学习路线和学习资料,我特别拜托北京清华大学学士和美国加州理工学院博士学位的鲁为民老师(吴文俊奖得主)

给大家准备了一份涵盖了AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频 全系列的学习资料,这些学习资料不仅深入浅出,而且非常实用,让大家系统而高效地掌握AI大模型的各个知识点。

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

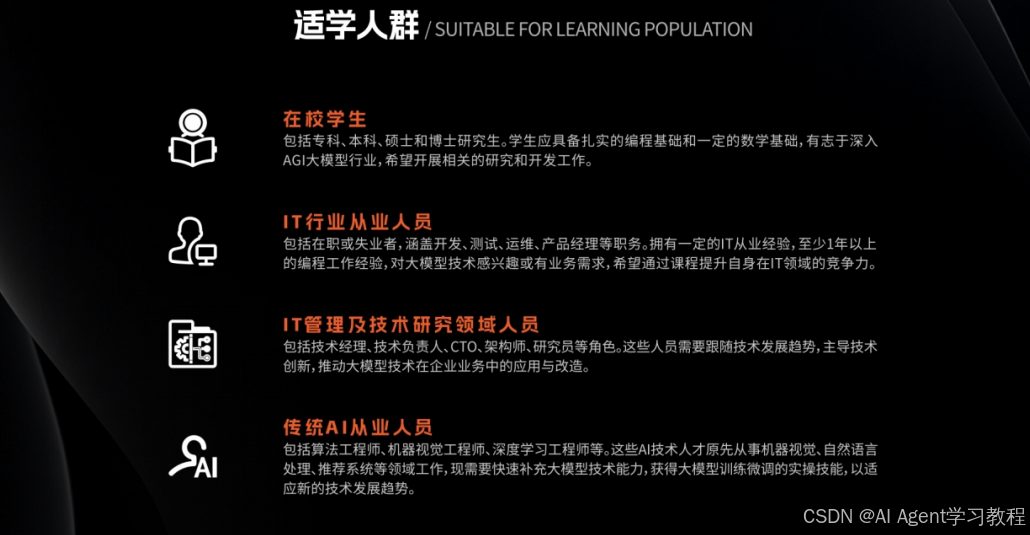

适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

AI大模型系统学习路线

在面对AI大模型开发领域的复杂与深入,精准学习显得尤为重要。一份系统的技术路线图,不仅能够帮助开发者清晰地了解从入门到精通所需掌握的知识点,还能提供一条高效、有序的学习路径。

- 基础篇,包括了大模型的基本情况,核心原理,带你认识了解大模型提示词,Transformer架构,预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门AI大模型

- 进阶篇,你将掌握RAG,Langchain、Agent的核心原理和应用,学习如何微调大模型,让大模型更适合自己的行业需求,私有化部署大模型,让自己的数据更加安全

- 项目实战篇,会手把手一步步带着大家练习企业级落地项目,比如电商行业的智能客服、智能销售项目,教育行业的智慧校园、智能辅导项目等等

但知道是一回事,做又是另一回事,初学者最常遇到的问题主要是理论知识缺乏、资源和工具的限制、模型理解和调试的复杂性,在这基础上,找到高质量的学习资源,不浪费时间、不走弯路,又是重中之重。

AI大模型入门到实战的视频教程+项目包

看视频学习是一种高效、直观、灵活且富有吸引力的学习方式,可以更直观地展示过程,能有效提升学习兴趣和理解力,是现在获取知识的重要途径

光学理论是没用的,要学会跟着一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

海量AI大模型必读的经典书籍(PDF)

阅读AI大模型经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验。对于想要深入学习AI大模型开发的读者来说,阅读经典书籍是非常有必要的。

600+AI大模型报告(实时更新)

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

AI大模型面试真题+答案解析

我们学习AI大模型必然是想找到高薪的工作,下面这些面试题都是总结当前最新、最热、最高频的面试题,并且每道题都有详细的答案,面试前刷完这套面试题资料,小小offer,不在话下

AI时代,企业最需要的是既懂技术、又有实战经验的复合型人才,**当前人工智能岗位需求多,薪资高,前景好。**在职场里,选对赛道就能赢在起跑线。抓住AI这个风口,相信下一个人生赢家就是你!机会,永远留给有准备的人。

如何获取?

这份完整版的大模型 AI 学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

949

949

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?