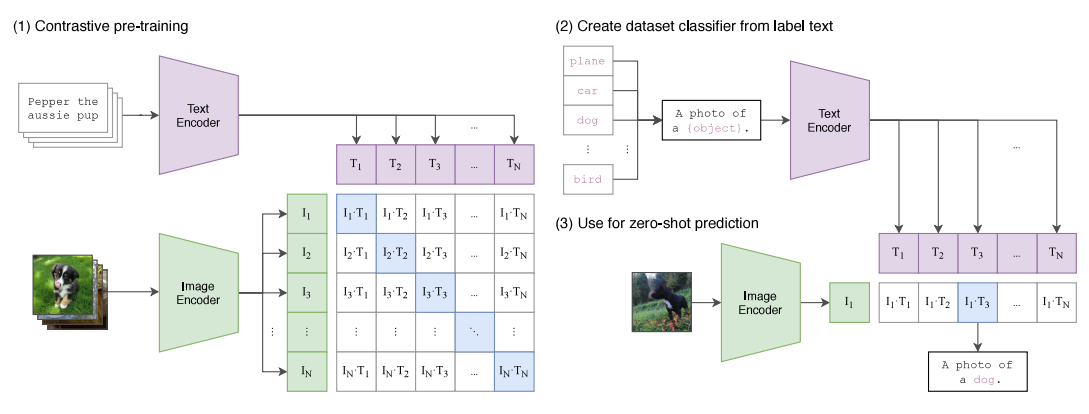

这里主要再简单看一下框架图:

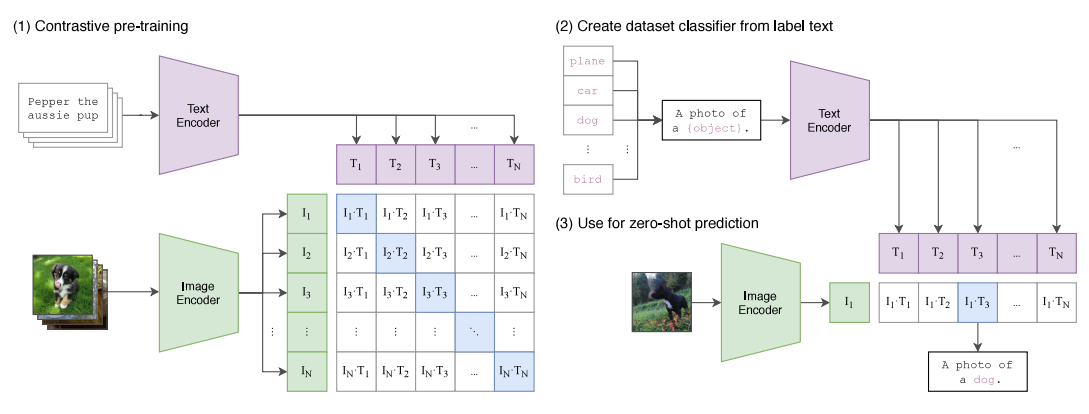

- 训练比较简单,使用的是对比学习的方法,做图文匹配的任务,计算相似度。给定batch = N N N的image-text pairs,CLIP预测 N × N N \times N N×N的概率(利用线性变换得到multi-modal embedding space的向量,点乘计算得到相似度),对角线即为正样本,其它都是负样本。

- 预测分类的使用,将label构建成文本,再分别计算相似度即可得到答案。

这里主要再简单看一下框架图:

1961

1961

1408

1408

735

735

740

740

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?