windows本地部署DeepSeek步骤

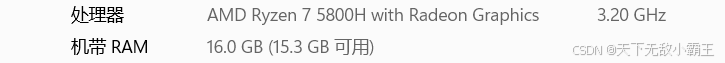

本人电脑配置如下,目前运行DeepSeek-7B模型没什么问题。

1.下载Ollama

下载网址:https://ollama.com/download,如果浏览器下载失败可以选择复制下载链接,去迅雷里面下载,大小大概为800MB左右。

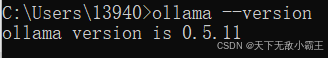

2.安装Ollama

下载完成后直接安装即可,默认安装在C盘。安装完成后,打开cmd,运行ollama --version,查看是否安装成功。安装成功后会打印ollama版本,如下所示:

3.模型下载

打开cmd窗口,输入指令:

如果你想要1.5b模型,则输入:ollama run deepseek-r1:1.5b

如果你想要7b模型,则输入:ollama run deepseek-r1:7b

如果你想要8b模型,则输入:ollama run deepseek-r1:8b

如果你没有强大的GPU加持,那就到此为止吧,还有14b,32b,70b,671b的,指令按照上面的对应修改即可。

4.使用

上述安装完成后,你就可以实现基本对话了,但是要在cmd窗口内,如下所示:

5.拓展

对于不想在cmd里面进行使用的,可以选择第三方的软件进行,比如vscode,下面是使用vscode进行的操作。

5.1vscode下载

vscode下载网址:https://code.visualstudio.com/

下载完成后进行安装。

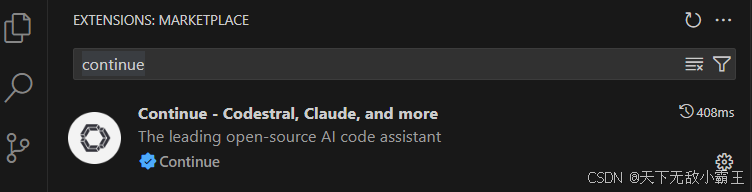

5.2.插件下载

打开vscode,安装插件continue,

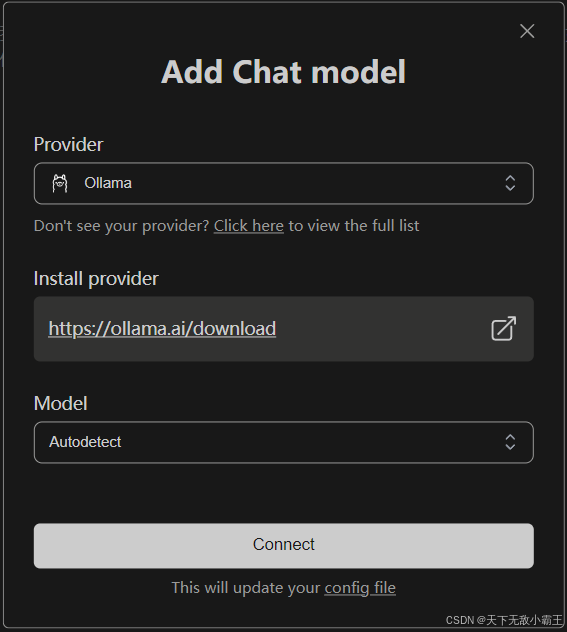

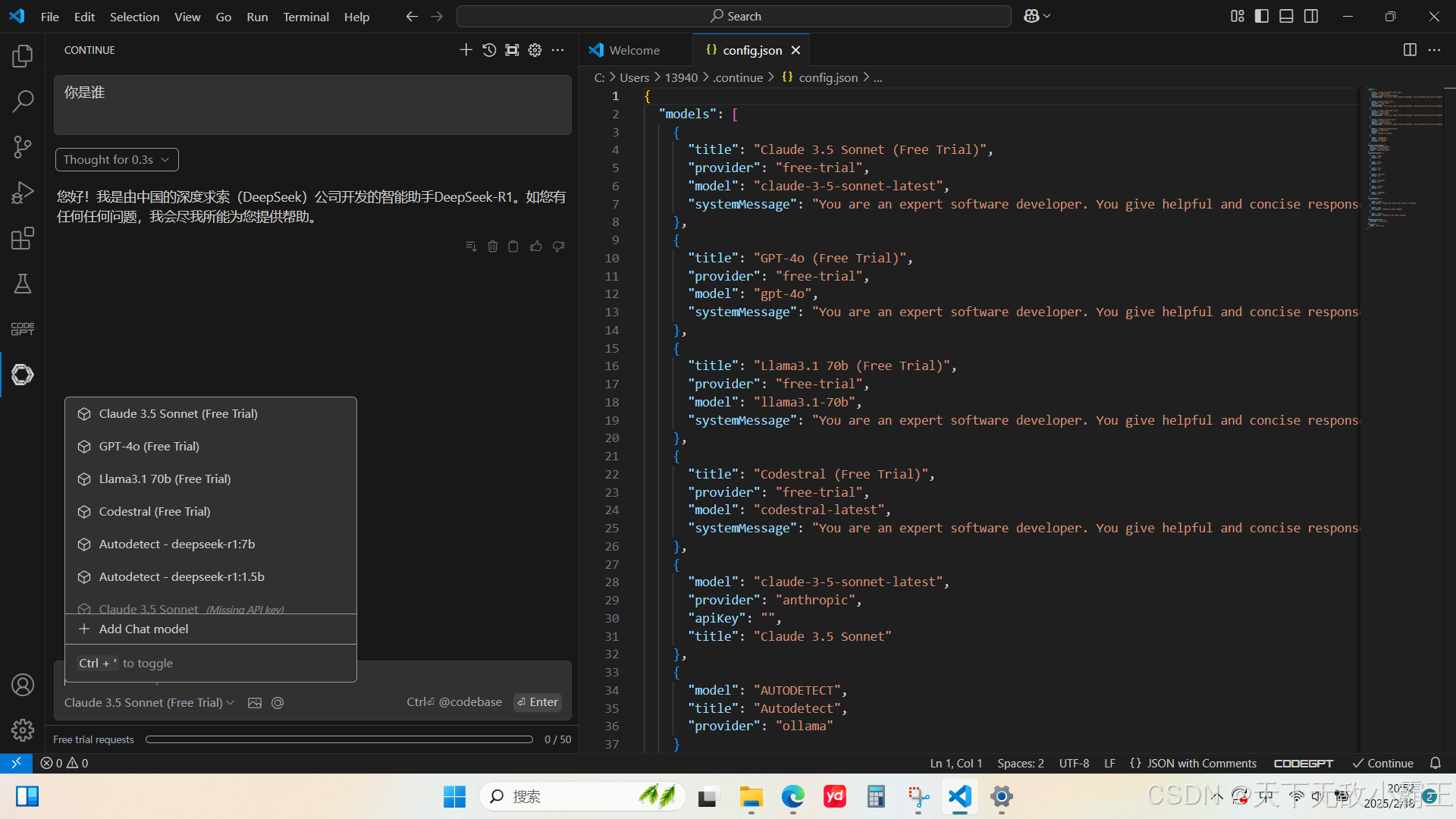

5.3选择模型

选择模型ollama,并选择autodetect

选择Autodetect-deepseek-r1:7b,我安装了1.5b和7b两个,所以能检测到2个。

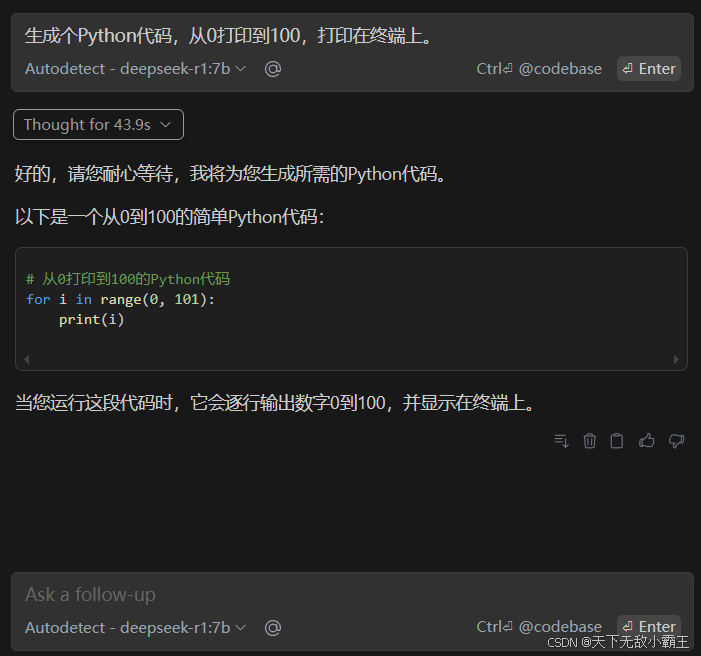

5.4使用

可以一边交流,一边跑代码啦。

1690

1690

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?