特征选择

特征选择是在于选取能够提高分类器学习效率的特征。对于没有分类能力的特征,经验上扔掉这样的特征对最终的分类结果并没有什么大影响。

通常特征选择的准则是信息增益或信息增益比

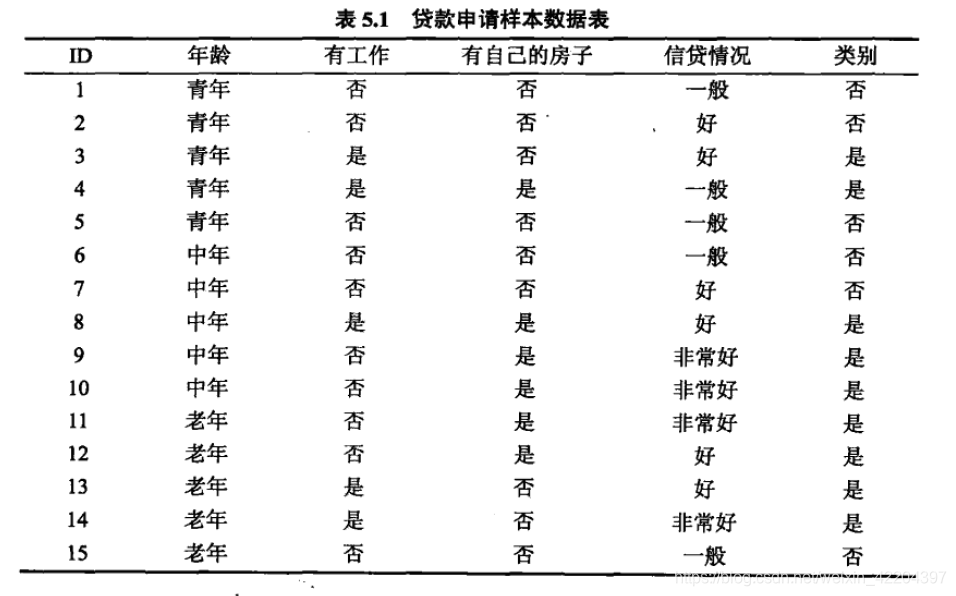

例子

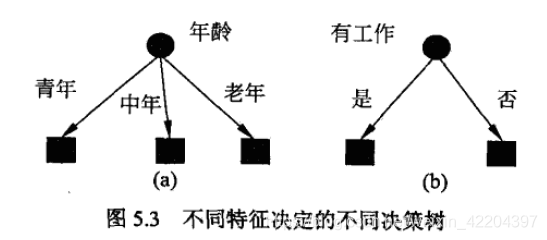

上表是有15个样本组成的贷款申请训练数据,数据包含贷款申请人的4个特征(年龄,是否有工作, 是否有自己的房子,信贷情况),最后一列是类别。特征选择是决定用哪个特征来划分特征空间,选择哪个特征作为根节点,可能的情况:

直观上,如果一个特征具有更好的分类能力,或者说按照这一特征将训练数据集分割成子集,使得各个子集在当前条件下有最好的分类,那么就更应该选择这个特征,信息增益就能够很好的表示这一直观的准则。

熵

信息论中,熵表示信息的不确定性,设 X X X是一个取有限个值的离散随机变量,其概率分部是:

P ( X = x i ) = p i , ( i = 1 , 2 , . . . n ) P(X = x_i)=p_i,(i=1, 2, ...n) P(X=xi)=pi,(i=1,2,...n)

熵就是 H ( X ) = − ∑ i = 1 n p i l o g p i H(X)=-\sum_{i=1}^np_ilogp_i H(X)=<

特征选择是提高分类器效率的关键,常用准则有信息增益。通过熵和条件熵来衡量数据的不确定性。信息增益表示特征带来的信息不确定性减少,用于决策树中选择最佳划分特征。举例说明了如何依据信息增益选择特征。

特征选择是提高分类器效率的关键,常用准则有信息增益。通过熵和条件熵来衡量数据的不确定性。信息增益表示特征带来的信息不确定性减少,用于决策树中选择最佳划分特征。举例说明了如何依据信息增益选择特征。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3154

3154

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?