m = nn.GELU()

input = torch.randn(2)

output = m(input)

erf

z

=

2

π

∫

0

z

e

−

t

2

d

t

.

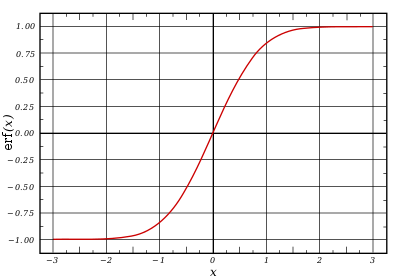

\displaystyle \operatorname {erf} z={\frac {2}{\sqrt {\pi }}}\int _{0}^{z}e^{-t^{2}}\,dt.

erfz=π2∫0ze−t2dt.

这个积分是特殊(非-初等) sigmoid中经常出现的函数。概率, 统计,和偏微分方程。在许多这些应用程序中,函数参数是实数。如果函数参数是实的,那么函数值也是实的。

在统计学上,对于非负值x,错误函数具有以下解释:随机变量 Y那是正态分布带着平均0和标准差 1/√2, ERFx是概率Y落在范围[−x, x]内.

两个密切相关的函数是互补误差函数 (ERFC)定义为

erfc

z

=

1

−

erf

z

.

\displaystyle \operatorname {erfc} z=1-\operatorname {erf} z.

erfcz=1−erfz.

参考链接:https://pytorch.org/docs/stable/generated/torch.nn.GELU.html?highlight=gelu

https://en.wikipedia.org/wiki/Error_function

https://blog.youkuaiyun.com/qq_40945404/article/details/110497682

本文介绍了PyTorch中的GELU激活函数,它在神经网络中常用于提供平滑的非线性。GELU函数与误差函数(ERF)相关,后者在概率、统计和偏微分方程等领域有广泛应用。误差函数的一个统计学解释是,对于正态分布的随机变量,ERF给出了变量落在特定区间内的概率。互补误差函数ERFC则是ERF的补函数。在深度学习中,GELU因其平滑特性而被用作sigmoid和ReLU的替代选择。

本文介绍了PyTorch中的GELU激活函数,它在神经网络中常用于提供平滑的非线性。GELU函数与误差函数(ERF)相关,后者在概率、统计和偏微分方程等领域有广泛应用。误差函数的一个统计学解释是,对于正态分布的随机变量,ERF给出了变量落在特定区间内的概率。互补误差函数ERFC则是ERF的补函数。在深度学习中,GELU因其平滑特性而被用作sigmoid和ReLU的替代选择。

4833

4833

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?