凌晨3点的机房里,李鸣盯着屏幕上刺眼的红色报错提示,手心全是冷汗——他的团队耗时两个月训练的金融大模型,在第17天突然崩了。 这不是科幻小说的情节,而是2025年AI创业公司的真实生存实录。今天带你直击大模型训练翻车现场,解密两个让无数技术VP夜不能寐的关键数字。

一、致命72小时:显存爆炸背后的「幽灵账单」

「所有节点显存占用率100%,训练任务强制终止」

当李鸣的团队在80G显存的服务器上加载130B参数的模型时,还没意识到问题所在。前三天训练流畅得让人安心,直到第72小时,显存突然像被黑洞吞噬般急速飙升。

工程师复盘报告显示:

• 当模型参数量超过120B时,每个GPU需缓存梯度+优化器状态

• 80G显存实际可用仅72G,训练到第3层时显存占用突破81G

• 系统自动启用内存交换(Memory Swap),速度暴跌90%

「我们就像开着五菱宏光跑F1赛道」李鸣苦笑着自嘲。这直接导致价值37万的算力资源瞬间蒸发,更让产品上线推迟了整整三个月。

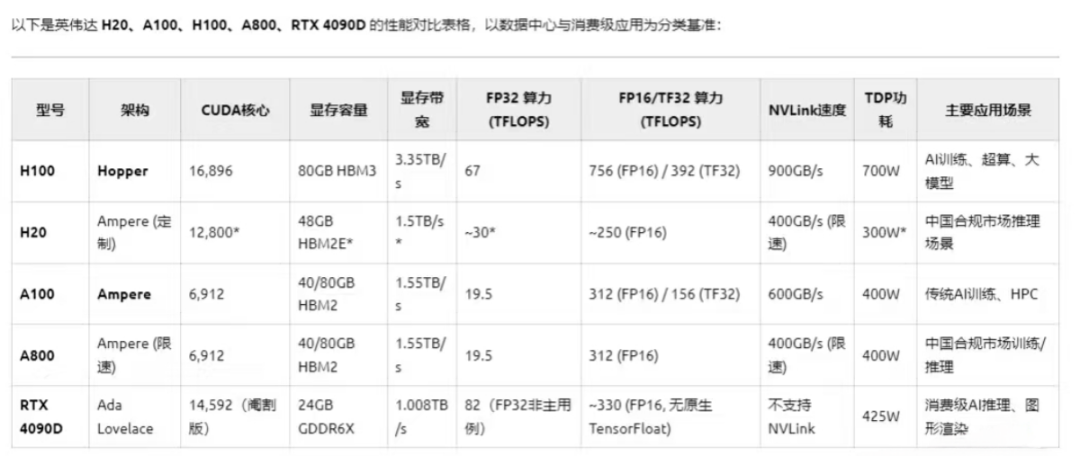

二、NVLink带宽:90%公司忽略的「隐形杀手」

另一家AI初创医疗公司的遭遇更让人窒息: 采购了8块「顶配A100显卡」,训练效率却不如竞争对手4卡机器。问题出在NVLink带宽——他们的服务器使用PCIe 4.0互联,实际传输带宽仅64GB/s,而采用NVLink3.0的机器带宽高达600GB/s。

这意味什么?

• 参数同步耗时增加8倍

• 当模型参数量达70B时,通信耗时占比超40%

• 每天多耗费2700度电(约合1700元)

「我们以为买了最好的显卡,却栽在最基础的连接器上。」技术经理王磊展示的监控截图里,GPU利用率曲线像心电图般剧烈波动。

三、避坑指南:大模型时代的服务器选购密码

1. 显存容量:「车道数」比「车速」更重要

• 百亿级模型建议单卡显存≥80G

• 警惕「共享显存」文字游戏,认准物理显存规格

• 预留20%显存余量应对梯度累积

2. NVLink带宽:这是血管,不是毛细血管

百卡集群建议带宽≥900GB/s

确认拓扑结构支持全互联(非菊花链)

实测P2P带宽(别信纸面参数)

某自动驾驶公司升级到NVLink4.0架构后,175B模型训练时间从27天压缩到11天,GPU闲置率从68%降至9%。

四、血泪教训换来的「反脆弱」方案

现在打开李鸣公司的新机房,会看到这样的配置:

✅ 32台HGX H100服务器,每台配备8块80G HBM3显存显卡

✅ 900GB/s NvLink全互连架构,延迟低于0.7微秒

✅ 动态显存分配系统,自动预警临界值

「以前觉得堆显卡就是王道,现在才知道要像交响乐团一样调配每个部件。」看着稳定运行的训练进度条,李鸣终于能睡个整觉了。

你的服务器正在悄悄吞噬预算吗? 回复关键词【避坑指南】,获取《大模型服务器选型18个致命细节》电子手册(附真实成本测算表)

👉 点击「立即咨询」,获取资深工程师免费服务器选型咨询服务

49

49

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?