📝 面试求职: 「面试试题小程序」 ,内容涵盖 测试基础、Linux操作系统、MySQL数据库、Web功能测试、接口测试、APPium移动端测试、Python知识、Selenium自动化测试相关、性能测试、性能测试、计算机网络知识、Jmeter、HR面试,命中率杠杠的。(大家刷起来…)

📝 职场经验干货:

随着AI技术的快速发展,Transformer已经成为测试开发人员必须了解的核心技术之一。今天,我们将从基础原理到实际应用,全方位解析这个技术架构。

1. Transformer是什么?

简单来说,Transformer是一种深度学习模型架构,最初由Google在2017年提出,主要用于处理序列数据(如文本)。它彻底改变了自然语言处理(NLP)领域,现在几乎所有先进的AI语言模型(如GPT、BERT等)都基于Transformer架构。

2. 为什么需要Transformer?

在Transformer出现之前,处理序列数据主要使用RNN(循环神经网络)和LSTM(长短期记忆网络)。但这些模型存在两个主要问题:

-

处理长序列困难:随着序列变长,早期信息容易被遗忘

-

计算效率低:必须按顺序处理数据,无法并行计算

-

Transformer通过全新的设计解决了这些问题。

3. Transformer的核心思想

3.1 自注意力机制(Self-Attention)

这是Transformer最核心的创新。想象你在读一篇文章:

-

传统方法:从左到右一个字一个字读

-

Transformer方法:一眼看完整句话,自动找出哪些词之间关系更密切

-

比如句子"这只猫坐在垫子上,因为它很柔软":

-

"它"更可能与"垫子"相关,而不是"猫"

-

Transformer能自动捕捉这种关系

3.2 位置编码(Positional Encoding)

由于Transformer不是顺序处理数据,需要额外信息告诉模型词语的位置关系。这就像给每个词加上"座位号"。

4. Transformer的基本结构

一个标准Transformer由两部分组成:

[输入序列] [输出序列]

| ^

v |

+-------------+ +-------------+

| 编码器部分 | | 解码器部分 |

| (Encoder) | --> | (Decoder) |

+-------------+ +-------------+

| ^

v |

+-------------------------+

| 自注意力机制 |

| (Self-Attention) |

+-------------------------+4.1 编码器(Encoder)

-

负责理解输入数据

-

由多个相同的层堆叠而成

-

每层包含自注意力机制和前馈神经网络

4.2 解码器(Decoder)

-

负责生成输出

-

也有多层结构

-

比编码器多一个"编码器-解码器注意力"层

5. Transformer为什么这么强大?

-

并行处理:可以同时处理所有输入,训练速度大幅提升

-

长距离依赖:能捕捉序列中任意两个元素间的关系

-

可扩展性:通过堆叠更多层,模型能力可以不断增强

6. Transformer在测试开发中的应用

作为测试开发人员,了解Transformer有助于:

-

测试AI系统:理解模型工作原理,设计更有效的测试用例

-

自动化测试:利用基于Transformer的模型生成测试数据或脚本

-

异常检测:分析日志或监控数据中的异常模式

7. 通俗理解Transformer

想象你在组织一场会议:

-

传统RNN:像一个人依次听取每位发言者的话,容易忘记前面内容

-

Transformer:像所有人同时发言,但有一种神奇能力能自动聚焦到相关的发言上,综合理解整个讨论

8. 常见Transformer模型

BERT:Google开发的,擅长理解语言

-

谷歌搜索(BERT应用)

场景:理解长尾搜索query

测试要点:

长query意图识别准确率

多义词消歧能力测试

搜索延迟性能监控

GPT系列:OpenAI开发的,擅长生成语言

-

GitHub Copilot(GPT-3微调)

-

测试相关:

代码补全的边界测试

安全测试:是否生成含漏洞的代码

上下文记忆测试

T5:Google开发的,统一了各种NLP任务

9.企业级应用案例

9.1 客服机器人(Transformer+业务知识库)

9.2 日志分析(BERT+BiLSTM)

某银行异常交易检测系统:

-

输入:操作日志的文本描述

-

输出:异常行为评分

-

测试重点:

处理非结构化日志的能力

模型漂移检测

9.3 测试领域直接应用

自动化测试脚本生成

// 输入:需求描述(自然语言)

"测试用户登录功能,包括:正确密码、错误密码、空密码、SQL注入尝试"

// 输出:生成的测试脚本片段

@Test

public void testLogin_SQLInjection() {

String maliciousInput = "' OR '1'='1";

Response res = loginAPI("admin", maliciousInput);

assertEqual(res.code(), 403);

}测试报告摘要生成

输入:自动化测试的原始日志(5000行)

输出:

【核心摘要】

1. 发现2个关键缺陷:

- 支付接口在并发请求时出现race condition

- iOS 14.5系统下UI错位

2. 通过率92%(较昨日↓3%)

3. 建议优先修复... 10. 学习建议

对于测试开发人员,建议:

-

先理解基本概念和工作原理

-

学习如何使用现成的Transformer模型API

-

了解模型评估指标和测试方法

-

逐步深入模型内部机制

Transformer是当今AI领域最重要的突破之一,它通过自注意力机制实现了对序列数据的高效处理。作为测试开发人员,理解这一技术将帮助我们更好地测试和利用AI系统。

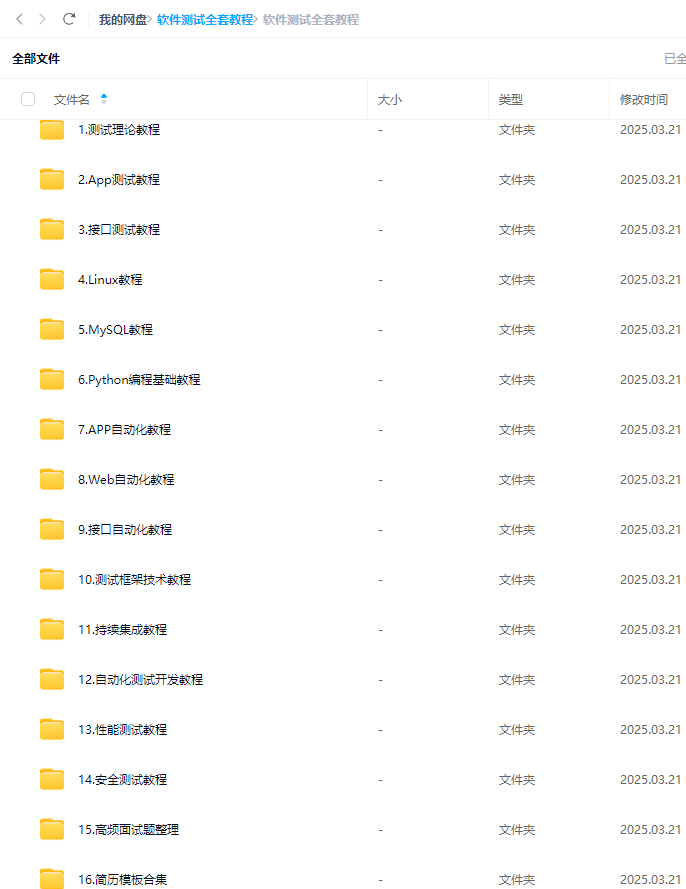

最后: 下方这份完整的软件测试视频教程已经整理上传完成,需要的朋友们可以自行领取【保证100%免费】

714

714

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?