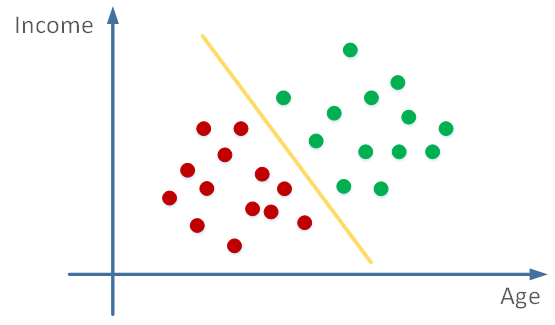

机器学习 100 天,今天讲的是:逻辑回归-梯度下降!

在讲解了逻辑回归的基本原理和损失函数之后,我们来推导逻辑回归模型中参数 w 和 b 的梯度表达式。

我们之前介绍过,计算逻辑回归的代价函数实际上包含了下面三个过程:

Z = W T X + b Z=W^TX+b <

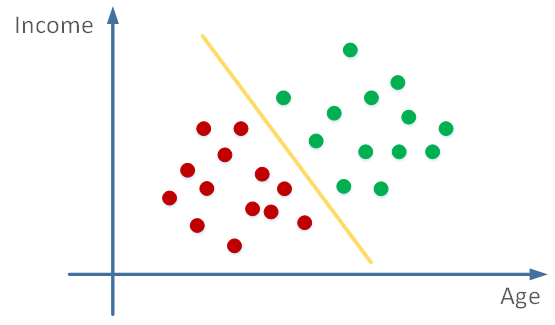

机器学习 100 天,今天讲的是:逻辑回归-梯度下降!

在讲解了逻辑回归的基本原理和损失函数之后,我们来推导逻辑回归模型中参数 w 和 b 的梯度表达式。

我们之前介绍过,计算逻辑回归的代价函数实际上包含了下面三个过程:

Z = W T X + b Z=W^TX+b <

440

440

1384

1384

5094

5094

2277

2277

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?