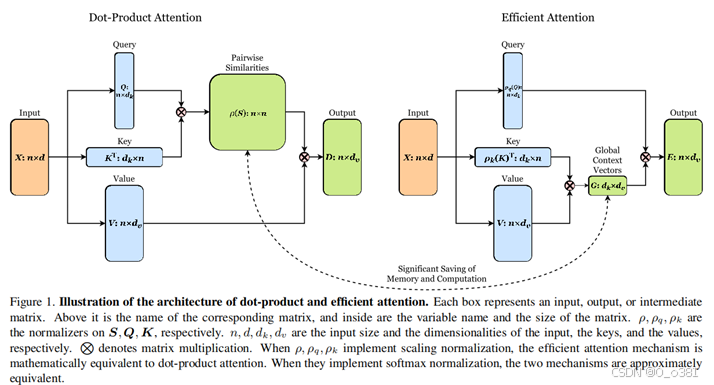

简述:提出了一种新的有效的注意机制,相当于点积注意,但其内存和计算成本大大降低。也就是复杂度从降低到

。

其实可以看出做的工作就是将传统Q,K,V,相乘的顺序改变了

核心公式(根据论文):

在代码中就是softmax函数

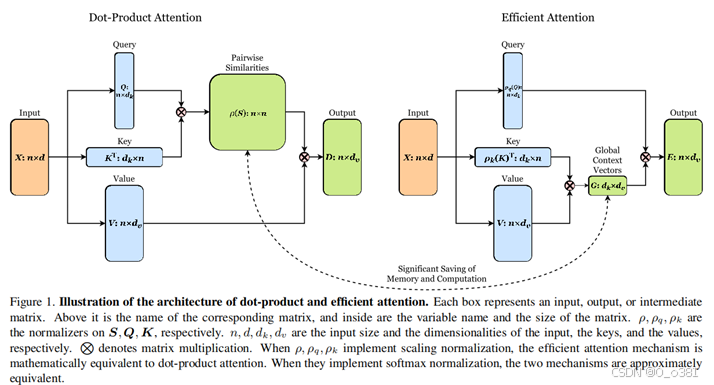

简述:提出了一种新的有效的注意机制,相当于点积注意,但其内存和计算成本大大降低。也就是复杂度从降低到

。

其实可以看出做的工作就是将传统Q,K,V,相乘的顺序改变了

核心公式(根据论文):

在代码中就是softmax函数

3501

3501

939

939

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?