import tensorflow as tf

def add_layer(inputs,in_size,out_size,activation_function=None):

with tf.name_scope(‘layer’):

with tf.name_scope(‘Weights’):

Weights= tf.Variable(tf.random_normal([in_size, out_size]),name=‘W’)

with tf.name_scope(‘biases’):

biases = tf.Variable(tf.zeros([1,out_size])+0.1,name=‘b’)

with tf.name_scope(‘Wx_plus_b’):

Wx_plus_b=tf.matmul(inputs,Weights)+biases

if activation_function is None:

outputs = Wx_plus_b

else:

outputs = activation_function(Wx_plus_b)

return outputs

with tf.name_scope(‘input’): #输入层大框架

xs = tf.placeholder(tf.float32,[None,1],name=‘x_input’)

ys = tf.placeholder(tf.float32,[None,1],name=‘y_input’)

l1 = add_layer(xs,1,10,activation_function=tf.nn.relu)

prediction = add_layer(l1,10,1,activation_function=None)

with tf.name_scope(‘loss’):

loss =tf.reduce_mean(tf.reduce_sum(tf.square(ys-prediction),reduction_indices=[1]))

with tf.name_scope(‘train’):

train_step=tf.train.GradientDescentOptimizer(0.1).minimize(loss)

sess =tf.Session()

writer=tf.summary.FileWriter(“logs/”,sess.graph)

sess.run(tf.initialize_all_variables())

重新打开terminal(在logs所在的文件夹下),输入命令tensorboard --logdir=logs

生成:TensorBoard 1.9.0 at http://ubuntu:6006 (Press CTRL+C to quit)

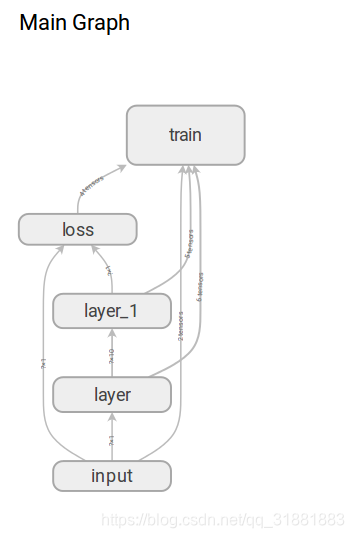

在谷歌浏览器中打开:http://ubuntu:6006,可以看到对应的tensorflow网络框架图:

这篇博客展示了如何利用TensorFlow库构建一个简单的神经网络,并通过TensorBoard进行可视化。首先定义了一个添加层的函数,然后创建了输入层、隐藏层和输出层。接着,设置了损失函数和梯度下降优化器进行训练。最后,通过运行TensorBoard在Ubuntu上查看网络结构和训练过程。

这篇博客展示了如何利用TensorFlow库构建一个简单的神经网络,并通过TensorBoard进行可视化。首先定义了一个添加层的函数,然后创建了输入层、隐藏层和输出层。接着,设置了损失函数和梯度下降优化器进行训练。最后,通过运行TensorBoard在Ubuntu上查看网络结构和训练过程。

404

404

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?