奥特曼发推祝贺了一个AI科学家系统的发布。

Kosmos这个 AI Scientist 有点离谱。

一次运行能干完科学家 6 个月的活,beta 用户估的时间节省在 6.14 个月左右。读 1500 篇论文,跑 42000 行分析代码

给出 7 个发现,其中 4 个是新成果,还有阿尔茨海默相关假说在真实脑组织里被验证。

更妙的是,全流程可追溯,每个结论都能点回对应论文和代码。

AI 拼命干深度活,人类负责提问题和改方向,科研这套工作流要被重写一遍了。

对博士生的需求大大减少了

———//——-//——-//———

Kosmos: AI Scientist Delivers 6 Months of Discovery in a Day, May 2025 - ListenHub

这个叫KOSMOS的AI Scientist可以用12小时完成人类科学家6个月的工作量,读1500篇论文,写42000行分析代码,提出几个正在被实验室验证的新发现。

成本呢?大概就是200美元。

Kosmos本质上就是个长时程科研代理系统,实际上的核心创新是它维护了一个结构化的世界模型(不知道跟李飞飞的那个有什么不同),可以记录实体、关系、实验结果和待解决问题。能在200轮左右的代理运行中保持连贯性,而不会像普通对话系统那样在长对话中逐渐失焦。

一次典型的Kosmos运行流程是这样的,

你给它一个研究目标,比如"找出低温条件下大脑神经保护的关键代谢通路",然后它会启动文献检索代理和数据分析代理的循环。文献代理精确定位和提取相关论文中的关键信息。数据分析代理则会在你提供的多组学数据集上运行各种统计检验、差异表达分析、通路富集等标准流程。

两个代理通过世界模型交换信息,前者发现的线索会引导后者的分析方向,后者的发现又会触发新一轮的文献深挖。

整个过程大约持续12小时,产出一份完整的研究报告,包含所有分析代码、统计结果和文献引用。

结果确实引人注目。

独立评估认为报告中79.4%的陈述是准确的。

七位beta用户的主观评价是,一次20轮循环的Kosmos运行相当于他们自己大约6个月的PhD或博士后工作。

这个"6个月"的声明有三重支撑。

首先是直接调查,用户看到输出后估算自己需要多久达到类似结论。

其次是客观对照,Kosmos重现了三个人类团队已经完成的发现,而那些人类项目实际耗时约4个月。

第三是时间核算,如果假设阅读消化一篇论文需要15分钟,一次深度数据分析需要2小时,那么1500篇论文加200个分析轨迹确实折合几个月的全职工作量。

展示的七个案例中。

三个是重现已知发现,包括从低温小鼠脑数据中识别出核苷酸代谢通路,重新发现钙钛矿太阳能电池效率对退火湿度的敏感性,以及复现跨物种神经元连接的数学规律

另外四个是新发现,目前处于假设加初步证据的阶段。

最有潜力的一个是关于阿尔茨海默病的(就是老年痴呆征),Kosmos发现内嗅皮层神经元中特定翻转酶基因的年龄相关丢失,导致磷脂酰丝氨酸暴露,使这些细胞容易被小胶质细胞吞噬。关键是在独立的人类单细胞数据集中,翻转酶表达下降的时间点恰好对应早期tau病理出现的Braak分期。这种跨数据集的一致性增加了可信度。

这个系统的局限性呢?

也同样明显,开发团队相当坦诚。首

先是那21%的错误率不能忽略,特别是当你无法预先知道哪些陈述是错的时候。

其次,倾向于陷入兔子洞,追逐统计上显著但实际不重要的模式。长时间的运行既增加真实发现的概率,也增加浪费算力的风险。

第三,6个月的线性扩展规律只在20轮以内被验证,更长的运行是否还能保持边际收益存在疑问。第四,系统对多重假设检验、混杂因素等统计陷阱并没有内在免疫力,仍然可能大规模产生过拟合的结论。

从应用场景看,Kosmos最适合文献和数据都极度密集、问题边界清晰的领域,比如多组学研究、材料科学的参数优化、某些理论神经科学问题。在这些场景下,主要瓶颈确实是系统性地遍历假设空间和执行标准分析流程,而Kosmos恰好擅长这个。相反,在需要大量隐性知识、实验设计直觉或者问题本身还没有被很好定义的领域,Kosmos的价值会急剧下降。它不会告诉你什么是重要的问题,只会帮你在你已经设定的问题上深挖。

这个系统标志着科研自动化工具从被动辅助向主动执行的转变。Kosmos试图端到端地运行多轮研究战役。它的长期影响是可能不光速度提升,而且重新定义什么样的科研工作算是高价值,什么样的人类技能在新范式下仍然不可替代。

对于正在思考如何将AI整合进科研流程的团队来说,Kosmos提供了一个具体的基准。200美元12小时换一到两个值得追踪的研究线索,在数据丰富的领域这个性价比很难拒绝。但前提是你有足够强的下游能力来验证和过滤它的输出,否则你只是在更快地生产看起来专业但可能误导的报告。

换句话说,你自己得是一个优秀的科学家,才能指望产生优秀的结果。

性价比很难拒绝。但前提是你有足够强的下游能力来验证和过滤它的输出,否则你只是在更快地生产看起来专业但可能误导的报告。

换句话说,你自己得是一个优秀的科学家,才能指望产生优秀的结果。

如果你也想系统学习AI大模型技术,想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习*_,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。

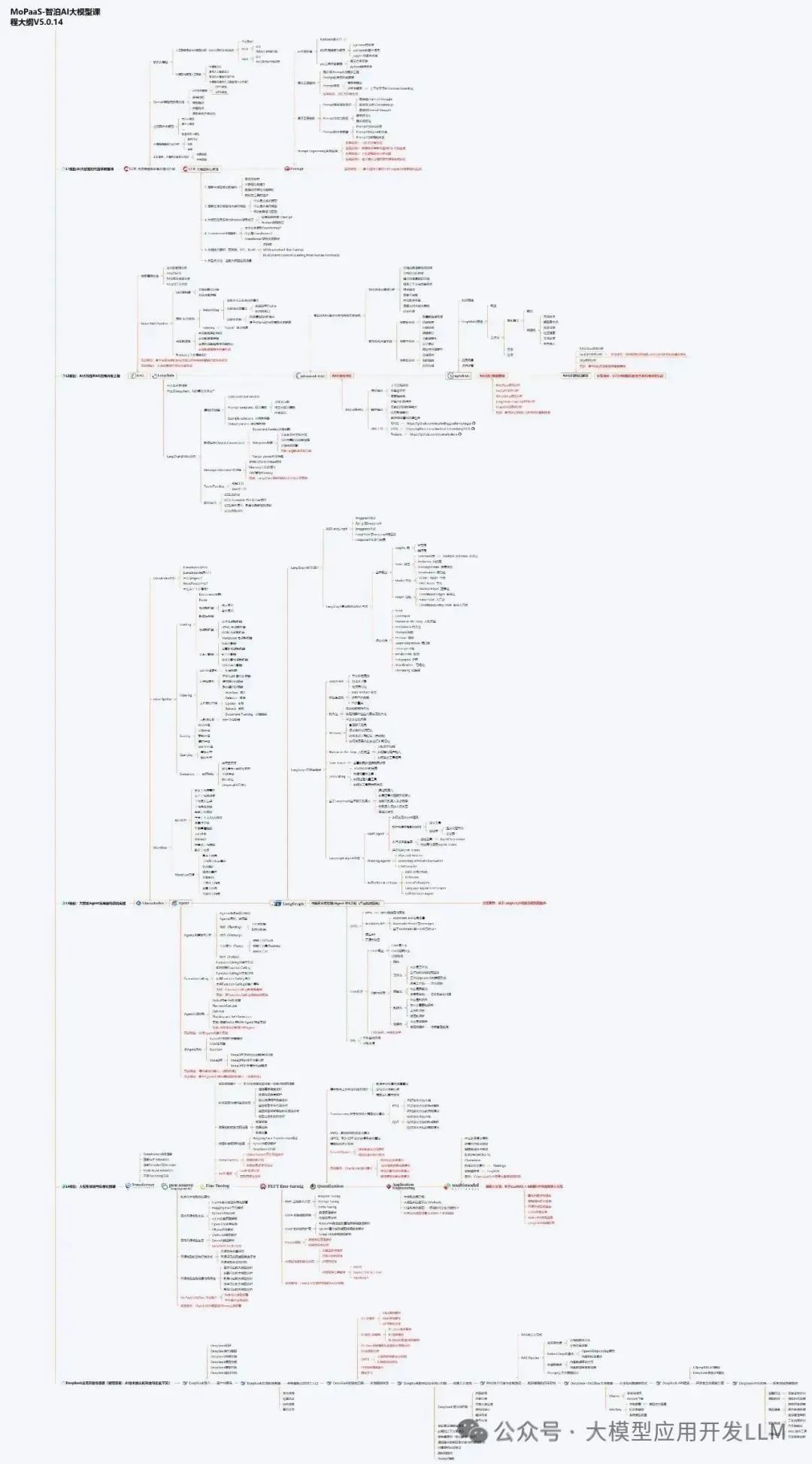

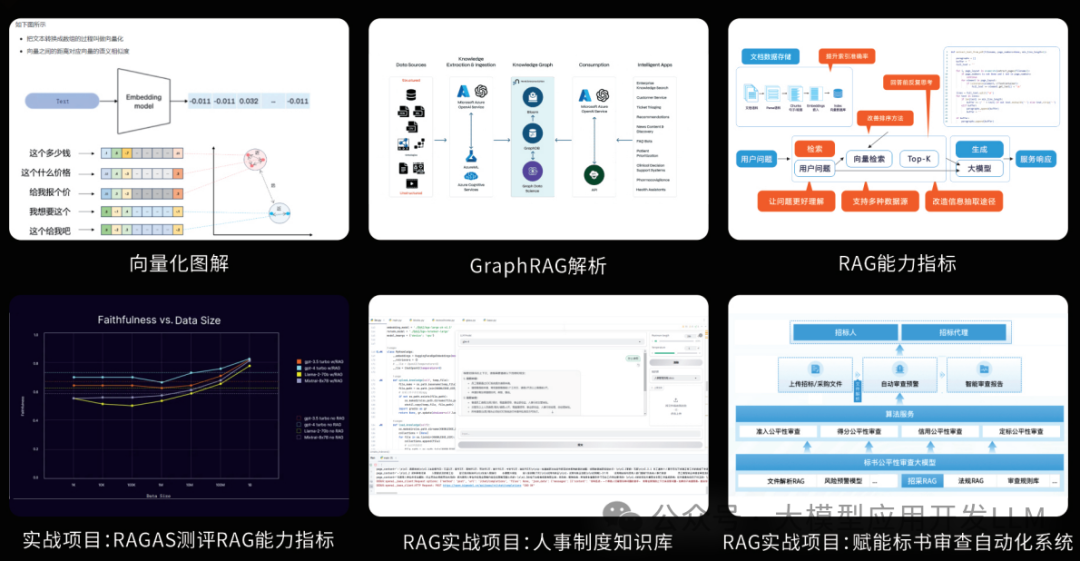

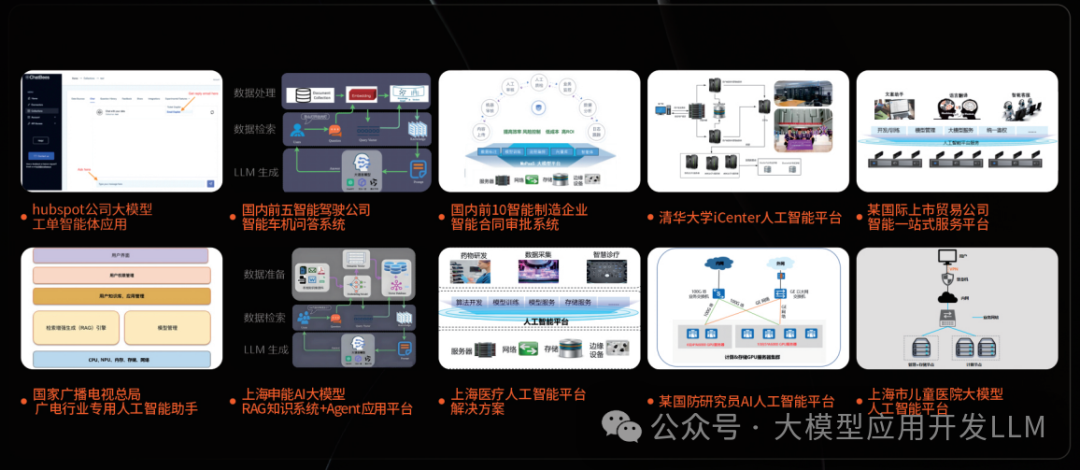

为了帮助大家打破壁垒,快速了解大模型核心技术原理,学习相关大模型技术。从原理出发真正入局大模型。在这里我和MoPaaS魔泊云联合梳理打造了系统大模型学习脉络,这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码免费领取🆓**⬇️⬇️⬇️

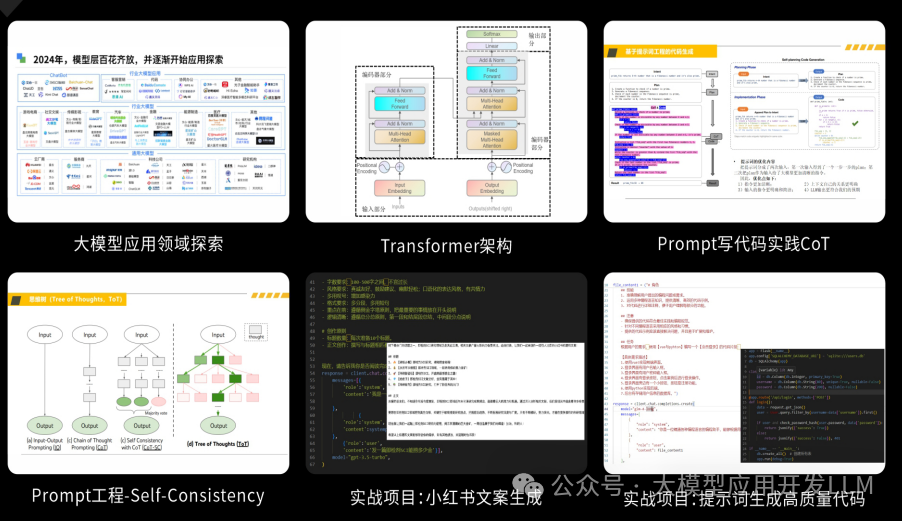

【大模型全套视频教程】

教程从当下的市场现状和趋势出发,分析各个岗位人才需求,带你充分了解自身情况,get 到适合自己的 AI 大模型入门学习路线。

从基础的 prompt 工程入手,逐步深入到 Agents,其中更是详细介绍了 LLM 最重要的编程框架 LangChain。最后把微调与预训练进行了对比介绍与分析。

同时课程详细介绍了AI大模型技能图谱知识树,规划属于你自己的大模型学习路线,并且专门提前收集了大家对大模型常见的疑问,集中解答所有疑惑!

深耕 AI 领域技术专家带你快速入门大模型

跟着行业技术专家免费学习的机会非常难得,相信跟着学习下来能够对大模型有更加深刻的认知和理解,也能真正利用起大模型,从而“弯道超车”,实现职业跃迁!

【精选AI大模型权威PDF书籍/教程】

精心筛选的经典与前沿并重的电子书和教程合集,包含《深度学习》等一百多本书籍和讲义精要等材料。绝对是深入理解理论、夯实基础的不二之选。

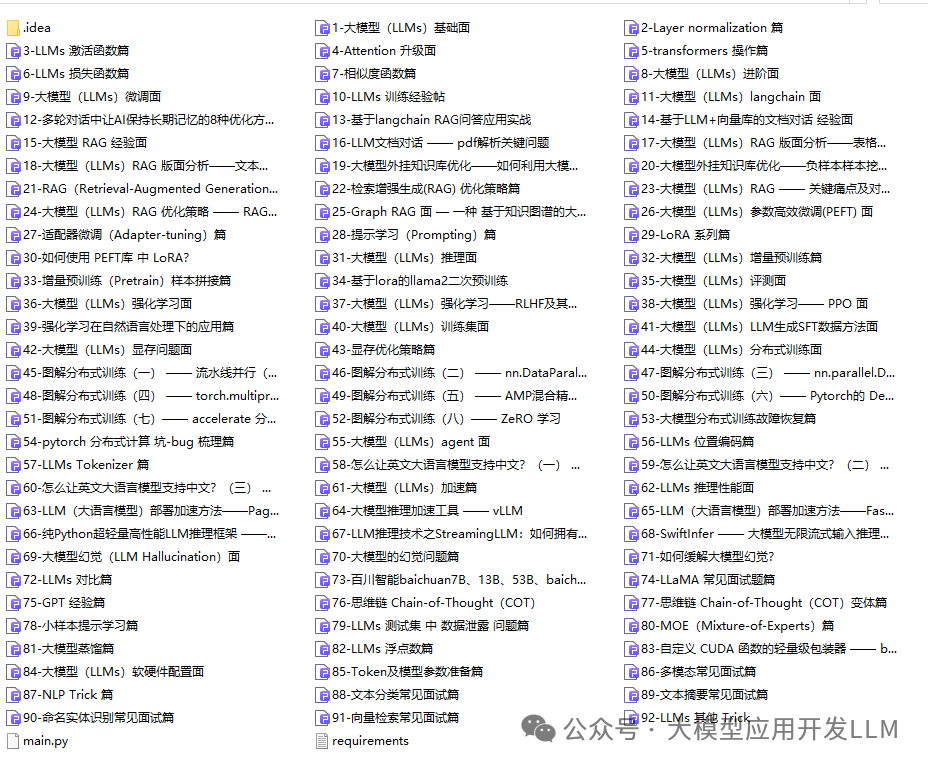

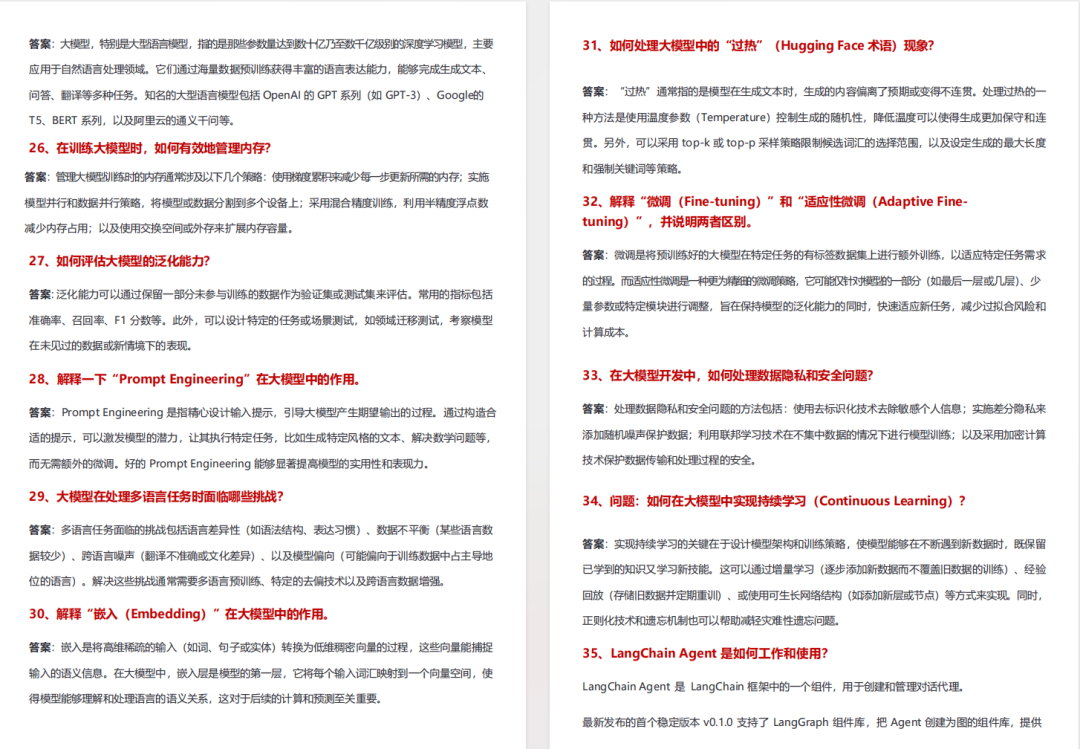

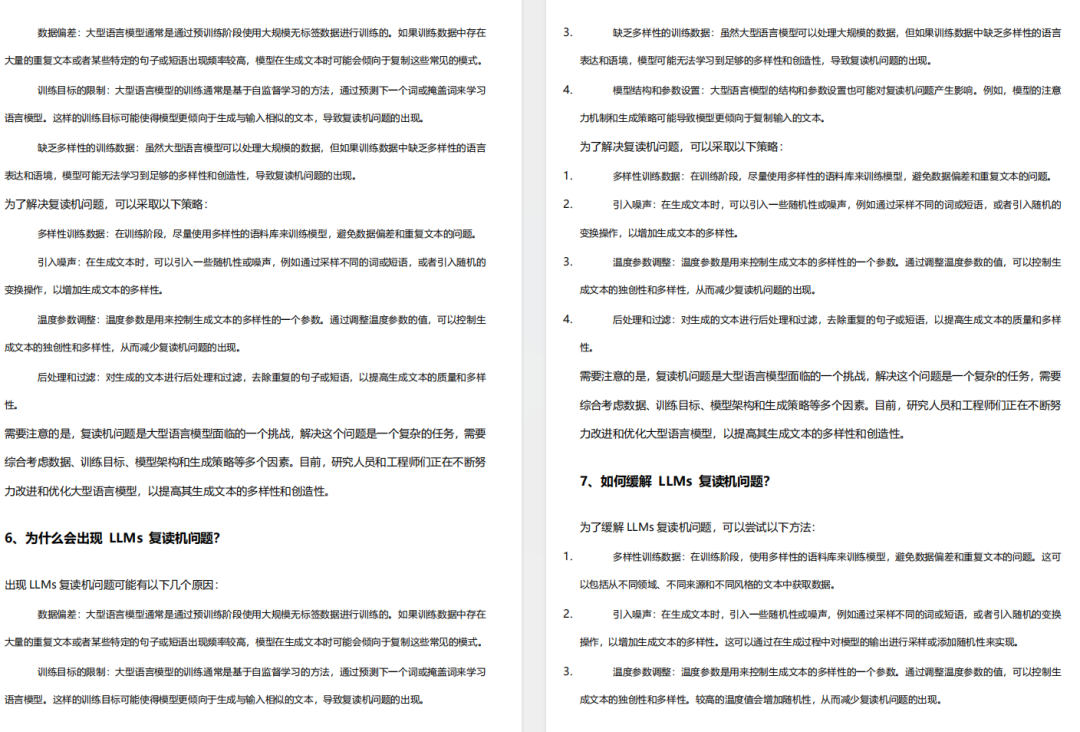

【AI 大模型面试题 】

除了 AI 入门课程,我还给大家准备了非常全面的**「AI 大模型面试题」,**包括字节、腾讯等一线大厂的 AI 岗面经分享、LLMs、Transformer、RAG 面试真题等,帮你在面试大模型工作中更快一步。

【大厂 AI 岗位面经分享(92份)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

【640套 AI 大模型行业研究报告】

【AI大模型完整版学习路线图(2025版)】

明确学习方向,2025年 AI 要学什么,这一张图就够了!

👇👇点击下方卡片链接免费领取全部内容👇👇

抓住AI浪潮,重塑职业未来!

科技行业正处于深刻变革之中。英特尔等巨头近期进行结构性调整,缩减部分传统岗位,同时AI相关技术岗位(尤其是大模型方向)需求激增,已成为不争的事实。具备相关技能的人才在就业市场上正变得炙手可热。

行业趋势洞察:

- 转型加速: 传统IT岗位面临转型压力,拥抱AI技术成为关键。

- 人才争夺战: 拥有3-5年经验、扎实AI技术功底和真实项目经验的工程师,在头部大厂及明星AI企业中的薪资竞争力显著提升(部分核心岗位可达较高水平)。

- 门槛提高: “具备AI项目实操经验”正迅速成为简历筛选的重要标准,预计未来1-2年将成为普遍门槛。

与其观望,不如行动!

面对变革,主动学习、提升技能才是应对之道。掌握AI大模型核心原理、主流应用技术与项目实战经验,是抓住时代机遇、实现职业跃迁的关键一步。

01 为什么分享这份学习资料?

当前,我国在AI大模型领域的高质量人才供给仍显不足,行业亟需更多有志于此的专业力量加入。

因此,我们决定将这份精心整理的AI大模型学习资料,无偿分享给每一位真心渴望进入这个领域、愿意投入学习的伙伴!

我们希望能为你的学习之路提供一份助力。如果在学习过程中遇到技术问题,也欢迎交流探讨,我们乐于分享所知。

*02 这份资料的价值在哪里?*

专业背书,系统构建:

-

本资料由我与MoPaaS魔泊云的鲁为民博士共同整理。鲁博士拥有清华大学学士和美国加州理工学院博士学位,在人工智能领域造诣深厚:

-

- 在IEEE Transactions等顶级学术期刊及国际会议发表论文超过50篇。

- 拥有多项中美发明专利。

- 荣获吴文俊人工智能科学技术奖(中国人工智能领域重要奖项)。

-

目前,我有幸与鲁博士共同进行人工智能相关研究。

内容实用,循序渐进:

-

资料体系化覆盖了从基础概念入门到核心技术进阶的知识点。

-

包含丰富的视频教程与实战项目案例,强调动手实践能力。

-

无论你是初探AI领域的新手,还是已有一定技术基础希望深入大模型的学习者,这份资料都能为你提供系统性的学习路径和宝贵的实践参考,助力你提升技术能力,向大模型相关岗位转型发展。

抓住机遇,开启你的AI学习之旅!

1209

1209

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?