✅作者简介:热爱科研的Matlab仿真开发者,擅长数据处理、建模仿真、程序设计、完整代码获取、论文复现及科研仿真。

🍎 往期回顾关注个人主页:Matlab科研工作室

🍊个人信条:格物致知,完整Matlab代码及仿真咨询内容私信。

🔥 内容介绍

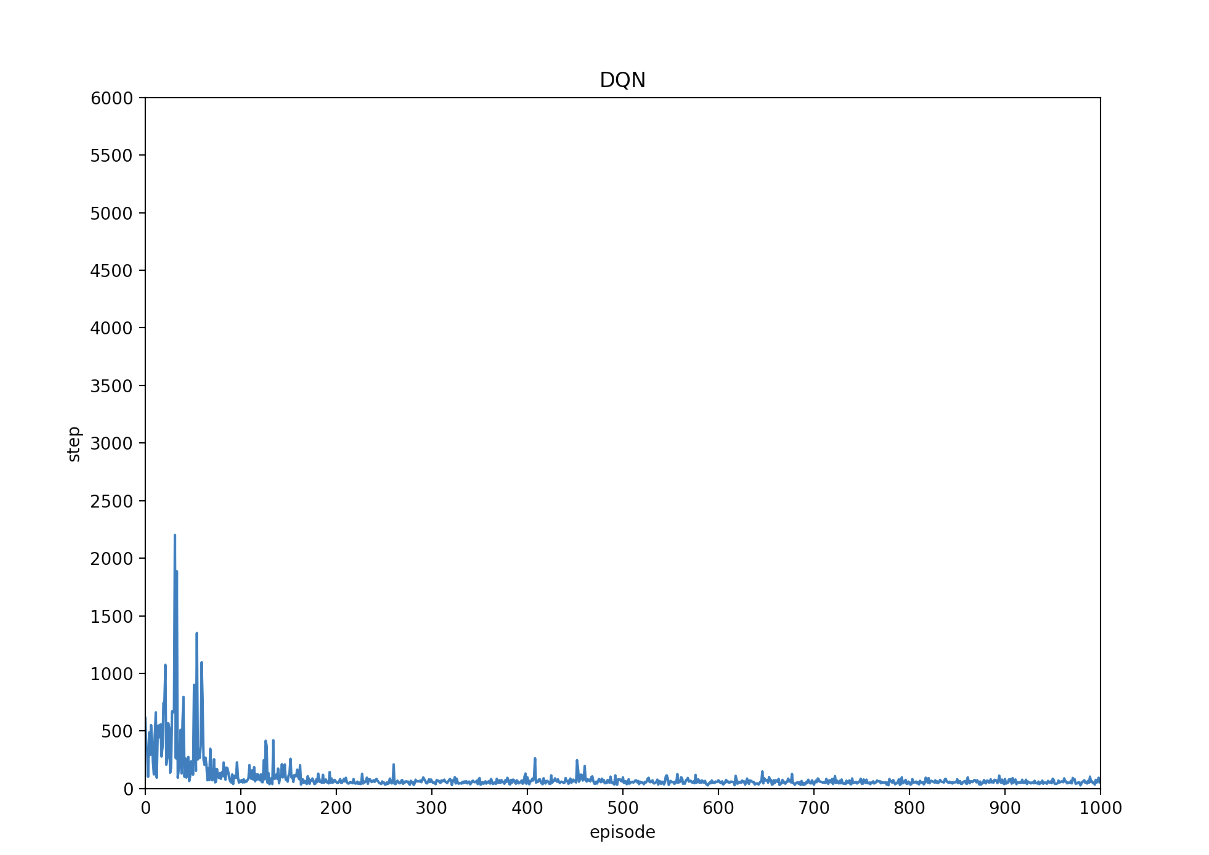

在移动机器人与智能体自主导航领域,避障控制是关键技术。本文基于深度学习框架 Pytorch,深入研究 DQN 算法、优先级采样的 DQN 算法以及 DQN + 人工势场的避障控制方法。通过构建仿真环境,对比分析三种算法在避障任务中的性能表现,包括学习效率、避障成功率和路径优化能力。研究结果表明,优先级采样的 DQN 算法在学习效率上表现突出,DQN + 人工势场算法在复杂环境下的避障成功率和路径规划质量更优,为智能体避障控制提供了多样化的解决方案和技术参考。

关键词

Pytorch;DQN 算法;优先级采样;人工势场;避障控制

一、引言

1.1 研究背景

随着人工智能与机器人技术的快速发展,移动机器人和智能体在工业、服务、探索等领域的应用日益广泛。在实际应用场景中,智能体需要在复杂环境下自主导航并完成避障任务,这对避障控制算法的性能提出了更高要求。深度强化学习算法因其强大的自主学习和决策能力,成为解决避障问题的热门研究方向,其中深度 Q 网络(DQN)算法在诸多领域取得了良好应用成果。

1.2 研究现状

传统的避障算法如人工势场法,原理直观、计算简单,但存在局部极小值等问题;经典的强化学习算法在处理高维状态和动作空间时面临维数灾难。DQN 算法通过结合深度神经网络和 Q - learning,有效解决了传统强化学习在复杂环境下的应用难题。在此基础上,优先级采样的 DQN 算法优化了经验回放机制,DQN + 人工势场的结合则尝试融合两种方法的优势。然而,目前针对这几种算法在避障控制中的系统性对比研究仍有不足。

1.3 研究目的与意义

本研究旨在基于 Pytorch 框架,实现 DQN 算法、优先级采样的 DQN 算法以及 DQN + 人工势场的避障控制,并通过仿真实验对比分析它们的性能,明确各算法的优势与局限性,为不同场景下智能体的避障控制算法选择提供理论依据和实践指导,推动智能体自主导航技术的发展。

二、DQN 算法原理与实现

2.1 DQN 算法基本原理

DQN 算法结合了 Q - learning 算法和深度神经网络(DNN)。Q - learning 是一种基于值函数的强化学习算法,通过不断更新 Q 值表来学习最优策略;DNN 则用于逼近 Q 值函数,以处理高维状态空间。在 DQN 中,智能体与环境进行交互,将状态、动作、奖励和下一状态存储在经验回放缓冲区中,然后随机采样一批数据用于训练神经网络,通过最小化预测 Q 值与目标 Q 值之间的均方误差来更新网络参数,逐步学习到最优的避障策略 。

2.2 基于 Pytorch 的 DQN 算法实现

- 网络结构设计:使用 Pytorch 搭建深度神经网络,包括输入层、隐藏层和输出层。输入层接收智能体的状态信息,如位置、速度、障碍物距离等;隐藏层采用多层全连接层提取特征;输出层输出每个动作对应的 Q 值。

- 经验回放机制:创建经验回放缓冲区,存储智能体在与环境交互过程中产生的经验数据。在训练时,从缓冲区中随机采样数据,打破数据之间的相关性,提高训练的稳定性和效率。

- 目标网络更新:引入目标网络来稳定训练过程,定期将主网络的参数复制到目标网络,用于计算目标 Q 值,减少训练过程中的波动。

- 训练与优化:定义损失函数(均方误差),使用随机梯度下降(SGD)或其改进算法(如 Adam)对网络进行优化,通过不断迭代训练,使网络学习到最优的避障策略。

⛳️ 运行结果

📣 部分代码

🔗 参考文献

🎈 部分理论引用网络文献,若有侵权联系博主删除

👇 关注我领取海量matlab电子书和数学建模资料

🏆团队擅长辅导定制多种科研领域MATLAB仿真,助力科研梦:

🌈 各类智能优化算法改进及应用

生产调度、经济调度、装配线调度、充电优化、车间调度、发车优化、水库调度、三维装箱、物流选址、货位优化、公交排班优化、充电桩布局优化、车间布局优化、集装箱船配载优化、水泵组合优化、解医疗资源分配优化、设施布局优化、可视域基站和无人机选址优化、背包问题、 风电场布局、时隙分配优化、 最佳分布式发电单元分配、多阶段管道维修、 工厂-中心-需求点三级选址问题、 应急生活物质配送中心选址、 基站选址、 道路灯柱布置、 枢纽节点部署、 输电线路台风监测装置、 集装箱调度、 机组优化、 投资优化组合、云服务器组合优化、 天线线性阵列分布优化、CVRP问题、VRPPD问题、多中心VRP问题、多层网络的VRP问题、多中心多车型的VRP问题、 动态VRP问题、双层车辆路径规划(2E-VRP)、充电车辆路径规划(EVRP)、油电混合车辆路径规划、混合流水车间问题、 订单拆分调度问题、 公交车的调度排班优化问题、航班摆渡车辆调度问题、选址路径规划问题、港口调度、港口岸桥调度、停机位分配、机场航班调度、泄漏源定位

🌈 机器学习和深度学习时序、回归、分类、聚类和降维

2.1 bp时序、回归预测和分类

2.2 ENS声神经网络时序、回归预测和分类

2.3 SVM/CNN-SVM/LSSVM/RVM支持向量机系列时序、回归预测和分类

2.4 CNN|TCN|GCN卷积神经网络系列时序、回归预测和分类

2.5 ELM/KELM/RELM/DELM极限学习机系列时序、回归预测和分类

2.6 GRU/Bi-GRU/CNN-GRU/CNN-BiGRU门控神经网络时序、回归预测和分类

2.7 ELMAN递归神经网络时序、回归\预测和分类

2.8 LSTM/BiLSTM/CNN-LSTM/CNN-BiLSTM/长短记忆神经网络系列时序、回归预测和分类

2.9 RBF径向基神经网络时序、回归预测和分类

基于Pytorch的DQN避障控制算法研究

基于Pytorch的DQN避障控制算法研究

2242

2242

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?