1. batch normalization

将一个batch size中同一个通道的所有像素值做成总和为0的分布,让像素分布更加的均匀,有利于模型参数的优化

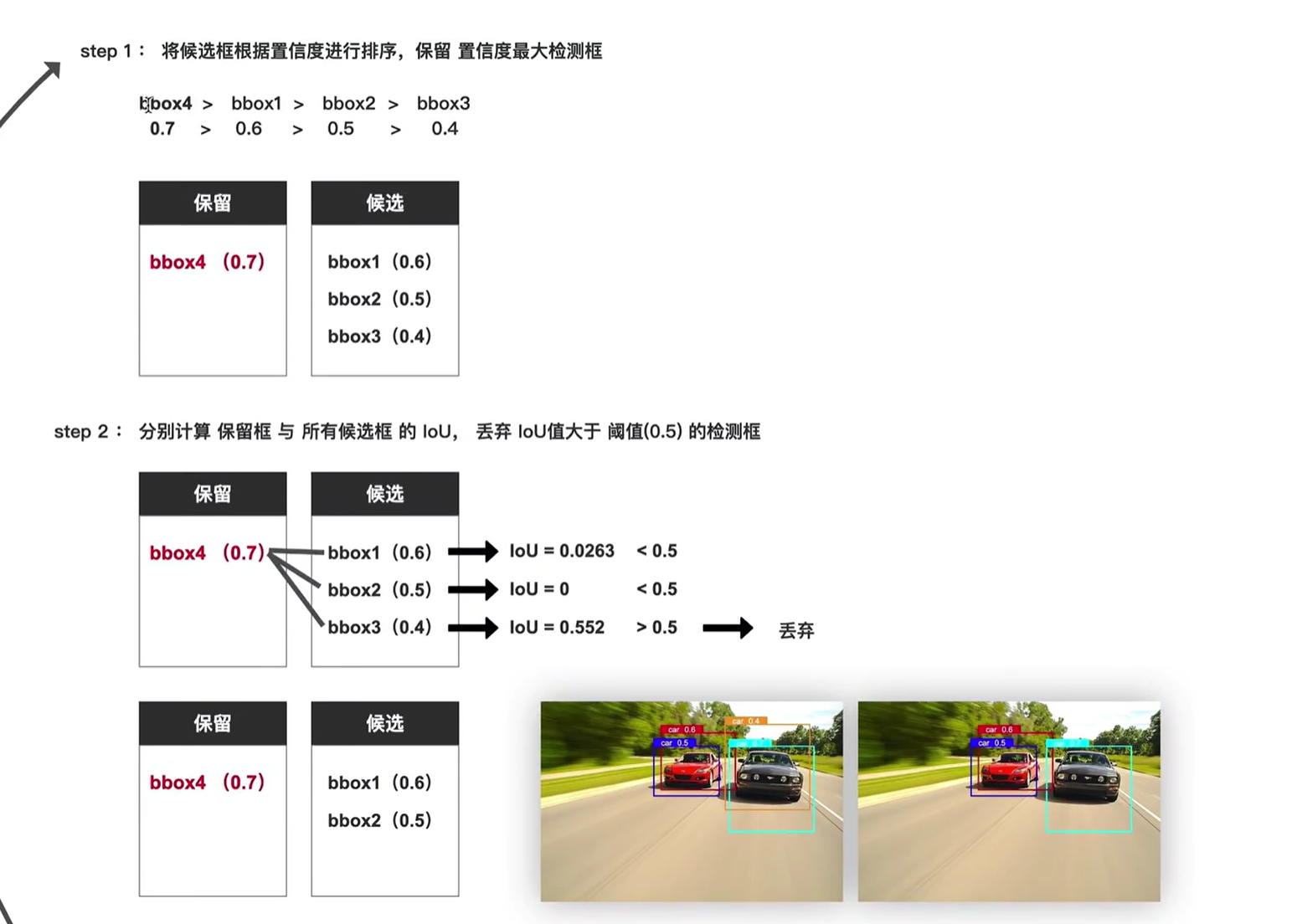

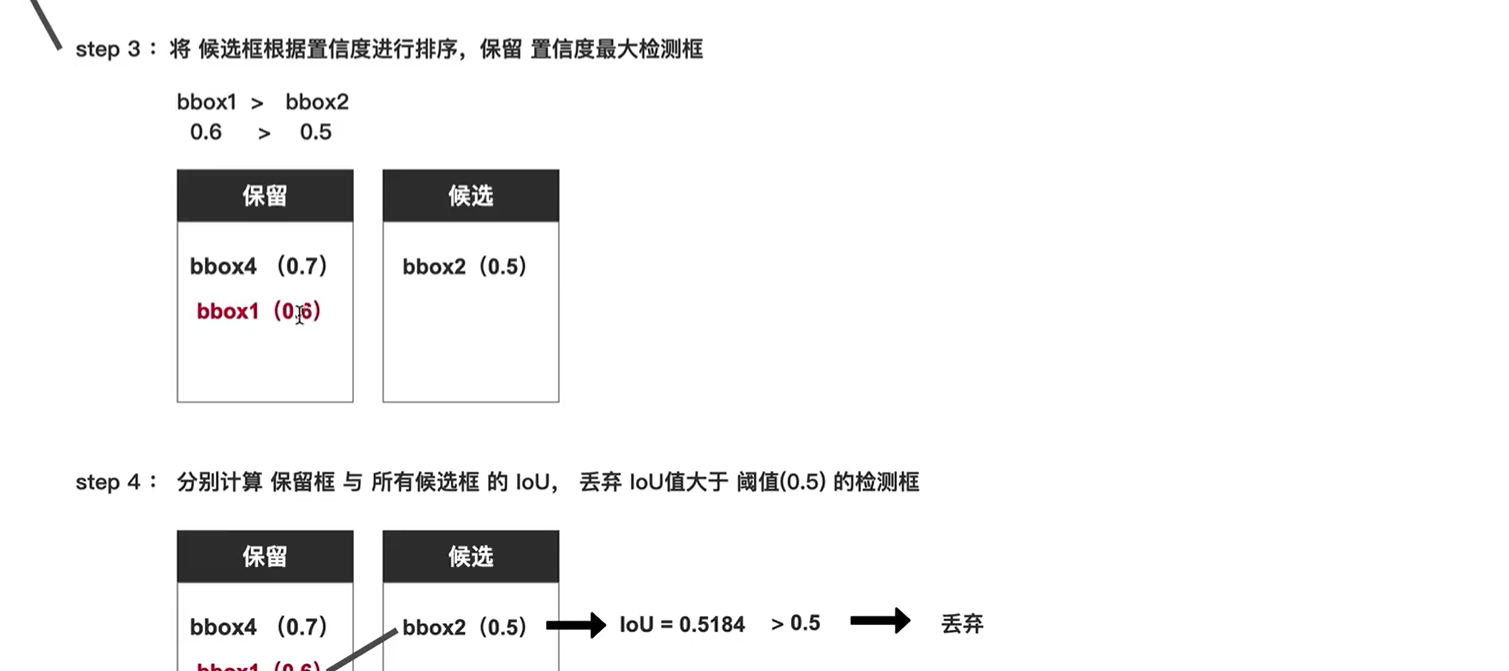

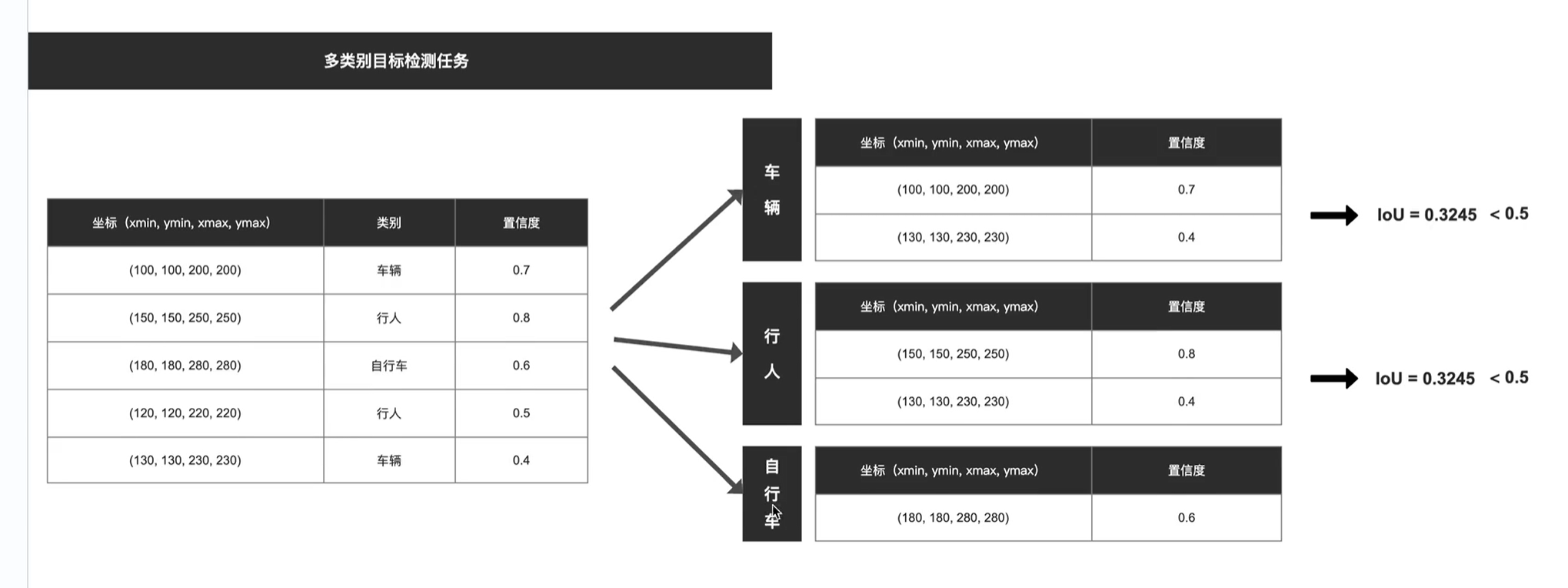

2. IOU与NWS

多头注意力机制:

1. 将图像分成多个patch

2. 每个patch进行embedding,得到一个向量,这个过程中每个patch加上位置编码

3. 将每个patch分别提取qkv

4.多个patch之间进行交叉q*K*V, 得到每个patch对应的新的向量

5. 每个向量按照头数进行拆分

6.利用全连接层把每个patch对应位置的向量进行合并

37万+

37万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?