1.前言

多目标跟踪,既MOT(Multiple Object Tracking),它一般由检测器模块和数据关联模块两个模块组成,它的作用是在事先不知道目标情况的前提下,对视频中用户感兴趣的目标,如行人、汽车、动物等进行检测并赋予ID进行轨迹跟踪的技术。

大多数方法通过关联分数高于阈值的检测框来获取标识。检测分数低的物体,例如被遮挡的物体,被简单地扔掉,这会带来不可忽视的真实物体缺失和碎片化的轨迹。基于此背景,论文《ByteTrack: Multi-Object Tracking by Associating Every Detection Box》中提出了一个基于目标检测(Tracking-by-detection)的多目标跟踪模型-ByteTrack,通过关联每个检测框而不是仅关联高分检测框来进行跟踪。对于低分检测框,我们利用它们与轨迹的相似性来恢复真实对象并过滤掉背景检测。论文里着重介绍了一个数据关联模型-Byte,但它并没有提出一个新的检测器模块,使用了YOLOX作为它的检测器模块。

文章地址:https://arxiv.org/pdf/2110.06864.pdf

代码地址:https://github.com/ifzhang/ByteTrack

2.检测器模块

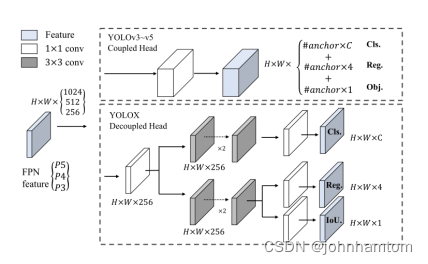

ByteTrack模型使用YOLOX作为检测器模块,YOLOX是2021年提出的高性能检测器,YOLOX将YOLO系列探测器切换到了无锚模式,而且采用了其他先进的检测技术,包括去耦头、强数据增强、多阳性和有效的标签分配策略Simota,以实现先进的目标检测性能,网络结构图如图所示,这里不介绍太多。

文章地址:https://arxiv.org/abs/2107.08430

3.数据关联模块

数据关联模块是多目标跟

ByteTrack是一种多目标跟踪(MOT)方法,它使用YOLOX检测器并改进了数据关联策略,关联每个检测框而非仅限于高分框,从而减少目标丢失。该模型通过保留低分检测框并利用其与轨迹的相似性来恢复真实目标。数据关联过程包括两次匹配,一次针对高分检测框,一次针对低分检测框,有效地处理遮挡和运动模糊问题。

ByteTrack是一种多目标跟踪(MOT)方法,它使用YOLOX检测器并改进了数据关联策略,关联每个检测框而非仅限于高分框,从而减少目标丢失。该模型通过保留低分检测框并利用其与轨迹的相似性来恢复真实目标。数据关联过程包括两次匹配,一次针对高分检测框,一次针对低分检测框,有效地处理遮挡和运动模糊问题。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1897

1897

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?