大家见识了各个大模型的“超能力”,如今雨后春笋般出现的各种AI应用,基本上都是基于大模型的二次开发与应用,对于拥有“洪荒之力”的大模型,想必各位都是小小的脑袋,大大的问号~不要着急,本次知识大课堂,崽儿就带领大家走进大模型家族,揭开它们的神秘身世。

各位圈中阿祖们,坐直身板,打起精神,冲好Coffee,摇晃红酒杯(拿出笔记本),崽儿老师开始上课啦!!!

2025年9月AI网站排行榜

来源:https://app.aibase.cn/best-ai-tools/

崽说. say

DeepSeek-R1

背景:

DeepSeek-R1是幻方量化旗下AI公司深度求索(DeepSeek)研发的推理模型。

特点:

1.采用强化学习进行后训练,旨在提升推理能力,擅长数学、代码和自然语言推理等复杂任务。

2.采用的大规模强化学习技术,仅需少量标注数据即可显著提升模型性能。模型完全开源,适配不同算力需求,进一步降低了AI应用门槛,赋能开源社区发展。

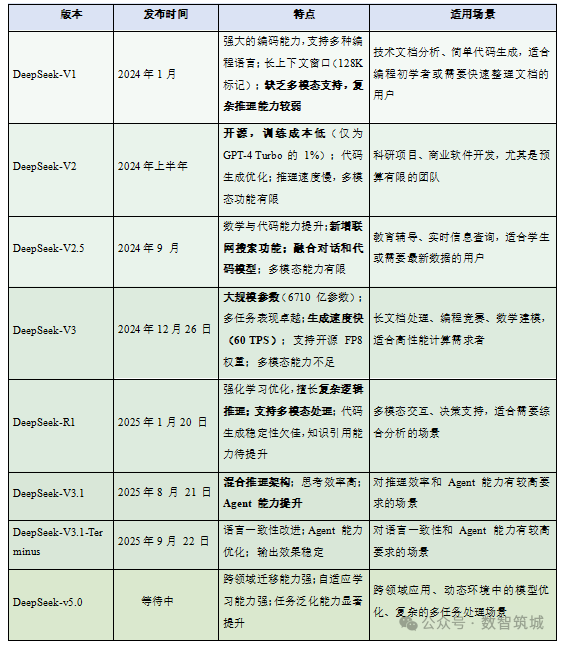

版本发展:

2

Qwen3(千问3)

背景:

Qwen3是阿里巴巴开源的新一代通义千问模型。

特点:

1.在架构上,Qwen3是中国国内首个“混合推理模型”,“快思考”与“慢思考”集成进同一个模型;在推理、指令遵循、工具调用、多语言能力等方面均大幅增强。

2.采用混合专家(Mo E)架构,包含2 个 MoE 模型和 6 个 dense 模型,部署成本大幅下降,显存占用仅为性能相近模型的三分之一。

版本发展:

豆包

背景:

豆包是字节跳动公司基于云雀模型开发的AI工具

特点:

1.提供聊天机器人、写作助手以及英语学习助手等功能;

2.支持语音通话、图片生成、视频生成等功能,相较于其他大模型智能体,豆包集成了最多的功能,具有更强的互动性。

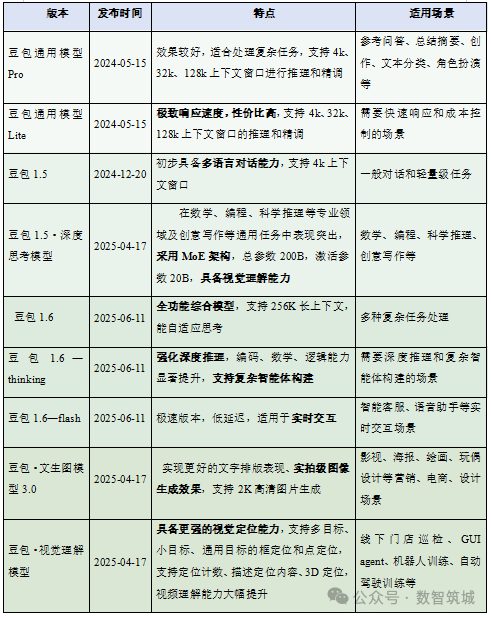

版本发展:

GPT-4.1

背景:

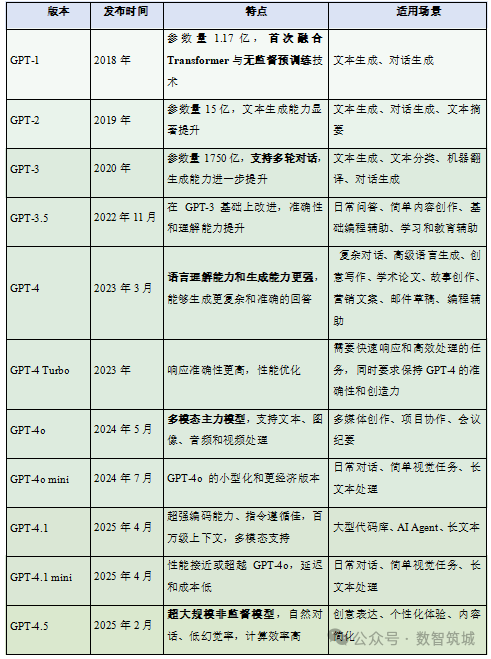

GPT(Generative Pre-trained Transformer)是由美国 Open AI 公司开发的基于Transformer 架构的生成式预训练语言模型,实现了对传统 AI 的突破性革新,重新定义了人们对 “机器理解与生成语言” 的认知,也推动了整个行业的发展方向,成为人工智能领域的重要里程碑。如果说Deep Seek是国内人工智能发展的推动者,那么GPT当之无愧是世界人工智能发展的先驱。

特点:

1.GPT-4.1具备更强的多模态处理能力,拥有 100 万个 token 的上下文窗口,成本相较 GPT-4o 降低了 26%。

2.擅长编码、指令遵循和长上下文理解,适用于处理复杂任务。

3.多个体量的模型能适应更多使用场景。

版本发展:

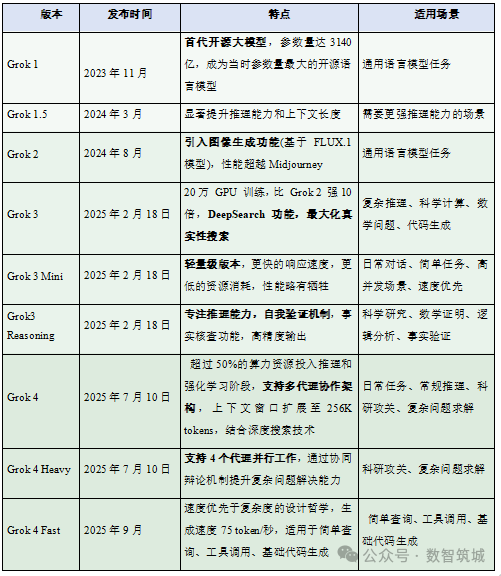

Grok 3

背景:

Grok 3 是由埃隆・马斯克旗下人工智能公司 x-AI 于 2025 年 2 月 18 日发布的第三代旗舰级大模型。

特点:

1.Grok 3 基于孟菲斯超级集群(10 万 - 20 万块英伟达 H100 GPU)训练,算力是前代 Grok 2 的 10 倍,成本降低 26%。

2.支持思维链(Chain of Thought)推理能力和实时信息处理,支持文本、图像多模态交互,并配备 256K token 的长上下文窗口(约 200 页文本),可处理复杂逻辑任务。

3.某些模块表现非常突出,包括:

Think/Big Brain:调用额外算力进行深度推理,在 AIME 2025 数学竞赛中得分 52%,远超 GPT-4o;

多模态支持:图像生成质量媲美专业工具。

版本发展:

Gemini 2.5 Pro

背景:

Gemini 2.5 Pro 是谷歌 Deep Mind 于 2025 年 3 月推出的旗舰级多模态大模型,定位为全场景智能协作工具。

特点:

1.超大上下文窗口:支持 100 万 tokens(约 2000 页文本),可处理完整代码库、长篇文档及复杂对话历史。

2.多模态深度融合:原生集成文本分析、图像生成、音频识别及视频理解能力。

3.结构化推理能力:通过 Thinking 功能 展示完整推理链。

4.实时信息整合:深度接入 Google 搜索,生成带引用的报告。

5.成本优势:输入 Token 价格仅为 OpenAI o3 的 1/8,Claude 4 Opus 的 1/10,适合企业级应用。

版本发展:

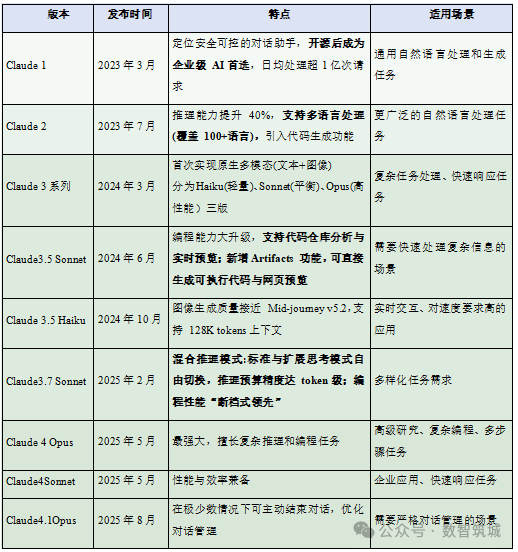

Claude 3.7 Sonnet

背景:

Claude 3.7 Sonnet 是 Anthropic 公司于2025 年 2 月 24 日发布的第三代旗舰级大模型,定位为混合推理与编程领域的标杆产品。在软件开发生命周期全流程支持上达到行业领先水平。

特点:

该模型在编程、数学、复杂任务规划等领域表现突出,其核心技术突破在于首次实现单一模型内的双模态推理——用户可自由切换标准模式(快速响应)与扩展思考模式(结构化推理),并通过控制推理预算(token 限制)平衡速度与准确性。

版本发展:

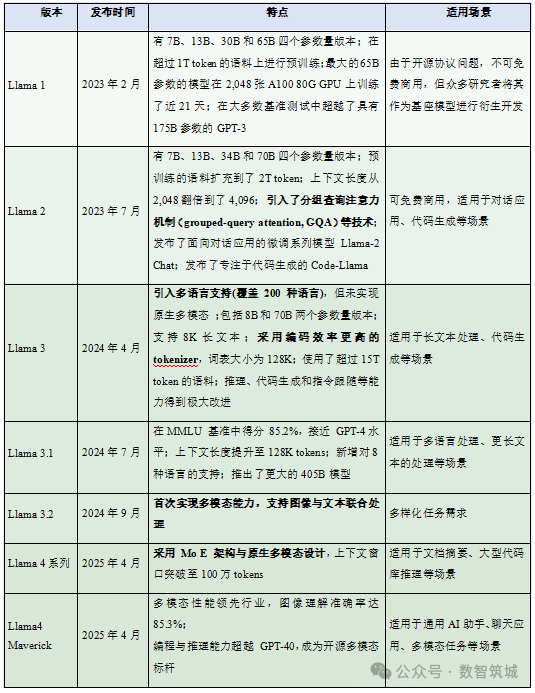

Llama 4 Maverick

背景:

Llama 4 Maverick 是 Meta 于 2025 年 4 月 5 日 发布的多模态旗舰模型,定位为高效能开源智能协作工具。

特点:

其核心技术突破在于首次将混合专家(MoE)架构与原生多模态能力深度结合,支持文本与图像的协同处理,并在长上下文、编程推理等领域实现行业领先性能。

版本发展:

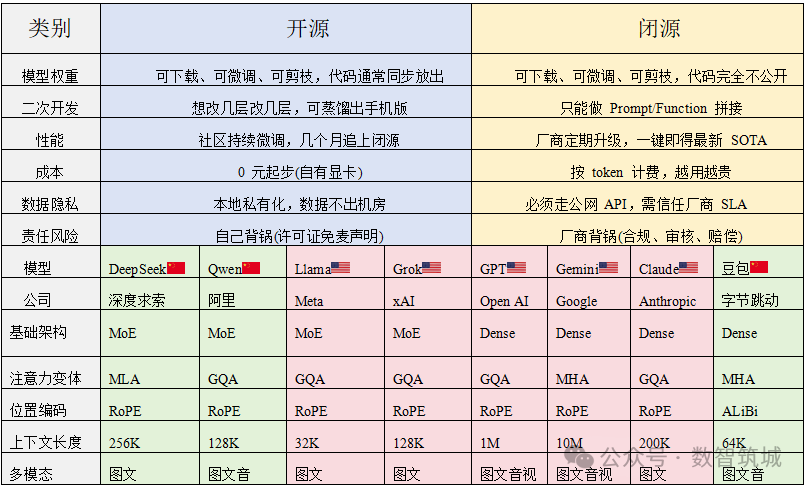

崽思. summary

1.技术路线趋同:全部转向 MoE+多模态+长上下文;Gemini/Claude 先推出“内置思考链”,GPT-5、Qwen-3、DeepSeek 快速跟进。

2.模型架构趋同:全是“Transformer + RoPE + SwiGLU”底色,差异仅在于“MoE 专家数/注意力变体/上下文长度”三点。

3.开源三兄弟(DeepSeek/Qwen/Llama)都放出官方 INT4/INT8 量化脚本,可在 8×A100 把 400B+ MoE 跑起来;闭源四家只给 HTTP API,内部通信协议未披露。

4.建立生态即护城河:OpenAI 靠插件+Canvas,Google 靠搜索+YouTube,字节靠抖音+飞书,Meta 靠开源社区,谁掌握“数据-场景-用户”闭环,谁就能持续领先。

5.开源与闭源差距缩小:DeepSeek-V3.1 综合分 58.4,已逼近 GPT-5 (59.4),Llama-4、Qwen-3 在 55-57 区间。

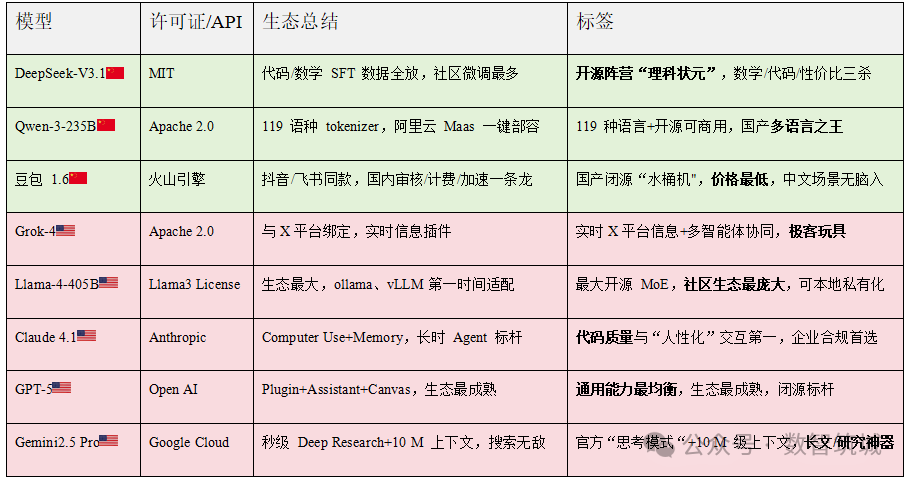

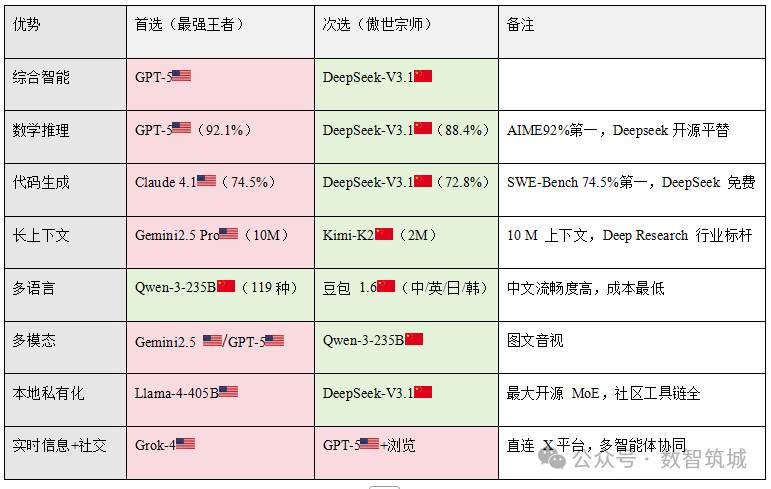

选用大模型总结:(全字背诵,必考点!!!)

从应用场景:

GPT 生态大,Gemini 长文霸;

Claude 代码神,Grok 实时刷;

DeepSeek 数学狠,Qwen 多语霸;

豆包价格低,Llama 私有化。

从经济现实:

对价格极度敏感-DeepSeek/豆包;

要开源可本地-Lama-4/Qwen-3;

预算充足要顶配-GPT-5-high / Claude 4.1。

2025年10月官方报价

图片来源:网络

崽学. study

1.开源 = 把“权重 + 训练代码 + 许可证”一次性打包给你,可改可商用;

闭源 = 只给黑盒 API,模型怎么来的、长啥样、能不能改,全靠厂商良心。

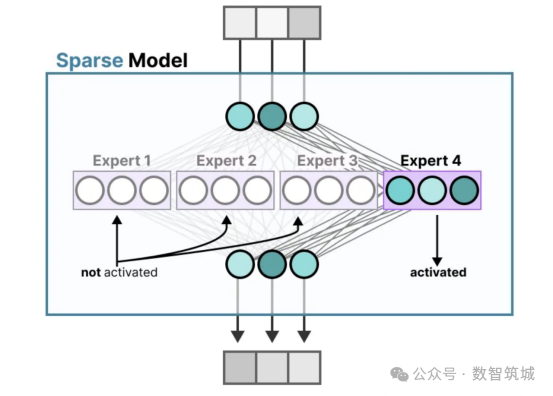

2.MoE(Mixture of Experts,混合专家模型)是一种稀疏激活的深度学习架构,核心思想是:

用多个“专家子网络”分工协作,每次只激活其中一小部分,从而在不增加计算量的前提下,把模型容量做大。

Sparse Model架构

图片来源:网络

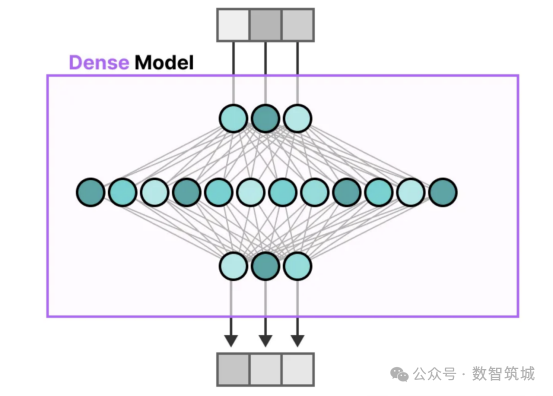

3.Dense架构(全连接架构)是一种神经网络架构,其核心特征是每一层的神经元与上一层所有神经元全连接,通过这种密集的连接方式实现特征的高效提取。

Dense架构

图片来源:网络

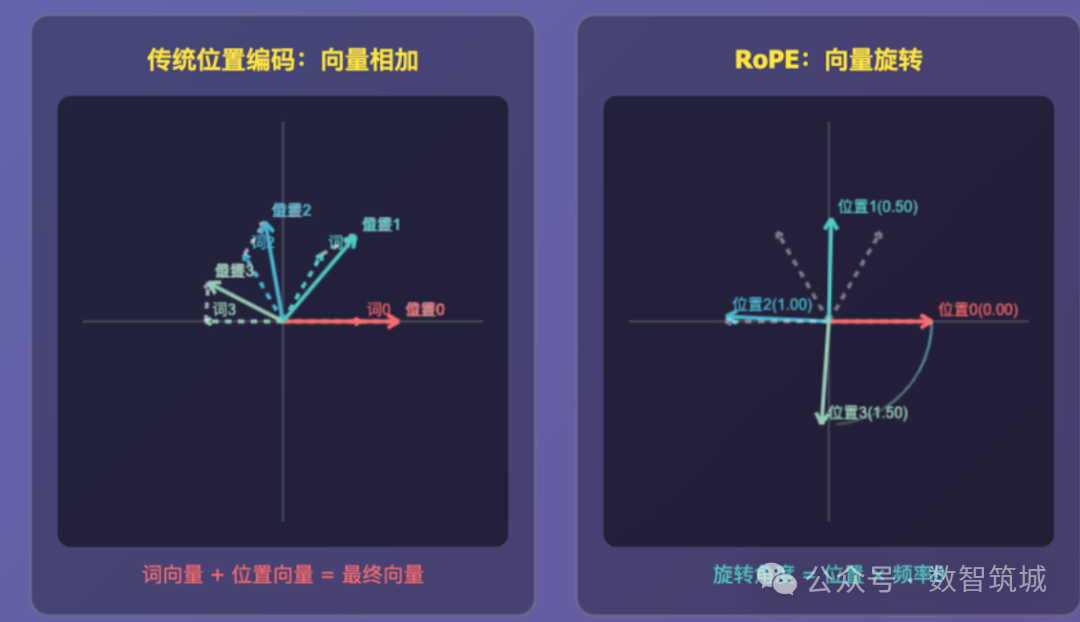

4.RoPE(Rotary Position Embedding)是一种用于Transformer模型的位置编码技术,通过旋转矩阵将位置信息融入词向量,解决了传统绝对位置编码无法处理长序列且无法体现相对位置关系的局限性。

其核心思想是将位置信息编码为旋转矩阵,并通过复数矩阵运算实现位置信息的动态调整。

传统位置编码与RoPE编码

5.大模型的上下文长度(Context Window)指模型单次推理中能处理的输入与输出文本总和的Token上限,直接影响模型处理长文档、维持对话连贯性和减少幻觉的能力。

887

887

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?