Tensorflow学习:手写数字识别(简单的神经网络,不含隐层)

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

# 载入数据集

mnist = input_data.read_data_sets("MNST_data", one_hot=True)

# 每个批次的大小:一次性向神经网络中放入100张图片进行训练:以矩阵的形式放进去

batch_size = 100

# 计算一共多少个批次 //:整除

n_batch = mnist.train.num_examples // batch_size

# 定义两个placeholder None:过会以一个批次喂进去,784:28*28(把一个图片拉成一个784的向量) 10:输出时0-9的10个数

x = tf.placeholder(tf.float32, [None, 784])

y = tf.placeholder(tf.float32, [None, 10])

# 定义一个简单的神经网络(只有输入层784个神经元,输出层10个神经元,不用隐层)

# 定义权值

W = tf.Variable(tf.zeros([784, 10]))

# 定义偏向值

b = tf.Variable(tf.zeros([10]))

# 通过softmax函数转化为概率值

prediction = tf.nn.softmax(tf.matmul(x, W) + b)

# 二次代价函数

loss = tf.reduce_mean(tf.square(y - prediction))

# 使用梯度下降法进行优化:是loss最小化,学习率:0.2

train_step = tf.train.GradientDescentOptimizer(0.2).minimize(loss)

# 初始化变量

init = tf.global_variables_initializer()

# 判断真实值与预测值是否相同(布尔类型),相同返回true

# tf.arg_max(prediction,1):求概率最大的数在哪个位置,相当于他的标签(返回一维张量中最大的值所在的位置)

correct_prediction = tf.equal(tf.argmax(y, 1), tf.arg_max(prediction, 1))

# 求准确率:cast:将bool类型转换成32位float类型,然后求一个平均值(true=1,false=0)

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

# 进行训练

with tf.Session() as sess:

# 初始化变量

sess.run(init)

# 训练次数:迭代21次

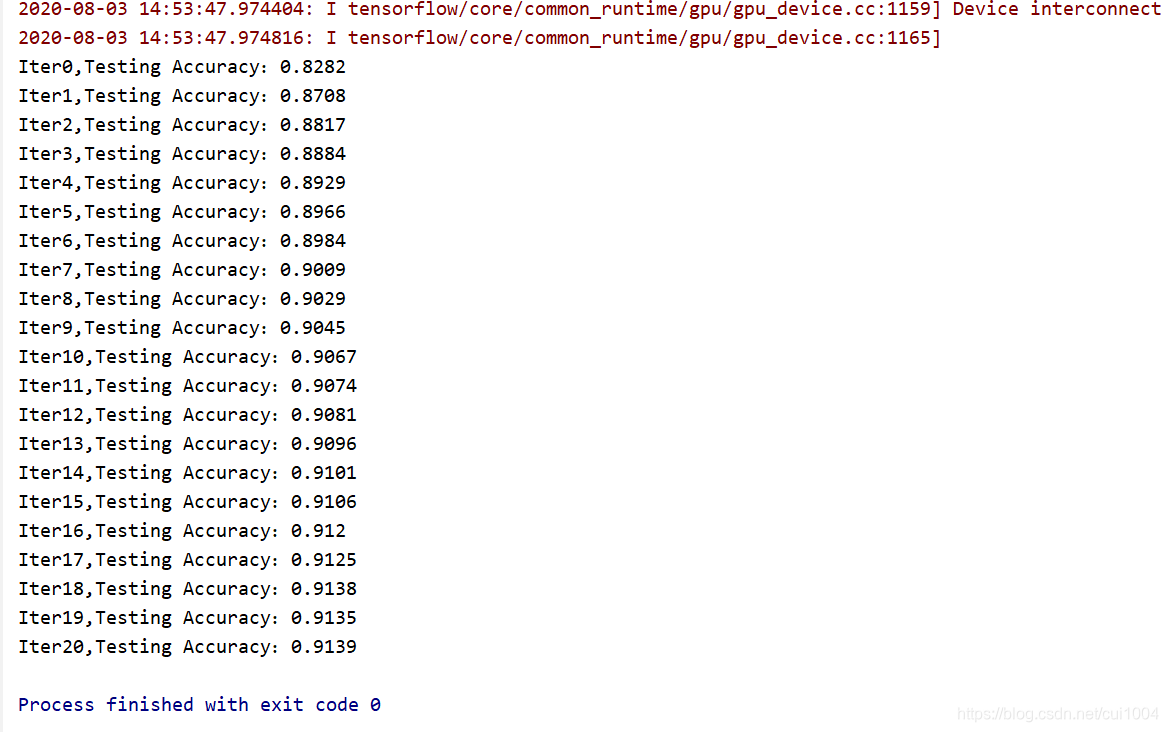

for step in range(21):

for batch in range(n_batch):

# 获得一个批次:100张图片

batch_xs, batch_ys = mnist.train.next_batch(batch_size)

# 把数据喂给它进行训练

sess.run(train_step, feed_dict={x: batch_xs, y: batch_ys})

# 进行完一次迭代训练打印出准确率:测试用的测试集中的图片和标签

acc = sess.run(accuracy, feed_dict={x: mnist.test.images, y: mnist.test.labels})

print("Iter" + str(step) + ",Testing Accuracy:" + str(acc))

进阶:可以对这个简单的神经网络进行优化:

1、batch_size:可以调整为50或者其他

2、可以增加隐藏层:可以增加一个隐藏层或者两个隐藏层,隐藏层的神经元可以设置10个或者100个。

3、损失函数可以不用二次代价函数,可以使用交叉熵代价函数和对数释然代价函数。

4、可以不使用梯度下降算法进行优化(或者改变梯度下降算法的学习率)。

5、训练的迭代次数可以进行改变,可以变成100或者200次迭代训练次数。

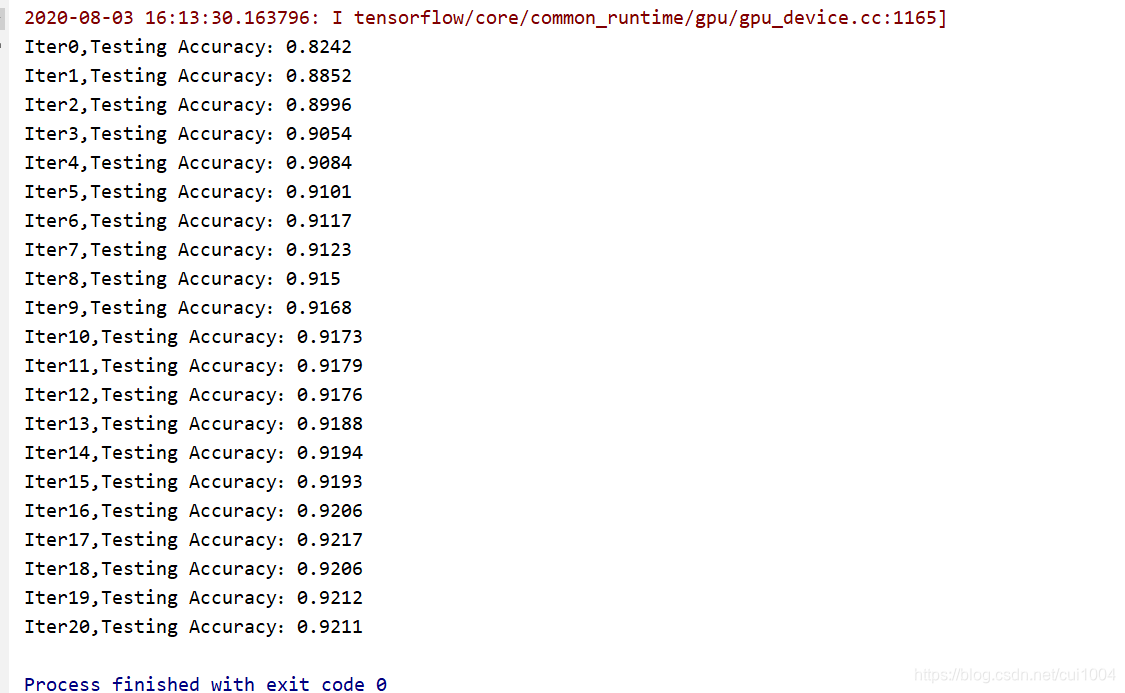

下面是将二次代价函数改成对数释然代价函数的训练结果

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

# 载入数据集

mnist = input_data.read_data_sets("MNST_data", one_hot=True)

# 每个批次的大小:一次性向神经网络中放入100张图片进行训练:以矩阵的形式放进去

batch_size = 100

# 计算一共多少个批次 //:整除

n_batch = mnist.train.num_examples // batch_size

# 定义两个placeholder None:过会以一个批次喂进去,784:28*28(把一个图片拉成一个784的向量) 10:输出时0-9的10个数

x = tf.placeholder(tf.float32, [None, 784])

y = tf.placeholder(tf.float32, [None, 10])

# 定义一个简单的神经网络(只有输入层784个神经元,输出层10个神经元,不用隐层)

# 定义权值

W = tf.Variable(tf.zeros([784, 10]))

# 定义偏向值

b = tf.Variable(tf.zeros([10]))

# 通过softmax函数转化为概率值

prediction = tf.nn.softmax(tf.matmul(x, W) + b)

# 二次代价函数

# loss = tf.reduce_mean(tf.square(y - prediction))

# 对数似然代价函数:label:真实标签值,logits:预测值,需要求下平均值

loss = tf.reduce_mean(tf.nn.softmax_cross_entropy_with_logits(labels=y, logits=prediction))

# 使用梯度下降法进行优化:是loss最小化,学习率:0.2

train_step = tf.train.GradientDescentOptimizer(0.2).minimize(loss)

# 初始化变量

init = tf.global_variables_initializer()

# 判断真实值与预测值是否相同(布尔类型),相同返回true

# tf.arg_max(prediction,1):求概率最大的数在哪个位置,相当于他的标签(返回一维张量中最大的值所在的位置)

correct_prediction = tf.equal(tf.argmax(y, 1), tf.arg_max(prediction, 1))

# 求准确率:cast:将bool类型转换成32位float类型,然后求一个平均值(true=1,false=0)

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

# 进行训练

with tf.Session() as sess:

# 初始化变量

sess.run(init)

# 训练次数:迭代21次

for step in range(21):

for batch in range(n_batch):

# 获得一个批次:100张图片

batch_xs, batch_ys = mnist.train.next_batch(batch_size)

# 把数据喂给它进行训练

sess.run(train_step, feed_dict={x: batch_xs, y: batch_ys})

# 进行完一次迭代训练打印出准确率:测试用的测试集中的图片和标签

acc = sess.run(accuracy, feed_dict={x: mnist.test.images, y: mnist.test.labels})

print("Iter" + str(step) + ",Testing Accuracy:" + str(acc))

附件:数据集连接:链接: https://pan.baidu.com/s/1tHdV4De4PLx-lEpvtheXMg 提取码: e1j1

1344

1344

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?